陈天桥邓亚峰联手破解大模型记忆难题!4个月打造SOTA系统,悬赏8万美元发起全球记忆挑战赛

陈天桥邓亚峰联手破解大模型记忆难题!4个月打造SOTA系统,悬赏8万美元发起全球记忆挑战赛开年,DeepSeek论文火遍全网,内容聚焦大模型记忆。

来自主题: AI技术研报

7664 点击 2026-02-06 10:35

开年,DeepSeek论文火遍全网,内容聚焦大模型记忆。

今天DeepSeek又发表了一篇论文,让AI解读,仔细读完,觉得很牛逼。

深夜,梁文锋署名的DeepSeek新论文又来了。这一次,他们提出全新的Engram模块,解决了Transformer的记忆难题,让模型容量不再靠堆参数!

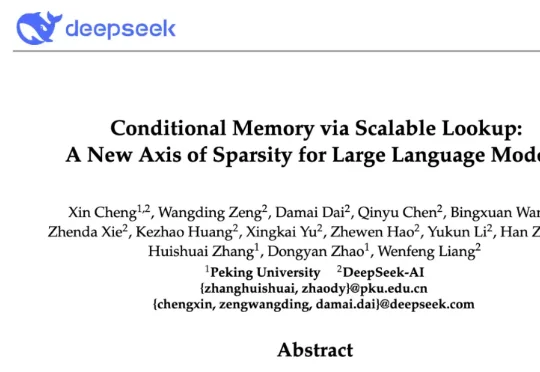

今天凌晨,喜欢闷声做大事的 DeepSeek 再次发布重大技术成果,在其 GitHub 官方仓库开源了新论文与模块 Engram,论文题为 “Conditional Memory via Scalable Lookup: A New Axis of Sparsity for Large Language Models”, 梁文锋再次出现在合著者名单中。

2026年新年第一天,DeepSeek又开卷了。

北大DeepSeek联合发布的NSA论文,目前已被ACL 2025录用并获得了极高评分,甚至有望冲击最佳论文奖。该技术颠覆传统注意力机制,实现算力效率飞跃,被誉为长文本处理的革命性突破。