医疗AI质变时刻来临!国产医疗AI率先突破,临床诊疗能力问鼎全球

医疗AI质变时刻来临!国产医疗AI率先突破,临床诊疗能力问鼎全球“我最近喉咙像刀割一样痛,还伴随鼻塞,但没有咳嗽……这是染上流感,还是又中招了?”

“我最近喉咙像刀割一样痛,还伴随鼻塞,但没有咳嗽……这是染上流感,还是又中招了?”

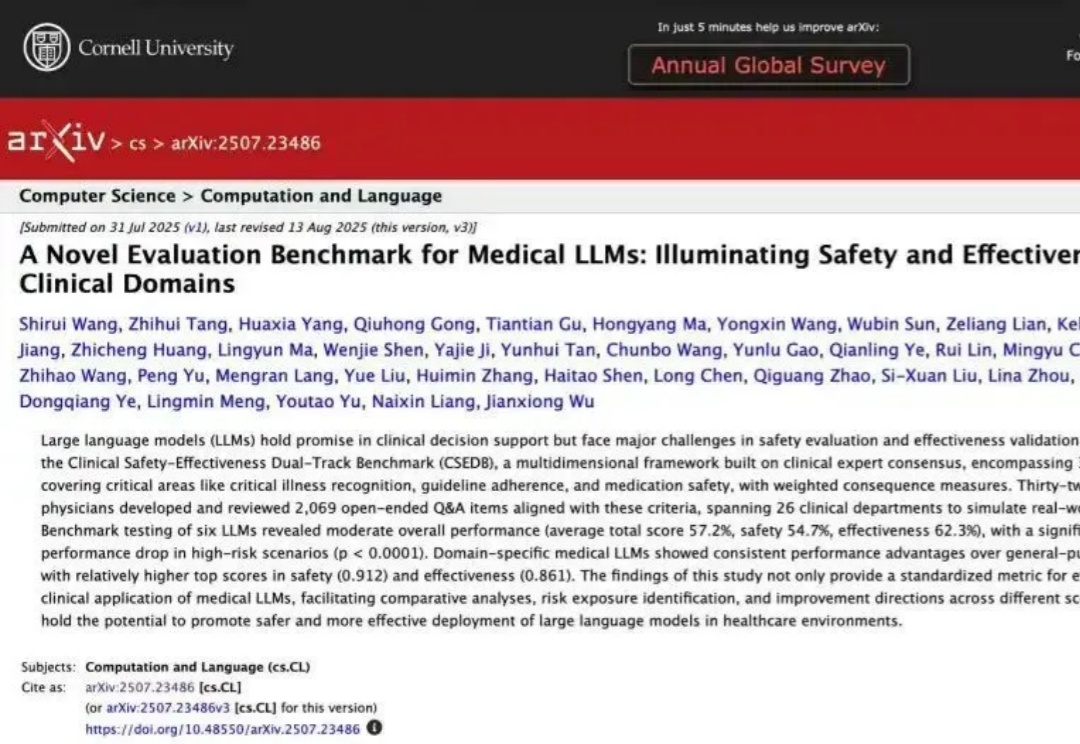

编程模型最新卷王来了。就在今天,火山引擎推出了面向Agentic编程任务深度优化的全新代码模型Doubao-Seed-Code。价格,调用价格国内最低,火山引擎还配套推出9块9套餐,一杯咖啡钱,就能搞定各种摸鱼小游戏——比如办公室躲老板(doge)。

AI正在以「教育革命」的名义,占领全球校园!清华的新生靠AI助理报到,加州州立大学把52万师生接入ChatGPT Edu,Google更直接向全球学生免费开放Gemini。看似高效的学习浪潮,却在悄悄重写权力格局:谁还在定义「什么叫学会」?当算法成为新的老师,大学的主权,是否已经被温柔地夺走?

近期,阿里巴巴 ROLL 团队(淘天未来生活实验室与阿里巴巴智能引擎团队)联合上海交通大学、香港科技大学推出「3A」协同优化框架 ——Async 架构(Asynchronous Training)、Asymmetric PPO(AsyPPO)与 Attention 机制(Attention-based Reasoning Rhythm),

大模型「灾难性遗忘」问题或将迎来突破。近日,NeurIPS 2025收录了谷歌研究院的一篇论文,其中提出一种全新的「嵌套学习(Nested Learning)」架构。实验中基于该框架的「Hope」模型在语言建模与长上下文记忆任务中超越Transformer模型,这意味着大模型正迈向具备自我改进能力的新阶段。

北京大学,银河通用,阿德莱德大学,浙江大学等机构合作,探究如何构建具身导航的基座模型(Embodied Navigation Foundation Model)提出了NavFoM,一个跨任务和跨载体的导航大模型。实现具身导航从“专用”到“通用”的技术跃进

几个月后,这家非营利研究机构及其新拆分的商业实体 Edison Scientific 又发布了一套更强大的 AI 科学家系统 Kosmos。这个系统在单次运行中可以持续工作 12 至 48 小时,完成相当于人类科研团队数月才能完成的工作量,且其产出的发现中有近 80% 经独立专家验证为准确。

3年时间,年收入达2.8亿美元,估值40亿美元。这是AI推理赛道跑出的最快独角兽。2025年10月28日,Fireworks AI宣布完成2.54亿美元C轮融资,由Lightspeed、Index Ventures和Evantic领投,英伟达、AMD、红杉资本、Databricks等跟投。创始人乔琳是PyTorch框架的核心创建者、复旦大学计算机系校友。

目前,最先进的对齐方法是使用知识蒸馏(Knowledge Distillation, KD)在所有 token 上最小化 KL 散度。然而,最小化全局 KL 散度并不意味着 token 的接受率最大化。由于小模型容量受限,草稿模型往往难以完整吸收目标模型的知识,导致直接使用蒸馏方法的性能提升受限。在极限场景下,草稿模型和目标模型的巨大尺寸差异甚至可能导致训练不收敛。

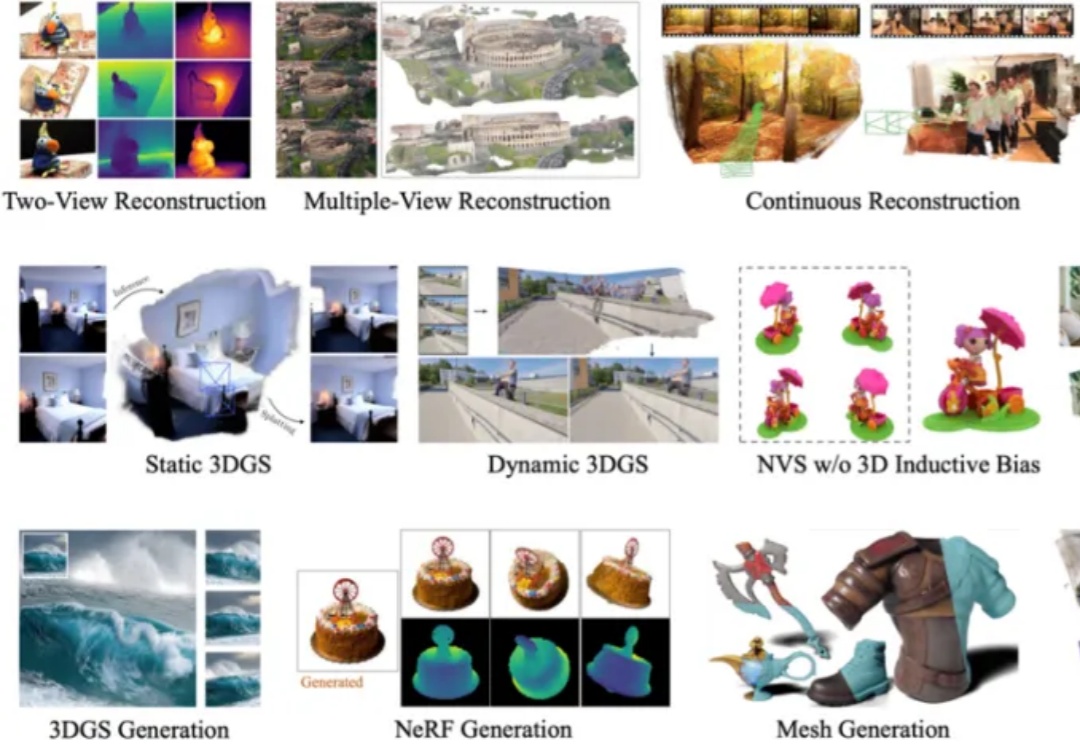

在 3D 视觉领域,如何从二维图像快速、精准地恢复三维世界,一直是计算机视觉与计算机图形学最核心的问题之一。从早期的 Structure-from-Motion (SfM) 到 Neural Radiance Fields (NeRF),再到 3D Gaussian Splatting (3DGS),技术的演进让我们离实时、通用的 3D 理解越来越近。