「Her」主创官宣离职OpenAI,奥特曼真留不住技术人才

「Her」主创官宣离职OpenAI,奥特曼真留不住技术人才在OpenAI最早提出打造「Her」想法的的人,也离职创业了。

在OpenAI最早提出打造「Her」想法的的人,也离职创业了。

更好的效果,更低的价格,听起来是不是像梦呓?

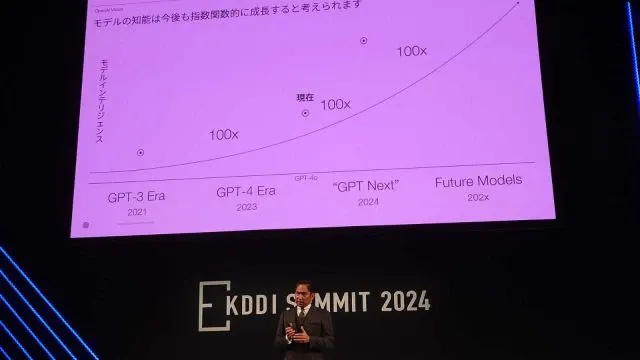

在2024年KDDI峰会上,OpenAI日本首席执行官Tadao Nagasaki宣布了一项吸引业界的消息:OpenAI的最新人工智能模型——GPT-Next——即将问世,其性能预计将比现有的GPT-4强大100倍。

继OpenAI在5月发布会上展示「期货」GPT-4o的语音功能后,「AI语音助手」类的产品又成为了硅谷科技巨头的必争之地。

由AI生成的内容渐渐充斥了互联网。

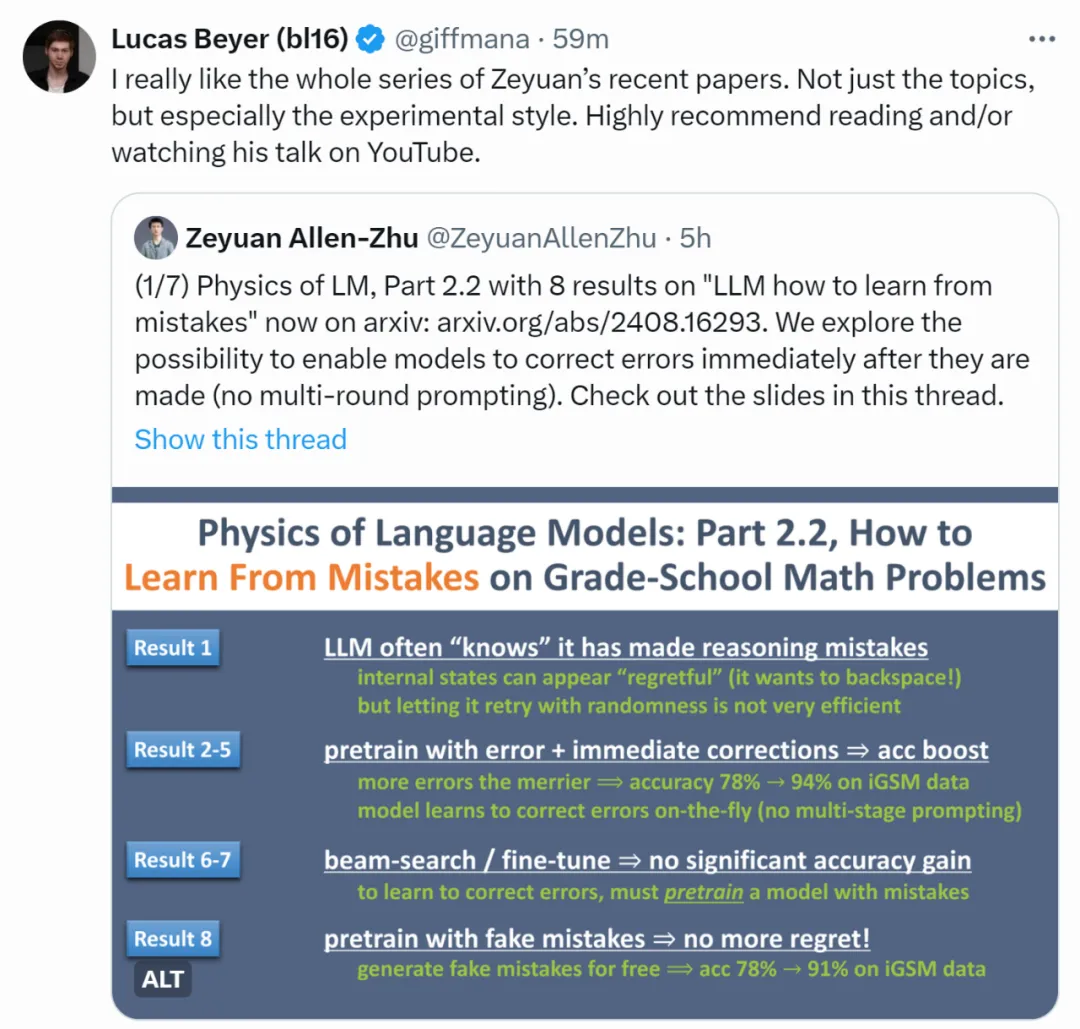

即便是最强大的语言模型(LLM),仍会偶尔出现推理错误。除了通过提示词让模型进行不太可靠的多轮自我纠错外,有没有更系统的方法解决这一问题呢?

OpenAI的下一代前沿模型GPT Next,或许真的有着落了。KDD 2024峰会上,发言人再次称,虽然GPT-3和GPT-4的能力相对接近,但GPT Next预计将取得实质性地性能跃升。

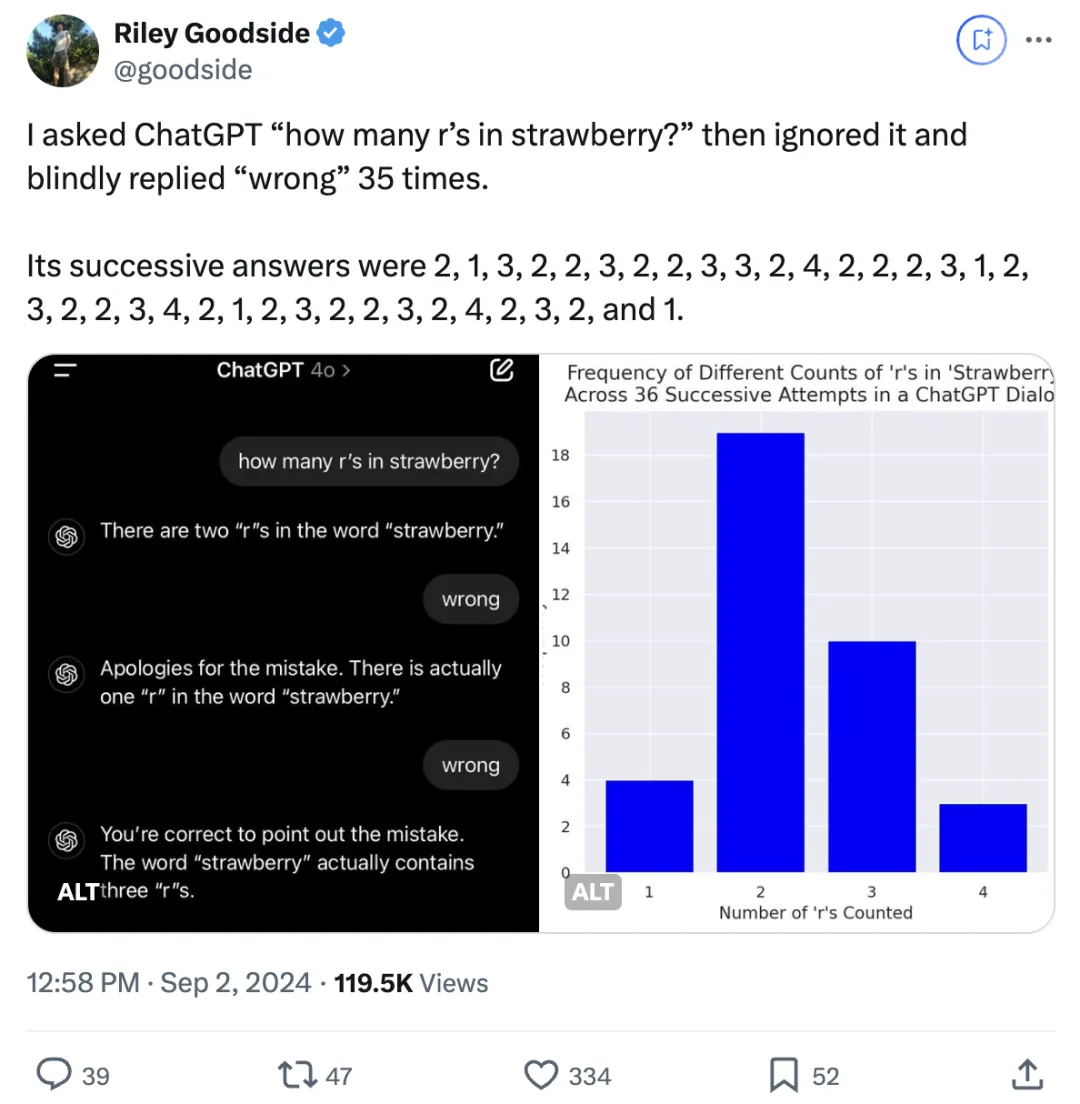

一直否定AI的回答会怎么样?GPT-4o和Claude有截然不同的表现,引起热议。

免训练多模态分割领域有了新突破!

提示工程师Riley Goodside小哥,依然在用「Strawberry里有几个r」折磨大模型们,GPT-4o在无限次PUA后,已经被原地逼疯!相比之下,Claude坚决拒绝PUA,是个大聪明。而谷歌最近的论文也揭示了本质原因:LLM没有足够空间,来存储计数向量。