ACL 2024 | 对25个开闭源模型数学评测,GPT-3.5-Turbo才勉强及格

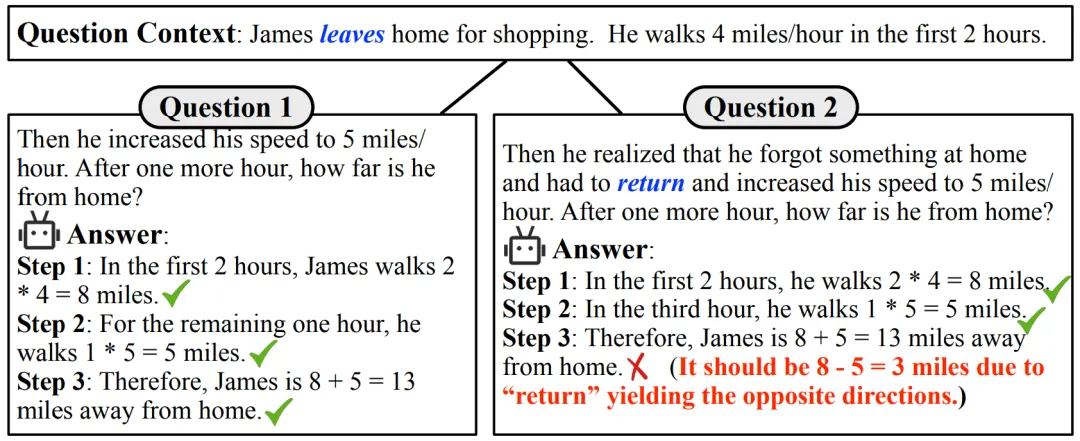

ACL 2024 | 对25个开闭源模型数学评测,GPT-3.5-Turbo才勉强及格大型语言模型(LLMs)在解决问题方面的非凡能力日益显现。最近,一个值得关注的现象是,这些模型在多项数学推理的基准测试中获得了惊人的成绩。以 GPT-4 为例,在高难度小学应用题测试集 GSM8K [1] 中表现优异,准确率高达 90% 以上。同时,许多开源模型也展现出了不俗的实力,准确率超过 80%。

大型语言模型(LLMs)在解决问题方面的非凡能力日益显现。最近,一个值得关注的现象是,这些模型在多项数学推理的基准测试中获得了惊人的成绩。以 GPT-4 为例,在高难度小学应用题测试集 GSM8K [1] 中表现优异,准确率高达 90% 以上。同时,许多开源模型也展现出了不俗的实力,准确率超过 80%。

还记得去年 AI 大牛 Andrej Karpathy 大力宣传的「AutoGPT」项目吗?它是一个由 GPT-4 驱动的实验性开源应用程序,可以自主实现用户设定的任何目标,展现出了自主 AI 的发展趋势。

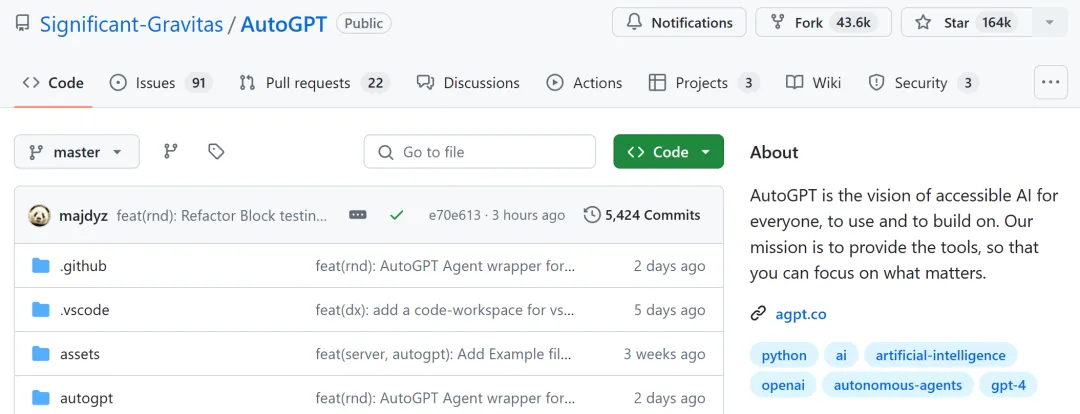

没眼看……“9.11和9.9哪个大”这样简单的问题,居然把主流大模型都难倒了??

把因果链展示给 LLM,它就能学会公理。

视觉大语言模型在最基础的视觉任务上集体「翻车」,即便是简单的图形识别都能难倒一片,或许这些最先进的VLM还没有发展出真正的视觉能力?

MoE已然成为AI界的主流架构,不论是开源Grok,还是闭源GPT-4,皆是其拥趸。然而,这些模型的专家,最大数量仅有32个。最近,谷歌DeepMind提出了全新的策略PEER,可将MoE扩展到百万个专家,还不会增加计算成本。

来自微软、MIT等机构的学者提出了一种创新的训练范式,攻破了大模型的推理缺陷。他们通过因果模型构建数据集,直接教模型学习公理,结果只有67M参数的微型Transformer竟能媲美GPT-4的推理能力。

一位已婚男子在AI那里,找到了认同和肯定。MIT研究AI与人类亲密关系先驱称,这只是「亲密幻觉」。

OpenAI全新的AGI路线图,刚刚被曝出了!OpenAI将AI划分为5个等级,自称其AI模型正处于L1,但很快就会达到L2(推理者)。而根据其前研究员预测,五级AGI最快将在27年实现。

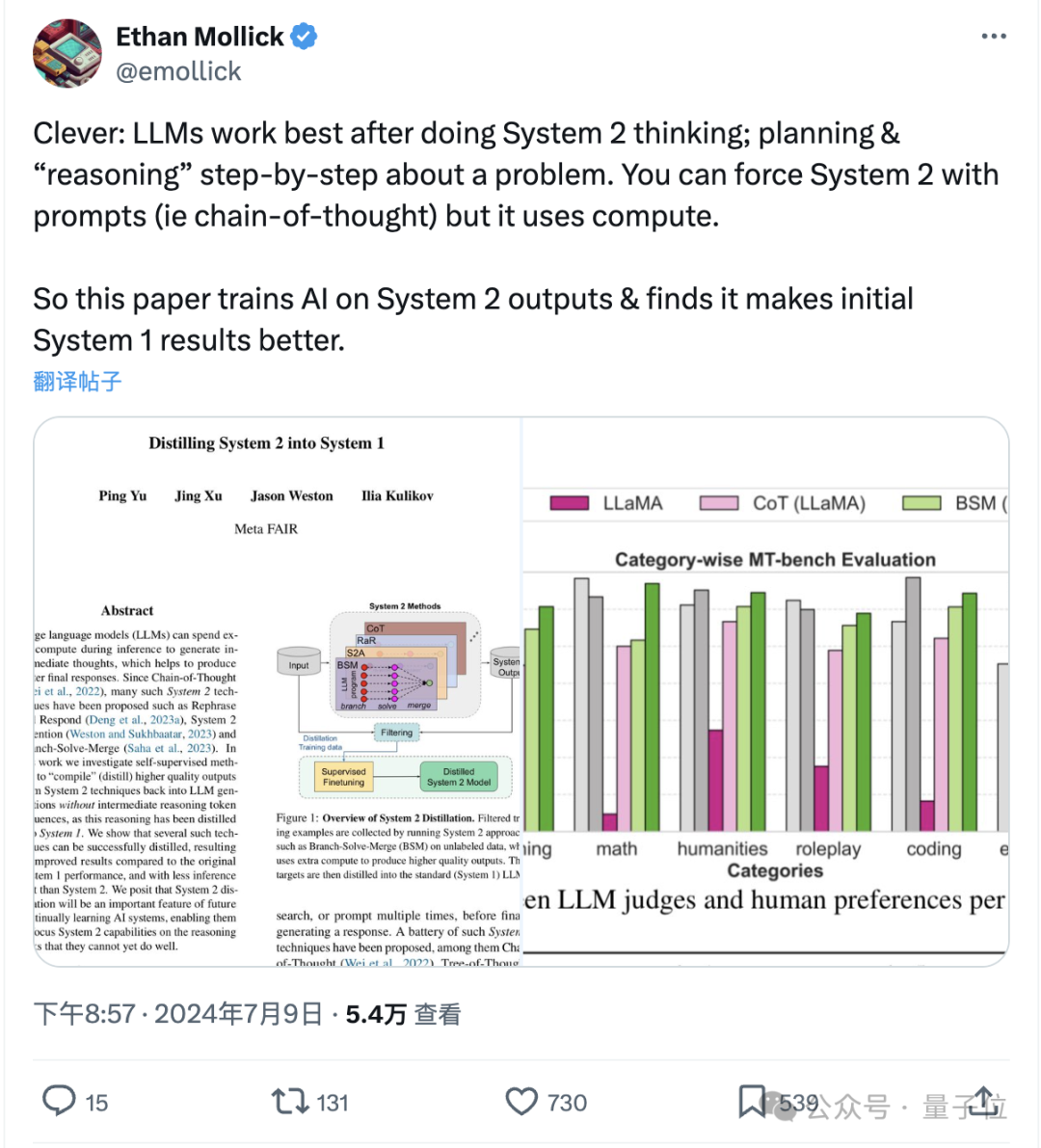

《思考快与慢》中人类的两种思考方式,属实是被Meta给玩明白了。