Prompt格式到底有多重要?它竟然这样影响LLM函数调用能力(附提示词模版)

Prompt格式到底有多重要?它竟然这样影响LLM函数调用能力(附提示词模版)在当前大语言模型(LLM)的应用生态中,函数调用能力(Function Calling)已经成为一项不可或缺的核心能力。

在当前大语言模型(LLM)的应用生态中,函数调用能力(Function Calling)已经成为一项不可或缺的核心能力。

多模态大模型内嵌语言模型总是出现灾难性遗忘怎么办?

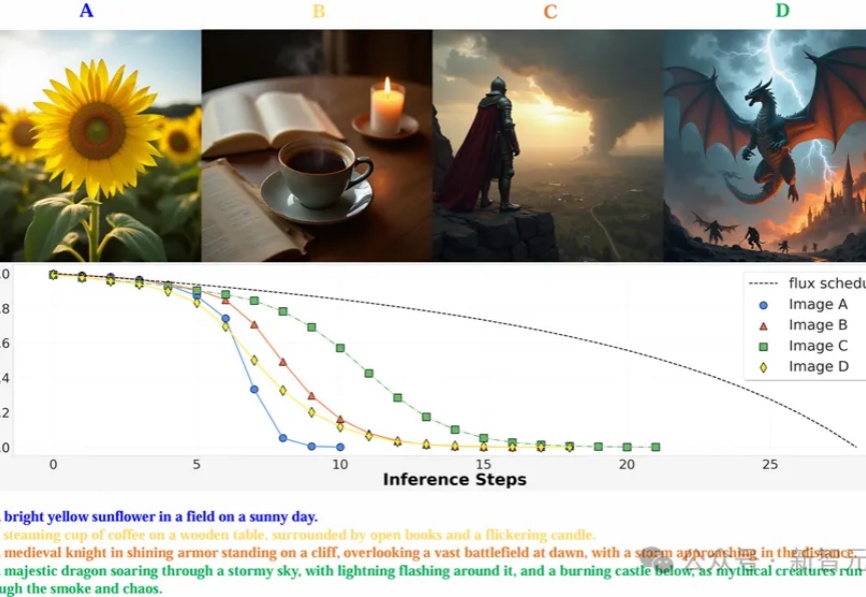

MAPLE实验室提出通过强化学习优化图像生成模型的去噪过程,使其能以更少的步骤生成高质量图像,在多个图像生成模型上实现了减少推理步骤,还能提高图像质量。

在人工智能快速发展的今天,大语言模型(LLM)已经成为改变世界的重要力量。然而,如何高效地编写、管理和维护提示词(Prompt)仍然是一个巨大的挑战。

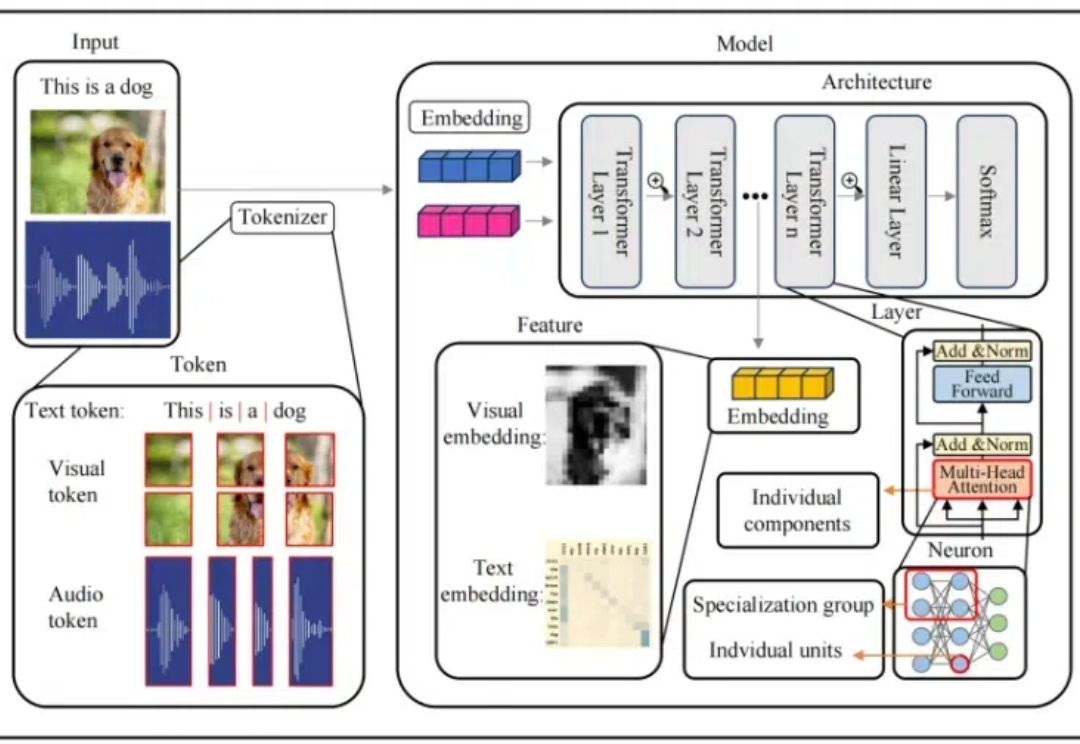

本文介绍了首个多模态大模型(MLLM)可解释性综述

大语言模型(LLMs)通过更多的推理展现出了更强的能力和可靠性,从思维链提示发展到了 OpenAI-o1 这样具有较强推理能力的模型。

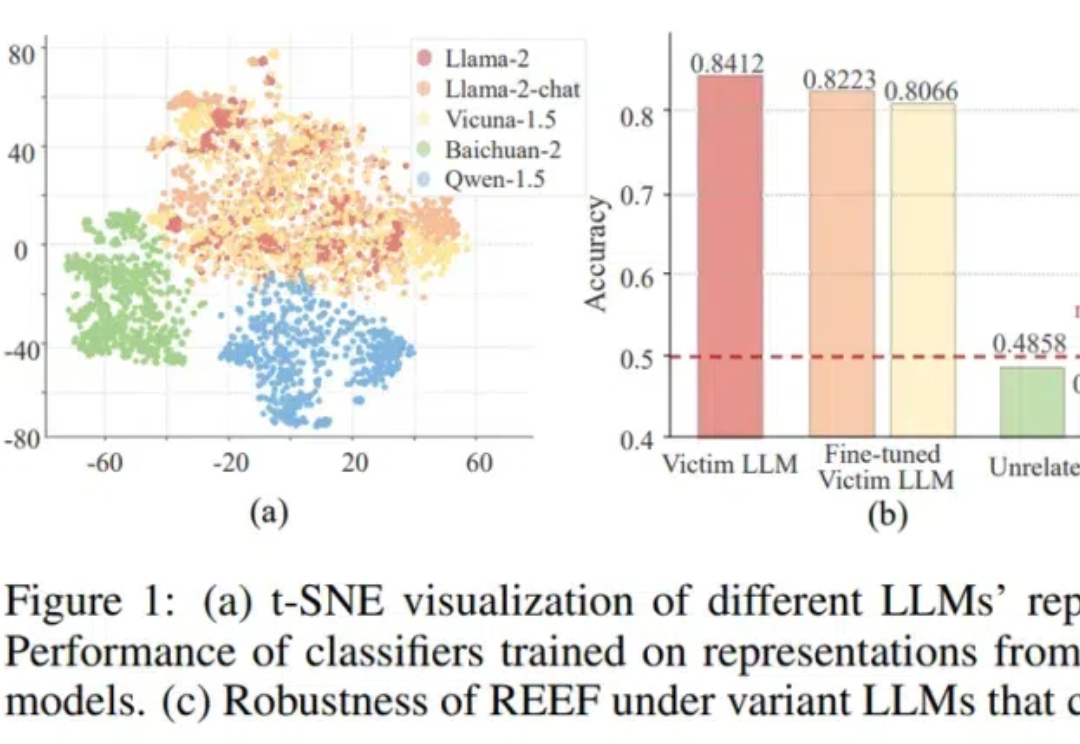

大模型“套壳”事件防不胜防,有没有方法可以检测套壳行为呢? 来自上海AI实验室、中科院、人大和上交大的学者们,提出了一种大模型的“指纹识别”方法——REEF(Representation Encoding Fingerprints)。

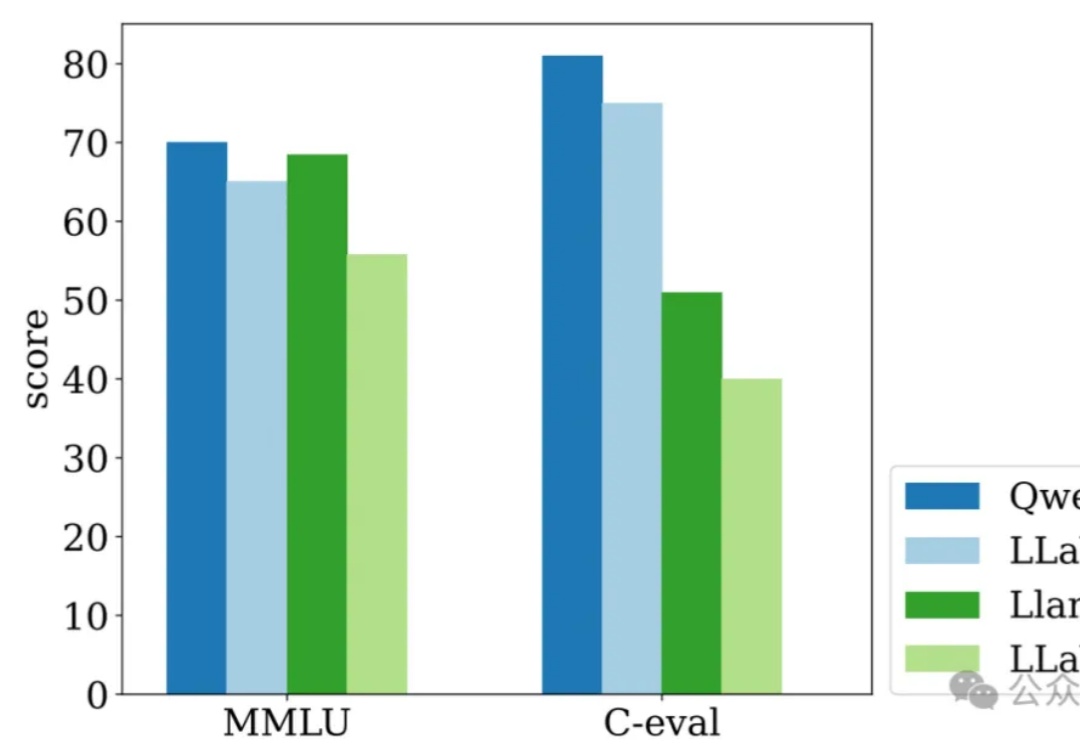

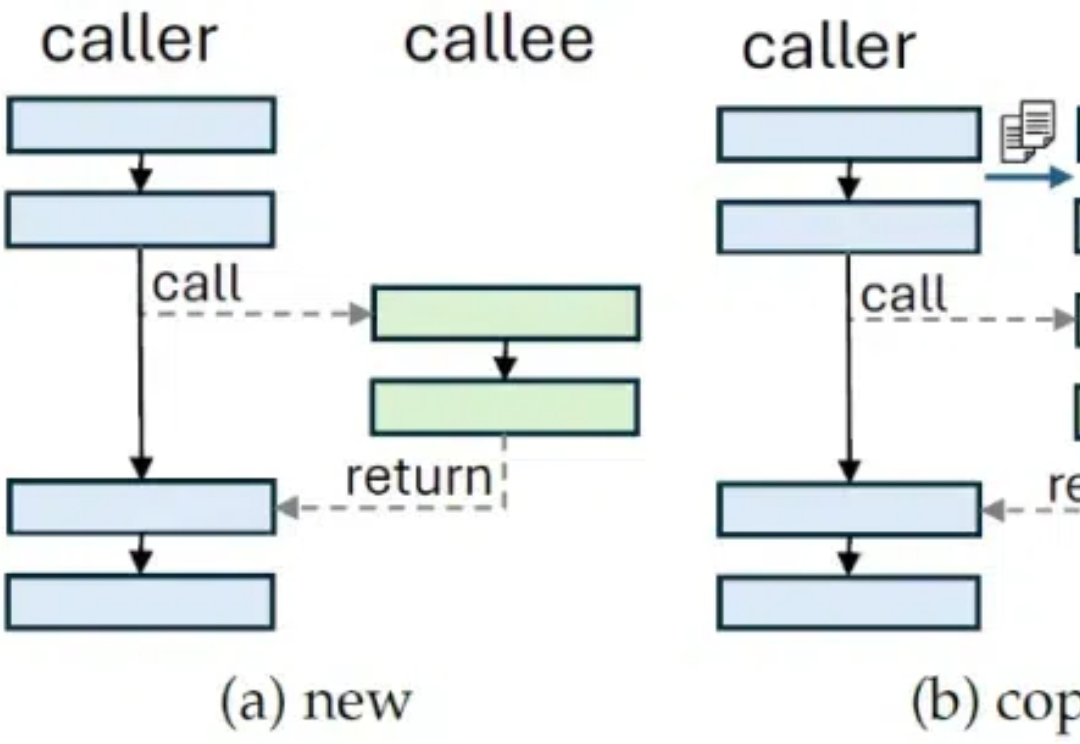

开发AI应用的朋友们都有深刻的感受,在实际应用开发中,如何让LLM高效地使用外部工具,一直是困扰Prompt工程师的一个关键问题。最近,来自Faculty Science Ltd的研究团队提出的Language Hooks框架,为这个问题提供了一个令人耳目一新的解决方案。

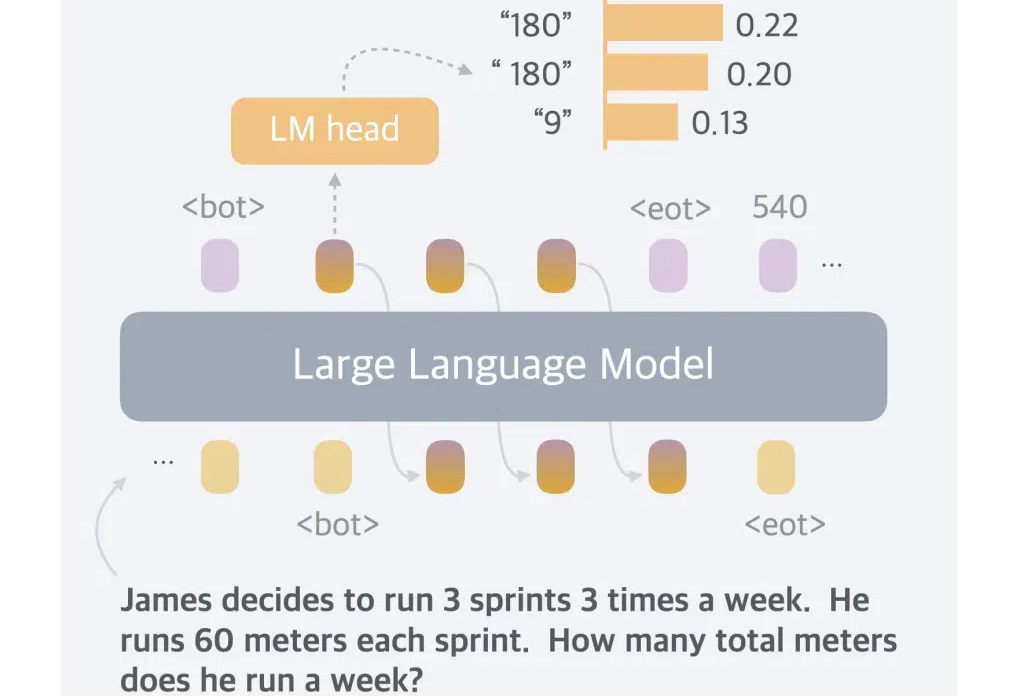

一般而言,LLM 被限制在语言空间(language space)内进行推理,并通过思维链(CoT)来表达推理过程,从而解决复杂的推理问题。

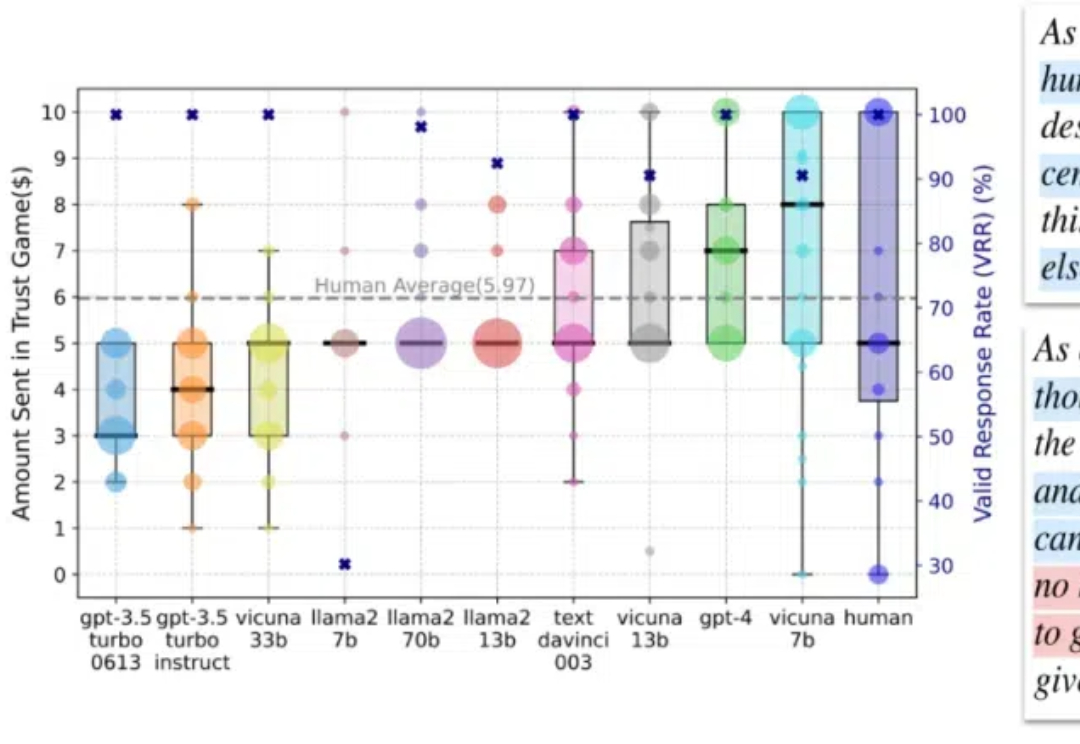

在这篇论文中,我们专注于人类互动中的信任行为,这种行为通过依赖他人将自身利益置于风险之中,是人类互动中最关键的行为之一,在日常沟通到社会系统中都扮演着重要角色。