上下文记忆力媲美Genie3,且问世更早:港大和可灵提出场景一致的交互式视频世界模型

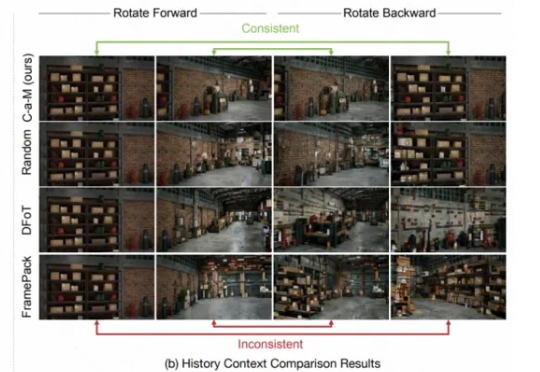

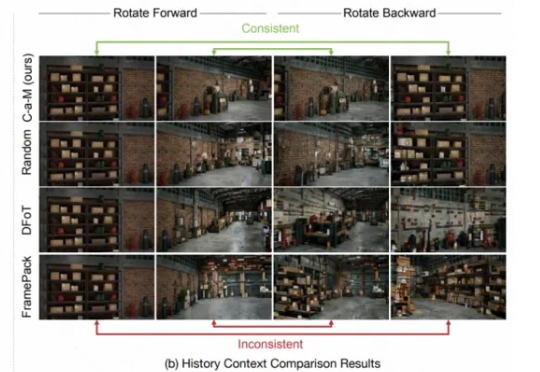

上下文记忆力媲美Genie3,且问世更早:港大和可灵提出场景一致的交互式视频世界模型要让视频生成模型真正成为模拟真实物理世界的「世界模型」,必须具备长时间生成并保留场景记忆的能力。然而,交互式长视频生成一直面临一个致命短板:缺乏稳定的场景记忆。镜头稍作移动再转回,眼前景物就可能「换了个世界」。

要让视频生成模型真正成为模拟真实物理世界的「世界模型」,必须具备长时间生成并保留场景记忆的能力。然而,交互式长视频生成一直面临一个致命短板:缺乏稳定的场景记忆。镜头稍作移动再转回,眼前景物就可能「换了个世界」。

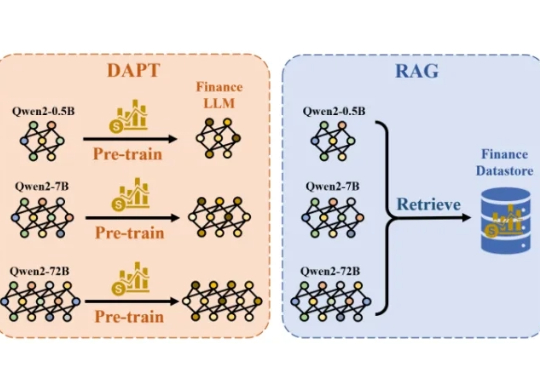

一个小解码器让所有模型当上领域专家!华人团队新研究正在引起热议。 他们提出了一种比目前业界主流采用的DAPT(领域自适应预训练)和RAG(检索增强生成)更方便、且成本更低的方法。

过去几年,AI 的巨大突破赋予了机器语言的力量。而下一个前沿,是给予它们关于世界的记忆。当大模型只能分析短暂的视频内容时,一个根本性的鸿沟依然存在:AI 能够处理信息,却无法真正地“记住” 信息。如今的瓶颈已不再是“看见”,而是如何保留、索引并回忆构成我们现实世界的视觉数据流。

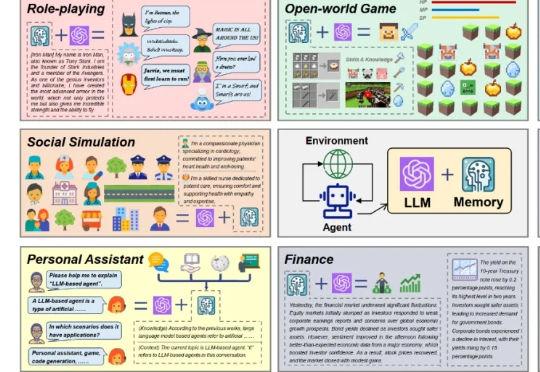

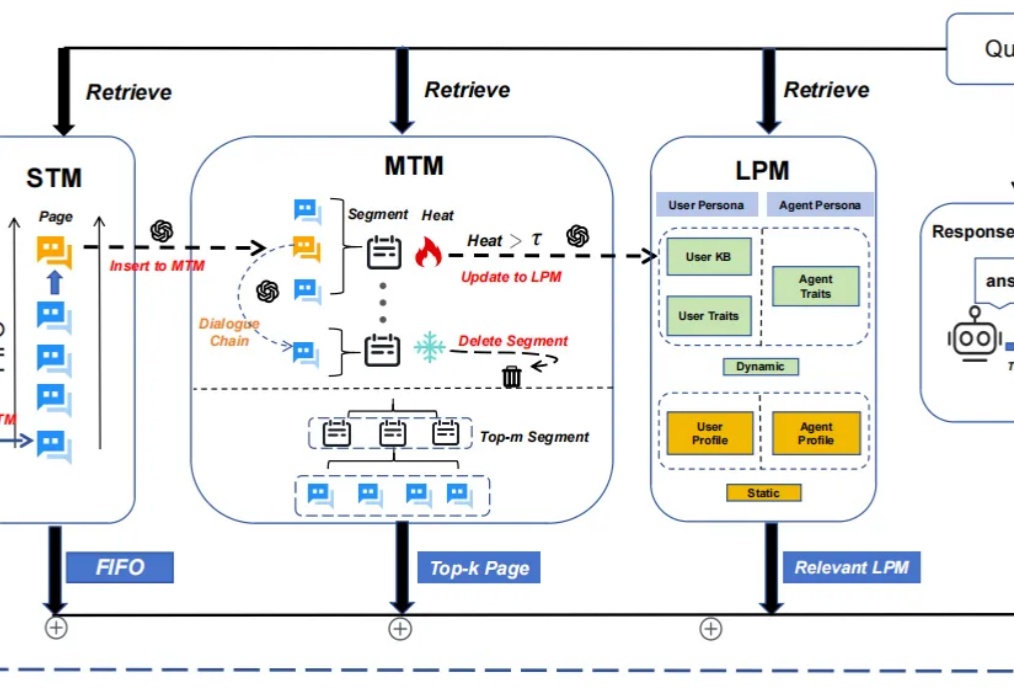

近期,基于大语言模型的智能体(LLM-based agent)在学术界和工业界中引起了广泛关注。对于智能体而言,记忆(Memory)是其中的重要能力,承担了记录过往信息和外部知识的功能,对于提高智能体的个性化等能力至关重要。

你说:“帮我列下今天的会议日程。” 它迅速回复:“9 点产品部,11 点市场部,下午 2 点财务汇报。”——完美。

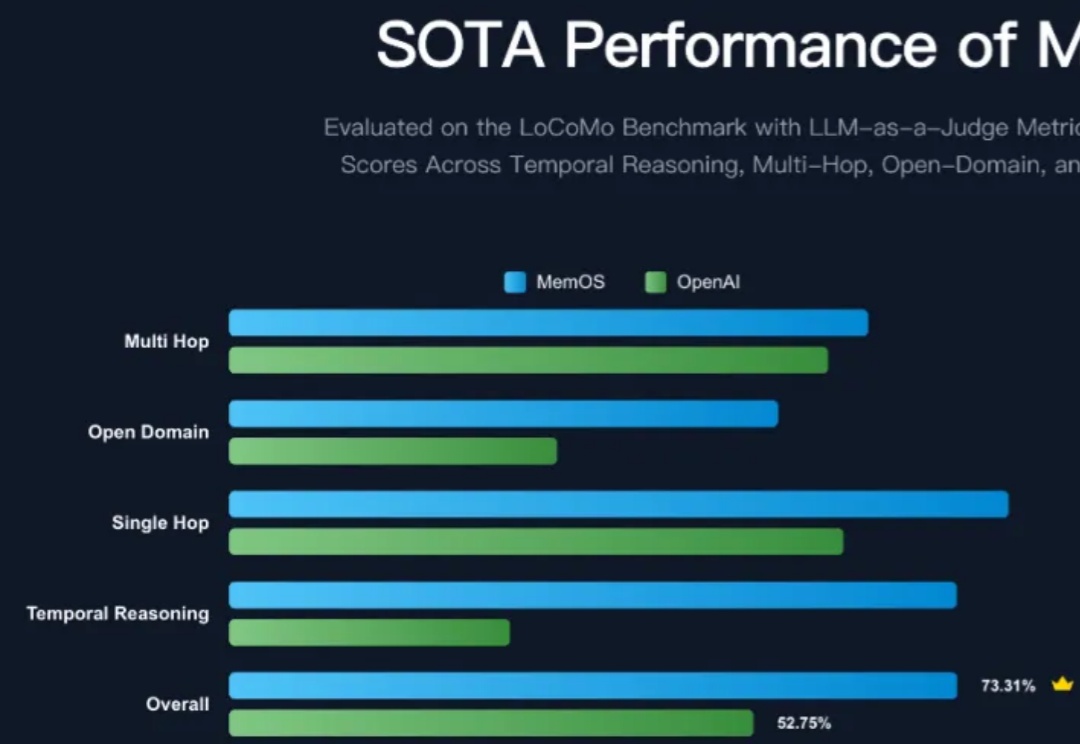

大模型记忆管理和优化框架是当前各大厂商争相优化的热点方向,MemOS 相比现有 OpenAI 的全局记忆在大模型记忆评测集上呈现出显著的提升,平均准确性提升超过 38.97%,Tokens 的开销进一步降低 60.95%,一举登顶记忆管理的 SOTA 框架,特别是在考验框架时序建模与检索能力的时序推理任务上,提升比例更是达到了 159%,相当震撼!

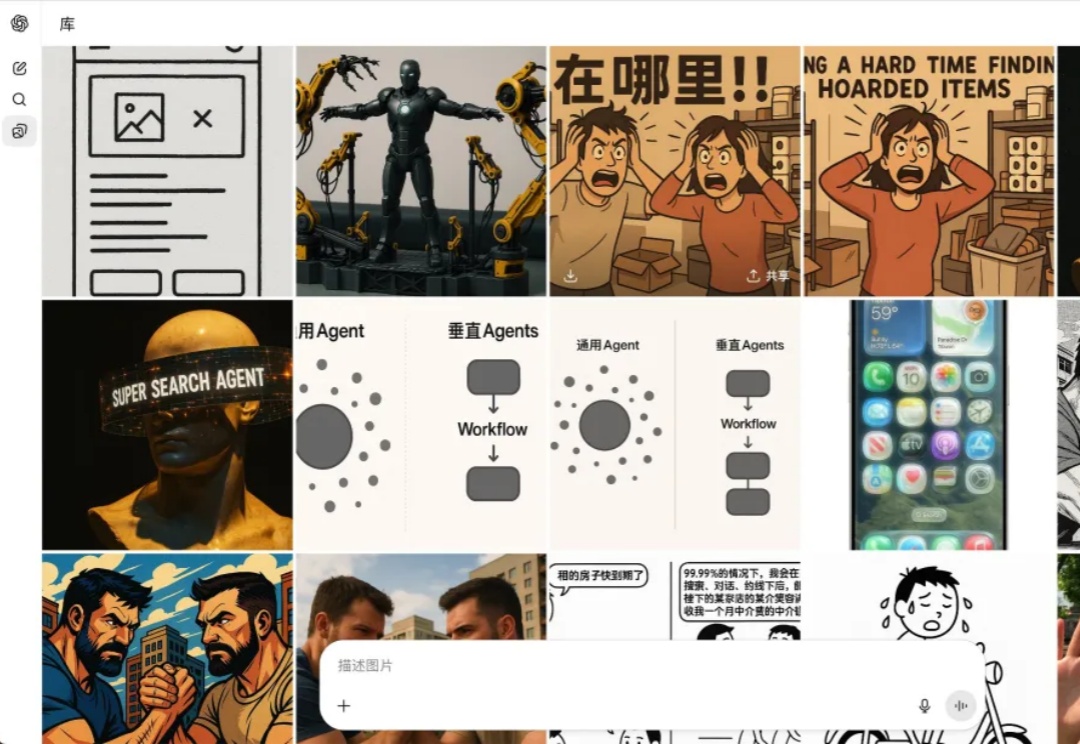

OpenAI 有个反常规的设定, 他们将我生成的图片整理成一个画廊,但是点开图片并没有跳回到当时对话的选项,只能在这张图的基础上修改。 这也是很多AI目前的交互通病, 我和他们的对话正在丢失。

随着大模型应用场景的不断拓展,其在处理长期对话时逐渐暴露出的记忆局限性日益凸显,主要表现为固定长度上下文窗口导致的“健忘”问题。

我们常把LangGraph、RAG、memory、evals等工具比作乐高积木,经验丰富的人知道如何搭配使用,就能迅速解决问题

自Agent火了以后,有关"记忆"的框架如雨后春笋般涌现,但绝大多数仍是为"单兵作战"设计,难以适应需要复杂协作、信息交互量暴增10倍的多智能体系统(MAS)