一些大模型,高分低能,为何?

一些大模型,高分低能,为何?这篇文章的思路来自 Philipp Schmid,由 minghao 推荐 https://www.philschmid.de/agent-harness-2026

搜索

搜索

这篇文章的思路来自 Philipp Schmid,由 minghao 推荐 https://www.philschmid.de/agent-harness-2026

12 月 19 日,Cursor 宣布将收购代码评审初创公司 Graphite。Graphite 聚焦于代码完成之后的流程,帮助团队评审变更、判断代码是否已具备上线条件。Graphite 联合创始人 Tomas Reimers 与 Cursor CEO Michael Truell 的共识是:“AI 的引入意味着会有更多代码被写出来,也就必然意味着,需要被评审的代码只会更多。”

12月21日,全球通用人工智能(AGI)公司MiniMax(稀宇科技)首次刊发其聆讯后资料集(PHIP)版本的招股书资料,有望刷新记录,成为从成立到IPO 历时最短的AI公司,标志着中国力量在国际资本市场迈出关键一步。

首个AI视频生成全球挑战赛来袭,袁粒、颜水成、程明明、田永鸿、Philip Torr多位大佬发起,20万大奖虚位以待!创作大神还是技术极客?两大赛道总有一个适合你,速速点击报名吧。

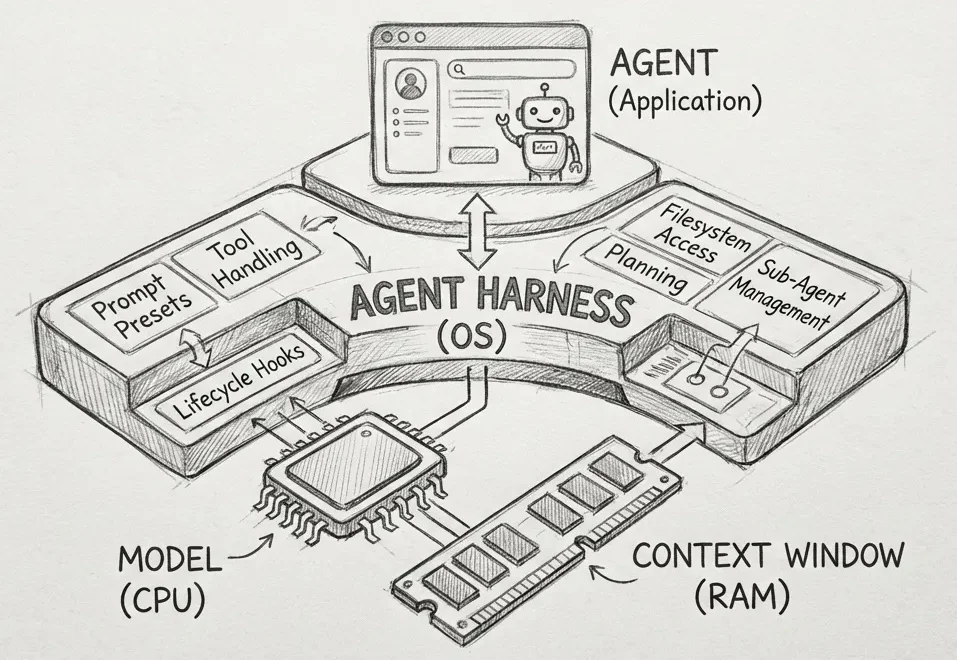

经常用 AI 的人都知道,大模型在与用户对话前,都会先阅读一段「系统提示词」,这个步骤不会对用户显示,而是模型的自动操作。这些提示词规定了模型的行为准则,很常见,不过在 Claude 的提示词中,竟要求模型参考「欧陆哲学(Continental Philosophy)」。

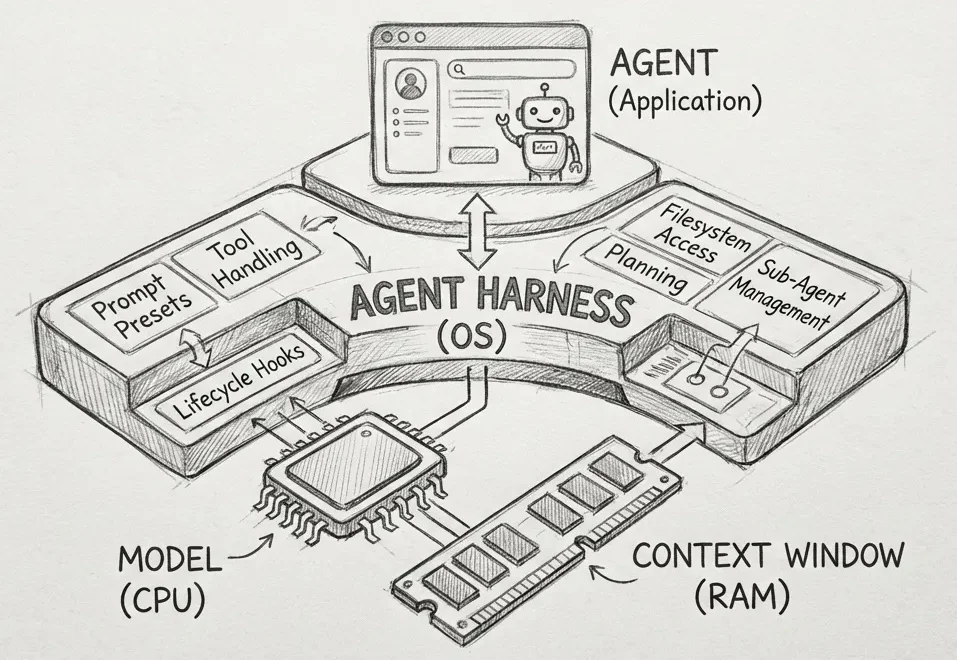

在「具身智能」与「世界模型」成为新一轮 AI 竞赛关键词的当下,来自北京人形机器人创新中心、北京大学多媒体信息处理国家重点实验室、香港科技大学的中国团队开源了全新的世界模型架构。

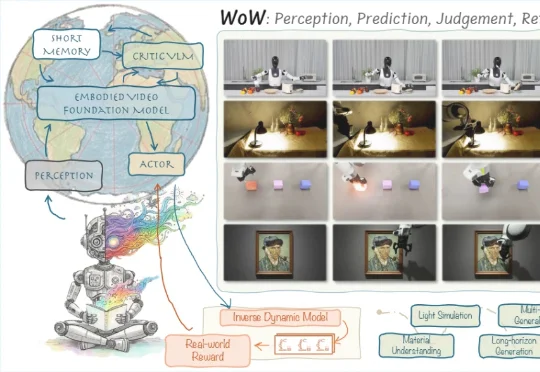

从蒸汽机到AI,自动化进程已持续两百年。在2017年,新晋诺奖得主Philippe Aghion就剖析AI对就业与增长的影响,强调它并非奇点催化剂,而是受「鲍莫尔成本病」制约的工具。

来自德国癌症研究中心(DKFZ)、欧洲分子生物学实验室(EMBL)、哥本哈根大学等机构的研究团队开发了一款名为Delphi-2M的AI医疗大模型。该模型能通过分析用户的医疗记录和生活方式,并提供长达了20年,覆盖癌症、皮肤病和免疫疾病等1258种疾病的风险估计。

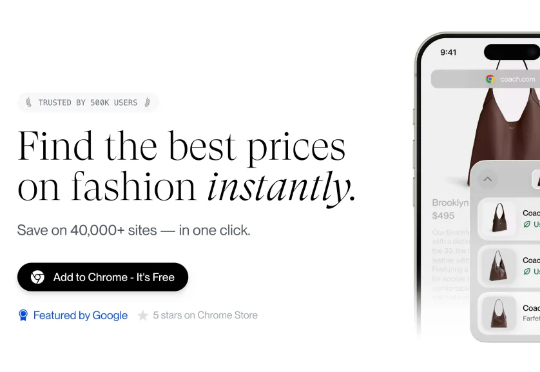

直到最近,我发现有两个年轻女孩正在用她们的方式重新定义这个过程。Phoebe Gates和Sophia Kianni,一个是比尔·盖茨的女儿,另一个是联合国最年轻的顾问之一。她们在斯坦福大学的宿舍里开始了一场购物革命,创立了Phia——一个能让购物变得更智能的AI agent。

每当需要处理复杂领域中高度不确定性或缺乏历史数据的问题时,纯粹的科学证据不足、存在矛盾或过于复杂,通常我们就需要依赖专家们的集体智慧来形成共识,指导实践。德尔菲法(Delphi method)是半个多世纪以来最常用的一种专家共识方法。