Llama 3.1正式发布:4050亿参数模型开源,小扎:把开源进行到底

Llama 3.1正式发布:4050亿参数模型开源,小扎:把开源进行到底GPT-4o的王座还没坐热乎,小扎率领开源大军火速赶到——

GPT-4o的王座还没坐热乎,小扎率领开源大军火速赶到——

就在刚刚,Meta 如期发布了 Llama 3.1 模型。

大模型迈入“小而强”时代。

随着人工智能技术的快速发展,能够处理多种模态信息的多模态大模型(LMMs)逐渐成为研究的热点。通过整合不同模态的信息,LMMs 展现出一定的推理和理解能力,在诸如视觉问答、图像生成、跨模态检索等任务中表现出色。

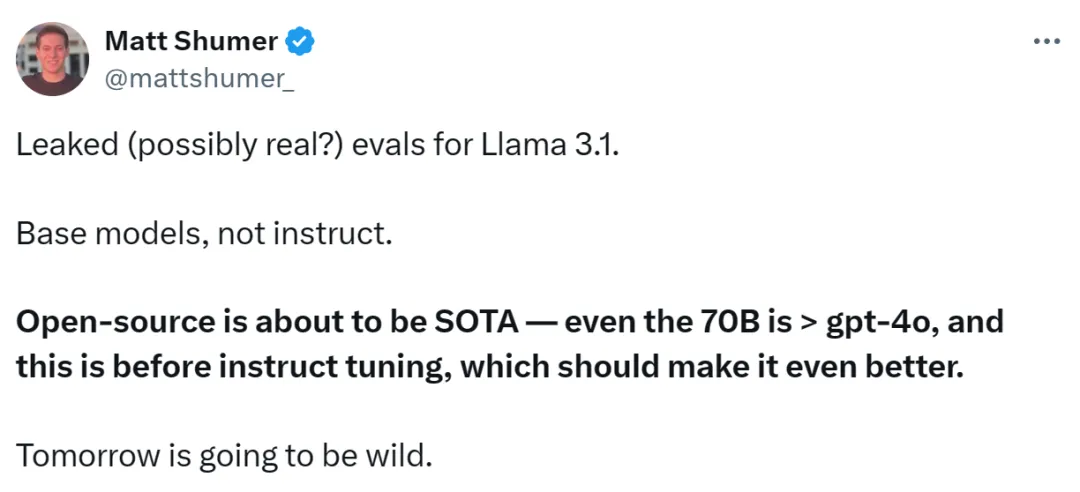

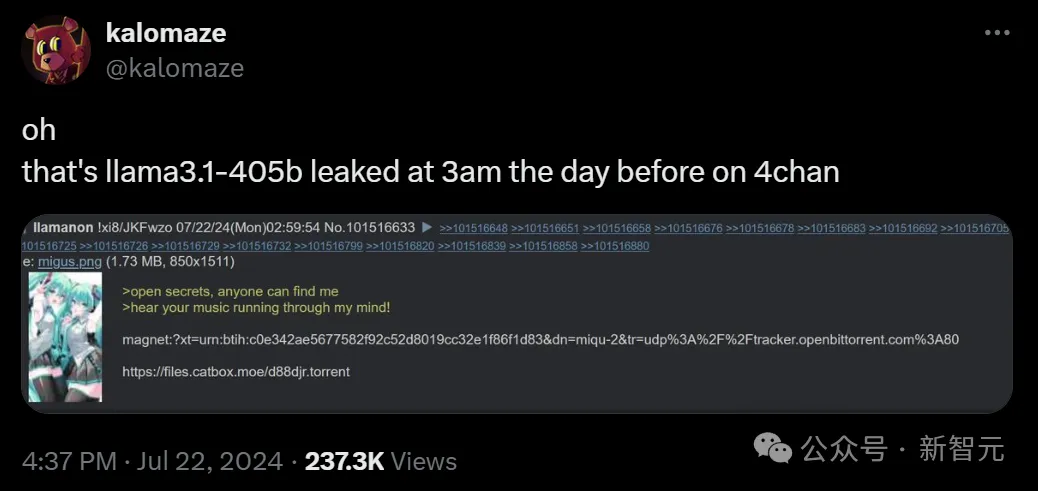

Llama 3.1 终于现身了,不过出处却不是 Meta 官方。

当今的LLM已经号称能够支持百万级别的上下文长度,这对于模型的能力来说,意义重大。但近日的两项独立研究表明,它们可能只是在吹牛,LLM实际上并不能理解这么长的内容。

Llama 3.1又被提前泄露了!开发者社区再次陷入狂欢:最大模型是405B,8B和70B模型也同时升级,模型大小约820GB。基准测试结果惊人,磁力链全网疯转。

OpenAI的ChatGPT是全球工作中使用最多的生成式人工智能工具

7月初,在约翰霍普金斯大学,资深科技记者、播客Pivot的联合主持人Kara Swisher与OpenAI CTO Mira Murati展开了一场火药味十足的对话,计算机科学家、斯坦福大学教授李飞飞也加入了提问阵营,他的另一个身份是Google云人工智能和机器学习首席科学家

多模态大模型(Multimodal Large Language Models,MLLMs)在不同的任务中表现出了令人印象深刻的能力,尽管如此,这些模型在检测任务中的潜力仍被低估。