突发!Meta刚从OpenAI挖走了清华校友宋飏

突发!Meta刚从OpenAI挖走了清华校友宋飏刚刚,Meta又从OpenAI挖来一员猛将——宋飏,扩散模型领域的核心人物,DALL·E 2技术路径的早期奠基者。他已正式加入Meta Superintelligence Labs,担任研究负责人,直接向他的师兄赵晟佳汇报。

刚刚,Meta又从OpenAI挖来一员猛将——宋飏,扩散模型领域的核心人物,DALL·E 2技术路径的早期奠基者。他已正式加入Meta Superintelligence Labs,担任研究负责人,直接向他的师兄赵晟佳汇报。

H-1B新规,正引发一场全球顶尖人才的争夺赛。黄仁勋、奥特曼等人赞成H-1B新令,但也有人认为,新政策将使美国创业企业遭受打击,限制美国企业获得全球人才的能力。

刚刚,Meta FAIR推出了代码世界模型!CWM(Code World Model),一个参数量为32B、上下文大小达131k token的密集语言模型,专为代码生成和推理打造的研究模型。这是全球首个将世界模型系统性引入代码生成的语言模型。

就在上周的 Meta Connect 开发者大会上,Meta 发布了三款全新智能眼镜,但本该展示“未来体验”的现场演示却屡屡翻车。Bosworth 随后在 Instagram 上火速澄清,否认了小扎的说法。他坦言,这不是 Wi-Fi 的问题,也不是场地的原因,而是 Meta 自己的设置和失误。

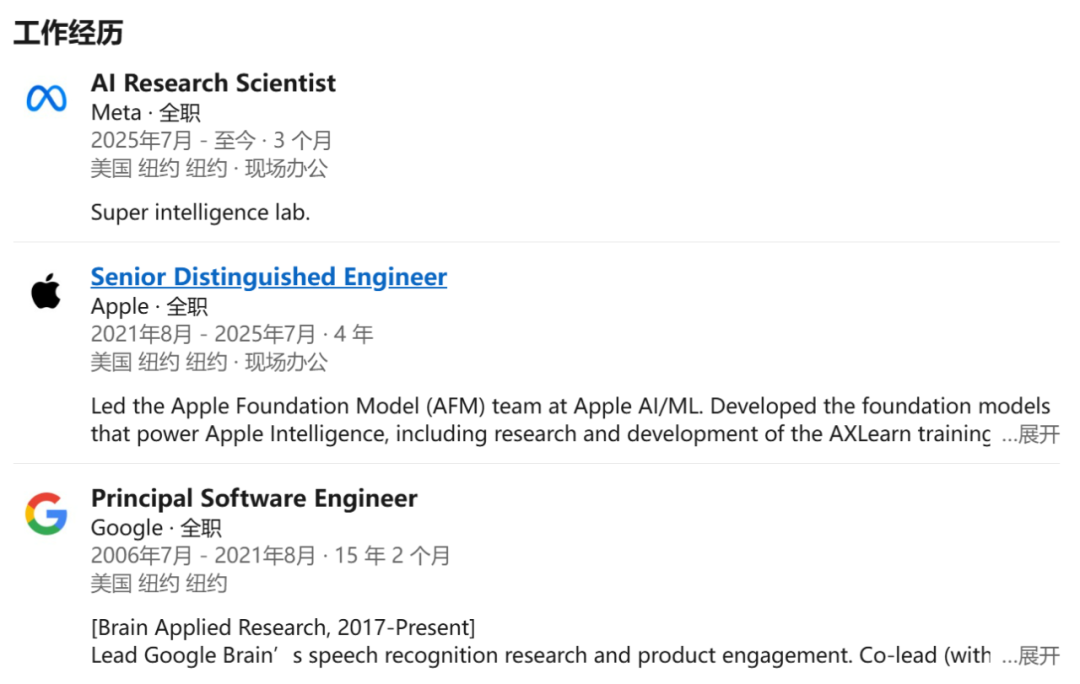

数月前,苹果基础模型团队负责人、杰出工程师庞若鸣(Ruoming Pang)离职加入 Meta。扎克伯格豪掷两亿美元招揽庞若鸣加入超级智能团队。根据庞若鸣的领英信息,他已在 Meta 工作了大约三个月的时间。

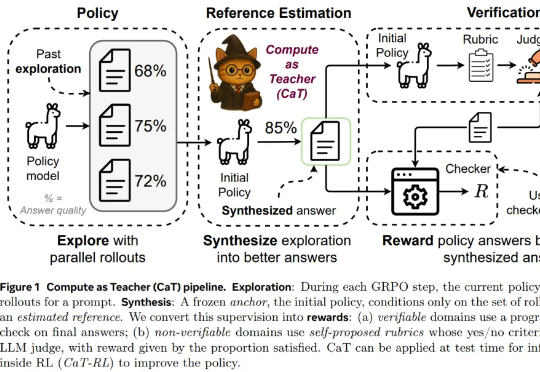

为了回答这一问题,来自牛津大学、Meta 超级智能实验室等机构的研究者提出设想:推理计算是否可以替代缺失的监督?本文认为答案是肯定的,他们提出了一种名为 CaT(Compute as Teacher)的方法,核心思想是把推理时的额外计算当作教师信号,在缺乏人工标注或可验证答案时,也能为大模型提供监督信号。

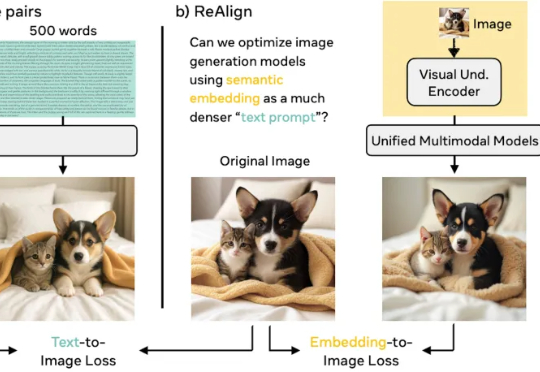

谢集,浙江大学竺可桢学院大四学生,于加州大学伯克利分校(BAIR)进行访问,研究方向为统一多模态理解生成大模型。第二作者为加州大学伯克利分校的 Trevor Darrell,第三作者为华盛顿大学的 Luke Zettlemoyer,通讯作者是 XuDong Wang, Meta GenAl Research Scientist、

这是我戴上 Meta Ray-Ban Display 的第一反应。说实话,从看到去年 Meta Orion 样机的表现之后,我的期待值原本没有特别高,但真的把 Display 戴在头上,我突然觉得这个行业有戏。

马斯克在忙着裁人,小扎这边继续忙着挖人。 这不?Optimus AI团队负责人Ashish Kumar决定离开特斯拉,加入Meta担任研究科学家。与此同时,小扎砸钱挖人的形象已经深入人心,使得网友不禁锐评,有10亿美元吗?

可以毫不夸张的说,Meta 是如今定义了 AI 眼镜这条赛道的那个存在,Meta Ray-Ban 甚至可以说是目前这条赛道中唯一一个已经走过了从零到一阶段的产品。因此无论 Meta 在此时此刻发布什么,都会引发 AI 眼镜行业内极高的话题度。