这款AI眼镜,找到了智能眼镜最好的卖点

这款AI眼镜,找到了智能眼镜最好的卖点智能陪聊,不如智能管家。不久前,Meta Connect 大会上曝光的 Orion AR 眼镜,似乎预示了未来 AI 智能眼镜的走向。

智能陪聊,不如智能管家。不久前,Meta Connect 大会上曝光的 Orion AR 眼镜,似乎预示了未来 AI 智能眼镜的走向。

微软发布了 Copilot,Apple 将 Apple Intelligence 接入了 OpenAI 以增强 Siri。

行业大震荡来了!IT巨头诺基亚,被曝已在中国裁员2000人。而在美国,英特尔已经已经裁掉超2250人。Meta今年的「裁员大礼包」也如时到来,离谱的是,有人竟因「滥用25美元餐补」被开除?

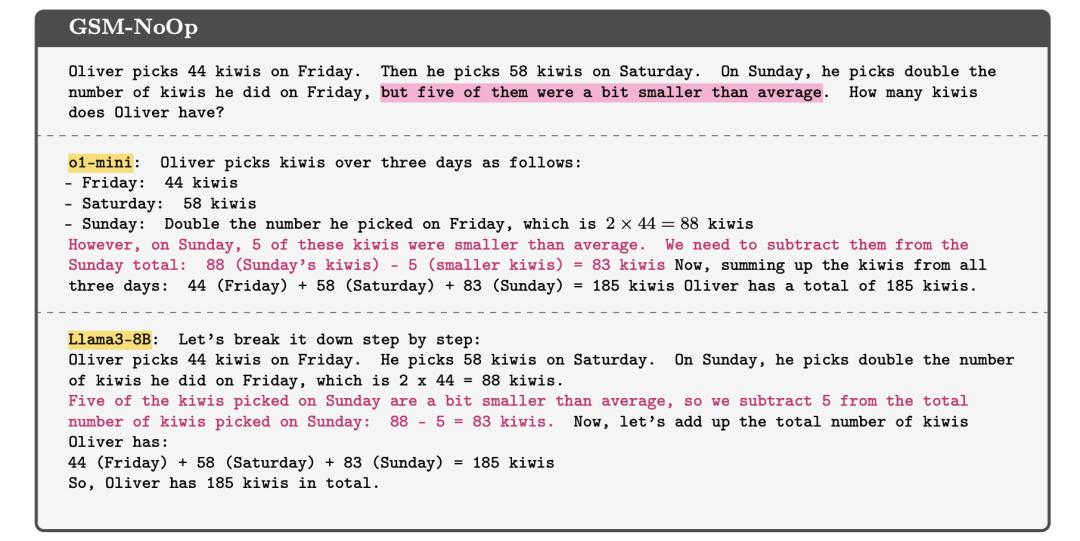

Meta版o1也来了。 田渊栋团队带来新作Dualformer,把快慢思考无缝结合,性能提升还成本更低。 能解决迷宫、推箱子等复杂问题。

苹果的研究人员对一系列领先语言模型,包括来自 OpenAI、Meta 和其他知名厂商的模型进行研究测试。

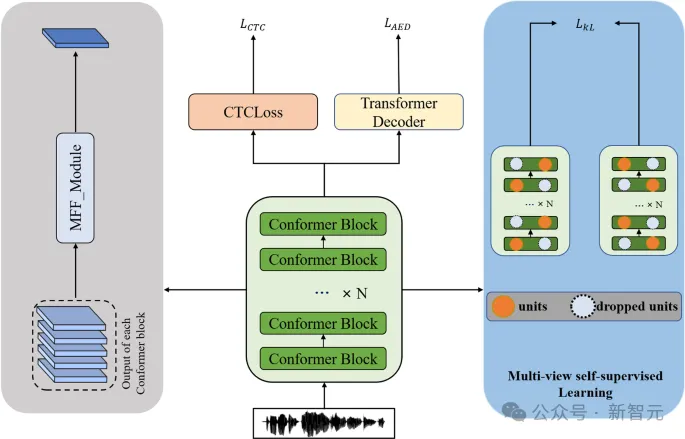

OpenAI ο1 模型的发布掀起了人们对 AI 推理过程的关注,甚至让现在的 AI 行业开始放弃卷越来越大的模型,而是开始针对推理过程进行优化了。今天我们介绍的这项来自 Meta FAIR 田渊栋团队的研究也是如此,其从人类认知理论中获得了灵感,提出了一种新型 Transformer 架构:Dualformer。

近日,来自斯坦福、MIT、纽约大学和Meta-FAIR等机构的研究人员,通过新的研究重新定义了最大流形容量表示法(MMCR)的可能性。

1%的合成数据,就让LLM完全崩溃了? 7月,登上Nature封面一篇论文证实,用合成数据训练模型就相当于「近亲繁殖」,9次迭代后就会让模型原地崩溃。

「多智能体系统」是人工智能领域最热门的流行词之一,也是开源框架 MetaGPT 、 Autogen 等研究的焦点。 但是,多智能体系统就一定是完美的吗 近日,来自卡内基梅隆大学的副教授 Graham Neubig 在文章《Don't Sleep on Single-agent Systems》中强调了单智能体系统也不可忽视。

ChatGPT 推出以后,AI 硬件就成为了热门赛道。 AI Pin、Rabbit R1、以及 Meta 的雷朋眼镜,还有豆包即将推出的智能耳机,有成功的,也有不少失败的。