快手广告系统全面迈入生成式推荐时代!GR4AD:从Token到Revenue的全链路重构

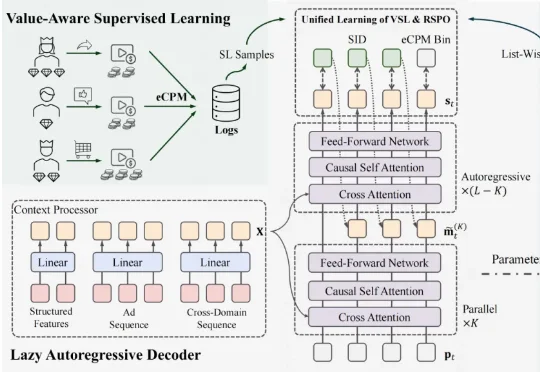

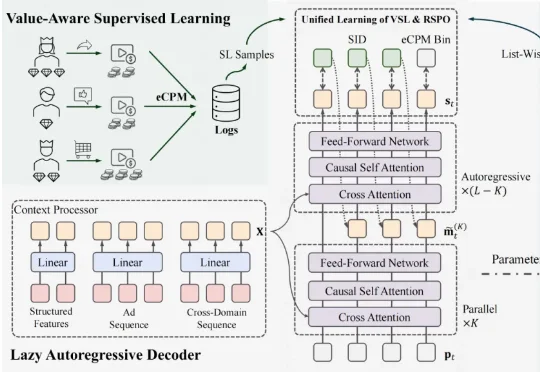

快手广告系统全面迈入生成式推荐时代!GR4AD:从Token到Revenue的全链路重构快手的这篇论文,正是对这一问题交出的一份沉甸甸的工业级答卷。他们提出了 GR4AD(Generative Recommendation for ADvertising),一个横跨表征、学习、服务三大层面协同设计的生成式广告推荐系统,并已全量部署于快手广告平台,服务超过 4 亿用户。

快手的这篇论文,正是对这一问题交出的一份沉甸甸的工业级答卷。他们提出了 GR4AD(Generative Recommendation for ADvertising),一个横跨表征、学习、服务三大层面协同设计的生成式广告推荐系统,并已全量部署于快手广告平台,服务超过 4 亿用户。

这段时间,updream 的内测消息在创作者圈子里悄悄传开了。它是一款面向专业创作者的 AI 视频创作产品,在前几天的 B 站首届 AI 创作大赛颁奖活动现场首次公开亮相。消息扩散之后,各创作者社群里很快出现了「求码」的声音。一款产品还没正式上线,就让这批见过不少 AI 神器的人主动排队,这本身就值得聊聊。

一家叫泛灵人工智能的团队,出了一款主打「超级办公助理」的硬件产品。

招聘是企业中信息损耗最严重的场景之一:从业务方描述“我需要能解决这个问题的人”,到 HR 翻译成关键词逐一筛选,每个环节都在吞噬语义信息。初级 HR 30%~50% 的工作日花在重复的搜索与外联上;AI 工具普及后,单个职位平均收到近 250 份申请,被动渠道的质量更加被稀释。

刚听说微信ClawBot插件上线时,我40多岁的姨特别兴奋,兴冲冲就去微信里找插件。

这两天,我被一张图反复种草。

AI 能做翻译大家都知道,而且呢,AI 还会做一种更高级的翻译:中译中、英译英,简单来说,翻译空气。

3 月 31 日下午,技术圈炸了锅: Claude Code,这款被公认为当前最强的 AI 编程助手,因为一次内部失误,核心代码逻辑暴露在了全球开发者面前。

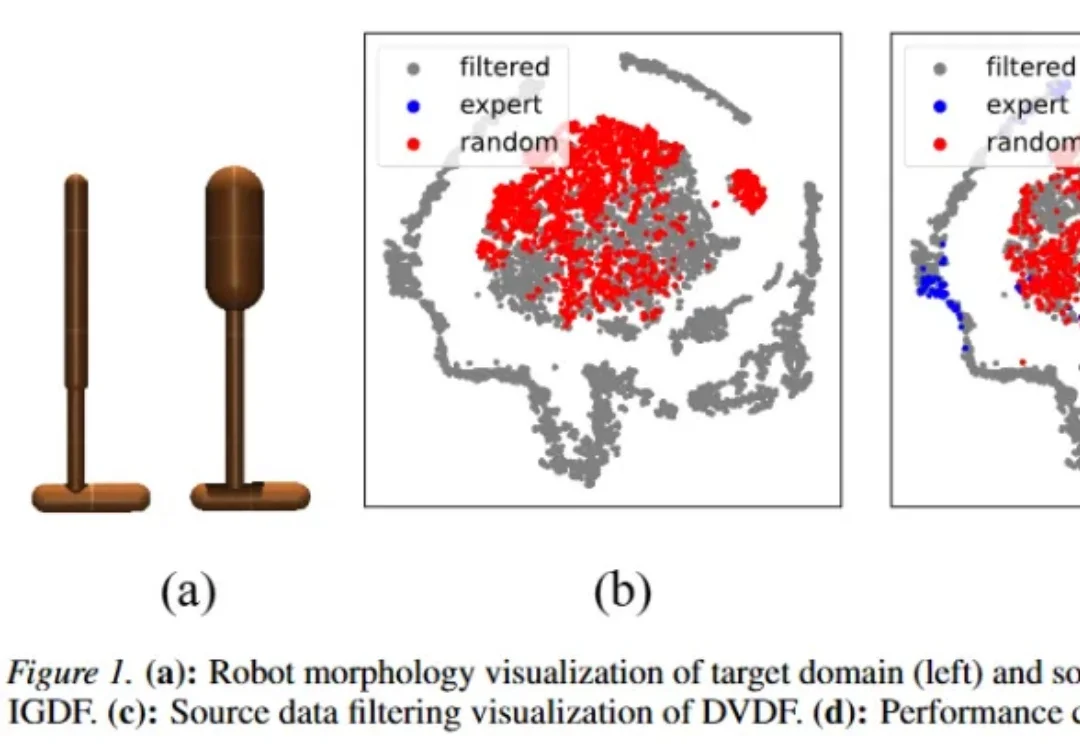

在现实世界中通过强化学习训练智能体,往往需要大量在线试错与环境探索,这不仅成本高昂,还可能带来显著安全风险:机器人可能因试错而损坏,自动驾驶的在线探索可能危及行车安全,而持续采集交互数据本身也代价巨大。

自从 30 号,Claude 传出最新的模型叫「卡皮巴拉」,愚人节的氛围就上来了。到后来 Claude Code 源码泄漏,更加是让互联网乱成一锅粥,赶紧喝了吧!