Anthropic 产品负责人:从 6 个月到 1 天的发版秘密,harness 会被模型当早餐吃掉

Anthropic 产品负责人:从 6 个月到 1 天的发版秘密,harness 会被模型当早餐吃掉最近,Lenny Rachitsky 请到了 Kat Wu,Anthropic Claude Code 和 Cowork 的产品负责人,访谈了一期播客。节目信息密度相当高,从 PM 角色的变化、Anthropic 的内部流程,到源码泄露事件和 OpenClaw 决策,全都聊了个遍。

搜索

搜索

最近,Lenny Rachitsky 请到了 Kat Wu,Anthropic Claude Code 和 Cowork 的产品负责人,访谈了一期播客。节目信息密度相当高,从 PM 角色的变化、Anthropic 的内部流程,到源码泄露事件和 OpenClaw 决策,全都聊了个遍。

写在前面: 太疯狂了,这大概是 APPSO 报道 AI 以来经历过更新最为密集的一个月。 在给大家介绍完一众新模型后,今天这篇文章,想和你聊聊对AI 行业的发布周期所产生的「超现实」现象。 在车轮滚滚

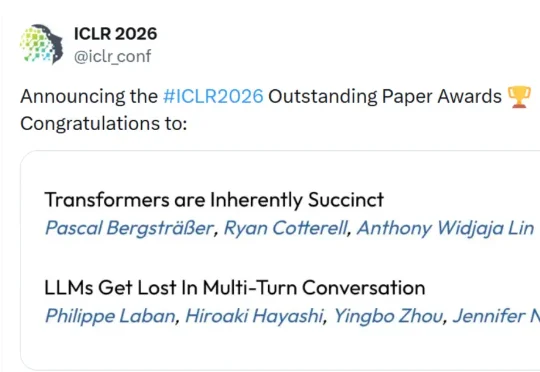

机器之心编辑部 ICLR 2026 获奖论文已经公布。 今年共有 2 篇论文获得「杰出论文奖」(Outstanding Paper),另有 1 篇论文获得「荣誉提名」(Honorable Mention);此外,还有 2 篇 ICLR 2016 论文获得「时间检验奖」(Test of Time Award)。

由 NVIDIA 支持的 Vast Data (一家为人工智能任务开发数据存储软件的公司)表示,已筹集约 10 亿美元,估值超过三倍增至 300 亿美元。

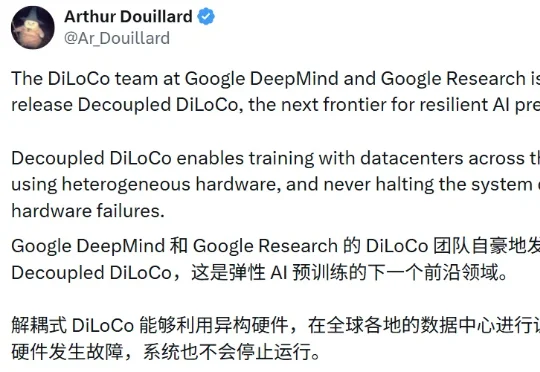

弹性 AI 预训练已经推进到了下一个前沿!没有意外:来自谷歌。据介绍,他们提出的 Decoupled DiLoCo 是一种革命性的分布式训练技术,能够利用全球各地的异构硬件进行训练,并且即使当硬件发生故障时,系统也不会停止运行!

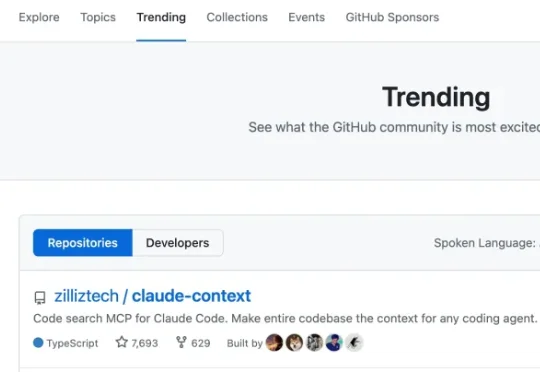

欢迎大家尝试前不久GitHub的日榜榜首项目——Claude Context。通过在AI coding场景引入混合检索,Claude Context相比使用grep的原生 Claude Code 能大幅提升检索精度和效率,减少约 40% 的 不必要Token 消耗。

Cognichip正在构建一个深度学习模型,以便在工程师设计新计算机芯片的过程中为其提供协助。它试图解决的问题是该行业数十年来一直面临的一个难题:芯片设计极其复杂、成本高昂且速度缓慢。先进的芯片从概念设计到大规模生产需要三到五年的时间;仅设计阶段就可能长达两年。想想看,英伟达最新的 GPU 系列Blackwell就包含1040 亿个晶体管——要排列这么多晶体管可不是一件容易的事。

Era平台允许硬件制造商为 AI 设备创建 AI 智能体和编排。该公司并不打算自己制造设备,而是旨在通过提供一个软件层来赋能他人,该软件层可以处理诸如定制语音创建或为耳机等传统设备添加智能等任务。

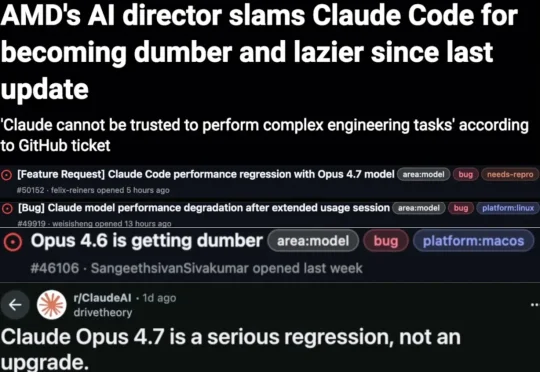

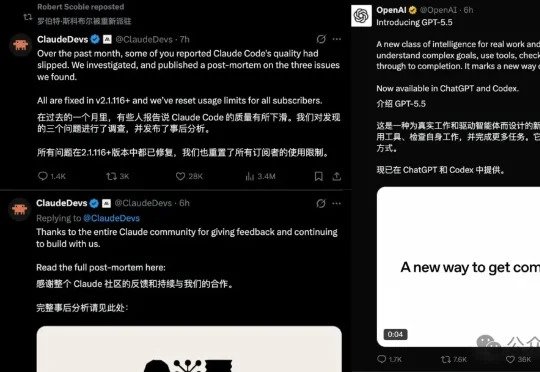

就在GPT-5.5发布的前后脚,Claude招了: 模型降智属实,所有使用额度均已重置。嘴硬了一个多月,这降智bug终于从A社自己嘴里蹦出来了:三个bug叠在一起,Claude使用体验全面拉垮。

在嘈杂喧嚣的 AI 世界里,什么才是真正值得关注的?《麻省理工科技评论》的记者和编辑花了多年时间思考这个问题,追踪 AI 的进展,描绘下一步走向。现在,我们第一次把答案浓缩成了一份清单。