更美图像生成、直出分钟级视频,国产自研DiT架构的越级之旅

更美图像生成、直出分钟级视频,国产自研DiT架构的越级之旅一转眼,2024 年已经过半。我们不难发现,AI 尤其是 AIGC 领域出现一个越来越明显的趋势:文生图赛道进入到了稳步推进、加速商业落地的阶段,但同时仅生成静态图像已经无法满足人们对生成式 AI 能力的期待,对动态视频的创作需求前所未有的高涨。

一转眼,2024 年已经过半。我们不难发现,AI 尤其是 AIGC 领域出现一个越来越明显的趋势:文生图赛道进入到了稳步推进、加速商业落地的阶段,但同时仅生成静态图像已经无法满足人们对生成式 AI 能力的期待,对动态视频的创作需求前所未有的高涨。

在今天揭幕的 2024 世界人工智能大会暨人工智能全球治理高级别会议(简称“WAIC 2024”)上,阶跃星辰首发了三款 Step 系列通用大模型新品:Step-2 万亿参数语言大模型正式版、Step-1.5V 多模态大模型、Step-1X 图像生成大模型。

只需Image Tokenizer,Llama也能做图像生成了,而且效果超过了扩散模型。

面对层出不穷的个性化图像生成技术,一个新问题摆在眼前:缺乏统一标准来衡量这些生成的图片是否符合人们的喜好。对此,来自清华、西交大、伊利诺伊厄巴纳-香槟分校、中科院、旷视的研究人员共同推出了一项新基准DreamBench++。

超越扩散模型!自回归范式在图像生成领域再次被验证——

北航的研究团队,用扩散模型“复刻”了一个地球? 在全球的任意位置,模型都能生成多种分辨率的遥感图像,创造出丰富多样的“平行场景”。 而且地形、气候、植被等复杂的地理特征,也全都考虑到了。

基于人工智能的数字内容生成,即 AIGC 在二维图像生成领域取得了很大的成功,但在三维生成方面仍存在挑战。智能化生成三维模型在 AR/VR、工业设计、建筑设计和游戏影视等方面都有应用价值,现有的智能化三维生成方法已经可以生成高质量的三维模型,但如何对生成结果进行精确控制,并对真实模型或生成的模型进行细节的修改,从而让用户自由定制高质量的三维模型仍然是一个待解决的问题。

在图像生成领域占据主导地位的扩散模型,开始挑战强化学习智能体。

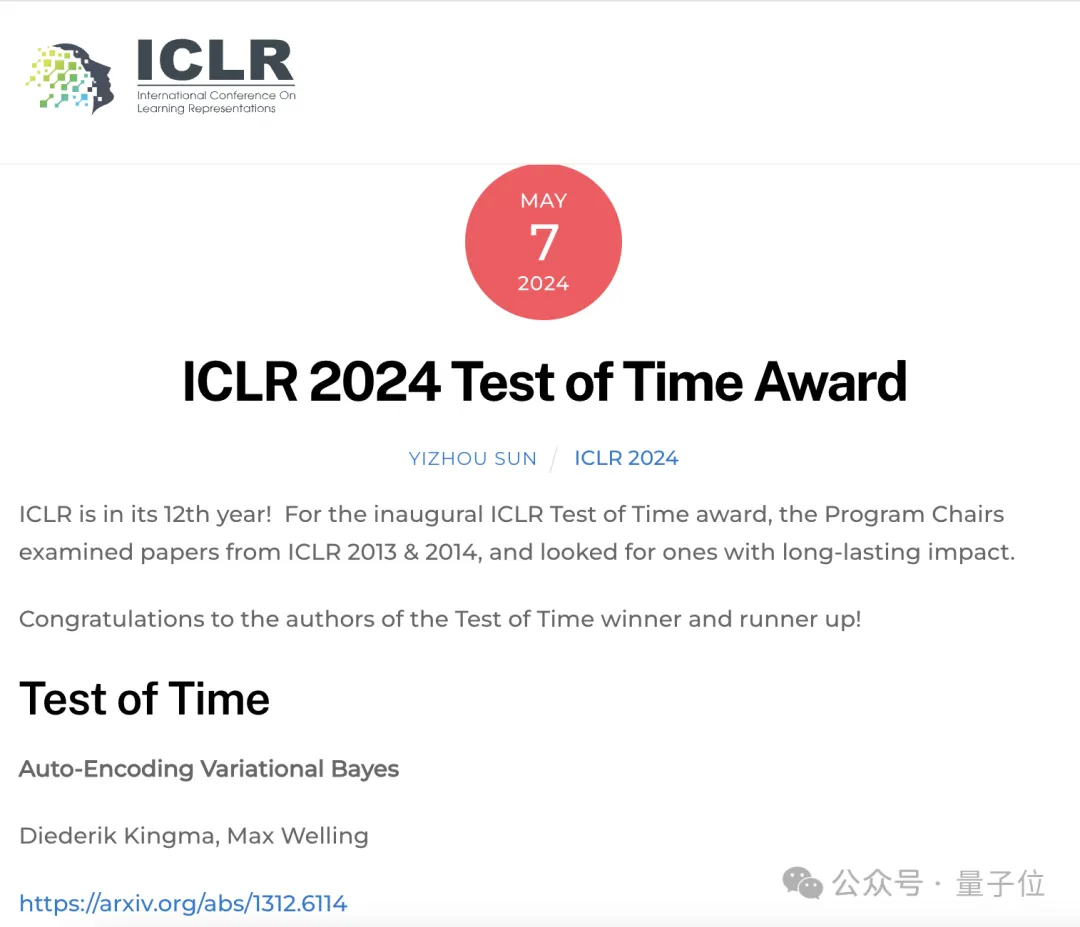

首届ICLR时间检验奖,颁向变分自编码器VAE

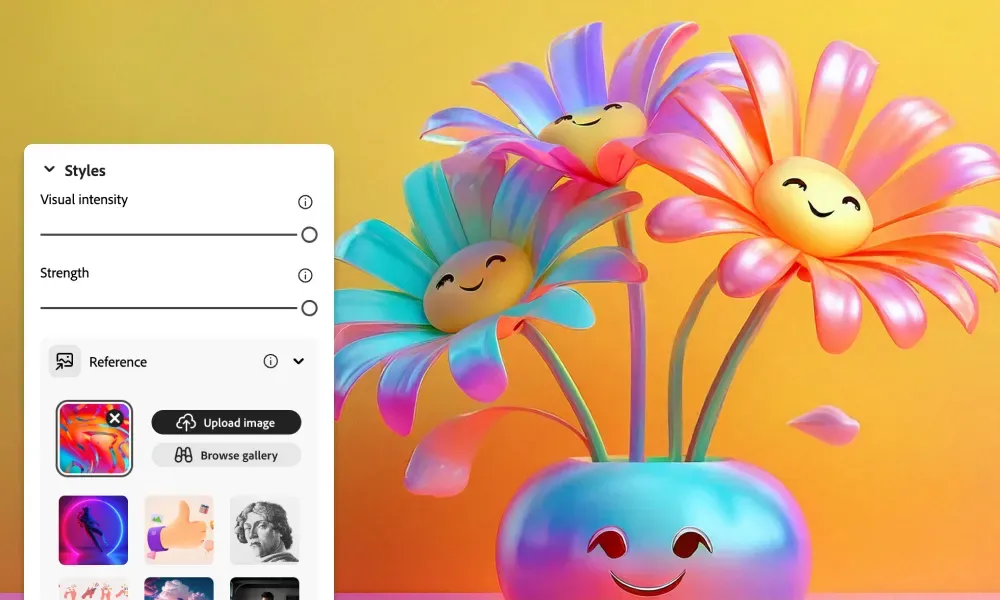

刚刚,Adobe 正式宣布推出新的图像生成模型 Firefly Image 3,即日起在 Firefly Web 应用程序、Adobe Photoshop 和 Adobe InDesign 中提供测试版,并在「今年晚些时候」全面上市,旨在让创作者能够提高工作效率,生成更高质量、更详细的图像。