打完“价格战”,大模型还要比什么?

打完“价格战”,大模型还要比什么?大模型的1996。 在近日举办的2024年云栖大会上,阿里再次成为了焦点。

大模型的1996。 在近日举办的2024年云栖大会上,阿里再次成为了焦点。

每一次技术爆发,拥有技术底蕴的创业团队,特别是来自高校的团队,都是更容易完成技术积累并实现技术突破的,这也导致其更容易获得资本市场认可,人工智能时代也不外如是。特别是,在AI 1.0时代,以香港中文大学为基础的商汤科技,以中科大为摇篮的云从科技,纷纷成功登陆股市,成为早期人工智能创业公司的代表。

“通用人工智能(AGI)的设计和开发,需要进行根本性改变。” 人工智能(AI)模型的参数规模越大,生成的答案就越准确?就更加可信? 还真不一定!

大模型时代,一家AIoT企业如何寻找它的生态位?

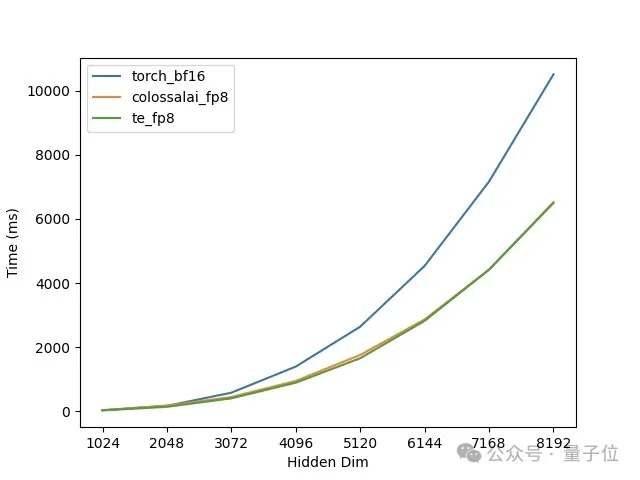

FP8通过其独特的数值表示方式,能够在保持一定精度的同时,在大模型训练中提高训练速度、节省内存占用,最终降低训练成本。

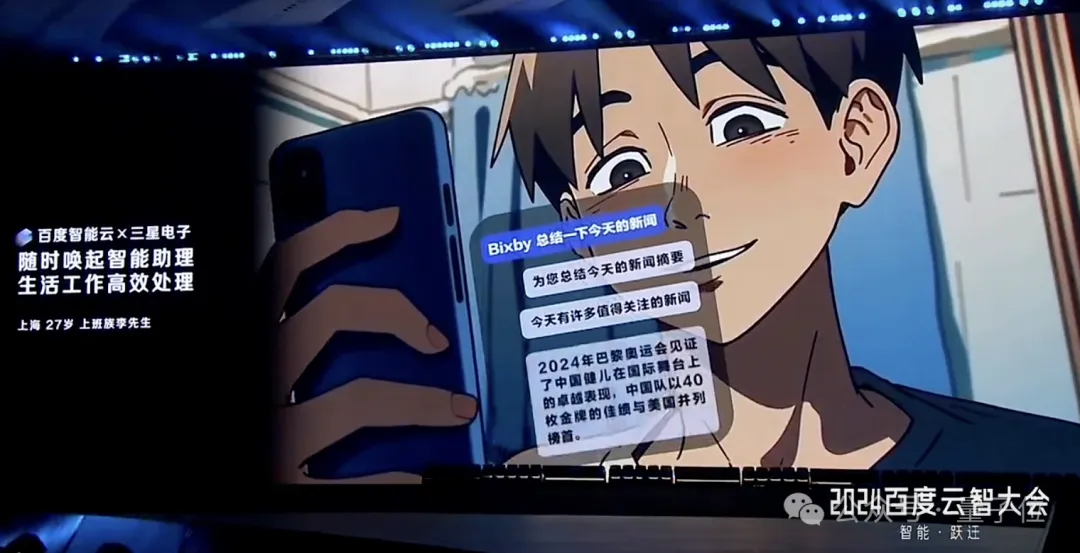

中国大模型平台市场第一! 大模型应用落地元年,百度最新成绩单出炉

这会是短短的昙花一现吗?

昨天,OpenAI CEO 山姆阿尔特曼在新开的博客主页发了一篇长文《智能时代》。全文大致内容是:随着深度学习的发展,超级人工智能将在几千天后到来,到时候 AI 会改变人们的方方面面,人类也将进入智能时代。

针对影视游戏、具身智能领域,推出两款大模型内容和数据引擎。

在当今大模型技术日新月异的背景下,数据已跃升为构建企业大模型知识库、优化训练与微调,乃至驱动模型创新不可或缺的核心要素。