字节开源大模型量化新思路,2-bit量化模型精度齐平fp16

字节开源大模型量化新思路,2-bit量化模型精度齐平fp16随着深度学习大语言模型的越来越火爆,大语言模型越做越大,使得其推理成本也水涨船高。模型量化,成为一个热门的研究课题。

搜索

搜索

随着深度学习大语言模型的越来越火爆,大语言模型越做越大,使得其推理成本也水涨船高。模型量化,成为一个热门的研究课题。

本文基于数势科技创始人&CEO黎科峰博士,百川智能联合创始人焦可,腾讯研究院副院长刘琼,蓝驰创投投资合伙人、TGO鲲鹏会学员石建平以及实在智能联合创始人、CMO张俊九等五位行业大咖在InfoQ主办的QCon全球软件开发大会的圆桌讨论整理。

多模态 AI 无疑是今年大模型的发展重点之一,Sora、Midjourney、Suno 等文生视频、文生图、文生音乐赛道的代表产品也是用户的关注热点。

众所周知,大语言模型的训练常常需要数月的时间,使用数百乃至上千个 GPU。以 LLaMA2 70B 模型为例,其训练总共需要 1,720,320 GPU hours。由于这些工作负载的规模和复杂性,导致训练大模型存在着独特的系统性挑战。

大模型回答如何更可靠?MIT研究团队设计出「共识博弈」,将数学家常用的博弈论引入LLM改进中。没想到,LLaMA-7B的表现,击败了LLaMA-65B,甚至与PaLM-540B相媲美。

中国AIGC产业峰会上,金山办公副总裁、研发中台事业部总经理姚冬分享了金山办公拥抱AI的思考与实践。

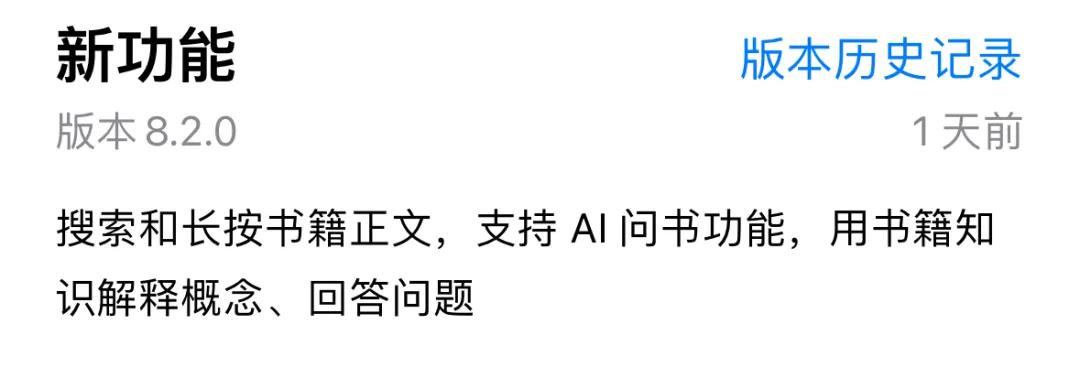

早在一个多月前,就已经有很多小伙伴拿到了微信读书的 AI 新功能内测,而就在一天前,AI 问书功能正式全量上线。

昨天刚刚在顶会ICLR作为特邀演讲(Invited Talk)中“国内唯一”的大模型玩家智谱AI,今天又放出了一个好消息

在刚刚举行的 ICLR 2024 大会上,智谱AI的大模型技术团队公布了面向激动人心的AGI通用人工智能前景的三大技术趋势,同时预告了GLM的后续升级版本。

最近在许多美国开发者的口中,一个开源模型经常被提及,它的发音听起来是“困”。乍一听到总让人一头雾水。哪个开发者天天用中文说困啊。