五种资源类别,如何提高大语言模型的资源效率,超详细综述来了

五种资源类别,如何提高大语言模型的资源效率,超详细综述来了本综述深入探讨了大型语言模型的资源高效化问题。

本综述深入探讨了大型语言模型的资源高效化问题。

AI绘图作为跟大语言模型并驾齐驱的最成熟的模态之一。

人话科普ChatGPT和大语言模型。全世界都在讨论ChatGPT,你却搞不懂?

语言模型究竟是如何感知时间的?如何利用语言模型对时间的感知来更好地控制输出甚至了解我们的大脑?最近,来自华盛顿大学和艾伦人工智能研究所的一项研究提供了一些见解。

起底大模型捧红的23家独角兽,大语言模型、垂直行业应用狂吸金。生成式AI这把火在资本市场越烧越旺。

2023 年是当之无愧的「AI+大模型」之年,以 ChatGPT 为代表的生成式 AI 的神速进展,让人们甚至认为大语言模型已经有资格被称作「世界模型」——人工智能从未像今天这样离「神性」如此接近。

作者重点关注了基于 Transformer 的 LLM 模型体系结构在从预训练到推理的所有阶段中优化长上下文能力的进展。

华为盘古系列,带来架构层面上新!量子位获悉,华为诺亚方舟实验室等联合推出新型大语言模型架构:盘古-π。

如果说2023年有一项技术能够达到如此空前的“热度”,毫无疑问,那就是生成式大语言模型。但是不同于那不足十亿分之一秒的、转瞬即逝的4万亿度高温,大模型对各行各业的深远影响,在2023年既如“春雷万钧”,又似“润物无声”。所以,如果要用两个关键词形容2023年的大模型产业,除了“热”,还有“卷”。

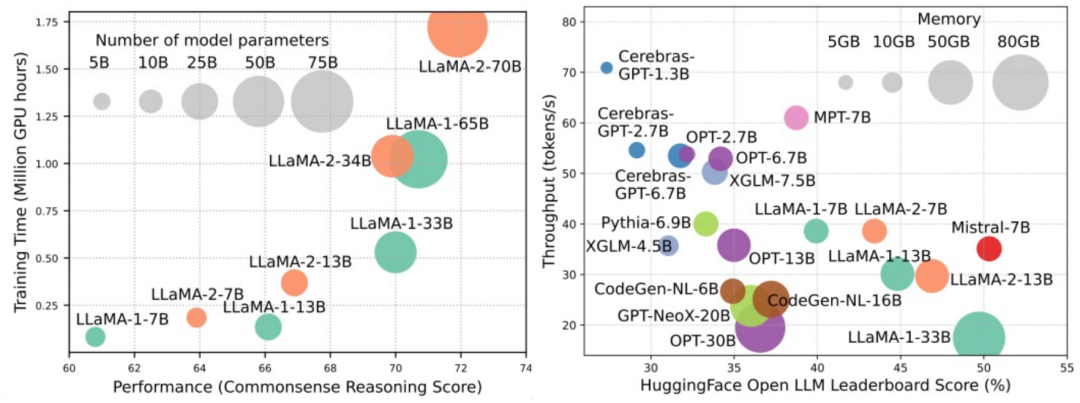

大规模语言模型(LLMs)在很多关键任务中展现出显著的能力,比如自然语言理解、语言生成和复杂推理,并对社会产生深远的影响。然而,这些卓越的能力伴随着对庞大训练资源的需求(如下图左)和较长推理时延(如下图右)。因此,研究者们需要开发出有效的技术手段去解决其效率问题。