Pika 2.0横扫Sora惊艳全网,一键颠覆广告业!上传自拍秒变好莱坞大片,和明星同框不是梦

Pika 2.0横扫Sora惊艳全网,一键颠覆广告业!上传自拍秒变好莱坞大片,和明星同框不是梦斯坦福天才少女,让AI视频的格局再次颠覆!Pika 2.0上线不久即引发全网狂潮,强大场景元素功能、超强文本对齐、深刻物理学理解,让它在AI视频大混战中脱颖而出,效果不输谷歌Veo 2.0。网友们疯狂实测,人手一部广告大片。

斯坦福天才少女,让AI视频的格局再次颠覆!Pika 2.0上线不久即引发全网狂潮,强大场景元素功能、超强文本对齐、深刻物理学理解,让它在AI视频大混战中脱颖而出,效果不输谷歌Veo 2.0。网友们疯狂实测,人手一部广告大片。

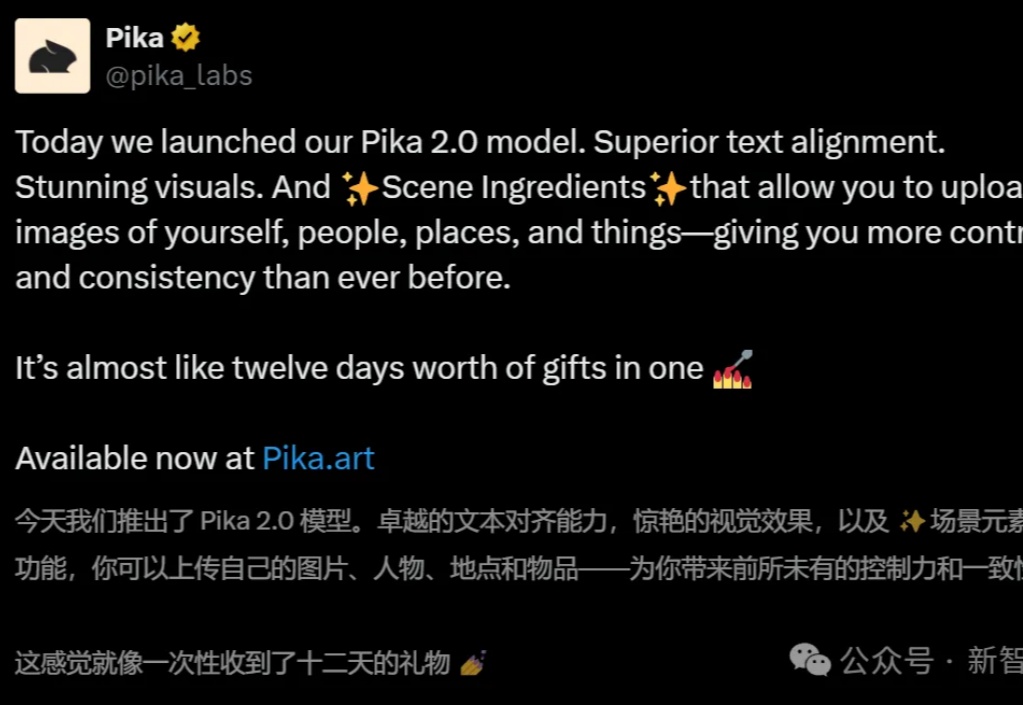

Lilian Weng离职OpenAI后首篇博客发布!文章深入讨论了大模型强化学习中的奖励欺骗问题。随着语言模型在许多任务上的泛化能力不断提升,以及RLHF逐渐成为对齐训练的默认方法,奖励欺骗在语言模型的RL训练中已经成为一个关键的实践性难题。

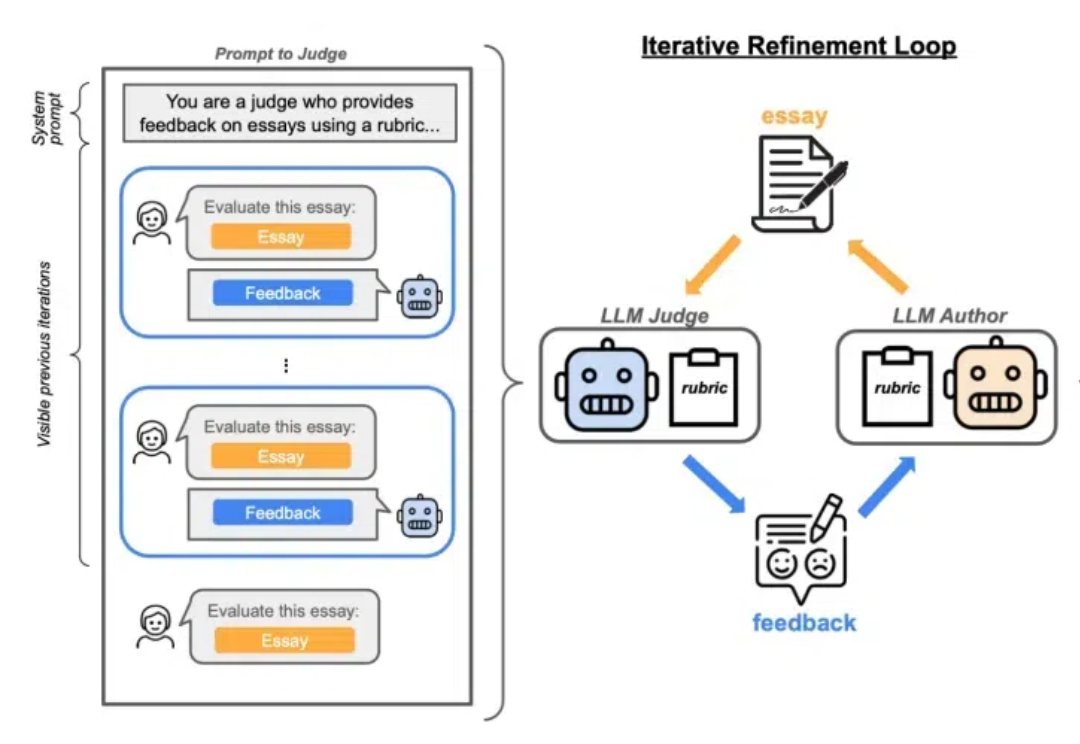

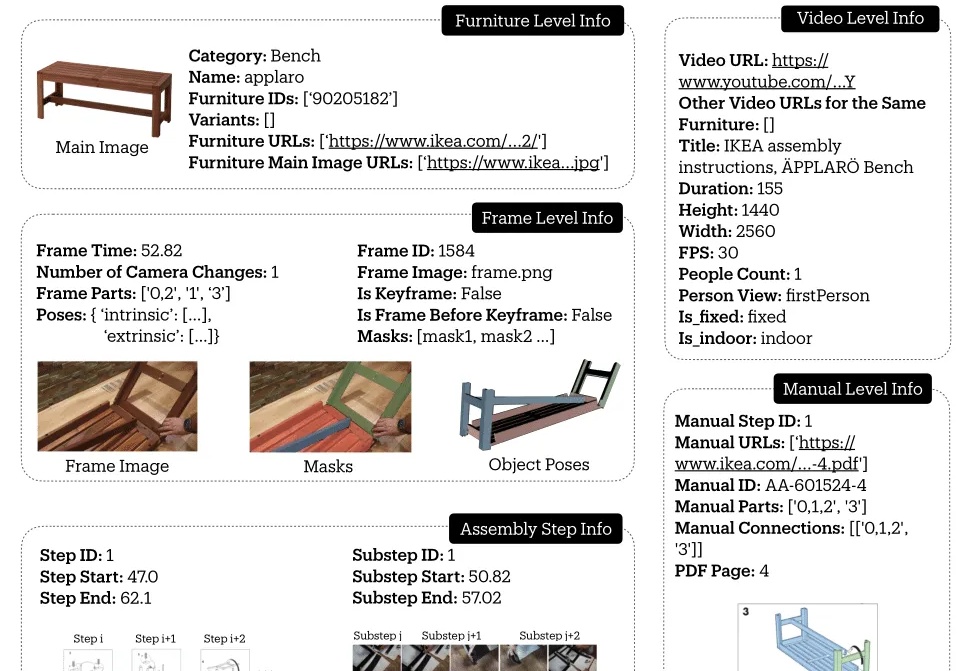

斯坦福大学推出的IKEA Video Manuals数据集,通过4D对齐组装视频和说明书,为AI理解和执行复杂空间任务提供了新的挑战和研究基准,让机器人或AR眼镜指导家具组装不再是梦。

就在刚刚,LeCun一反常态地表示:AGI离我们只有5到10年了!这个说法,跟之前的「永远差着10到20年」大相径庭。当然,他还是把LLM打为死路,坚信自己的JEPA路线。至此,各位大佬们的口径是对齐了,有眼力见儿的投资人该继续投钱了。

代码模型可以自己进化,利用自身生成的数据来进行指令调优,效果超越GPT-4o直接蒸馏!

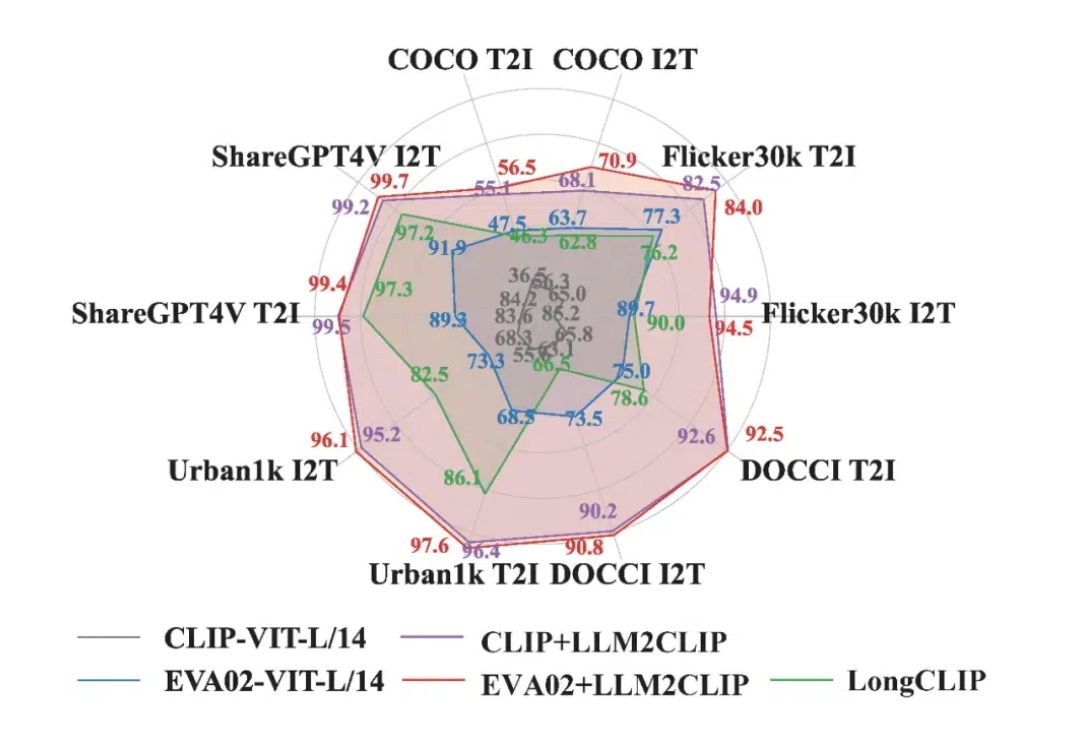

在当今多模态领域,CLIP 模型凭借其卓越的视觉与文本对齐能力,推动了视觉基础模型的发展。CLIP 通过对大规模图文对的对比学习,将视觉与语言信号嵌入到同一特征空间中,受到了广泛应用。

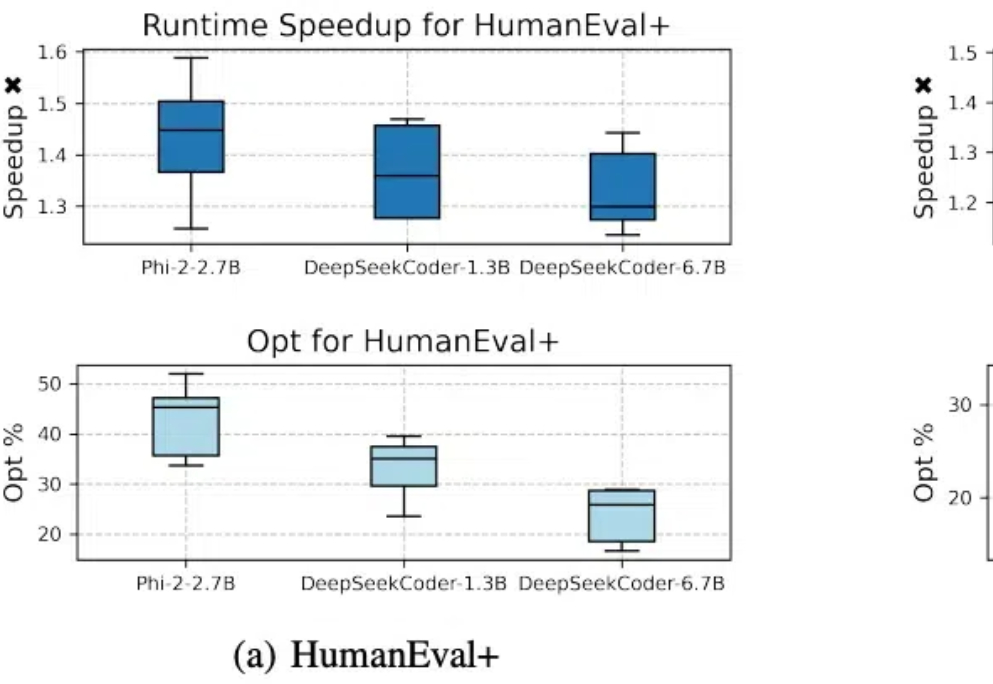

代码模型SFT对齐后,缺少进一步偏好学习的问题有解了。 北大李戈教授团队与字节合作,在模型训练过程中引入偏好学习,提出了一个全新的代码生成优化框架——CodeDPO。

斯坦福吴佳俊团队,给机器人设计了一套组装宜家家具的视频教程!

利用概念激活向量破解大模型的安全对齐,揭示LLM重要安全风险漏洞。

OpenAI o1风格的推理大模型,有行业垂直版了。HK-O1aw,是由香港生成式人工智能研发中心(HKGAI)旗下AI for Reasoning团队(HKAIR) 联合北京大学对齐团队(PKU-Alignment Team)推出的全球首个慢思考范式法律推理大模型。