用GPT-2监督GPT-4,防止AI毁灭人类? OpenAI Ilya超级对齐团队首篇论文出炉

用GPT-2监督GPT-4,防止AI毁灭人类? OpenAI Ilya超级对齐团队首篇论文出炉Ilya领衔的OpenAI对齐团队,刚刚发表了首篇论文——用类似GPT-2监督GPT-4的方法,或可帮人类搞定自己更聪明的超级AI!

Ilya领衔的OpenAI对齐团队,刚刚发表了首篇论文——用类似GPT-2监督GPT-4的方法,或可帮人类搞定自己更聪明的超级AI!

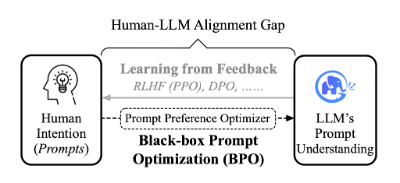

大模型的效果好不好,有时候对齐调优很关键。但近来很多研究开始探索无微调的方法,艾伦人工智能研究所和华盛顿大学的研究者用「免调优」对齐新方法超越了使用监督调优(SFT)和人类反馈强化学习(RLHF)的 LLM 性能。

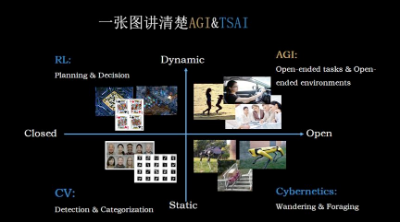

这一切看似尘埃落定,但伴随着此次OpenAI纷争,一个潜藏的深层次议题浮出水面:考量AGI的未来轨迹时,有两种观念:一方面是“有效加速主义”,主张无条件加速技术创新,快速推动社会结构的颠覆;另一方面是“超级爱对齐”,强调在AI发展过程中必须注入对人类的深层关怀与爱,以确保AI对人类的安全性。

最近,来自北京大学等机构研究者提出了一种全新视觉语言大模型——Video-LLaVA,使得LLM能够同时接收图片和视频为输入。Video-LlaVA在下游任务中取得了卓越的性能,并在图片、视频的13个基准上达到先进的性能。这个结果表明,统一LLM的输入能让LLM的视觉理解能力提升。

本文探讨了AI对齐在OpenAI公司中被忽视的一部分,以及AI对齐在大模型训练中的重要性和影响。文章揭示了OpenAI内部因AI对齐而产生的分歧,并阐述了AI对齐在保证AI按照人类意图和价值观运作方面的作用。同时,文章指出AI对齐在大模型训练中存在的性能阉割和对齐税等问题,以及AI对齐在大模型发展中的隐藏模型和重要性。

OpenAI的董事会发生了“政变”,导致CEO奥特曼被罢免。董事会没有公布具体原因,引发了公司内部和投资者的不满和困惑。

AI能理解搞笑视频笑点在哪里了。北大等团队开源视觉语言大模型Video-LLaVA,将图像和视频表示对齐到统一的视觉特征空间,在13个图片和视频基准上达到先进的性能。

并非所有人都熟知如何与 LLM 进行高效交流。 一种方案是,人向模型对齐。于是有了 「Prompt工程师」这一岗位,专门撰写适配 LLM 的 Prompt,从而让模型能够更好地生成内容。

C-MCR利用现有多模态对比表征间可能存在的重叠模态,来连接不同的对比表征,从而学到更多模态间的对齐关系,实现了在缺乏配对数据的多模态间进行训练。

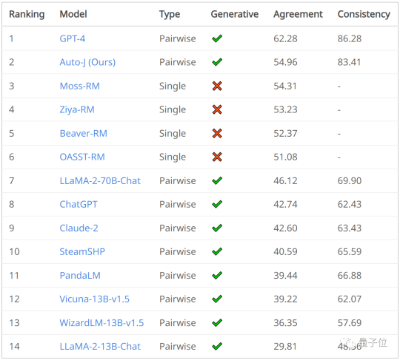

评估大模型对齐表现最高效的方式是?在生成式AI趋势里,让大模型回答和人类价值(意图)一致非常重要,也就是业内常说的对齐(Alignment)。