AI带来“幻觉”,是创意还是误导?

AI带来“幻觉”,是创意还是误导?人工智能系统的“幻觉”是由于其工作原理和结构决定的,它们并非大脑模型,无法准确地描述事实。然而,人们使用人工智能系统通常是为了完成创造性的任务,而创造力涉及某种启发式的搜索过程。

人工智能系统的“幻觉”是由于其工作原理和结构决定的,它们并非大脑模型,无法准确地描述事实。然而,人们使用人工智能系统通常是为了完成创造性的任务,而创造力涉及某种启发式的搜索过程。

近期,关于GPT-4.5提前泄露的消息在全网疯传,逼的OpenAI研究员甚至Altman本人下场否认,但这仍然挡不住愉快吃瓜的网友。

多模态技术是 AI 多样化场景应用的重要基础,多模态大模型(MLLM)展现出了优秀的多模态信息理解和推理能力,正成为人工智能研究的前沿热点。上周,谷歌发布 AI 大模型 Gemini,据称其性能在多模态任务上已全面超越 OpenAI 的 GPT-4V,再次引发行业的广泛关注和热议。

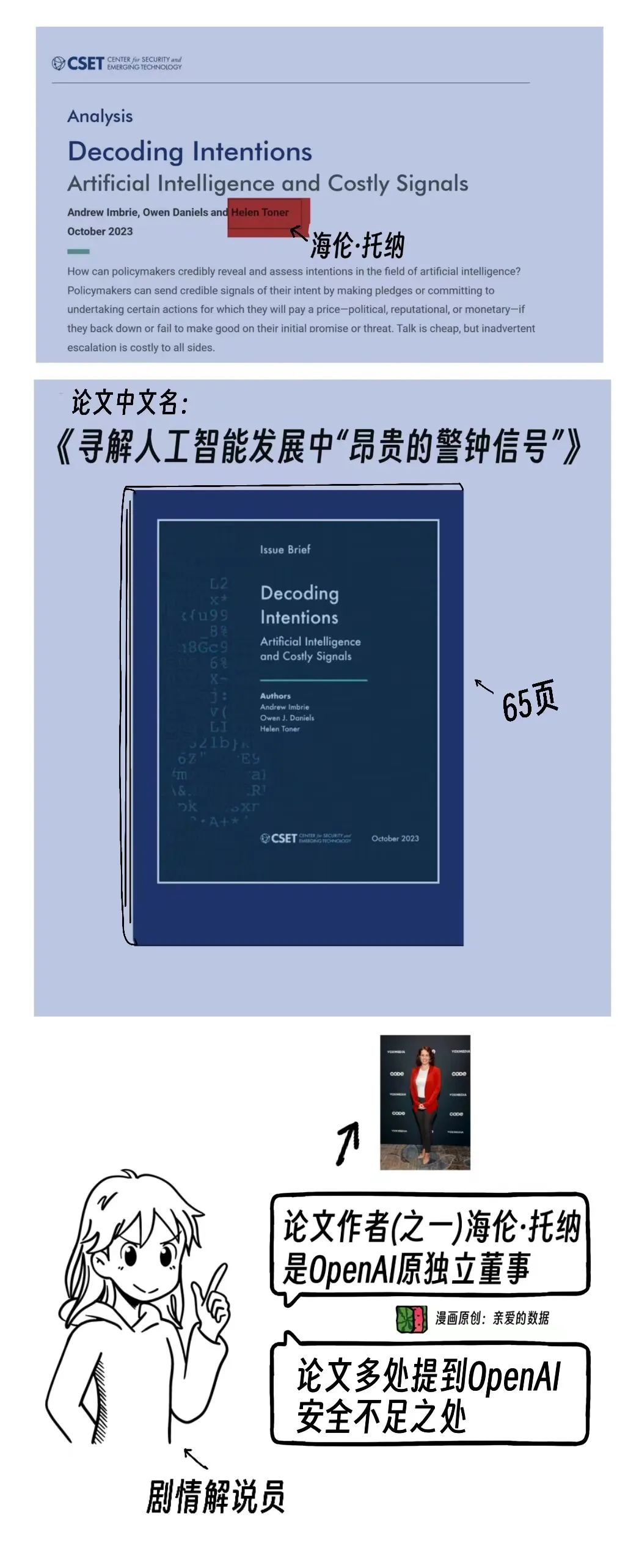

随着大型语言模型(LLM)的发展,从业者面临更多挑战。如何避免 LLM 产生有害回复?如何快速删除训练数据中的版权保护内容?如何减少 LLM 幻觉(hallucinations,即错误事实)? 如何在数据政策更改后快速迭代 LLM?这些问题在人工智能法律和道德的合规要求日益成熟的大趋势下,对于 LLM 的安全可信部署至关重要。

大模型长期以来一直存在一个致命的问题,即生成幻觉。由于数据集的复杂性,难免会包含过时和错误的信息,这使得输出质量面临着极大的挑战。过多的重复信息还可能导致大型模型产生偏见,这也算是一种形式的幻觉。

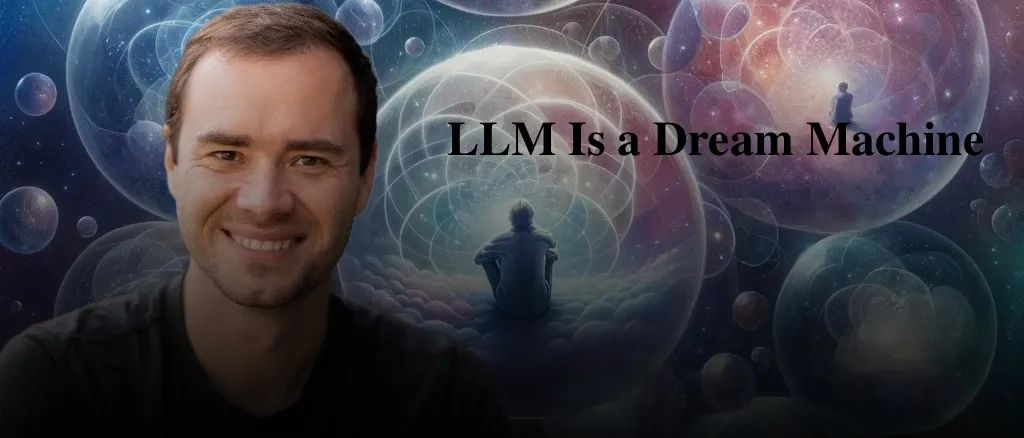

大模型就是「造梦机」!幻觉是LLM与生俱来的特性,而非缺陷。OpenAI科学家Andrej Karpathy独特视角在AI社区掀起了激烈的讨论。

现在的GPT-4,未来的GPT-5,相较于前几个版本性能更强。安全挑战,史无前例。

Nature刊文,从学生、老师、学要、教育平台、教育工具提供商等角度详细剖析了LLM如何重塑教育事业,变革的时刻也许已经到来了。

大语言模型「拍马屁」的问题到底要怎么解决?最近,LeCun转发了Meta发布的一篇论文,研究人员提出了新的方法,有效提升了LLM回答问题的事实性和客观性。我们一起来看一下吧。

本文讨论了大模型AI在语言生成中常出现的“幻觉”现象,即生成与输入信息不符的胡话。作者解释了“幻觉”的成因和影响,并介绍了降低“幻觉”的一些努力和突破。