6700万参数比肩万亿巨兽GPT-4!微软MIT等联手破解Transformer推理密码

6700万参数比肩万亿巨兽GPT-4!微软MIT等联手破解Transformer推理密码来自微软、MIT等机构的学者提出了一种创新的训练范式,攻破了大模型的推理缺陷。他们通过因果模型构建数据集,直接教模型学习公理,结果只有67M参数的微型Transformer竟能媲美GPT-4的推理能力。

来自微软、MIT等机构的学者提出了一种创新的训练范式,攻破了大模型的推理缺陷。他们通过因果模型构建数据集,直接教模型学习公理,结果只有67M参数的微型Transformer竟能媲美GPT-4的推理能力。

生成式 AI 碰撞上自动驾驶技术,会产生怎样的火花?过去,生成式 AI 在业界已经被用来解决自动驾驶的长尾问题。目前,学界开始尝试在算法仿真领域引入多 Agent 数据集来增强仿真的效果。

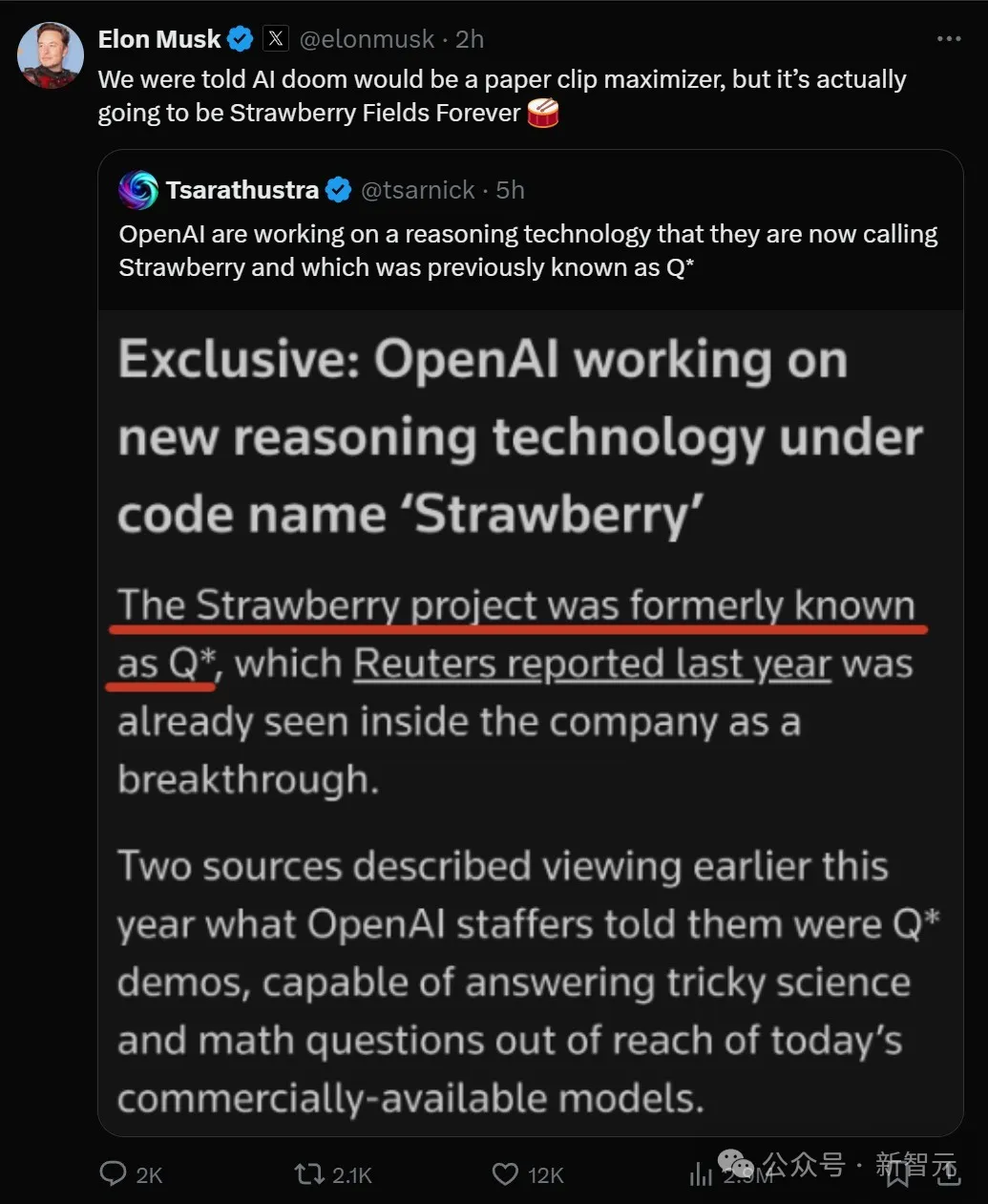

OpenAI被曝出了新项目「草莓」,据悉能提前计划,自主浏览网页,还能进行深度研究。草莓由大量通用数据上后训练而成,推理能力显著提高。根据OpenAI最近的AGI路线图,草莓疑似已达Level 2。

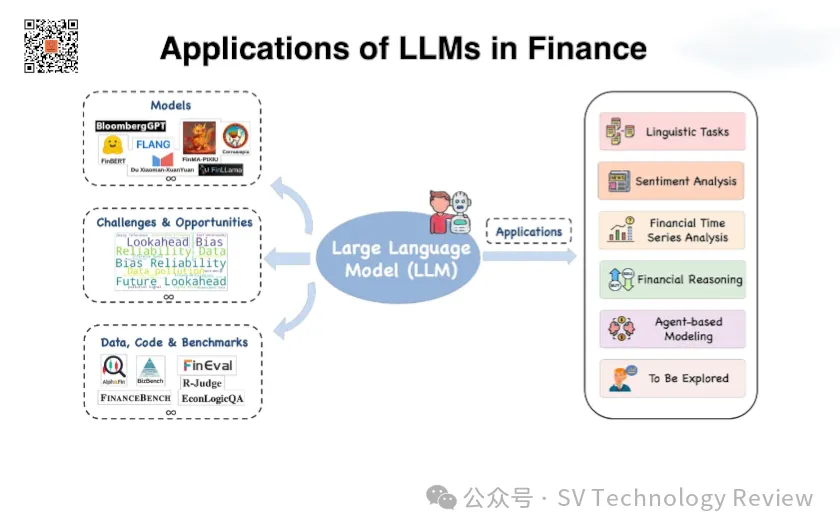

在瞬息万变的金融市场中,大模型(LLM)作为一种前沿技术,正以前所未有的速度变革着投资和金融行业。凭其强大的数据处理能力和智能分析功能,LLM不仅能够帮助投资者做出更明智的决策,还能预见市场趋势,降低投资风险。

全球共有1600个组织受访,受访者均为组织生成式AI战略或关键部门的数据分析决策者。

GPT-3 时刻正在进入机器人世界。

Kevin Scott表示,过去20年里,人工智能领域最重要的进步都与“规模”有关;OpenAI的潜力在于未来可能成为构建AI平台的基础;数据的质量比数量更重要。

生成式模型原本被设计来模仿人类的各种复杂行为,但人们普遍认为它们最多只能达到与其训练数据中的专家相当的水平。不过,最新的研究突破了这一限制,表明在特定领域,如国际象棋,通过采用低温采样技术,这些模型能够超越它们所学习的那些专家,展现出更高的能力。

将分析师此前需要2-3个小时完成的工作缩短为2-3分钟。

这几年,人们都在谈论大模型。特别是在 Scaling Law 的指导下,人们寄希望于将更大规模的数据用于训练,以无限提升模型的智能水平。在中国,「数据」作为一种与土地、劳动力、资本、技术并列的生产要素,价值越来越被重视。