字节开源大模型量化新思路,2-bit量化模型精度齐平fp16

字节开源大模型量化新思路,2-bit量化模型精度齐平fp16随着深度学习大语言模型的越来越火爆,大语言模型越做越大,使得其推理成本也水涨船高。模型量化,成为一个热门的研究课题。

随着深度学习大语言模型的越来越火爆,大语言模型越做越大,使得其推理成本也水涨船高。模型量化,成为一个热门的研究课题。

当地时间5月7日,ICLR 2024颁发了自大会举办以来的首个「时间检验奖」!

在机器学习社区中,ICLR (国际学习表征会议)是较为「年轻」的学术会议,它由深度学习巨头、图灵奖获得者 Yoshua Bengio 和 Yann LeCun 在 2013 年牵头举办。但 ICLR 很快就获得了研究者的广泛认可,并且在 AI 圈拥有了深度学习会议「无冕之王」的称号。

由深度学习巨头、图灵奖获得者 Yoshua Bengio 和 Yann LeCun 在 2013 年牵头举办的 ICLR 会议,在走过第一个十年后,终于迎来了首届时间检验奖。

20 世纪 90 年代,长短时记忆(LSTM)方法引入了恒定误差选择轮盘和门控的核心思想。三十多年来,LSTM 经受住了时间的考验,并为众多深度学习的成功案例做出了贡献。然而,以可并行自注意力为核心 Transformer 横空出世之后,LSTM 自身所存在的局限性使其风光不再。

推荐系统对于应对信息过载挑战至关重要,它们根据用户的个人偏好提供定制化推荐。近年来深度学习技术极大地推动了推荐系统的发展,提升了对用户行为和偏好的洞察力。

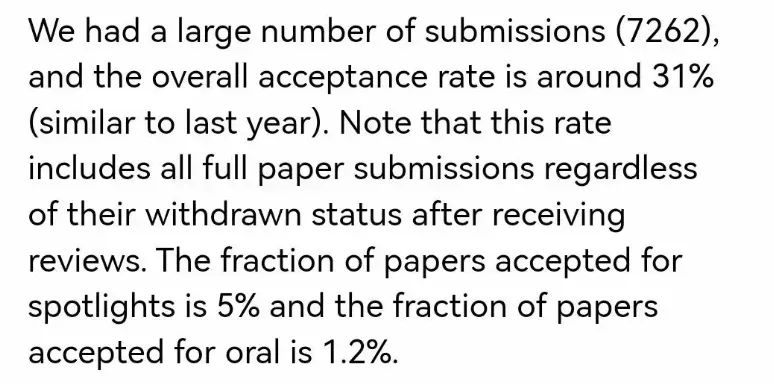

ICLR 全称为国际学习表征会议(International Conference on Learning Representations),今年举办的是第十二届,于 5 月 7 日至 11 日在奥地利维也纳展览会议中心举办。

不需要OpenAI,微软或许也会成为AI领头羊!

多层感知器(MLP),也被称为全连接前馈神经网络,是当今深度学习模型的基础构建块。MLP 的重要性无论怎样强调都不为过,因为它们是机器学习中用于逼近非线性函数的默认方法。

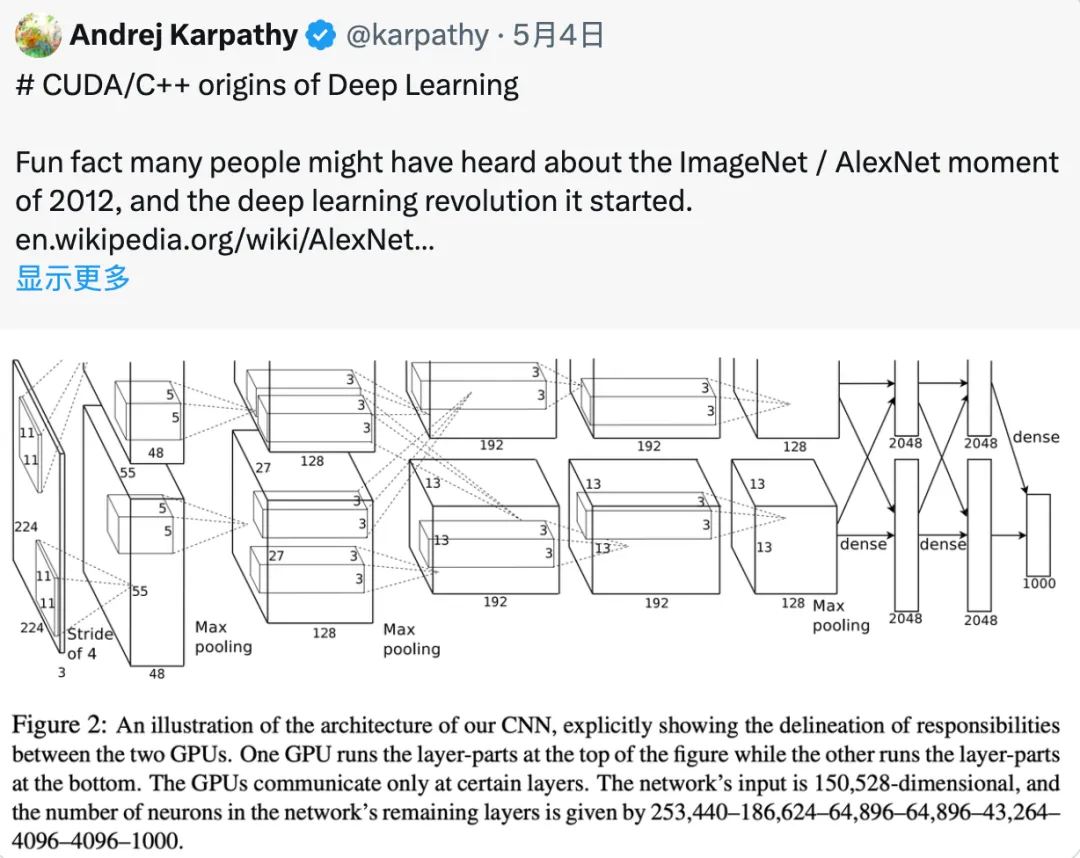

没想到,自 2012 年 AlexNet 开启的深度学习革命已经过去了 12 年。