挖到M2.1的7个神仙用法,有点上头。。

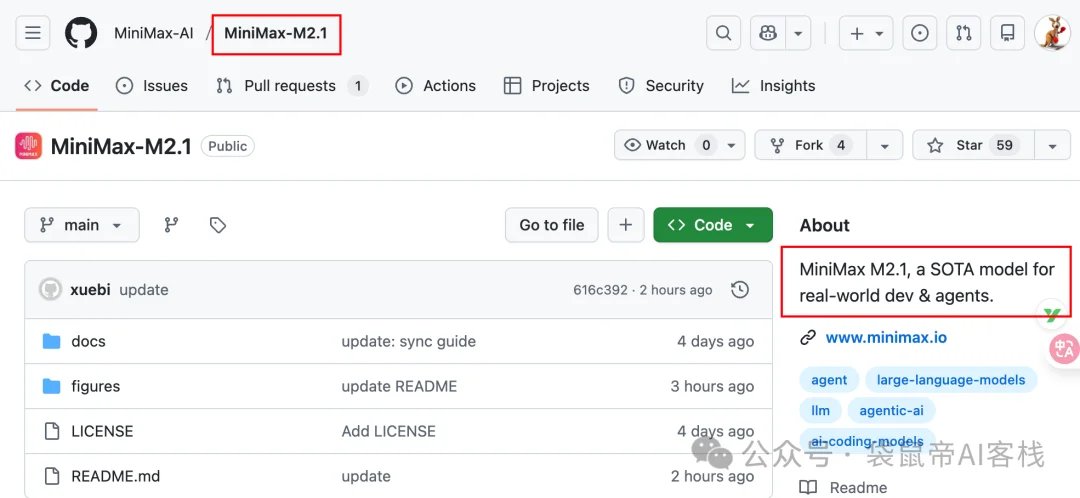

挖到M2.1的7个神仙用法,有点上头。。上周我还在折腾各种图片、视频生成模型,这周又到了编程周。前天MiniMax丢出了个在编程界绝对有分量的模型:MiniMax-M2.1。然后发现就在刚才已经开源了:

上周我还在折腾各种图片、视频生成模型,这周又到了编程周。前天MiniMax丢出了个在编程界绝对有分量的模型:MiniMax-M2.1。然后发现就在刚才已经开源了:

真是越到年底,越是神仙打架。

在代码大模型(Code LLMs)的预训练中,行业内长期存在一种惯性思维,即把所有编程语言的代码都视为同质化的文本数据,主要关注数据总量的堆叠。然而,现代软件开发本质上是多语言混合的,不同语言的语法特性、语料规模和应用场景差异巨大。

ChatGPT 也推出了年度回顾,不过,由于各种限制,不是每个人都能打开,有网友等了一天都等不到自己的年度回顾。拜托,现在 AI 已经这么好用了,为什么不能自己做一个呢?尤其是这一年,有大量的时间正是花在这些 AI 工具里。

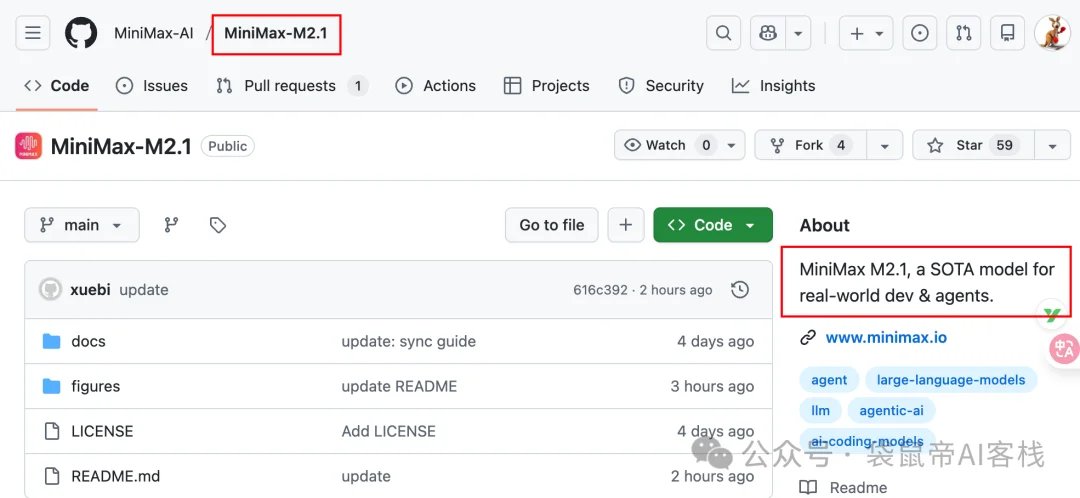

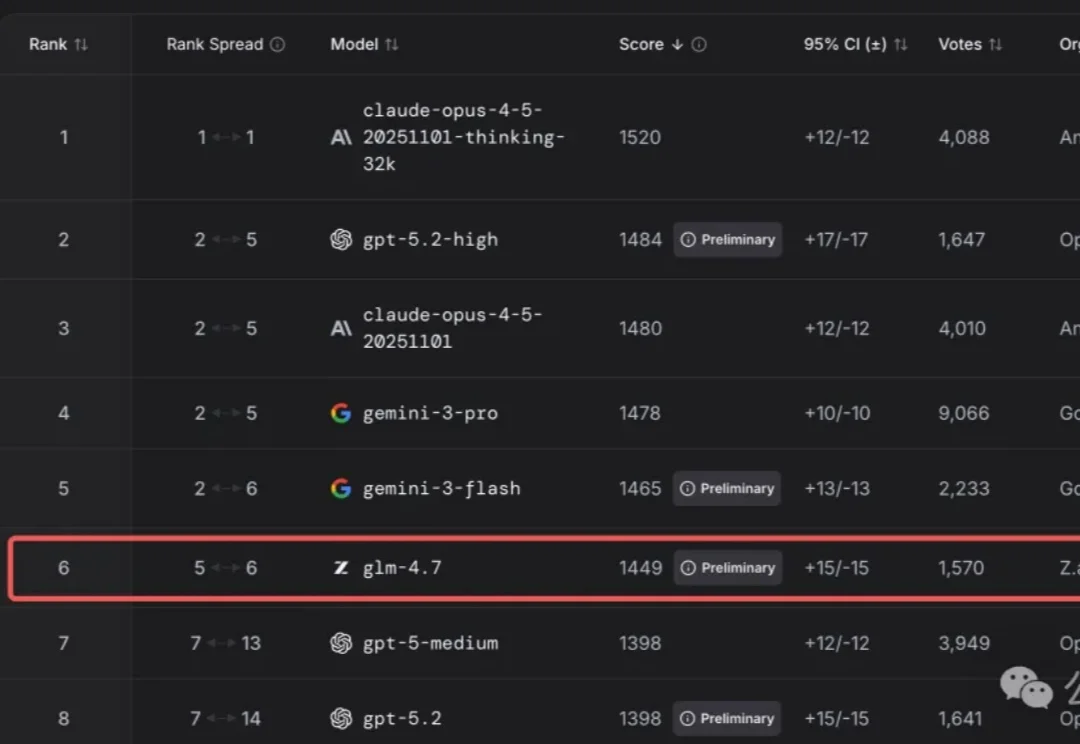

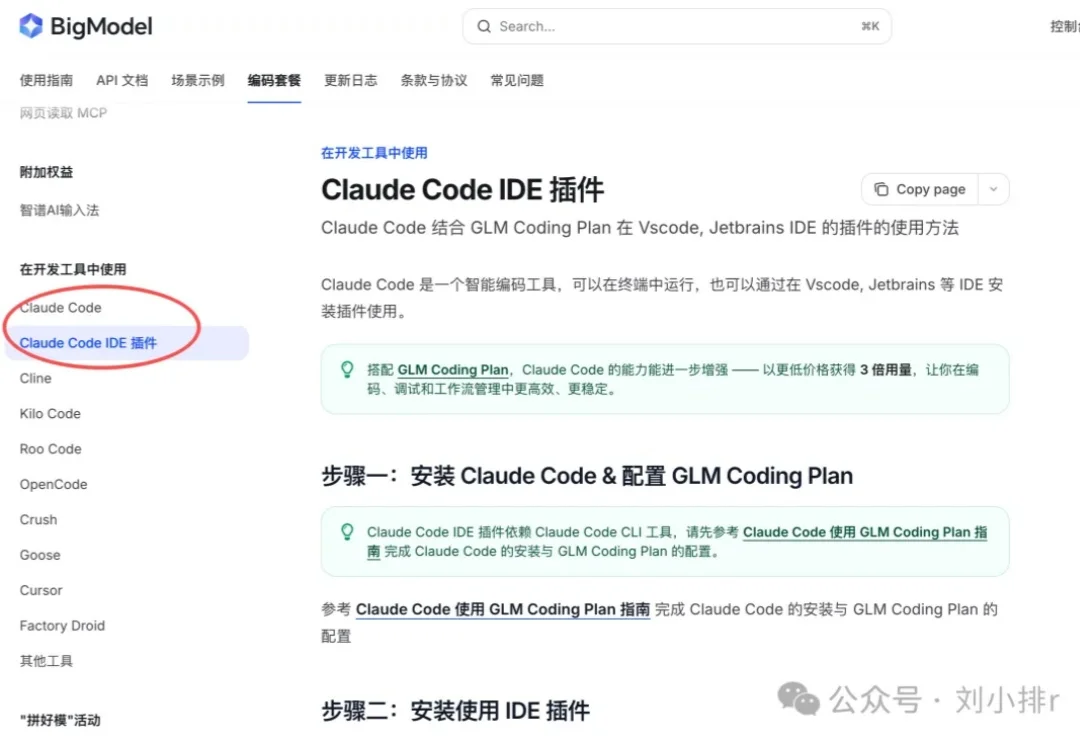

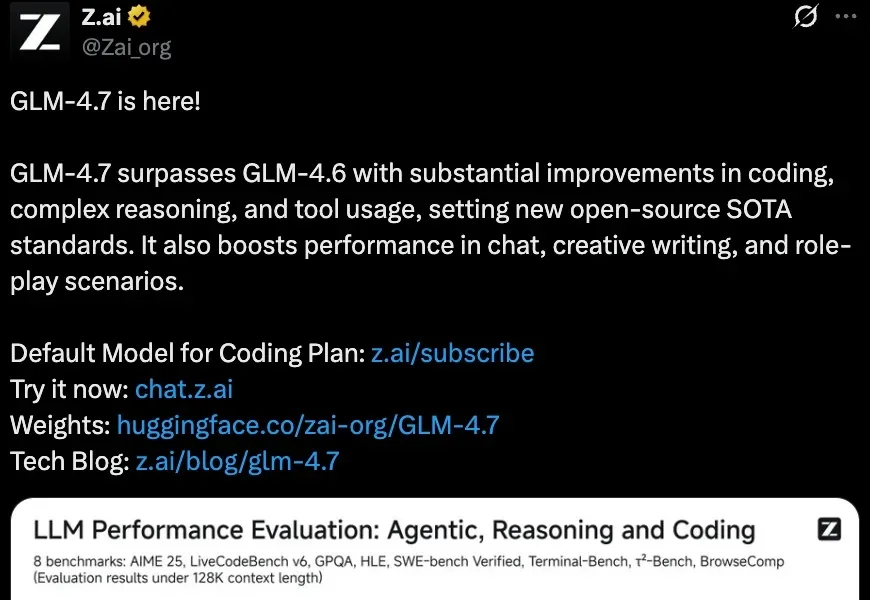

哈喽,大家好,我是刘小排。 GLM 4.7发布了,从客观数据看,编程方面进步很大。

老粉都知道,咱们特工宇宙和扣子团队有多熟悉。

MiniMax最新旗舰级Coding & Agent模型M2.1,刚刚对外发布了。这一次,它直接甩出了一份硬核成绩单,在衡量多语言软件工程能力的Multi-SWE-bench榜单中,以仅10B的激活参数拿下了49.4%的成绩,超越了Claude Sonnet 4.5等国际顶尖竞品,拿下全球SOTA。

2025倒计时,新SOTA模型涌现没有放缓迹象。一夜之间,编程SOTA模型易主,而且上线即开源,依然来自中国大模型公司——智谱AI,GLM-4.7。

编程初创公司Lovable在销售额翻三倍后,以66亿美元的估值获得了3.3亿美元的新融资,正值对于能够加速软件开发的人工智能工具的需求激增。Lovable首席执行官在周五的彭博电视节目中表示,自上轮融资六个月以来,公司收入“增长了三倍以上”。他拒绝透露具体数字。

即将过去的、我们无比熟悉的 2025 年,被称为是 Agent 的元年。