比英伟达工程师还熟练!DeepSeek R1+测试时Scaling自动优化GPU内核

比英伟达工程师还熟练!DeepSeek R1+测试时Scaling自动优化GPU内核英伟达巧妙地将DeepSeek-R1与推理时扩展相结合,构建了全新工作流程,自动优化生成GPU内核,取得了令人瞩目的成果。

英伟达巧妙地将DeepSeek-R1与推理时扩展相结合,构建了全新工作流程,自动优化生成GPU内核,取得了令人瞩目的成果。

这项尝试只用到了 R1 模型和基本验证器,没有针对 R1 的工具,没有对专有的英伟达代码进行微调。其实根据 DeepSeek 介绍,R1 的编码能力不算顶尖。

DeepSeek的V3模型仅用557.6万的训练成本,实现了与OpenAI O1推理模型相近的性能,这在全球范围内引发连锁反应。由于不用那么先进的英伟达芯片就能实现AI能力的飞跃,英伟达在1月27日一天跌幅高达17%,市值一度蒸发6000亿美元。

SANA 1.5是一种高效可扩展的线性扩散Transformer,针对文本生成图像任务进行了三项创新:高效的模型增长策略、深度剪枝和推理时扩展策略。这些创新不仅大幅降低了训练和推理成本,还在生成质量上达到了最先进的水平。

英伟达卡内基梅隆大学一起,给宇树机器人“一雪前耻”了(doge)。只通过一个训练框架,机器人就能成为“学人精”,完成各种高难度敏捷动作。

最近,一位哈佛教授痛心疾首地曝出,DeepSeek本来有机会诞生在美国?原本DeepSeek的工程师可以拿到英伟达的全职offer,美国却没有将他留住,导致「钱学森回国」的故事再一次上演,美国跟「国运级AI」擦肩而过!

机器人界「球星」竟被CMU英伟达搞出来了!科比后仰跳投、C罗、詹皇霸气庆祝动作皆被完美复刻。2030年,我们将会看到一场人形机器人奥运会盛宴。

今年 1 月,DeepSeek R1 引爆了全球科技界,它创新的方法,大幅简化的算力需求撼动了英伟达万亿市值,更引发了全行业的反思。在通往 AGI(通用人工智能)的路上,我们现在不必一味扩大算力规模,更高效的新方法带来了更多的创新可能。

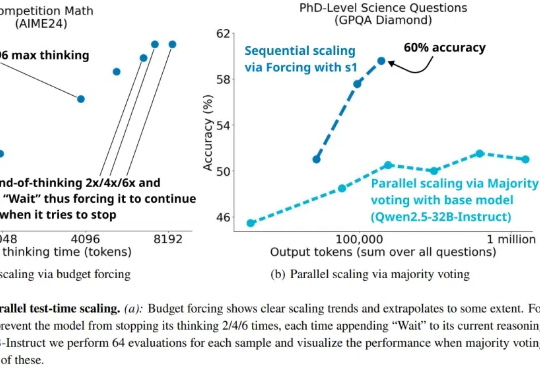

Ilya Sutskever 在 NeurIPS 会上直言:大模型预训练这条路可能已经走到头了。上周的 CES 2025,黄仁勋有提到,在英伟达看来,Scaling Laws 仍在继续,所有新 RTX 显卡都在遵循三个新的扩展维度:预训练、后训练和测试时间(推理),提供了更佳的实时视觉效果。

先是“AI界拼多多”DeepSeek,从除夕前火到了现在。它凭借着“低训练成本”、“能和OpenAI一较高下的模型能力”,直接给全球来了一剂猛药,甚至让OpenAI、英伟达两大AI巨头公司感受到了“威胁”。关于DeepSeek成本、能力、创始人的“神话”和“误读”,还在此起彼伏出现。