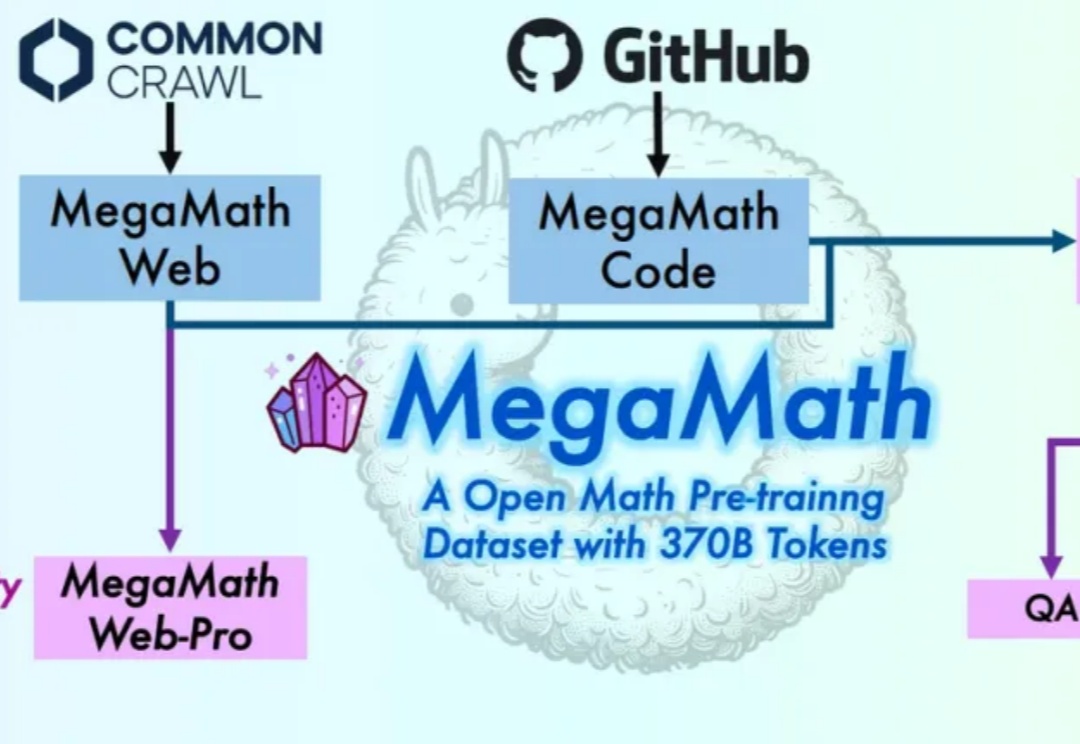

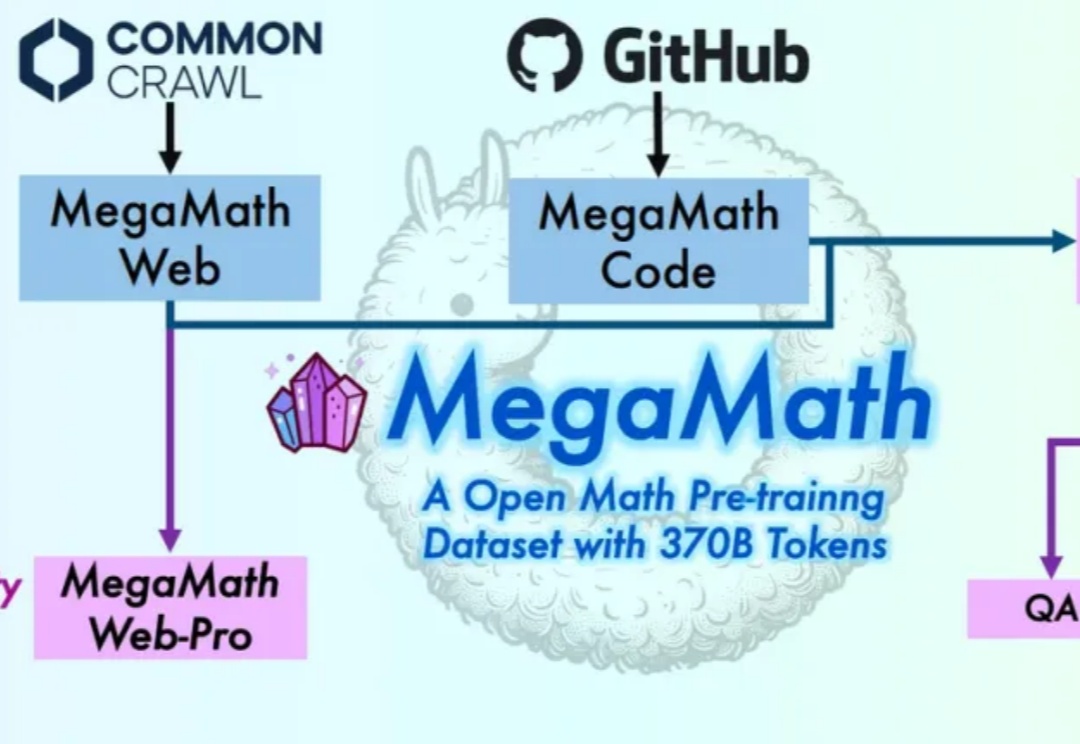

3710亿数学tokens,全面开放!史上最大高质量开源数学预训练数据集MegaMath发布

3710亿数学tokens,全面开放!史上最大高质量开源数学预训练数据集MegaMath发布在大模型迈向推理时代的当下,数学推理能力已成为衡量语言模型智能上限的关键指标。

在大模型迈向推理时代的当下,数学推理能力已成为衡量语言模型智能上限的关键指标。

中国科学院深圳先进技术研究院娄春波团队与北京大学定量生物学中心钱珑团队成功推出一款生物制造大语言模型SYMPLEX。SYMPLEX是全球首个面向合成生物学元件挖掘与生物制造应用的大语言模型。

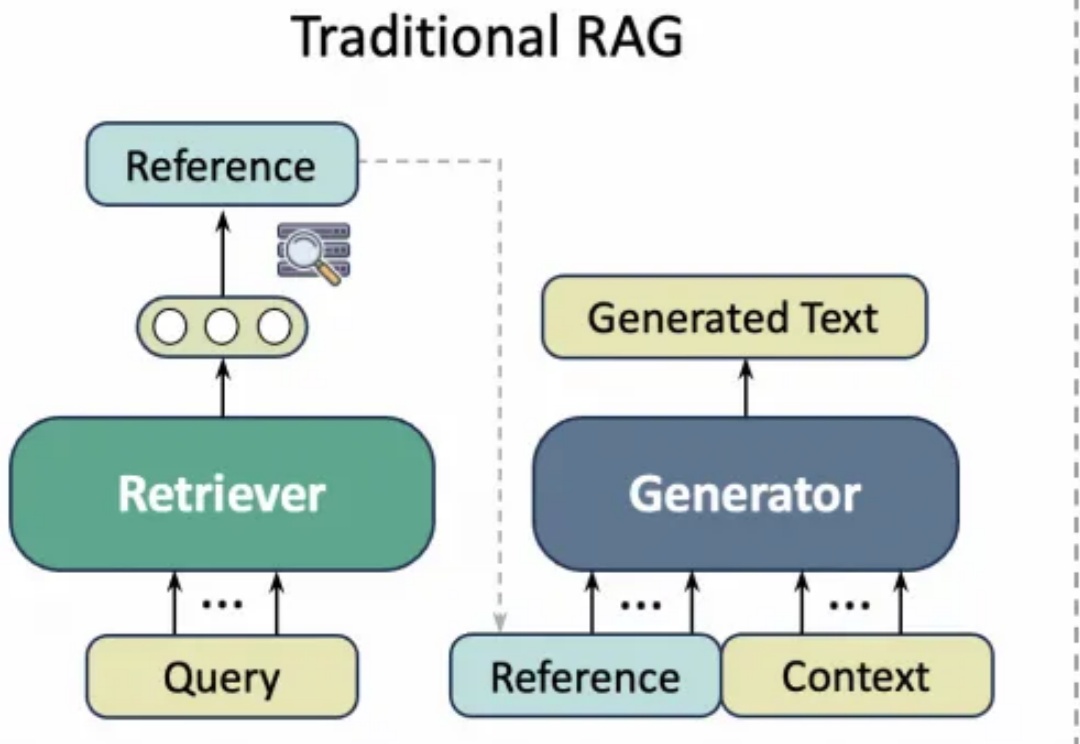

学术写作通常需要花费大量精力查询文献引用,而以ChatGPT、GPT-4等为代表的通用大语言模型(LLM)虽然能够生成流畅文本,但经常出现“引用幻觉”(Citation Hallucination),即模型凭空捏造文献引用。这种现象严重影响了学术论文的可信度与专业性。

多点发力,协同并进,才能让AI的成长有更多道路可走

众所周知,大语言模型(LLM)往往对硬件要求很高。

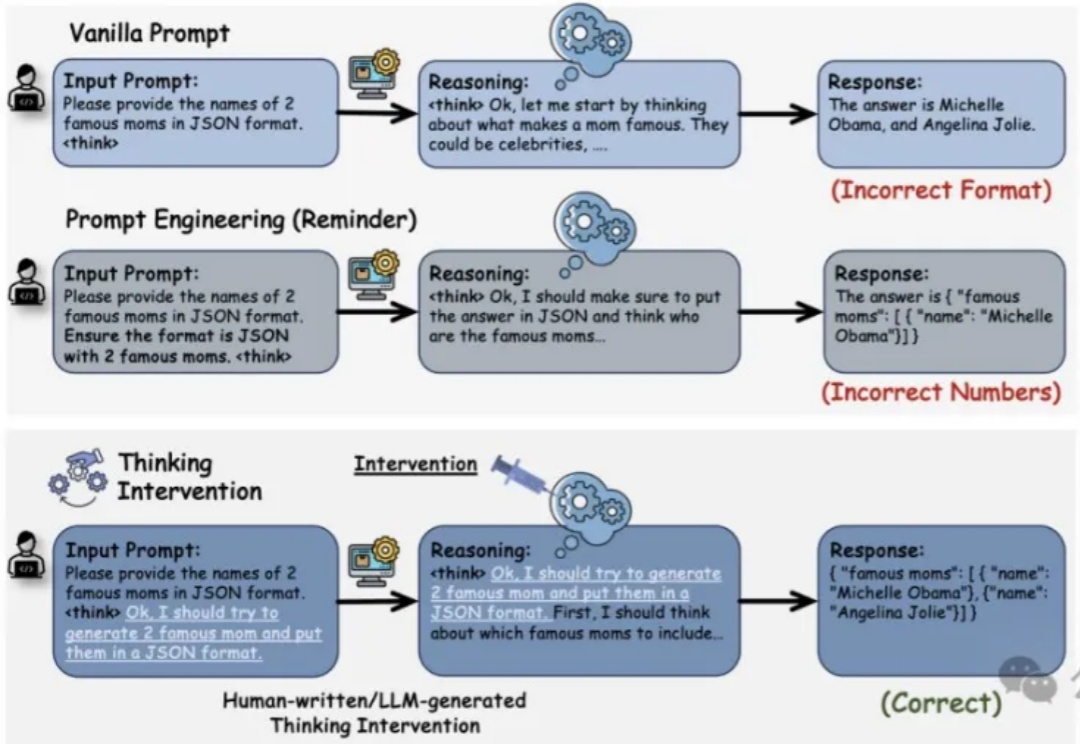

推理增强型大语言模型LRM(如OpenAI的o1、DeepSeek R1和Google的Flash Thinking)通过在生成最终答案前显式生成中间推理步骤,在复杂问题解决方面展现了卓越性能。然而,对这类模型的控制仍主要依赖于传统的输入级操作,如提示工程(Prompt Engineering)等方法,而你可能已经发现这些方法存在局限性。

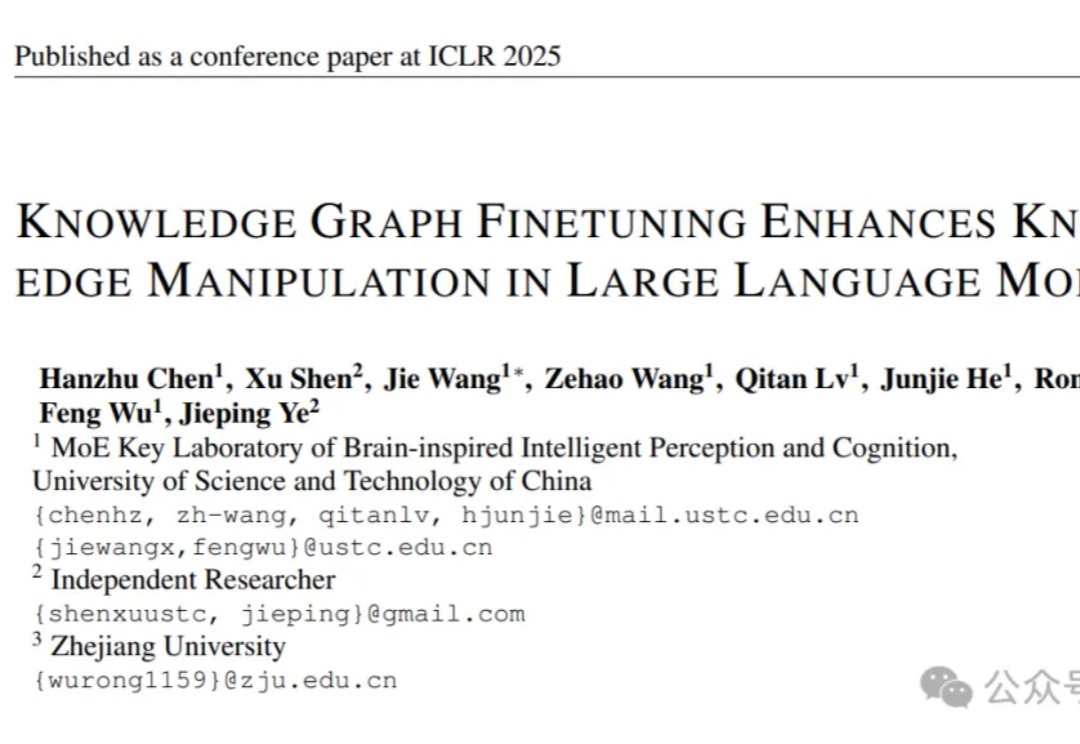

让大语言模型更懂特定领域知识,有新招了!

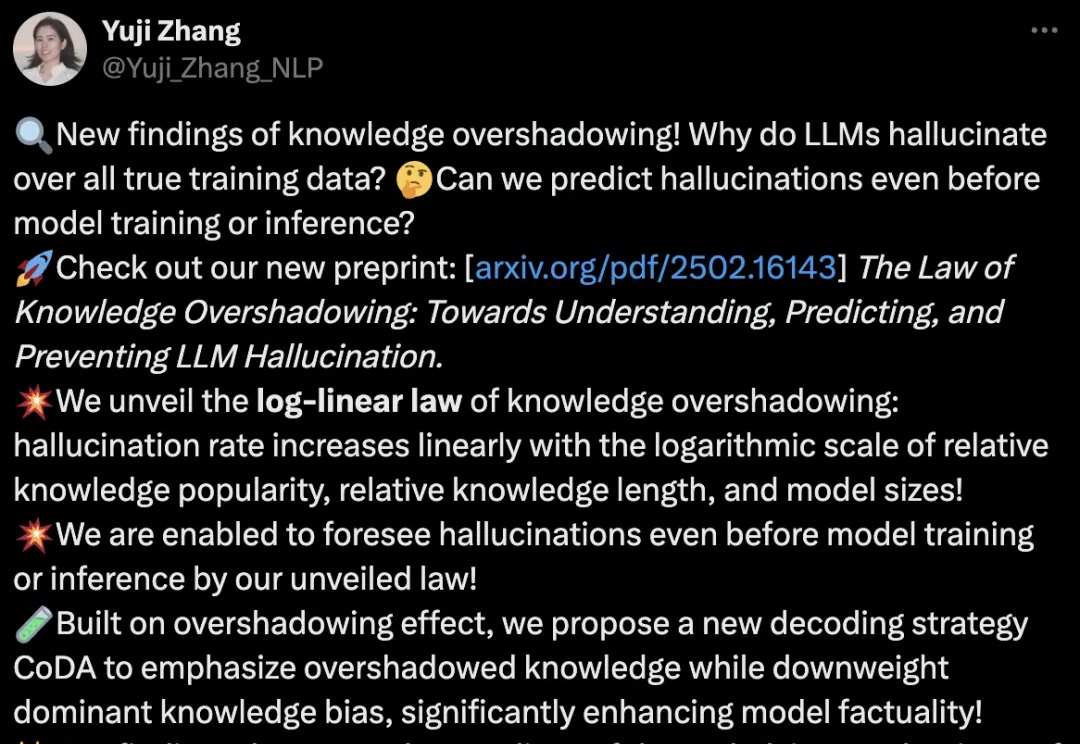

来自UIUC等大学的华人团队,从LLM的基础机制出发,揭示、预测并减少幻觉!通过实验,研究人员揭示了LLM的知识如何相互影响,总结了幻觉的对数线性定律。更可预测、更可控的语言模型正在成为现实。

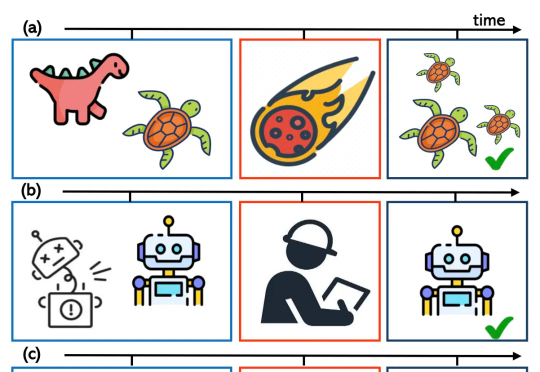

近年来,大语言模型(LLM)的性能提升逐渐从训练时规模扩展转向推理阶段的优化,这一趋势催生了「测试时扩展(test-time scaling)」的研究热潮。

大型语言模型 (LLM) 在软体机器人设计领域展现出了令人振奋的应用潜力。