创业一年半,胖了30斤,AI大佬感叹:还是回谷歌好

创业一年半,胖了30斤,AI大佬感叹:还是回谷歌好本周一,知名 AI 学者、前谷歌大脑高级研究科学家 Yi Tay 在短短一年半的创业之后官宣回到谷歌,他显得很高兴。

本周一,知名 AI 学者、前谷歌大脑高级研究科学家 Yi Tay 在短短一年半的创业之后官宣回到谷歌,他显得很高兴。

不知道从何时起,脑海里就有着阶跃星辰的多模态能力遥遥领先的印象。 无论去哪旅游,以前是用谷歌地图,现在基本都用「跃问」,看到长得奇特的建筑就拍来问问,还能跟 AI Chat 一下历史。 这不,最近来新加坡出差了,顺便旅旅游,就又用上了「跃问」。

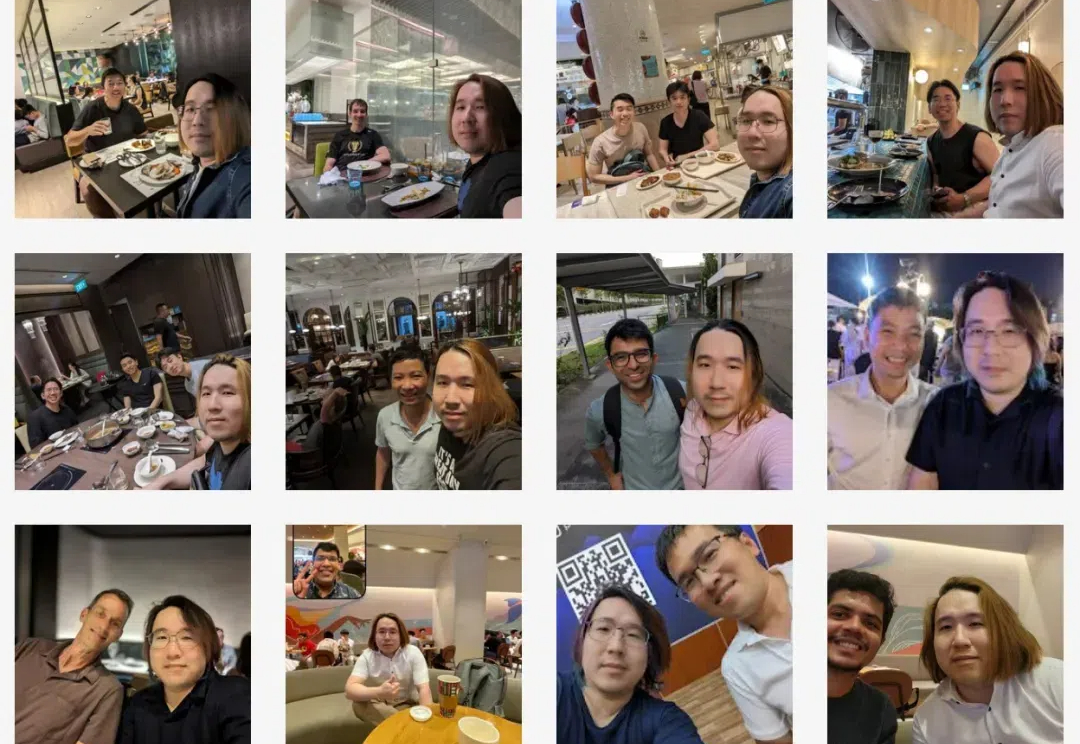

在人工智能领域,大语言模型(LLM)的向量嵌入能力一直被视为处理文本数据的利器。然而,斯坦福大学和Google DeepMind的研究团队带来了一个颠覆性发现:LLM的向量嵌入能力可以有效应用于回归任务。

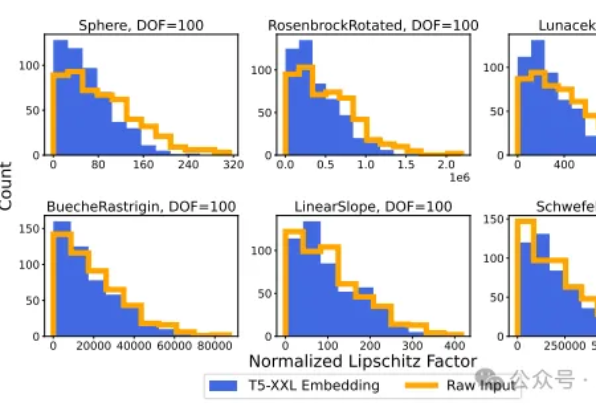

曾经每天都用谷歌学术的科学家们,正在转向新的AI工具。

今年是谷歌学术创立20周年,创始人们特意为此撰写了一篇博客,回顾了谷歌学术的成长历程,并分享了一些实用的使用技巧和背后的趣闻轶事。在AI浪潮席卷而来之际,谷歌学术将如何站稳脚跟?

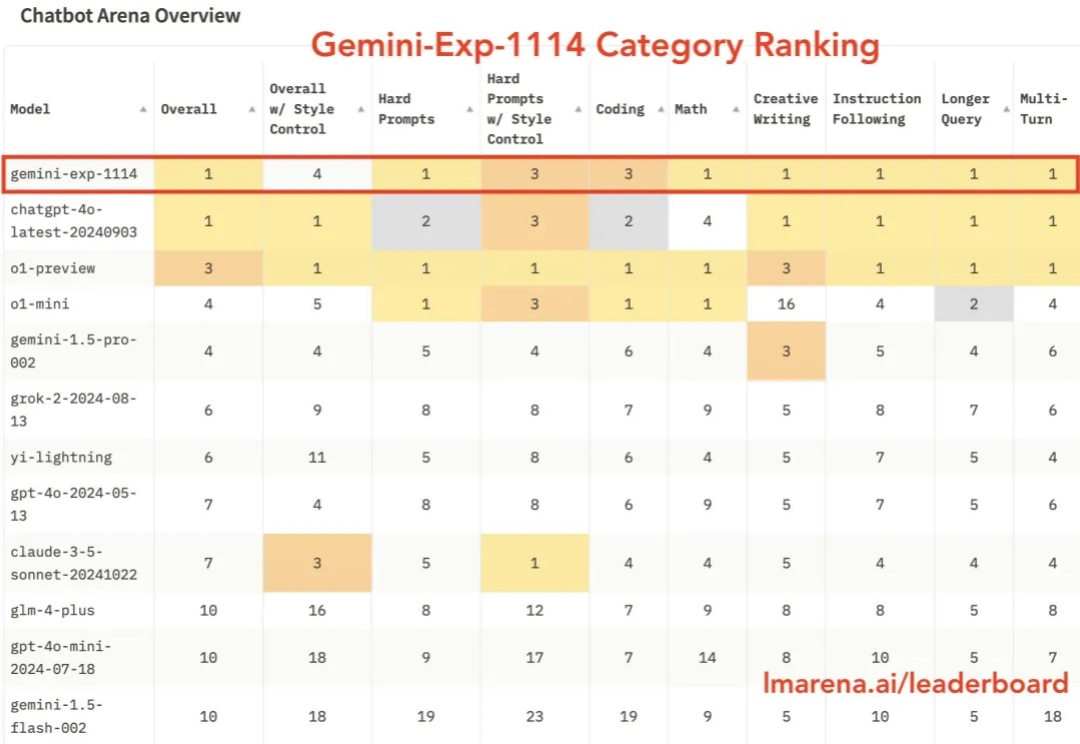

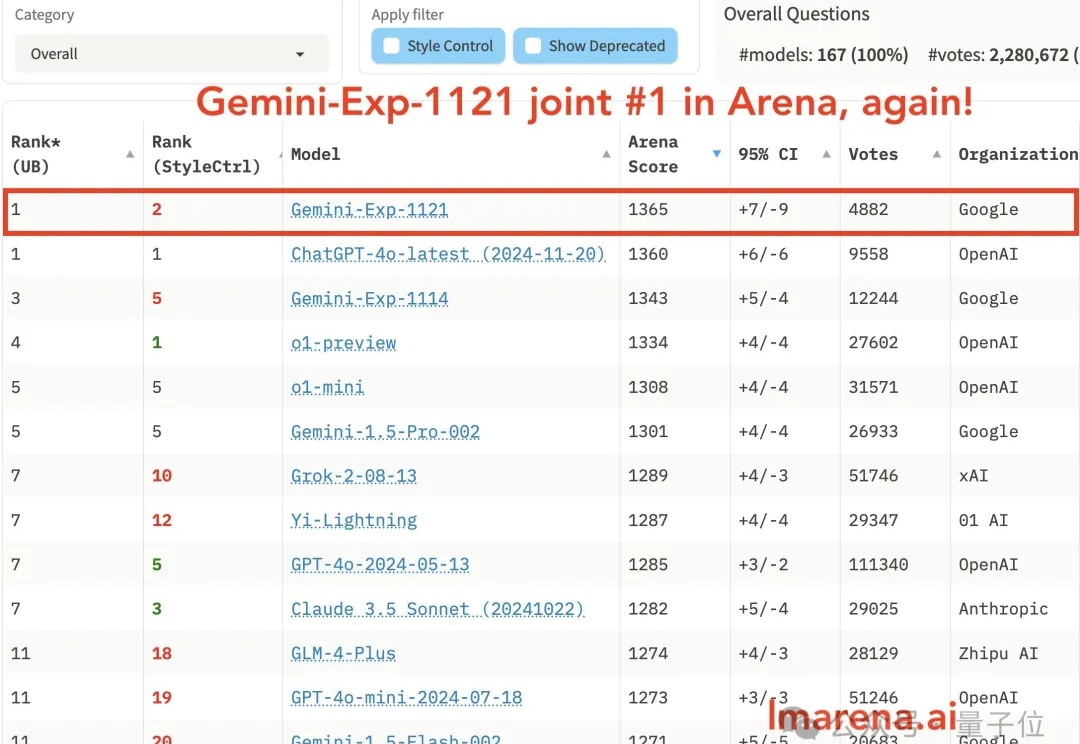

太卷了,大模型迭代开始以「周」为单位了吗?

谷歌和OpenAI又杠上了。

领头羊企业OpenAI刚获得66亿美元融资,估值达到1570亿美元,成为究极独角兽。紧跟其后,xAI、Perplexity、Anthropic等明星创企也开始新一轮的大额融资,xAI的估值更是冲向了450亿美元。三年过去,生成式AI热潮经久不衰,依然是当下最热门投资方向。

阿联酋和沙特大力投资美国AI市场,引发国际关注。 • 🚀 阿联酋MGX基金投资OpenAI等AI公司。 • 💼 阿联酋和沙特展开AI领域竞争。 • 🌐 沙特推动AI项目,与谷歌云合作。

美司法部请求法官强制谷歌出售其Chrome浏览器,这标志着对这家全球最大的科技公司之一的重大打击。