人工智能正以前所未有的速度改变着我们的世界。在这场技术革命中,Anthropic等领先企业描绘了一幅令人振奋的未来图景:智能代理系统将在各行各业发挥重要作用,从客户服务到软件开发,AI都将成为不可或缺的助手。然而,在这片繁荣景象的背后,一个潜在的危机正在悄然滋长。

Anthropic最新发布的研究报告[1]中,详细阐述了如何构建高效的AI代理系统。他们提出了一系列看似简单而强大的模式,从基本的提示链接到复杂的orchestrator-worker工作流。这些方法无疑能带来短期的效率提升,但我们不禁要问:这些技术是否真的推动了AI的本质进步,还是仅仅是在掩盖更深层次的问题?

事实上,仔细审视Anthropic的方法,我们会发现一个令人不安的事实:这些所谓的创新,本质上都建立在prompt工程的基础之上。而prompt工程,正是本文要探讨的核心问题 - 它可能正成为阻碍AI真正进步的绊脚石。

2019年,一位名叫John Smith的软件工程师正在为一家大型电商公司开发一个客户服务AI。John发现,只要稍微调整输入提示,AI的回答就能变得更加准确和贴切。这看似是一个巧妙的发现,但实际上,John和他的团队正在步入prompt工程的陷阱。

Prompt工程,简而言之,就是通过精心设计输入指令来优化AI模型的输出。它就像是给AI开了一剂"聪明药",能让模型在特定任务上表现出色。这种方法之所以受欢迎,原因显而易见:它简单、直接、见效快。开发者不需要深入了解模型的内部机制,只需要不断调整输入,直到得到满意的结果。

然而,这种表面上的便利性掩盖了一个严重的问题:我们是在教会AI真正理解和解决问题,还是仅仅在教它如何应对特定的提示?就像那个依赖"聪明药"的人可能会失去独立思考的能力,过度依赖prompt工程的AI系统可能永远无法达到真正的智能。

根据一项研究[2],自动化系统在许多场景下已经能够超越人工生成的提示。这意味着,我们可能正在投入大量资源到一个即将被淘汰的技术上。

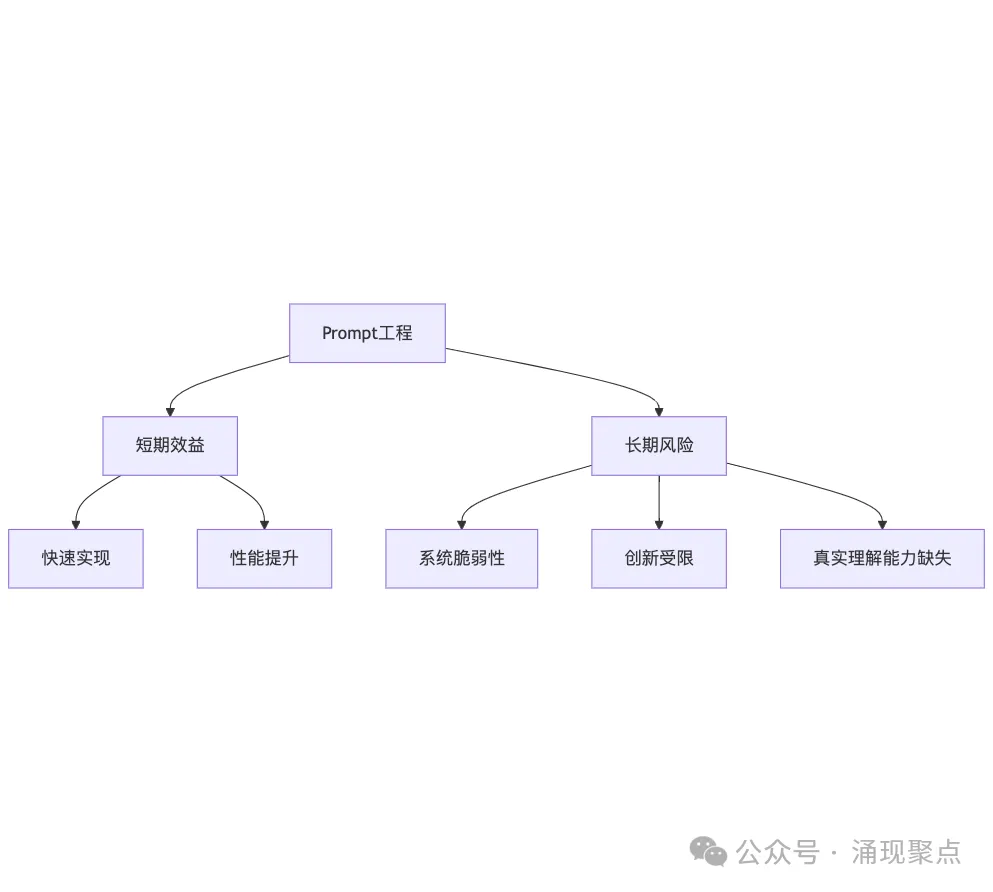

提示词工程的双面性

这张图展示了prompt工程的双面性。虽然它能带来短期的效益,如快速实现和性能提升,但长期来看,它可能导致系统脆弱性增加、创新受限,以及AI系统缺乏真实的理解能力。

要理解prompt工程的潜在危害,我们需要先了解软件开发中的一个重要概念:技术债。

技术债指的是为了短期利益而采用次优解决方案所带来的长期成本。就像信用卡债务一样,技术债会随着时间的推移而累积,最终可能导致系统的崩溃。

一个经典的例子是Y2K问题。上世纪60、70年代的程序员为了节省内存,只用两位数表示年份。这个看似聪明的做法在短期内确实提高了效率,但随着千禧年的临近,这个"技术债"几乎导致了全球范围的系统崩溃。据估计,为了修复这个问题,全球共花费了约1000亿美元。

McKinsey的一项研究[3]显示,组织通常会分配10-20%的新项目预算来解决技术债务。这不仅耗费了大量的财务资源,还分散了开发团队的注意力,导致创新和战略性计划的延迟。

技术债不仅会增加维护成本,还会严重限制系统的可扩展性和创新能力。当开发者花费大量时间处理遗留问题时,他们就没有精力去开发新功能或优化系统架构。

那么,prompt工程如何成为AI领域的技术债呢?让我们深入分析一下。

首先,prompt工程的脆弱性不容忽视。Anthropic的研究中提到,即使是微小的词语变化也可能导致AI输出的显著差异。这意味着基于prompt工程的系统极其敏感,难以维护和扩展。想象一下,如果一个复杂的AI系统依赖于数百个精心调校的prompt,那么每次模型更新或业务需求变化,都可能导致整个系统的崩溃。

以一家大型科技公司的经历为例。他们开发了一个基于prompt工程的客户服务AI系统,初期表现优异。然而,随着公司业务的扩展和客户需求的变化,维护这个系统变得越来越困难。开发团队发现,每次添加新功能或调整现有功能,都需要重新设计和测试大量的prompt,这不仅耗时耗力,还经常导致系统其他部分的意外行为。

其次,prompt工程严重限制了AI系统的灵活性和创新能力。当我们过度依赖特定的prompt来获得期望的输出时,我们实际上是在限制AI的思考空间。这就像是给一个孩子提供标准答案,而不是教会他独立思考。长此以往,AI系统可能会变得僵化,失去应对新挑战的能力。

更重要的是,prompt工程可能会阻碍我们对AI本质的理解。当我们把注意力集中在如何优化输入上时,我们可能忽视了更根本的问题:如何提升AI的真正理解能力和推理能力。这就像是在不断改进马车,而忽视了发明汽车的可能性。

一项研究[4]显示,91%的机器学习模型在条件变化时会出现性能下降,这凸显了基于prompt工程的系统的脆弱性。

提示词工程的技术债

这张图展示了prompt工程作为技术债的主要问题。它导致系统脆弱性增加,创新受限,以及AI系统真实理解能力的缺失。这些问题相互关联,共同阻碍了AI的长期发展。

Anthropic在其研究中大力推崇agent系统,认为这是AI应用的未来。然而,我们不得不问:这些复杂的agent系统是否真的解决了问题,还是只是在沙滩上建造摩天大楼?

Agent系统的核心仍然依赖于prompt工程。虽然它们看起来更加复杂和智能,但本质上仍然是在通过精心设计的提示来引导AI的行为。这种方法不仅没有解决prompt工程的根本问题,反而可能会加剧技术债的累积。

想象一个由多个agent组成的复杂系统,每个agent都依赖于特定的prompt来完成任务。这样的系统不仅难以维护,而且极易出错。一个agent的微小失误可能会在整个系统中产生连锁反应,导致灾难性的后果。

更糟糕的是,这种复杂性可能会给我们一种虚假的安全感。我们可能会误以为,通过堆砌更多的agent和更复杂的工作流,我们就能解决AI的根本局限性。然而,这种方法可能只会让我们陷入更深的技术债陷阱。

一项研究[5]指出,agent模型存在诸多陷阱,包括过度拟人化、忽视系统的复杂性、以及对agent能力的错误估计。这些问题在复杂的multi-agent系统中可能会被进一步放大。

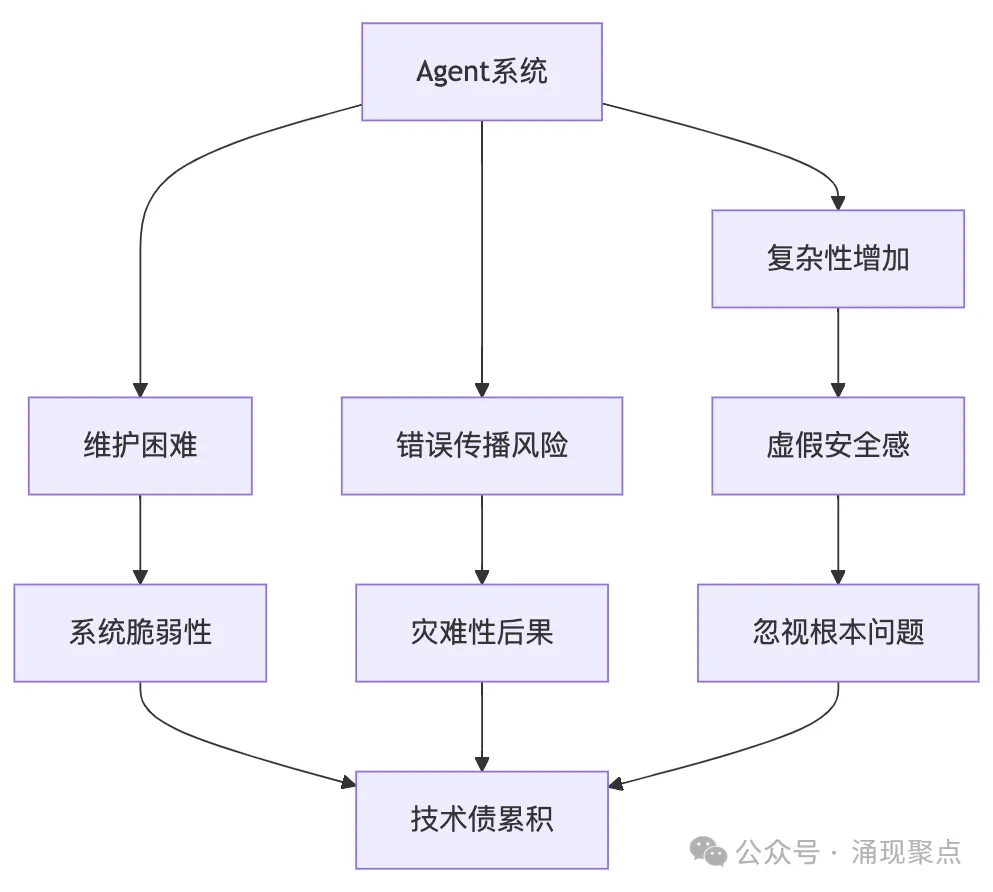

Agent系统可能带来的问题

这张图展示了agent系统可能带来的问题。虽然它看似解决了一些问题,但实际上可能会导致系统复杂性增加、维护困难、错误传播风险上升,最终导致更严重的技术债累积。

那么,我们应该如何摆脱prompt工程的束缚,真正推动AI的发展呢?答案可能在于回归AI研究的本质。

首先,我们需要重新关注模型本身的能力提升,而不是仅仅优化输入。这意味着要投入更多资源到基础模型的研究中,提高模型的理解能力、推理能力和泛化能力。例如,多模态AI系统的研发就是一个有前景的方向,它能让AI更全面地理解和处理信息。

一项研究[6]显示,多模态AI系统如GPT-4能够处理文本、图像等多种输入形式,大大减少了对特定prompt的依赖。

其次,我们应该探索自动化prompt生成和优化的方法。Google的LaMDA AI展示了这方面的潜力,它能够根据过去的交互自动调整响应。这种方法可以减少人工干预,让AI系统更加自主和适应性强。

再者,我们需要重新思考AI系统的评估方式。目前,很多评估标准都过于依赖特定的prompt,这可能导致我们高估了AI的实际能力。我们需要开发更全面、更客观的评估方法,真正衡量AI的理解能力和问题解决能力。

最后,也许是最重要的,我们需要培养一种新的AI开发思维。不再是"如何优化prompt",而是"如何设计能真正理解和解决问题的AI系统"。这需要我们跳出当前的思维框架,勇于挑战既有范式。

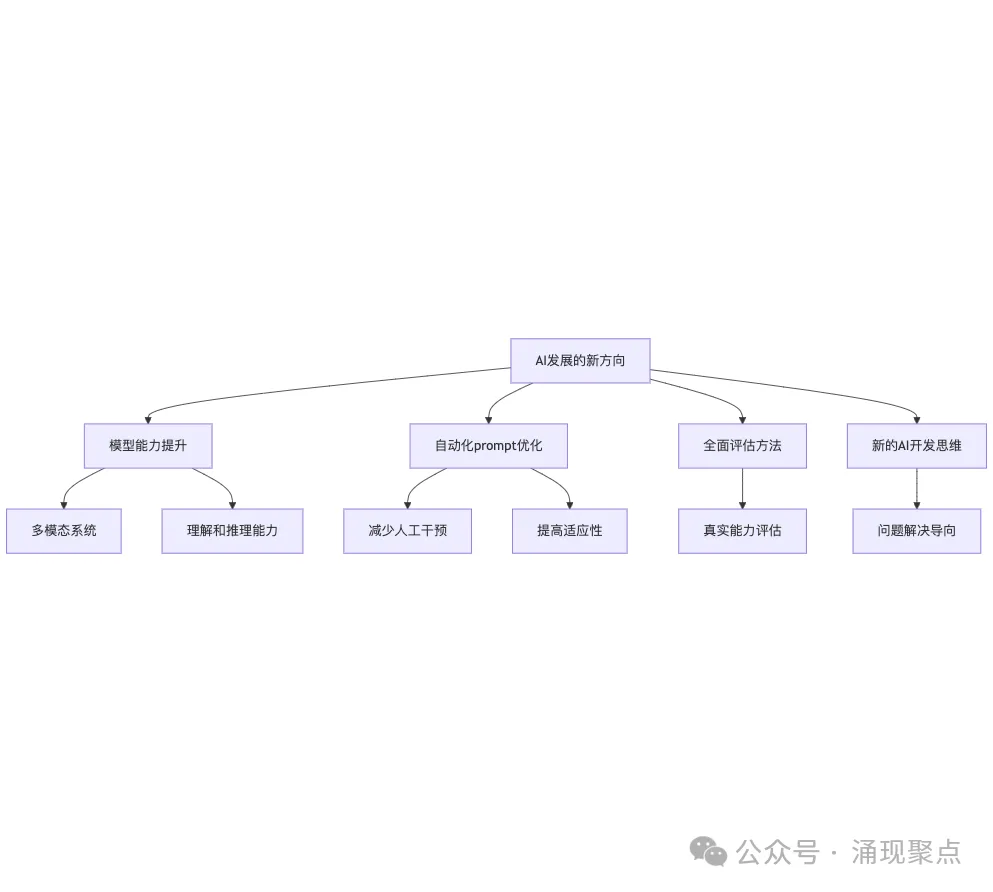

AI发展的新方向

这张图展示了AI发展的新方向。我们需要从多个角度推动AI的进步,包括提升模型本身的能力、探索自动化的prompt优化方法、开发更全面的评估体系,以及培养新的AI开发思维。这种多维度的方法更有可能带来AI的实质性进步。

Prompt工程无疑在短期内推动了AI应用的快速发展。然而,如果我们不能认识到它的局限性,并采取行动去克服这些局限,我们可能会阻碍AI的长远进步。

我们需要重新审视AI发展的方向。是继续在prompt工程的道路上越走越远,还是勇敢地走出舒适区,探索真正能提升AI能力的新方法?这个选择将决定AI技术的未来,也将深刻影响人类社会的发展。

如果我们能够如果我们能够摆脱prompt工程的束缚,回归到AI研究的本质,我们或许能够开创一个真正智能的未来。在这个未来中,AI不再是被动地响应特定的提示,而是能够真正理解、推理和创新。

让我们共同思考:在后prompt工程时代,AI的发展之路应该如何定义?我们又该如何避免落入新的技术债陷阱?这些问题的答案,将塑造我们与AI共存的未来。

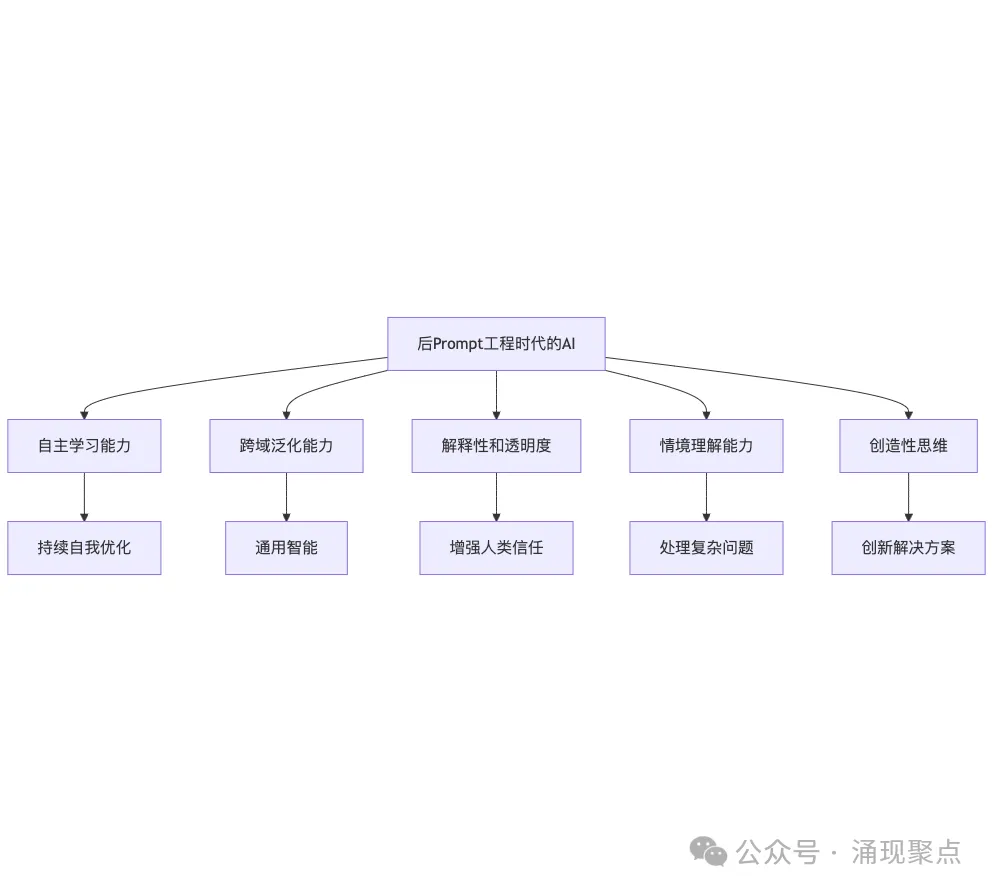

随着人工智能技术的不断演进,我们有理由相信,后prompt工程时代的AI发展将呈现出全新的面貌。这个时代的AI可能具备以下特征:

自主学习能力:未来的AI系统将不再依赖于人工设计的prompt,而是能够自主学习和适应新环境。它们可能会通过持续的自我优化来提升性能,就像人类通过经验积累而成长一样。例如,Google的LaMDA AI已经展示了这方面的潜力,它能够根据过去的交互自动调整响应。

跨域泛化能力:AI将不再局限于特定领域,而是能够灵活地将知识迁移到新的问题域。这种泛化能力将大大扩展AI的应用范围,使其成为真正的通用智能。多模态AI系统的发展正在朝这个方向迈进,如GPT-4和Gemini 2.0已经能够处理文本、图像等多种输入形式。

解释性和透明度:未来的AI系统将不再是黑盒,而是能够清晰地解释其决策过程。这不仅有助于增强人类对AI的信任,也将为AI的进一步改进提供重要洞见。一项研究[7]指出,提高AI模型的透明度和可解释性是未来AI发展的重要方向。

情境理解能力:AI将能够更深入地理解复杂的情境和语境,而不仅仅是表面的文字含义。这种深层次的理解能力将使AI在处理模糊和不确定性问题时变得更加高效。例如,在客户服务领域,AI将能够更准确地理解客户的真实需求,而不仅仅是对关键词做出反应。

创造性思维:突破prompt工程的限制后,AI可能会展现出真正的创造力。它们不再局限于已知的模式,而是能够产生全新的、富有创意的解决方案。在艺术创作、科学研究等领域,我们可能会看到AI做出令人惊叹的创新。

后提示词工程时代的AI

这张图展示了后Prompt工程时代AI的主要特征。这些特征相互关联,共同推动AI向着更高级、更智能的方向发展。

然而,在追求这些进步的同时,我们也需要警惕新的技术债陷阱。例如,过度依赖自主学习可能导致AI系统的行为变得不可预测;跨域泛化能力的提升可能带来新的安全风险;追求解释性可能会牺牲系统的效率。

因此,在后prompt工程时代,我们需要建立一个平衡的发展框架。这个框架应该既鼓励AI能力的全面提升,又确保系统的可控性和安全性。我们需要在技术创新和伦理考量之间找到平衡点,确保AI的发展真正造福人类社会。

在这个新时代,AI研究者、开发者和使用者都需要以更开放、更批判的态度来看待AI技术。我们需要不断反思:我们开发的AI系统是否真正智能?它们是否能够适应复杂多变的现实世界?我们又该如何确保AI的发展方向与人类的价值观和需求保持一致?

只有不断思考这些深层次的问题,我们才能避免陷入新的技术债陷阱,真正推动AI向着更高层次的智能迈进。后prompt工程时代的AI发展之路可能充满挑战,但也蕴含着无限的可能性。让我们携手共同探索,开创AI的美好未来。

在这个过程中,我们需要保持警惕和批判性思考。正如一项研究[8]指出的那样,我们可能还没有准备好支持完全自主的AI代理。我们需要谨慎地评估每一步进展,确保我们不会在追求技术进步的过程中忽视潜在的风险。

同时,我们也要认识到,AI的发展不仅仅是技术问题,还涉及到复杂的社会、伦理和政策问题。我们需要多方面的协作,包括技术专家、伦理学家、政策制定者和公众的参与,才能确保AI的发展方向是负责任的、可持续的。

最后,让我们记住,技术的终极目标是为人类服务。在后prompt工程时代,我们应该致力于开发能够真正理解人类需求、能够与人类有效协作的AI系统。这不仅需要技术上的突破,还需要我们对人类智能和人机交互有更深入的理解。

通过摆脱prompt工程的束缚,回归到AI研究的本质,我们有望开创一个AI真正成为人类智能伙伴的新时代。这个时代的AI将不仅仅是一个强大的工具,而是能够与人类共同思考、共同创造的智能实体。让我们怀着这样的愿景,继续我们的AI探索之旅。

参考资料

[1]研究报告:https://www.anthropic.com/research/building-effective-agents

[2]一项研究:https://www.itpro.com/technology/artificial-intelligence/this-engineering-discipline-was-hailed-as-the-next-big-thing-but-ai-has-killed-it-before-it-even-started

[3]McKinsey的一项研究:https://hashstudioz.com/blog/understanding-technical-debt-and-its-impact-on-software-development/

[4]一项研究:https://www.rapidinnovation.io/post/the-power-of-genai-with-prompt-engineering

[5]一项研究:https://www.alignmentforum.org/posts/8HWGXhnCfAPgJYa9D/pitfalls-of-the-agent-model

[6]一项研究:https://www.techtarget.com/searchenterpriseai/tip/9-top-AI-and-machine-learning-trends

[7]一项研究:https://www.fanaticalfuturist.com/2024/12/ai-models-secretly-learn-new-capabilities-long-before-they-show-them/

[8]一项研究:https://www.zdnet.com/article/were-not-ready-to-support-autonomous-ai-agents-survey-suggests/

文章来自微信公众号 “涌现聚点”,作者“chouti”

【开源免费】OWL是一个完全开源免费的通用智能体项目。它可以远程开Ubuntu容器、自动挂载数据、做规划、执行任务,堪称「云端超级打工人」而且做到了开源界GAIA性能天花板,达到了57.7%,超越Huggingface 提出的Open Deep Research 55.15%的表现。

项目地址:GitHub:https://github.com/camel-ai/owl

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0