苏黎世联邦理工实测:一句Prompt就能摧毁16个Agent组成的「共识网络」多Agent避坑指南来了

苏黎世联邦理工实测:一句Prompt就能摧毁16个Agent组成的「共识网络」多Agent避坑指南来了在构建多Agent系统(Multi-Agent Systems)时,让几个Agent互相“对话”并不难,但要让它们在局部状态不一致的情况下,敲定一个全局唯一的决策,也就是达成“一致”(Agree)或“共识(Consensus)”,却是一个极具挑战的工程难题,您可能会问为什么,这有何难?

在构建多Agent系统(Multi-Agent Systems)时,让几个Agent互相“对话”并不难,但要让它们在局部状态不一致的情况下,敲定一个全局唯一的决策,也就是达成“一致”(Agree)或“共识(Consensus)”,却是一个极具挑战的工程难题,您可能会问为什么,这有何难?

我输入了一段 prompt,按下生成。手还搁在键盘上呢,视频已经出来了。

Anthropic 研究科学家 Nicholas Carlini 在 [un]prompted 2026 安全会议上用不到 25 分钟演示了一件事:语言模型现在可以自主找到并利用零日漏洞,目标包括 Linux 内核这种被人类安全专家审计了几十年的软件。

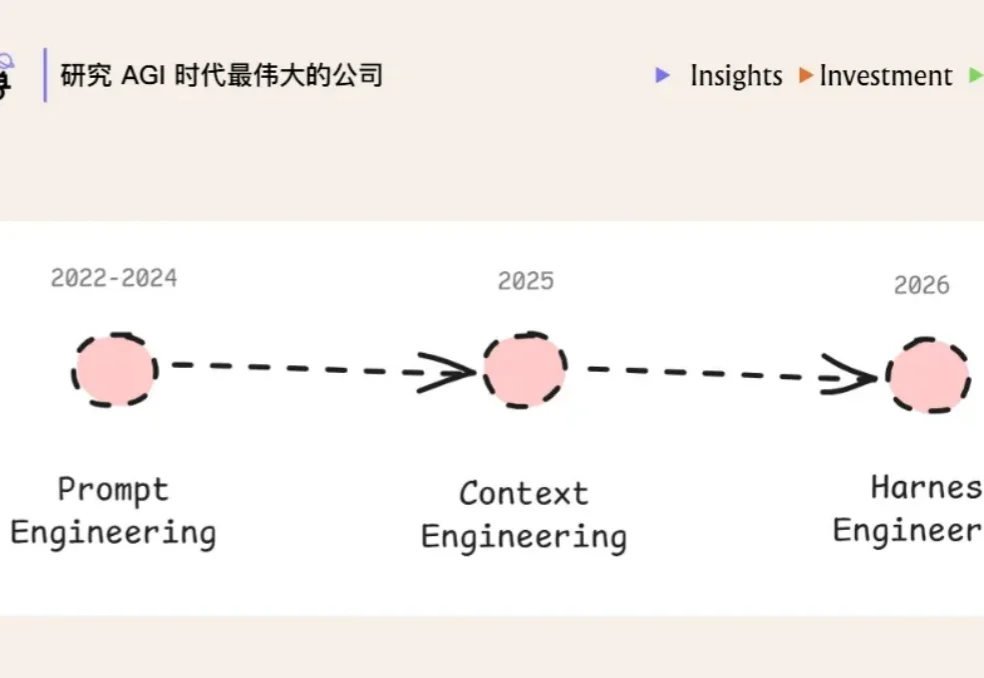

最近,harness engineering 又成了继 prompt engineering、context engineering 之后新一代的 buzzword。

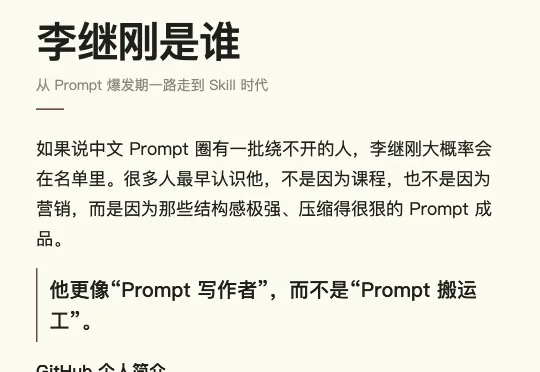

Skills.sh (https://skills.sh/) 上已经有将近9万个skills了,但是,值得使用的skills凤毛麟角!今天给大家推荐prompt大神李继刚的13个skills,绝对值得你拥有!要看懂 ljg-skills,最好先看懂作者。

昨晚(3月16日),朋友圈里有不少人在转飞书玩虾大会的加更直播链接。说是李诞和呼兰还有小声比比在现场实操演示,怎么玩最近科技圈炙手可热的小龙虾(OpenClaw)。 坦白说,作为一个在AI行业两年多、自己折腾过本地服务器部署、写过无数复杂Prompt的从业者和观察者,我一开始点进直播间的心态,是带着一点傲慢和不屑的。

昨日,OpenAI 宣布收购了 Promptfoo 以保障其 AI 智能体的安全。这家成立于 2024 年的 AI 安全初创公司,专注于保护大语言模型免受网络攻击。OpenAI 在一篇博客文章中表示,交易完成后,Promptfoo 的技术将整合进 OpenAI Frontier,该平台是其近期推出的、供企业构建和管理 AI 智能体的平台。

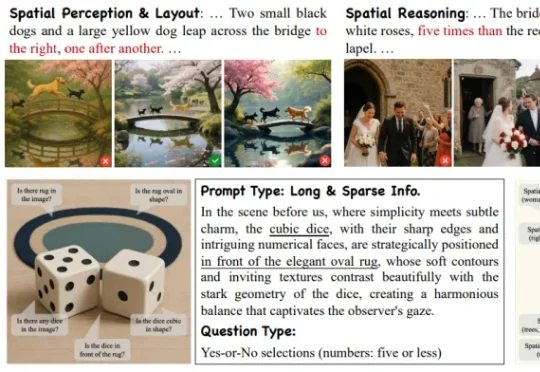

来自阿里高德的一篇最新 ICLR 2026 中稿论文《Everything in Its Place: Benchmarking Spatial Intelligence of Text-to-Image Models》提出了面向文生图空间智能的系统性评估基准 SpatialGenEval,旨在通过长文本、高信息密度的 T2I prompt 设计,以及围绕空间感知

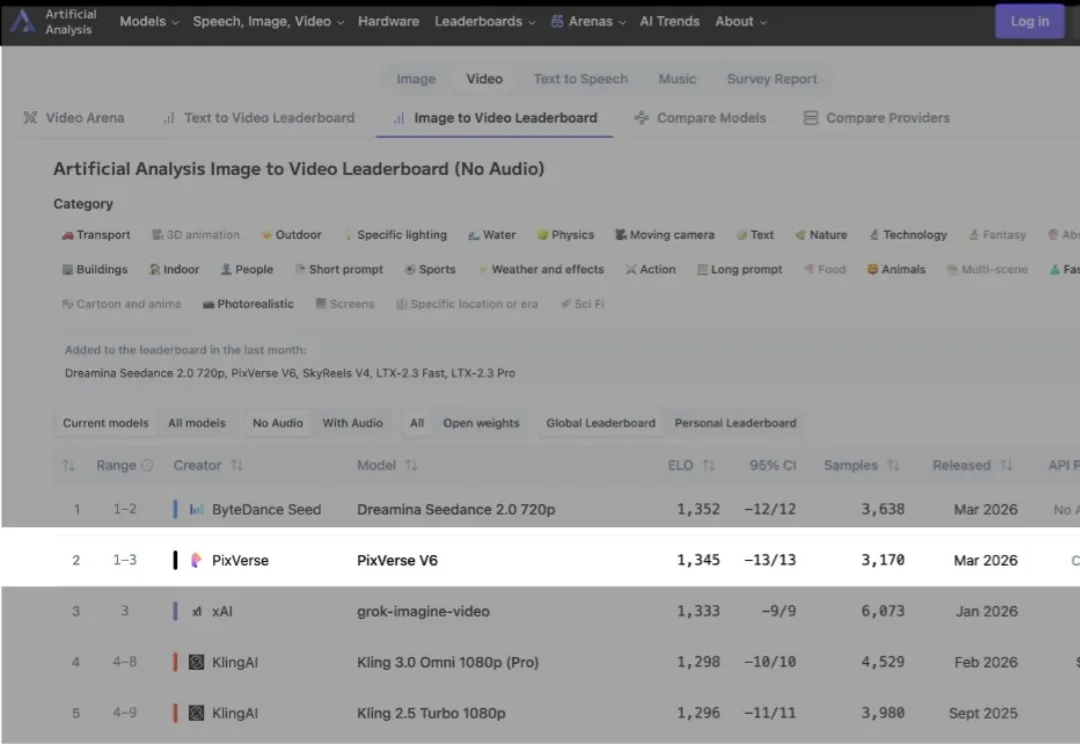

Seedance 2.0用了两天,个人感想是,以下几类人群或即将失业:一、把「学好提示词」奉为圭臬,并开班传授佶屈聱牙反逻辑长难句prompt的AI导师。二、成本只有一个自拍杆的所谓短视频博主。三、刚开始做AI社交的小创业者。

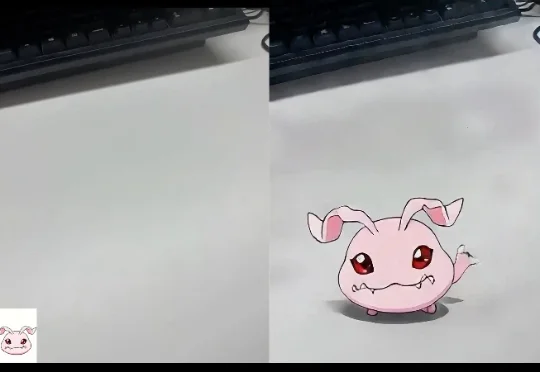

初创公司 Xmax AI 推出的首个虚实融合的实时交互视频模型 X1,没有复杂的 Prompt,不需要漫长的渲染等待,只需要手势进行交互,就可以让虚拟世界与现实相连,在镜头中令「幻想」成真,让用户体验到实时交互的心流体验。