“后来,人工智能(AI)变得无处不在。如今我们‘勉强’接受NeuroAI这个称呼,只为大众能理解其含义。”

当下学术界正面临一个尴尬现实:“AI”似乎已经成为一个无法回避的标签,不管你愿意与否。在神经科学领域,这种现象尤为明显。

美国国立卫生研究院(NIH)的格蕾丝·黄(Grace Hwang)和乔·莫纳科(Joe Monaco)组织的“2024 BRAIN NeuroAI Workshop”研讨会上,试图厘清这些问题的关键:

▪ 在这个AI无处不在的时代,我们究竟需要怎样的神经科学研究?

▪ 当我们试图创造出超越人类智能的机器时,是否真正理解了自身智能的本质?

▪作为神经科学与人工智能的交汇点,“NeuroAI”能否为我们揭开智能的终极奥秘?

▪ 我们是否过于沉迷于“大脑即计算机”的隐喻,而忽视了生物智能的独特性?

近期,保罗·米德尔布鲁克斯(Paul Middlebrooks)邀请这对学术伉俪分享了这场研讨会上涌现的关于NeuroAI未来的深度思考。

目录:

01 与NeuroAI有关的学术重逢

02 命名“争议”:NeuroAI被滥用了吗?

03 “小众”的神经形态学:从硬件到理念的类脑探索

04 BRAIN NeuroAI研讨会:挑战传统语境

05 感知控制理论:还原论思维为何行不通?

06 数字孪生以及错误的“二进制”认知

07 振荡、行波与时空组织:大脑的动态协调机制

08 谜底揭晓:基础计算单元与基础层

保罗·米德尔布鲁克斯:2024年12月4日,两位共同组织了“2024BRAIN NeuroAI Workshop”研讨会,探讨了NeuroAI如何整合到BRAIN计划中并帮助理解和治愈人类脑疾病。请问是什么契机促使两位聚集一起开展NeuroAI这项研究的?

乔·莫纳科:我们们最初相识于2004年的布兰迪斯大学(Brandeis University),当时我们都在上拉里·阿博特(Larry Abbott)教授的计算理论神经科学课程。我们两人中,我才是从一开始就是神经科学家的那个。我从事计算神经科学和理论研究,博士期间研究网格细胞(grid cells)和位置细胞(place cells),建模它们如何通过“重映射”(remapping)产生关联——这是海马体研究中至关重要的计算转换机制。后来在约翰霍普金斯大学的吉姆·尼里姆(Jim Knierim)实验室博士后工作期间,我开始关注自由活动大鼠在环形轨道上重复顺时针导航时的复杂行为。

通过精确追踪大鼠头部和身体的位置,我们可以观察位置场(place field)活动随时间的形成过程。这就是我开始深入研究复杂神经行为分析的基础,并从有机体的角度思考其中实际发生了什么。我们是否真的拥有所有这些内部计算表征?这些表征是如何转化为小动物每时每刻的行为?由此我开始探索复杂的时间动力学与行为的关系。

格蕾丝·黄:我在取得博士学位后,先去了MITRE公司,后又长期为政府工作。直到2015年,我才回到“学术界”,加入了约翰·霍普金斯大学应用物理实验室,担任项目主管,负责运行应用神经科学项目,这是我自2005年以来第一次重新关注神经科学。2017年美国神经科学学会(SfN)的海报环节,让我深入了解了Joe的相位细胞(phaser cells)研究。我对相位细胞产生兴趣,因为与海马体中的位置细胞不同,位置细胞与穿越位置场的相位是不对称映射的。

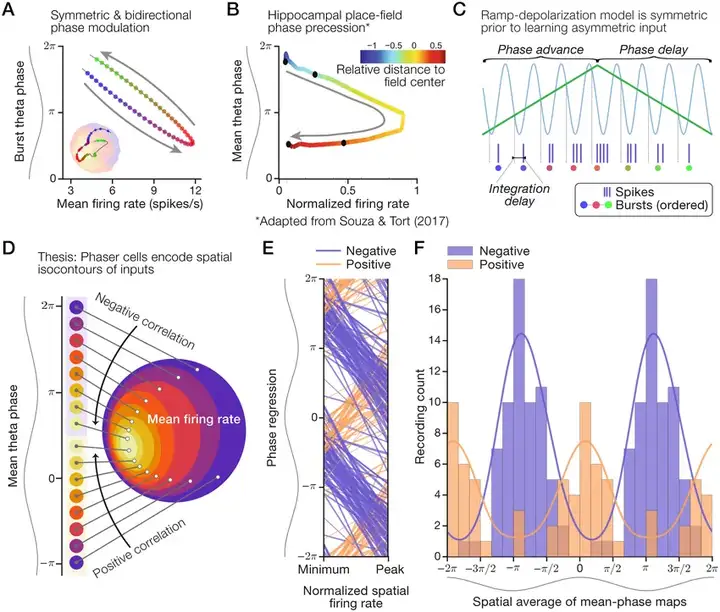

▷相位细胞编码的机制及其时间组织. 图源:Monaco, Joseph & De Guzman, Rose & Blair, Hugh & Zhang, Kechen. (2019). Spatial synchronization codes from coupled rate-phase neurons. PLOS Computational Biology. 15. e1006741. 10.1371/journal.pcbi.1006741.

乔·莫纳科:传统海马位置细胞的相位前移(phase precession)现象中,随着动物穿越位置场,神经元放电会在θ节律周期中逐渐提前。但我们在外侧隔膜(lateral septum)发现了新型相位细胞——它们的相位编码不依赖运动轨迹,而是直接对应空间位置。这种编码可能为机器人多智能体协同提供新思路。

格蕾丝·黄:当时我在智能系统中心的综合物理实验室工作,与很多机器人专家共事。这一研究立刻让我想到:若能用这种相位编码实现自主定位与建图该多酷!巧合的是,当天另一篇关于“群体振荡器”(Swarmulators)的论文发布,展示了如何通过内部相位变量控制同步(sync)和集群(swarm)。这两项发现让我意识到:乔的相位细胞或许可用于控制多智能体机器人。就这样,2017年我们重新开始合作。后来AI变得无处不在。如今我们“勉强”接受NeuroAI这个称呼,只是因为大众能理解其含义。

格蕾丝·黄:有人认为,NeuroAI是用AI研究神经科学,也有人认为是用神经科学原理改进AI(包括硬件、软件或两者结合)。但我们刻意保持开放定义。在研讨会上,我们明确表示更关注NeuroAI的双向融合性,而非将AI用于任何科学方法的前馈。

乔·莫纳科:我不觉得是“勉强”,反而认为这正是机遇所在。需要澄清的是,在本次访谈中,我们必须将BRAIN计划官方发言立场与个人科学观点区分开。从BRAIN计划视角看,这里存在大量有趣机会。Brad综述论文中的图表中梳理了四五个AI通过数据学习演化的主要路径。核心问题是:这些路径如何交汇?更接近大脑形态的数据学习计算将是什么样?

回顾历史,自50年代符号主义AI(Newell和Simon从认知科学出发)到80年代联结主义兴起(伴随神经网络和反向传播),再到近10-15年硬件算力突破催生现代AI技术,神经科学的启发始终贯穿其中。当前正是融合的黄金时期。与其纠结定义(毕竟认知科学、神经科学和AI专家最擅长术语之争),不如聚焦实质——如果真想深入,我们甚至能把意识研究者也拉进来辩论。

保罗·米德尔布鲁克斯:我注意到,你提到的这些都是意识研究者,但把哲学家们排除在外,是因为他们最擅长争论语义,是吗?

乔·莫纳科:是的,我们需要有人关注这个问题。我认为在这个早期且充满机遇的融合阶段——尽管不同领域的研究已积累数十年,但它们似乎都遇到了相似的瓶颈。认知科学未能实现20世纪60-70年代米勒(Miller)预想的宏大研究纲领;神经科学则困在吸引子动力学和群体几何学的框架里,纠结如何整合海量数据。或许通过跨领域合作,我们能一举突破这些难题。

格蕾丝·黄:我想为自己只能勉强接受“AI”这个词的个人立场辩护一下,因为这已经是第二次我被迫把“NeuroAI”这个词用在我参与的项目或概念中了。我曾主导一个名为“面向高能效电路与AI的脑启发动力学”的前沿研究项目。最初,这个项目的名称中并没有“AI”这个词。但我的前NSF(美国国家科学基金会)领导说“AI”一词必须出现在标题中,只是因为它当时非常热门。这就是我的出发点,Joe,我们不得不使用“AI”这个词,因为这个词现在很流行。

乔·莫纳科:这是一个新术语,我认为它还没有被很好地定义。这就是开研讨会的目的。让我们把这些人聚集在一起。过去一年,格蕾丝和我参加了大量NeuroAI会议,我们看到许多主题正在浮现。BRAIN计划希望探索自身在其中的潜在角色——如何在其使命框架内推动这一领域?我们通过研讨会广泛征集社区意见,而社区也积极反馈了值得深挖的机会。

格蕾丝·黄:从NSF转到NIH后,我震惊地发现NIH对神经形态计算的投资极少。如果你在NIH Reporter数据库搜索“neuromorphic”(神经形态学),会发现自80年代末有记录以来,只能找到约60个项目,总投资不到2000万美元。

一方面,它发展速度受限,但我认为另一方面原因是神经形态学工程师、神经技术以及生物医学工程师的圈子是割裂的。他们会去参加不同领域的会议,彼此之间并没有真正的交流。对我来说,将神经形态学和神经科学联系起来是非常重要的,这样我们才能更好地利用神经形态学来促进大脑健康。

保罗·米德尔布鲁克斯:说来有趣,我和其他学者讨论这次研讨会时提到,我惊讶于神经形态学(neuromorphic)内容占比如此之大。结果对方(一位神经科学家)反问道:"神经形态学是什么?"我当场愣住。

乔·莫纳科:确实,这个概念并不广为人知。夸贝纳·博阿亨(Kwabena Boahen)是神经形态学计算领域的领导者之一,他提出了一种具有突破性的可扩展计算范式。要实现真正的可扩展性,必须借鉴大脑结构——比如存算一体的设计。传统CPU/GPU基于冯·诺依曼架构(计算与存储分离),受制于物理极限;而大脑本身就是存算融合的系统,神经形态技术试图突破传统硬件的扩展瓶颈。

用费曼的名言来说:“凡是我所不能创造的,我就还不理解。”神经形态工程师们正是从突触到细胞层面,试图在芯片上重构生物神经系统的特性。

格蕾丝·黄:神经形态技术的起源可追溯至卡弗·米德(Carver Mead)学派。早期的神经形态工程师试图在芯片上模拟离子通道特性,生成与猫锥体细胞测量结果相当的脉冲信号。Nisha Mohawad在1991年写的论文首次普及了神经形态学,也就是拉尔夫所说的“传统神经形态技术”。此后,这一领域经历了多样化发展,导致其定义变得模糊。不同群体对“神经形态”的理解各异:有人视其为硬件(如类脑芯片),有人则认为是设计原则(如卡伊提到的“让设备信号统计特性匹配大脑”)。

它甚至可以是指导性原则。神经形态社区内部也存在分歧:一部分人认为神经形态必须依赖专用硬件,另一部分人则强调其设计理念。但对我而言,神经形态技术的核心是类脑特性——通常基于脉冲通信、能效极高、且能自适应使用者需求。研讨会上还讨论了一个有趣观点:自适应系统因无需外部计算机控制,其片上自主性使其更难被黑客攻击。

乔·莫纳科:我认为需要明确的是,并非所有的神经形态学硬件都是能够自我学习的。许多开发的测试平台——例如英特尔有一个名为Loihi的项目虽能运行大规模脉冲神经元网络,但难以实现STDP(脉冲时序依赖可塑性)等学习规则。其他芯片设计则更易适配不同学习机制——这正是领域内待解的难题:如何安全地实现自适应?

格蕾丝·黄:关键点在于:有些芯片是为了推理而设计的,还有些则是为了学习而设计的。

保罗·米德尔布鲁克斯:听起来整个研讨会都聚焦于神经形态学?但事实并非如此,这只是进入更广泛讨论的一个切入点。我完全理解为什么神经形态学会成为一个重点。然而问题是,正如Joe先前所说的,“理论整合”进展如何?让不同领域学者共处一室碰撞思想,是否真能推动问题解决?

乔·莫纳科:这个挑战一直存在。正如格蕾丝先前所说,这些领域之间并没有足够的交流。我们有意将这些不同的社区聚集在一起,开始展开对话。即使在神经形态学工程领域内也存在分歧。

有一些人希望使用大规模神经形态学计算系统来运行大脑的大型模型。他们需要大规模的大脑数据来构建这些类型的模型,如连接组和细胞类型等。这些数据可以作为测试评估系统、建模和模拟系统,以确认或证伪关于这些网络某些方面的理论。

小规模应用方面,能源效率高的模拟或混合信号设备,可以被分发到边缘,用于在更广泛的应用场景中进行类脑、类神经元的智能计算。

扩展这些模型要困难得多,也更具特殊性。我认为目前有机会打破计算神经科学和理论驱动建模中的一些规模障碍,并将其扩展到我们真正关心的脑内活动,使其可以原则性方式被研究。

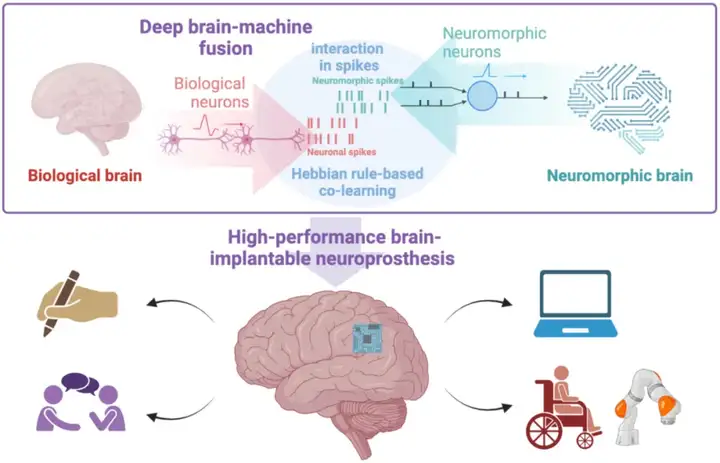

▷神经形态计算促进深度脑机融合. Qi Y, Chen J and Wang Y (2023) Neuromorphic computing facilitates deep brain-machine fusion for high-performance neuroprosthesis. Front. Neurosci. 17:1153985. doi: 10.3389/fnins.2023.1153985

保罗·米德尔布鲁克斯:在“BRAIN计划”开展10年之际,举办一场研讨会的目的之一,就是要弄清楚未来的路线图应该走向何方,或者哪些途径值得探索的并应该向前推进。这样总结正确吗?

乔·莫纳科:更准确地说,我们不用“应该”(should)这个词,而是希望社区共同提出“应该”(shoulds)。研讨会汇集了神经形态技术、度量标准制定者、自然智能研究者——我们需要厘清:这些拼图如何组合?哪些部分能与BRAIN计划的使命契合?

保罗·米德尔布鲁克斯:当我想到NeuroAI,通常会联想到用AI模型(如卷积神经网络CNN)模拟脑功能,再验证其是否产生类脑表征——比如早期用CNN建模视觉物体识别的经典研究。但这次研讨会显然涵盖更广,比如安德烈亚斯·图利乌斯(Andreas Tullius)的基础模型(foundation models)工作也被纳入。能否谈谈你们还引入了哪些议题?

乔·莫纳科:我们对这个领域的初步思考,源于2020年我们组织的大脑研究者会议研讨会,那场研讨会的主题是“动态系统神经科学与机器学习”。虽然当时的讨论主要集中在这两个领域的交叉上,但现在回看,那其实是NeuroAI的雏形。通过深入的交流和思考,我们逐渐意识到,许多现有问题的根源,似乎都来自于对纯计算视角的过度依赖。

传统研究被“大脑即计算机”的隐喻框住了手脚。这种认知渗透在认知科学、AI和神经科学中——神经科学家总在谈论神经编码、解码和表征,仿佛只要在实验中找到某个脑区活动与行为的相关性(比如“动物看到提示后左转时某神经元放电”),像是发现了计算式表征方法,就是解释。

如此就算破解了认知机制,“到此为止”。但问题是,这种“到此为止”的想法恰恰成为了一个障碍,因为实际上研究并未结束,我们还需要将行为纳入这个循环中。行为是大脑与身体、身体与环境之间持续不断的动态耦合过程。这就是为什么我们想要扩展研究视野,引入具身认知(embodied cognition)和40Hz振荡研究的视角。我们的目的不是要完全认同这些理论,而是要指出:环境中存在着大规模的分布式反馈循环,这些循环是动物认知过程中的关键组成部分。这就是我们研究的方向。

格蕾丝·黄:第一天计划全部讨论计算智能,而第二天更多的是具身神经形态转换。

乔·莫纳科:但第一天就有多少人多次强调思考具身性的重要性。这并非完全出乎意料。

比如,在我们论文发表的同一期杂志上还发表了一篇名为《深度智能》的文章,作者是辛辛那提大学的电气工程教授阿里·曼尼(Ali Manai)。我知道他从事计算神经科学已久,对生物学有非常全面的视角。他认为,生物有机体本质上是一个统一的整体:在系统层面通过进化实现整合,在个体层面通过发展达到整合,并且不断通过学习、衰老和经验来强化这种整合。这个观点值得我们反复回味。这也是他在受邀演讲时比较自然智能与人工智能时的核心论点。虽然这两种智能之间存在诸多差异,但我认为这种整合性是最关键的区别之一。

保罗·米德尔布鲁克斯:我突然想到,“整体神经科学”(holistic neuroscience)会是个好术语,可惜容易让人联想到玄乎的“整体医学”。有人可能会看到这个词并认为它是“伪科学”。

▷Dickson BA. Holistic Neurology, Our Two Nervous Systems: Physiology of our head and gut brains. New Directions in Holistic Brain Balance series. HolisticBrainBalance.wordpress.com. Accessed February 24, 2025. ISBN: 9781530392056.

乔·莫纳科:我认为如果忽略了大脑中的内部计算表征,那就是“伪科学”。正因如此,我们两天的议程涵盖了主流NeuroAI研究,比如将任务约束的AI模型映射到腹侧视觉通路,也延伸至背侧运动通路等其他脑区,即“认知地图”。

认知地图可能是大脑中实际的高级认知编码的最清晰的例子,至少这是我作为一个海马体研究者的个人看法。认知地图涉及降维技术与任务驱动的低维流形分析。如今我们记录数十万神经元活动,若仅用UMAP(一种非线性降维算法)可视化,得到的彩色斑点虽美却无解释力。

当这与整体性、可解释性(interpretability)和机制联系起来讨论时,我们如何识别和理解驱动高维神经活动的关键因素?

格蕾丝·黄:回顾这两天的研讨会,我觉得关于神经伦理的讨论也非常重要,因为NeuroAI将带来许多新的挑战。其实说实话,我认为在一个小时的会议中,根本无法充分讨论NeuroAI伦理问题。应该有更多的关于伦理和监管问题的讨论。

保罗·米德尔布鲁克斯:你们的立场论文,也就是《智能系统信息边界的神经动力学计算》*,大量论证了具身性与环境-身体-脑循环互动的重要性。论文的核心,正是通过历史视角与AI现状的对比,提出所谓的“计算基础层”(a base layer of computation)概念。

Monaco, Joseph D., and Grace M. Hwang. "Neurodynamical computing at the information boundaries of intelligent systems." Cognitive Computation 16.5 (2024): 1-13.

扎克·皮特科(Zach Pitko)曾提出要记录每个突触的连接强度这个终极目标。这个想法体现了典型的还原论思维,与你们文章中提倡的整体性研究方法形成了对比。我觉得问题在于:现在的研究仍然过于依赖还原论思维,即认为只要测量得够细致就能理解整体。但是现代动力系统理论告诉我们,研究大规模神经元群体的整体特性和低维结构可能更有意义。我们需要更多讨论:到底应该在什么层面进行研究?为什么选择这个层面?这些理论层面的问题值得更深入的探讨。

乔·莫纳科:这更像是一个评论,我完全同意。这其实触及我们写论文的初衷——对当前领域的普遍挫败感。我们深入挖掘心智哲学与计算哲学,追问:大脑中的计算究竟是什么?信息对大脑意味着什么?当前认知科学、神经科学与AI共享香农信息论框架(发送者-接收者-共享编码),但这可能不适用于大脑——毕竟神经系统的语义建构是动态的、自指的、与环境共生的。

这让我想起了托尼·扎多尔(Tony Zador)演讲中提到的“硬件彩票”的概念。从某种意义上说,香农的信息理论是一种“理论彩票”。它为每个人提供了一个现成可用的工具,比如,“一个重要的概念如何量化?”于是学界开始用统计分布和均值计算信息量,但这只是纯粹的句法操作。正如香农所说:“这与语义无关。”

我们试图突破这种框架,因为生物体处理的信息类型在跨越有机体边界时会发生本质转换。生物认知系统的独特之处在于:它们构建了信息边界——不仅是皮肤这样的物理边界,更是通过外感受器(如视觉、听觉)与内驱力(如饥饿、好奇)的交互形成的动态界面。生物体持续与环境对话:我们依赖环境获取能量,所以觅食成为根本需求。动物通过移动寻找食物与庇护所,这种能力定义了它们的生存策略,而珊瑚或海鞘等固着生物只能被动滤食。运动能力是智能演化的关键。正是这种在信息边界上的动态耦合,让目标驱动与感官输入沿着感知层级(自下而上)和行为控制层级(自上而下)持续对流。

这类似于卡尔·弗里斯顿(Karl Friston)的预测处理框架——大脑作为内源性预测模型,通过自上而下的预期抵消自下而上的预测误差,以自由能最小化为原则调节平衡。但这类统一理论在神经科学预测中面临挑战。如何设计实验验证其特异性?比如,某个功能在预测处理框架下的运作方式,能否与其他理论区分?

抛开术语之争,我认为,本质上生物体通过管理界面的熵来构建意义——无论是预测误差还是其他量度,核心在于对抗热力学失衡,这就是生命的游戏规则。

保罗·米德尔布鲁克斯:这是否与控制理论(control theory)的视角相关?我想说的是,将意义重新注入神经科学并非默认路径。长期以来,神经科学的默认立场是还原论的“大脑即计算机”范式——从感觉输入回溯机制,可以忽视目标、意义与目的。尽管论文和其他研究指出,早期的控制论运动更关注控制过程。所以我想问:这是否就是控制理论的切入点?

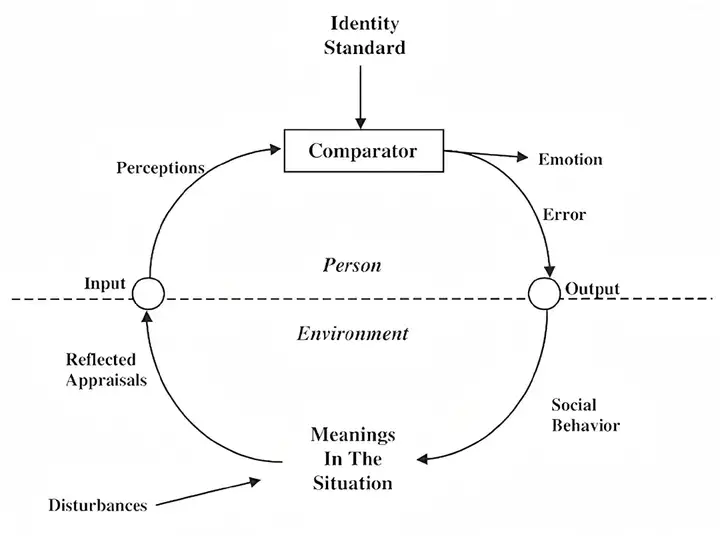

乔·莫纳科:最契合的框架是感知控制理论(Perceptual Control Theory, PCT)。这是20世纪50-60年代控制论的一个分支,由比尔·鲍尔斯(Bill Powers)在60-70年代发展起来。

保罗·米德尔布鲁克斯:Henry Yin曾说早期控制论研究的根本问题,实际上是,机器的参考信号是外部设定的,而生物体的参考信号却是内在生成的。这正是神经科学长期忽视的关键差异,而你们的论文也深入探讨了这一点。

乔·莫纳科:对。Henry的书中部分章节传递了这种观点,这些内容在某种程度上是有争议的(bomb-throwing)。我觉得,这种强烈的观点会激发思考:“这很有趣,但哪里可能出错?”我不是运动系统方面的专家,但我熟悉90年代至00年代的最优反馈控制理论(optimal feedback control),它基于前馈模型(forward models)的传统框架,通过预测动作后果来评估运动指令,再嵌套在复杂控制回路中。

而感知控制理论(PCT)的魅力在于颠覆了这一逻辑:它强调层级化控制中每一级的实时感知比较。比如最高层的感知目标会生成参考信号,与自下而上的感官输入逐级比对,最终转化为肌肉动作——整个过程是同步的,控制信号的阶段流,感官和控制信号在层次结构中流动。

▷感知控制理论。Anderson, Janice & Wall, Steven. (2015). Peer Interactions Through Social Media and the Development of Science Teaching Identity in Elementary Education Majors. Contemporary Issues in Technology and Science Teacher Education.

保罗·米德尔布鲁克斯:但传统模型假设存在计算延迟——在控制工程中,延迟会削弱系统稳定性。

乔·莫纳科:这种表述本质上延续了线性的“输入-输出”的思维模式。如果将控制过程视为循环,就类似这样:第一步是感知,第二步是认知,第三步是运动指令,第四步是行为。行为改变了个体的姿态与环境的关系,进而改变了感官输入,最终又回到感知环节的开端。

如果控制回路中存在复杂的计算前馈模型,就相当于在控制过程中引入延迟。从控制理论或工程学角度看,延迟越多,控制系统的稳定性越差。然而动物行为的显著特征在于其强大的目标达成能力——即便实际运动轨迹充满变数,它们仍能高效完成目标。比如老鼠能在黑暗的复杂洞穴中凭借极少的感官线索自如导航,这提示我们:或许根本不需要在控制回路中进行如此复杂的计算。

与观察到的行为的变异性相比,实现目标的稳健性远远超过了实际的动作。试想:老鼠如何在无光环境中仅凭零散线索完成复杂路径导航?这是我一直想跟运动系统研究者讨论的问题。在我看来,这是一个开放性问题,涉及用前馈模型(forward model)与逆向模型(inverse model)的对比,以及传统运动控制理论强调的通过预测误差(ascending prediction error comparisons)进行层级调节,而感知控制理论(PCT)则主张基于感知参考信号(perceptual reference point comparisons)的实时比对。这就是我在研讨会上想要展开的一些讨论。

从BRAIN的角度来看,我不会强加我的观点,但我认为这是一个重要的议题,这将为推动理论发展开启很多潜在机会。其中,数据是一个重要组成部分——分子层级的全脑细胞类型图谱、精细的连接组学数据集、刚发布的FlyWire数据集项目,以及去年启动、未来将会看到结果的Brain Connects计划,这些都属于还原论方法的大规模数据积累。

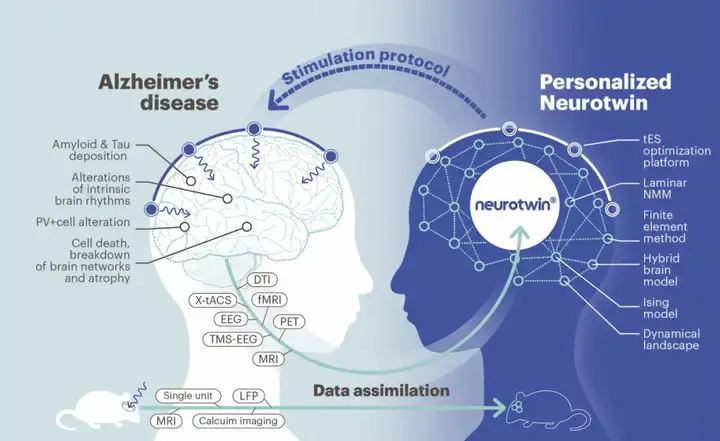

不过,我们同样需要将这些数据与整体性思维相结合。研讨会上关于数字孪生(digital twins)、多尺度生物物理建模的讨论,正是探索如何将分子数据与行为神经科学有机衔接的尝试。

格蕾丝·黄:说到这里,在NeuroAI研讨会上,数字孪生的热议让我颇感意外。

保罗·米德尔布鲁克斯:么是数字孪生?我们为什么需要它?

格蕾丝·黄:实际上,国家科学、工程和医学研究院有一个官方定义:数字孪生是一组虚拟信息结构,它模拟了自然、工程或社会系统或系统之系统的结构、上下文和行为,它通过其物理孪生体的数据动态更新,具有预测能力,并形成实现价值的决策。虚拟和物理之间的双向互动是数字孪生的核心。其实大家用的多是官方定义的子集版本。我原本没想到数字孪生会成为热议焦点。不过看来这可能是NeuroAI领域的新机遇——值得参与者持续探索。

▷数字孪生技术案例 图源:upt.edu

乔·莫纳科:我们在研讨会的第一场会议中听到一些关于神经基础模型和数字孪生之间的讨论,两种方法都是大规模使用神经和行为数据的方式,但目标各不相同。神经基础模型类似人工智能中的基础模型,可泛化至下游任务、特定领域或回答特定问题;而数字孪生,更侧重于通过海量数据精准预测特定个体系统的个性化行为。

保罗·米德尔布鲁克斯:你可以使用数字孪生来测试关于自然系统的假设。

乔·莫纳科:对。数字孪生会随研究对象演化。例如,如果你建立小鼠的数字孪生模型,并在实际实验中观察其行为,就可以在硅基仿生体中并行运行模型,实现细粒度实时预测与调控。帕特里克·门多萨(Patrick Mendoza)的演讲标题“闭环虚拟神经科学”正体现了这一思想——通过硅基仿生体与真实动物的闭环互动,推动实验设计的革新。

保罗·米德尔布鲁克斯:你可以想象用数字孪生追踪生物体一生的变化,包括发育过程——虽然这在人类研究中因纵向数据难以获取而受限,但通过更短周期的实验对象(如小鼠)可以实现快速迭代。比如,对于医生来说,就可以通过虚拟模型加速医疗决策——例如在手术室中实时测试方案并优化操作,而非依赖经验直觉。

回到正题,你之前说“基础层”。根本问题是,为什么要在神经计算中定义“基础层”?

乔·莫纳科:这个概念并非我首创,只是我在论文中将其称为“基础层”。这一思考源于对计算本质的哲学追问——不同类型的计算如何实现?物理系统或动态系统中是否存在计算?例如,由常微分方程(ODEs)构成的系统,通过龙格-库塔算法等数值方法演化,能否进行计算?大脑作为物理的、动态的、化学的物质系统,其计算方式是否与硅基计算机有本质区别?

传统神经科学框架可能将我们引向误区。生物学中细胞固然重要,比如,神经元对大脑至关重要,但神经胶质细胞(如星形胶质细胞、少突胶质细胞、小胶质细胞)在结构可塑性中的作用同样不可忽视。

从更广泛的角度来看,我们习惯了将计算系统视为“必须有晶体管”这类基本单元。硅晶圆通过光刻工艺形成的芯片,本质上是对材料的物理雕刻——这就是数字计算的底层架构。我们目前使用的计算机和手机CPU中的晶体管,正是基于传统CMOS工艺的基础计算单元。但大脑真的与此类似吗?神经元是否等同于晶体管?答案显然是否定的。

保罗·米德尔布鲁克斯:但神经元本质上是二进制事件发生器。麦卡洛克-皮茨模型(McCulloch-Pitts model)的“全或无”(all-or-nothing)特性至今未被推翻,对吗?

乔·莫纳科:不,麦卡洛克-皮茨模型从根本上说是错误的,神经元的峰电位,并非二进制信号,而是一个"全或无"的事件。有人说“峰电位的时序决定信息。只要知道这个峰电位相对于那个峰电位的时间戳是什么,就能告诉我们所有信息了。”这是不对的,因为你并不需要一个绝对的时间戳。关键在于理解单个脉冲在动态网络中的功能角色——它如何触发下游神经元的响应,如何通过递归连接反馈到更高层脑区,最终形成感知或行为的整体图景。一切都是因果关系,是动态的、相互关联的,不能说就是"1或0"。

虽然冯·诺依曼确实受此启发,发明了数字计算技术,但这不是大脑的工作方式,正如沃尔特·弗里曼(Walter Freeman)指出的那样。

格蕾丝·黄:正如伊奥塔(Yiota)的研究所示,所有这些树突状计算都在树突中发生。我们现在意识到的丰富性远超麦卡洛克-皮茨时代想象的复杂计算。

振荡、行波与时空组织:

大脑的动态协调机制

保罗·米德尔布鲁克斯:你刚刚从神经元层面深入到了树突计算的物理层级,并想上升到更高层级,讨论振荡在动态耦合中的作用。我很好奇工程师们如何看待振荡这个问题?

乔·莫纳科:振荡是重复的。你可以有一个不由振荡过程产生的传播的波。

保罗·米德尔布鲁克斯:好,没问题,你可以将它们区分开。这就像你可以说海里的每个浪花是独立存在的。尽管它们在宏观上交织,但你仍可单独分析某一朵浪。

乔·莫纳科:对。空间和时间在大脑中是耦合的。有一个数学形式主义叫做层次理论(hierarchy theory),基本上是说,高频振荡只能在有限空间内维持同步性,而低频振荡能跨越更广区域保持节律协调。

至少在哺乳动物的大脑具有一套非常完善的神经震荡系统,这些振荡存在于大脑的不同部位,在不同时间以不同方式相互作用,它们具有不同的基频,而且这些频率之间的比例关系呈现出非常有趣的不可通约性。大约六个互不干扰或极少干扰的频段,因为这样你就可以同时拥有θ波、γ波,并且一个θ周期可嵌套七个γ周期,形成一个有趣的“协调信息包”。

关键不在于神经元在θ周期内的绝对放电时刻,而在于γ振荡序列如何在θ框架内雕刻神经活动模式。这种时空法则通过跨层级反馈实现:全局振荡调节神经元放电时序,而局部活动又通过突触可塑性重塑振荡节律,形成双向因果机制。

保罗·米德尔布鲁克斯:那么我想问:你们提出的"基础层"究竟是什么?在讨论之前,或许可以先列出你们对基础层作为有效计算层提出的三个要求:

一是它们包含一个宏观尺度的层次控制结构,它实现了比较器误差和输出功能。这是控制理论的一部分。

二是适应性地控制由物理具身和在因果环境中嵌入所产生的内部和外部信息流。这是这些连续流动之间几乎生态心理学的互动。

三是支持离散的神经动力学状态和适应性高维状态转换,跨越神经回路反馈的时间尺度,然后你列出了一些具体的时间尺度。我猜这与振荡为何重要的原因有关,这些嵌套的振荡结构,这些振荡中携带的尖峰信息,以及它们如何在不同的时间尺度和结构和流动中相互作用。

确实非常宏大。读完后不禁让人思考:该从哪里着手?如何启动这样的研究计划?

乔·莫纳科:好吧。需要澄清的是,这篇论文不代表BRAIN计划的官方立场。它源自我几年前对"神经中心主义范式是否错误"的思考——拉法·尤斯特(Rafa Yuste)多年前就提出应转向"网络中心范式"。

约翰·霍普菲尔德(John Hopfield)刚刚获得了诺贝尔奖,说明这个方向正在获得认可。正如我们所看到的,技术决定论在这里起关键作用。我们的工具越来越好用,而BRAIN计划在这方面确实发挥了很大作用,我们能够记录的神经元数量越多,记录的保真度越高,吞吐量越大,我们就能看到的东西就越多。

我们现在可以记录数百万个神经元了。我们仍然需要聚焦低维表示——即从高维神经活动中提取出与任务相关的2-4维吸引子(attractor)的子集。若能将这些维度映射到行为约束,就能解释神经系统的运作逻辑。当然,全脑不可能是单一吸引子,而是由多层级动态系统构成的复杂网络。

▷吸引力子. 图源:Wikipedia

我认为到处都有类似吸引子的动力学,但它们是复杂、异质且模块化的。这些动态受多层级组织机制(如振荡、行波)的瞬时调控,在时空维度上形成准层级化的相干组织结构。

人们会思考自然智能的敏捷性、灵活性。比如,动物是如何在同一时间优化多个目标的?它是通过以恰当方式自适应地激活或关闭不同尺度的子网络来实现的。就像是,我同时想做三件事:我想在一小时内获得食物,又要说完我正在说的这句话,等等。你脑中存在多个目标,如何协调这些目标?。

这正是时空组织发挥作用之处——它可能管理着吸引子或准吸引子构成的异质层级结构。我在论文中将其称为“令牌”(tokens)或“因果令牌”(causal tokens)。我想弄明白,我们是否应将吸引子视为某种复杂的任务流形(manifold)?

然后所有的神经活动都投射到这个流形上。通过这种方式就能解析全局机制。比如在"执行-抑制"(Go/Nogo)决策中,选择向量在流形内旋转,随后行为被触发——这呼应了大卫·塞西罗(Dave Cecillo)2013年的开创性研究。但问题在于如何解释这些现象:选择向量与命令向量有何区别?其他空间维度扮演什么角色?我们该如何理解通信子空间?它们如何为服务目标而自适应地激活或关闭?

我的想法是,因果令牌(causal tokens)本质上是存在于不同尺度的准吸引子。之所以称为"准吸引子",是因为系统不会被困在其中——若陷入无法逃脱的平衡态,认知将停滞。正如我们所知,认知始终处于动态流动中:不断发现小型吸引子,又被扰动推出。可能存在竞争过程,但核心问题是——如果计算确实以这种方式进行,其基础单元究竟是什么?

保罗·米德尔布鲁克斯:最后一个问题,基础计算单元与基础层到底是什么?

乔·莫纳科:我关注的计算基础层是超级神经元群:由多个神经元构成的回路通过突触间的回响活动形成自稳定结构。这种非线性连接能引发自我维持的神经活动。其优势在于可扩展性——你可以在主回路上衍生子回路,通过结构可塑性调整连接方式。例如,某个阈下子回路可能因动物经历而改变连接权重,导致非线性对齐方式变化,最终扩展为更高层级的因果令牌。这种准吸引子通过整合环境新关联获得意义,并由振荡时空结构调控其自我维持活动。

格蕾丝·黄:我想知道这些是否可以通过实验测量。

乔·莫纳科:如果我的假设成立——特定突触的精确权重值其实无关紧要——那将彻底颠覆现有范式。若大脑计算确实依赖自维持神经元簇的扩展与适应,则与人工神经网络模型(如Transformer)的底层逻辑完全相悖。AI模型依赖精确权重参数,而大脑的突触权重时刻处于剧烈波动中。

这正是关键差异:AI模型通过量化压缩权重参数实现功能迁移,而理解大脑无需测量每个突触——它们的权重本就高度动态且不稳定。神经系统的核心在于动态结构的涌现,而非静态参数的精确编码。

保罗·米德尔布鲁克斯:有些人会反对这一点,因为我收到过完全相同的反驳,说突触权重实际上是相当稳定的。我想,除非我们测量每一个突触,否则我们不会知道答案。

乔·莫纳科:如果准吸引子确实通过自维持突触回路存在,这些回路会长期保持强相关性。但关键不在于权重绝对值,而在于非线性对齐方式如何使神经元群以特定模式放电,并与其他因果令牌互动。

格蕾丝·黄:听起来像是动态性才是关键。

乔·莫纳科:动态性会驱动状态切换。

保罗·米德尔布鲁克斯:以一种层次化,还是异层次化的方式?

乔·莫纳科:我认为是异层次化,它涵盖了所有可能性。

编辑这期对话时,我不禁想起了一个有趣的悖论:我们越是试图通过人工智能来理解大脑,就越发现大脑的不可捉摸;我们越是深入研究神经科学,就越感受到意识的神秘。就像用显微镜观察水滴,本以为能看清水的本质,结果发现了更多未知的微观世界。

我们是不是一直在用错误的方式追问正确的问题?当我们执着于将大脑简化为可计算的模型时,是否忽视了一个基本事实:正是那些难以量化的特质——直觉、创造力、情感共鸣——才是使我们成为人的关键?就像一位诗人的灵感不能简化为神经元的放电模式,一个舞者的优雅也不能仅仅用肌肉收缩来解释。

更有趣的是,在探索人工智能的过程中,我们似乎总是在寻找一面镜子,希望通过它更好地认识自己。但这面镜子总是不够完美:它要么过于简化了人类智能的复杂性,要么又过分强调了某些特定的计算能力。这让我想到,也许 NeuroAI的真正价值不在于它能多么准确地模拟人类大脑,而在于它揭示了人类认知的独特性——那些无法被完全数字化的特质。

当我们站在人工智能和神经科学的交叉路口,也许是时候问一个更根本的问题:我们究竟在寻找什么?是对大脑工作机制的完整解释,还是对人类本质的深层理解?或许,答案就藏在这个问题本身里——正是不断追问的过程,才是最珍贵的人类特质。

为了阅读体验,本文对听稿进行了适当地编辑。

原对话指路:

https://www.preposterousuniverse.com/podcast/2024/12/09/298-jeff-lichtman-on-the-wiring-diagram-of-the-brain/

文章来自微信公众号 “ 追问nextquestion “,作者 追问

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】DeepBI是一款AI原生的数据分析平台。DeepBI充分利用大语言模型的能力来探索、查询、可视化和共享来自任何数据源的数据。用户可以使用DeepBI洞察数据并做出数据驱动的决策。

项目地址:https://github.com/DeepInsight-AI/DeepBI?tab=readme-ov-file

本地安装:https://www.deepbi.com/

【开源免费】airda(Air Data Agent)是面向数据分析的AI智能体,能够理解数据开发和数据分析需求、根据用户需要让数据可视化。

项目地址:https://github.com/hitsz-ids/airda

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI