ChatGPT等AI模型爆发式增长引发关键问题:这场AI革命需要消耗多少能源?本文探究数据中心在乡村地区的快速扩张,以弗吉尼亚州为例,揭示研究者如何通过供应链分析和直接测量两种方法估算AI能耗。虽然AI目前仅占全球能源消耗的小部分,但在数据中心集中区域影响显著。技术效率的提升能否跑赢使用量的增长?这场能源与创新的博弈将如何影响我们的未来?

在弗吉尼亚州的库尔佩珀县,空气中弥漫着干草和粪便的气息,这里的牛数量是人类的三分之一。“我们有大片农场,大多数仍然是家族经营,并且有很多森林,”Sarah Parmelee说道,她是该县55,000名居民之一。“这里是迷人的美国小镇风情,”她补充道。

但是这个田园般的世外桃源正经历21世纪的重大转变。过去几年里,该县已经批准了七个大型数据中心项目的建设,这些项目将支持技术公司在生成式人工智能(AI)方面的扩张计划。在这些巨大的建筑内部,成排的计算机服务器将用于训练像ChatGPT这样的对话式AI模型,并向全世界每天约数十亿的请求提供答案。这种建设将会给弗吉尼亚带来长远的影响,每个设施可能会消耗与数万住宅相同的电量,这可能会推高居民的用电成本,并使该地区的电力基础设施使用超出其容量限制。帕梅利和其他社区成员对数据中心的用电需求持谨慎态度,尤其弗吉尼亚已经是全球的数据中心之都。2024年12月发布的一项审查指出,尽管数据中心带来了经济效益,但持续增长可能会在未来十年内使弗吉尼亚的电力需求翻倍。

“电将从哪里来?”帕梅利问道,她正在绘制该州数据中心的增长地图,并为位于弗吉尼亚州沃伦顿的非营利组织皮埃蒙特环境委员会(Piedmont Environmental Council)工作。他们都说,“我们会从其他地区购买电力。”但可能那个区正计划从你这里购买电力。”

类似关于AI和能源的冲突正在全球许多地方上演,这些地方的数据中心都在以创纪录的速度涌现。大型科技公司正大力押注生成式AI,这比旧的AI模型需要更多的能量来运行,因为旧模型只是提取数据中的模式,而不生成新的文本和图像。这使得企业集体花费数百亿美元用于新建数据中心和服务器,以扩大其算力容量。

从全球视角来看,AI对未来电力需求的影响相对较小,但是对数据中心密集的地方的影响较为深远。与其他能源密集型设施相比,如钢铁厂和煤矿,数据中心的空间密集度要高得多。公司倾向将数据中心的建筑建设地彼此靠近,以便共享电网和冷却系统,并高效地传输信息,既包括内部传输,也包括传输到用户。特别地,由于弗吉尼亚州提供税收优惠,越来越多的数据中心公司在此聚集。

图片来源:go.nature.com/439becc

“如果有了一个,很可能就会有更多,”帕梅利说。弗吉尼亚已经拥有340个这样的设施,而帕梅利绘制的地图显示弗吉尼亚还有159个计划中的数据中心或现有中心的扩建项目,据位于加利福尼亚州帕洛阿尔托的研究机构EPRI的一份报告称,这些数据中心占该州电力使用的四分之一以上[2]。在爱尔兰,数据中心消耗的电力超过了全国用电量的20%,其中大部分位于都柏林边缘地区。在美国,至少有五个州的数据中心耗电量已超过10%。

更棘手的情况是,企业对其AI系统电力需求的数据缺乏透明度。“真正的问题是,我们在操作时几乎无法获取详细数据和信息,”独立研究员乔纳森·库米说,他研究计算机能源使用三十多年时间,并在加州伯灵格姆运营一家分析公司。

“我认为这个领域的研究人员都在抓狂,因为我们得不到我们需要的数据,”阿姆斯特丹自由大学研究员、荷兰公司Digiconomist的创始人亚历克斯·德弗里斯说,这家公司研究数字趋势带来的意外后果。“我们只能尽力而为,尝试各种方法来得出一些数字。”

由于缺乏公司的详细数据,研究人员以两种方式探讨了AI的能源需求。2023年,德弗里斯使用了一种供应链(或基于市场的)方法。他查看了NVIDIA服务器的功耗,该服务器在生成式AI市场占据主导地位,并据此推算一年所需的电力。然后,他根据特定任务所需此类服务器总数的估计值乘以这一数字。

德弗里斯用这种方法估计了如果谷歌搜索使用生成式AI所需的能量。两家能源分析公司估计,谷歌搜索使用类似ChatGPT的AI需要40到50万台NVIDIA A100服务器,基于这些服务器的功率需求,这将相当于每年23至29太瓦时 (TWh) 的电力。然后,根据分析师提供的每日高达90亿次搜索的估算(不同来源的估计数字),德弗里斯计算出每次通过AI服务器的请求大约需要7至9瓦时(Wh)的电力。按照谷歌在2009年博客文章中报道的数字,这是普通搜索使用电力的23至30倍(参见 go.nature.com/3d8sd4t)。对此,谷歌方没有回应。

德弗里斯说,这种计算方式感觉像是“抓住救命稻草”(grasping at straws),因为他不得不依靠来自第三方的估算。而他的数字很快过时了,因为现在的AI模型在计算成本仅为2023年模型一小部分的情况下,也可以达到相同的准确度,所以现在用于集成AI的谷歌搜索所需的服务器数量可能更低,正如美国能源分析公司SemiAnalysis(德弗里斯估算的来源数据)在给《自然》杂志的电子邮件中所写道。

即便如此,该公司表示,评估生成式AI能耗的最佳方式仍然是监控服务器发货量及其功率需求,这是许多分析师广泛采用的方法。然而,要分离出仅由生成式AI使用的能量是很困难的,因为数据中心通常也需要执行非AI任务。

另一种评估AI能耗需求的方法是“自下而上”的:研究人员测量一个与AI相关的请求在一个具体数据中心中的电力需求。然而,独立研究人员只能使用开源的AI模型进行测量,这些模型的能耗预计和私有模型(非开源)类似。

这些测试背后的概念是用户提交一个提示,例如生成图像或文本聊天的请求,然后Python软件包CodeCarbon可允许用户电脑访问数据中心,获取模型执行芯片的技术细节。“在运行结束时,它会提供所使用的硬件消耗了多少电力的估计值,”萨莎·卢西奥尼说,他是帮助开发CodeCarbon的AI研究员,并且在纽约市的Hugging Face工作,该公司托管了一个开放源代码平台,用于AI模型和数据集。

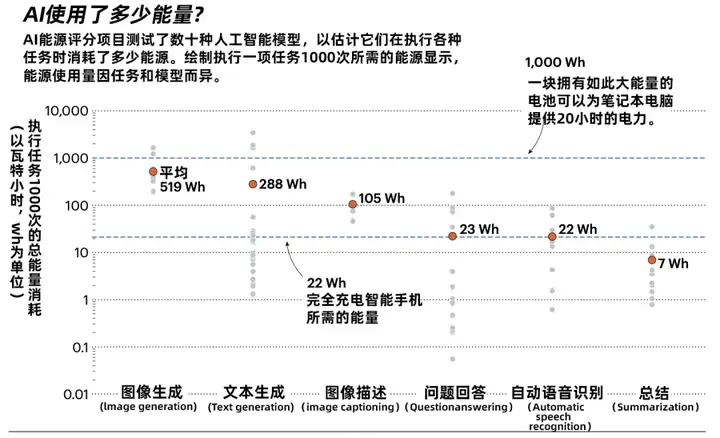

卢西奥尼和其他人发现不同的任务需要不同的能量。根据他们最新的结果,平均而言,根据文本提示生成图像大约消耗0.5 Wh的电力,而生成文本则略少。作为比较,现代智能手机充满电大约需要22 Wh。但存在很大的差异:较大的模型需要更多的能量(参见‘AI使用多少能量?’)。德弗里斯说,这些数字低于他论文中的数字,但这可能是因为卢西奥尼等人测试用的模型至少比支持ChatGPT的模型小一个数量级,以及AI变得越来越高效。

这些数字是一个下限,根据卡内基梅隆大学的计算机科学家艾玛·斯特鲁贝尔(Emma Strubell)的说法,他是卢西奥尼的合作研究者。他们说,“否则,公司会出来纠正我们,但他们并没有。”此外,公司通常不会提供估算数据中心冷却(data-centre cooling)所需电力相关的信息。据法国的数据科学家本诺瓦·科尔蒂(Benoît Courty)所说,CodeCarbon也无法访问某些类型的芯片的能量消耗数据,这包括谷歌的专有TPU芯片,他是CodeCarbon的维护者。

AI在不同任务上的能耗

卢西奥尼还研究了一个模型从大量数据中提取统计模式,也就是训练生成式AI模型需要多少能量。训练像GPT-3这样的模型,即ChatGPT的第一个版本背后的模型,需要的能量约为千兆瓦时。但按照模型每天接收数十亿次请求的计算,那么回答这些查询所消耗的电力,能耗在太瓦时量级,依然主导AI每年的能耗需求。

上个月,卢西奥尼和其他研究人员发起了AI Energy Score项目,这是一个公共倡议,旨在比较不同任务上的AI模型的能效,并给每个模型评级。封闭源代码模型的开发者也可以上传测试结果,然而目前只有美国软件公司Salesforce参与了进来,卢西奥尼说。

随着竞争的加剧,公司对于其最新行业模型的能源需求越来越闭口不谈,‘公司间共享信息的现象有所减少’,斯特鲁贝尔说。如谷歌和微软等公司的报告所称,归因于支持AI的数据中心建设,他们的碳排放量正在增加。(当被《自然》杂志提及缺乏透明度的批评时,包括谷歌、微软和亚马逊在内的公司没有回应;相反,它们强调正在与地方当局合作,确保新建的数据中心不会影响当地的公用设施供应。)

一些政府现在要求公司提高透明度。2023年,欧盟通过了一项能源效率指令,要求能耗500千瓦功率以上的数据中心运营商每年报告其能源消耗。

基于供应链估算方法,分析师表示数据中心目前仅占世界电力需求的一小部分。国际能源署(IEA)估计,在2022年,此类设施使用的电量为240至340太瓦时,或占世界需求的1%到1.3%,如果包括加密货币挖掘和数据传输基础设施,这一比例将升至2% [4]。

AI的爆发将会增加这一比例,但由于许多行业的电气化、电动汽车的增长以及空调需求的增加,预计到2050年全球电力消耗将增长超过80%,因此数据中心“在全球电力需求增长中所占的比例相对较小”,IEA报道[4]。

即使有对AI当前能源需求的估算值,也很难预测未来趋势,库米警告说。“没有人知道即使是几年后,数据中心(无论是AI还是传统型)将使用多少电力”,他说。主要原因是未来所需的服务器和数据中心数量存在问题,在财政的激励下,公用事业公司和技术公司通常夸大数字。并且,许多预测是基于“简单化的假设”,他们将最近的趋势外推到未来十年或十五年。

去年晚些时候,库米与他人合著了一份由美国能源部资助的报告[5],该报告估计美国的数据中心目前使用国家电力的176太瓦时(4.4%),并且到2028年可能会翻倍或三倍,达到总用电量的7%到12%。

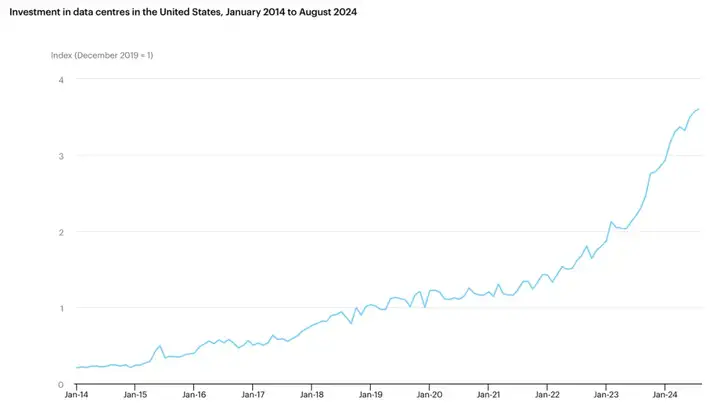

与此同时,SemiAnalysis在其2024年3月的报告中指出(参见 go.nature.com/439becc),到2028年,数据中心将消耗美国15%的电力,到2030年将消耗全球能源生产的4.5%(大约是IEA数据的两倍)。IEA计划下个月更新其数据,但无论其预测如何,显然,AI对能源的影响在地方和区域层面上最为明显。

就在世界各地的研究人员尽力评估AI对能源的影响时,弗吉尼亚州的居民也缺少有关该地区数据中心用电情况的信息。帕梅利通过查阅新闻报道、行业出版物、税务申报和众包提示,追踪了一些数据中心的电力需求,然而,要找到相关的信息非常具有挑战性。

里士满弗吉尼亚州立法审计审查委员会的首席立法政策分析师马克·格里宾(Mark Gribbin)表示,当地电力公司确实知道建造数据中心的公司承诺需要多少电力。作为监督州级项目和机构的政府机构成员,他共同撰写了那份数据中心将在十年内使弗吉尼亚的电力需求翻倍的报告[1]。但是,公司通常不会公开单个数据中心的具体电力需求。

上个月,弗吉尼亚州议员通过了一项数据中心透明度法案,该法案在《自然》杂志付印时正等待州长签署。它不要求公司披露其电力需求,而是呼吁报告对环境的影响,涉及用水、土地使用等方面。

与此同时,弗吉尼亚州的电力基础设施已显示出紧张迹象。位于华盛顿特区以西的威廉王子县的一些批准的数据中心面临长达三年的延迟,因为电力公司无法按承诺的时间向它们供电。

JLARC的报告称,弗吉尼亚州的公用事业公司将“非常困难”地建立足够的基础设施以满足预期的数据中心需求。太阳能设施需要以2024年年度两倍的速度增加,风力发电能力则必须超过迄今为止所有为未来发展预留的海上风电场。

在某些情况下,建造数据中心的公司正试图自己采购电力供应。例如,去年微软达成了一项重启宾夕法尼亚州三里岛核电站反应堆的协议,以帮助为其AI运营供电。虽然其中一些项目使用低碳或可再生能源,但一些公用事业公司和立法者正在推动发展更多的化石燃料电厂,比如燃烧天然气的电厂,然而这将增加碳排放。

建造数据中心的热潮基于更多人想要更频繁地使用AI的预期。但是,“AI使用的速度和方式仍然根本不确定”,IEA分析员在去年的一篇评论文章中写道(参见 go.nature.com/4hu2hos)。人们担心AI表现的不一致性以及版权侵权诉讼;也不清楚将来为生成式AI提供计算能力究竟需要多少资源。

2014年1月至2024年8月美国数据中心投资情况,图片来源:go.nature.com/4hu2hos

中国今年早些时候发布的DeepSeek-R1模型能够以明显的成本优势与美国模型相匹敌。这让一些研究人员认为现在可以创建更好的模型而不必使其变得更“大”,这可能降低数据中心的计算需求。

集智百科团队对DeepSeek-R1模型原理的拆解:DeepSeek-R1|集智百科

相比之下,如果生成式AI变得更加高效,人们很可能会更加频繁地使用它——这就是所谓的杰文斯悖论(Jevons paradox),得名于十九世纪英国经济学家威廉·斯坦利·杰文斯。他观察到煤炭技术效率的提高也加速了开采,从而抵消了节省下的能源。

十年后,按照计划,生成式AI的使用量可能会增长,库尔佩珀县目前提议的所有数据中心都将以满负荷运行;也有可能生成式AI将成为一种相对小众的技术,由于需求不足,一些数据中心将关闭。

“如果做出有把握的预测,但这件事本身又存在巨大的不确定性,有人就会遭受损失”,库米说。

参考文献:

1. Joint Legislative Audit and Review Commission. Data Centers in Virginia 2024. JLARC Report 598 (JLARC, 2024).

2. Electric Power Research Institute. Powering Intelligence: Analyzing Artificial Intelligence and Data Center Energy Consumption (EPRI, 2024).

3. De Vries, A. Joule 7, 2191–2194 (2023).

4. International Energy Agency. World Energy Outlook 2024 (IEA, 2024).

5. Shehabi, A. et al. United States Data Center Energy Usage Report (Lawrence Berkeley National Laboratory, 2024).

文章来自于“集智俱乐部”,作者“ Sophia Chen”。