在机器人领域,扩散策略(Diffusion Policy)已经成为了标准模仿学习策略和 VLA 动作生成范式,但其「从随机噪声中迭代解噪」的机制带来了不容忽视的推理延迟。如果机器人不再从随机高斯噪声开始「盲猜」,是否可以基于「刚刚做了什么」来预测「下一步做什么」呢?

新加坡南洋理工大学 MARS Lab 提出 Action-to-Action (A2A) Flow Matching 新范式:以历史机器人轨迹而非随机噪声作为生成起点,打破了生成速度与精度的双重瓶颈,实现了更高训练效率、极速推理响应及卓越的泛化表现。

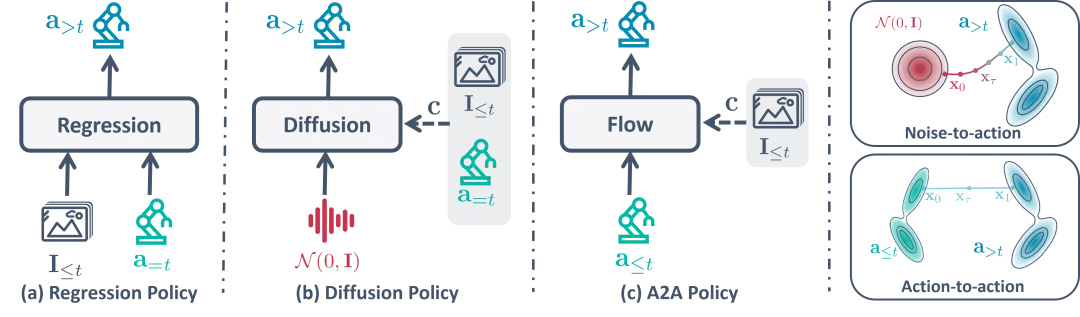

扩散策略已成为机器人多模态动作建模的主流方法,但其依赖从随机噪声中进行多步迭代解噪,推理延迟较高,在实时控制场景中构成关键瓶颈。虽然现有工作尝试优化噪声初始化,但仍未摆脱「从噪声到数据」的长程生成路径。

这种「去噪」思维源自图像生成,但并不完全适用于机器人控制。与缺乏先验的图像合成不同,机器人拥有持续反馈的自身状态信号,具有显著的物理一致性与运动连续性。A2A 的核心洞察在于:既然扩散模型本质是学习分布间的映射,为何不将起点更换为信息密度更高、距离目标分布更近的历史状态先验?

A2A 策略的设计逻辑极具直觉:将动作生成的基准从「随机噪声」切换为「动作历史」。

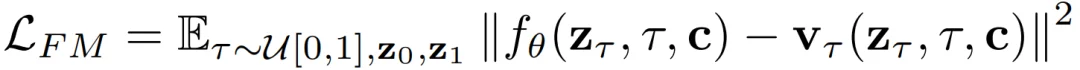

传统扩散策略往往采取 Noise-to-Action 机制,而 A2A 则直接在更具相关性的历史与未来动作分布间建立联系。为了更进一步拉近分布距离,我们在潜空间完成 Flow Matching 学习。具体地,在 Flow 训练目标函数中

与传统 Flow Matching 不同之处在于,我们将初始分布由高斯噪声替换为历史 Action 的编码信号,进而使得流型梯度极易被神经网络捕捉。

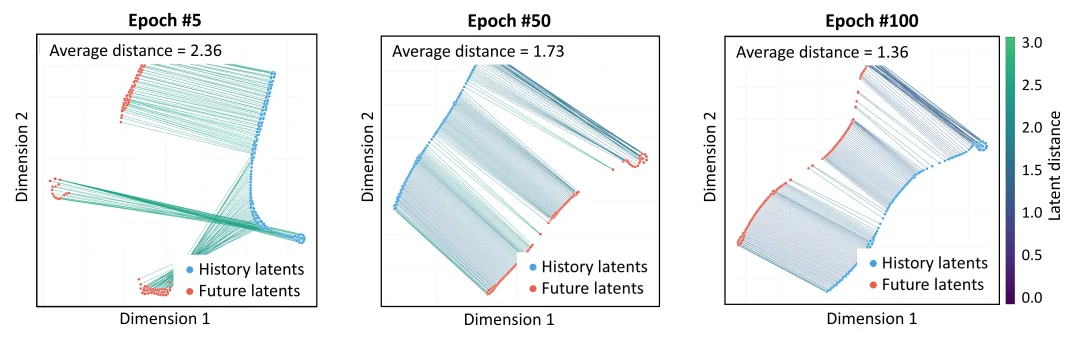

实验证明,这种设计使得起点与终点的物理距离极近且分布高度对齐。得益于极短的传输路径,A2A 仅凭轻量级 MLP 架构与单步 Euler 积分即可快速生成高质量动作。

在多项仿真(ManiSkill, RLBench, LIBERO)与真实 Franka 机器人任务中,A2A 展现出了极佳的训练效率、推理速度、以及泛化能力。

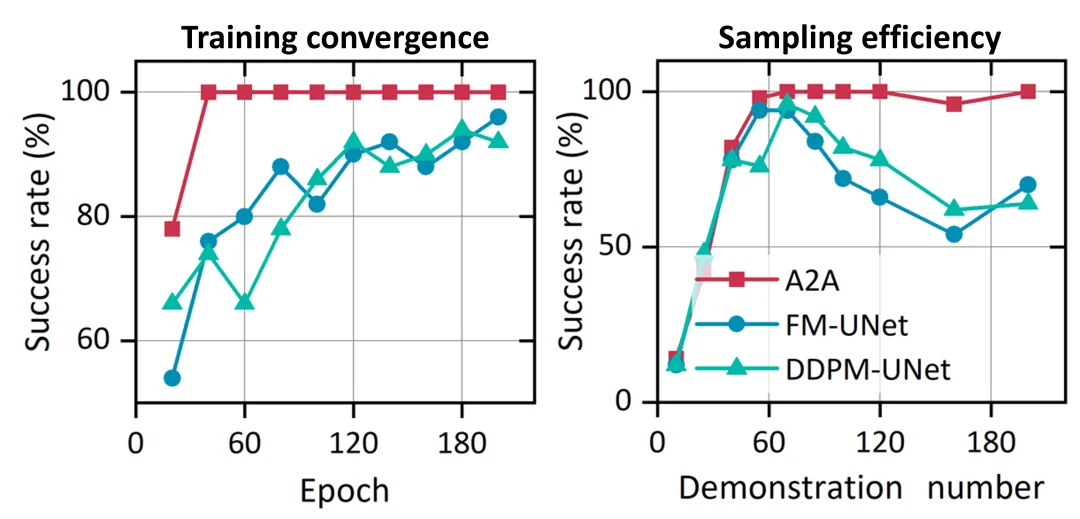

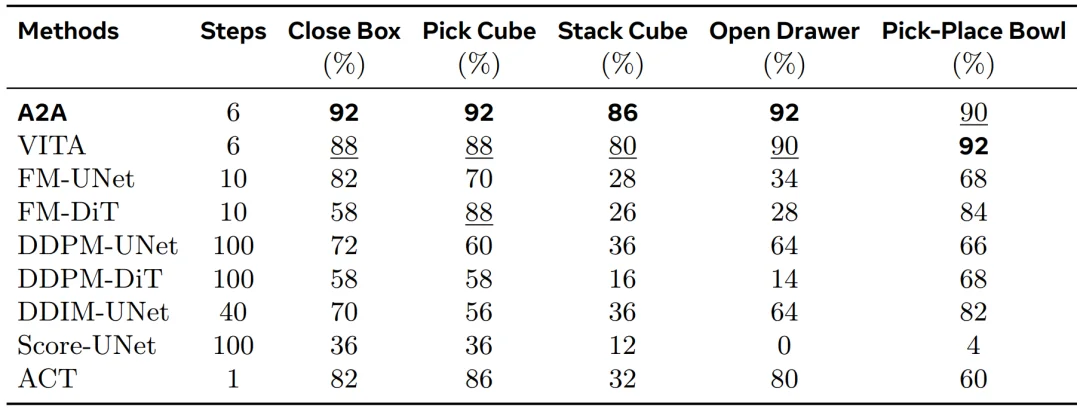

首先训练效率方面,A2A 展现出极快的收敛速度,仅需少量训练轮次即可达到稳定的 100% 成功率。在 5 类仿真任务中,其成功率全面领先于 8 种主流方法,并在有限数据下也能够维持高性能表现。

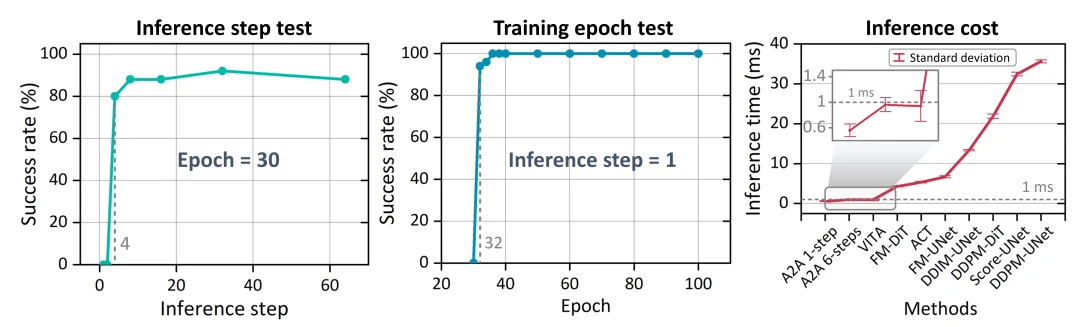

此外,推理速度方面,A2A 实现了亚毫秒级的极致推理速度,平均延迟仅约 1ms,在单步推理模式下延迟更是低至 0.56ms,比传统扩散策略快 20 倍,比常规流匹配方法(10 步)快 5 倍。

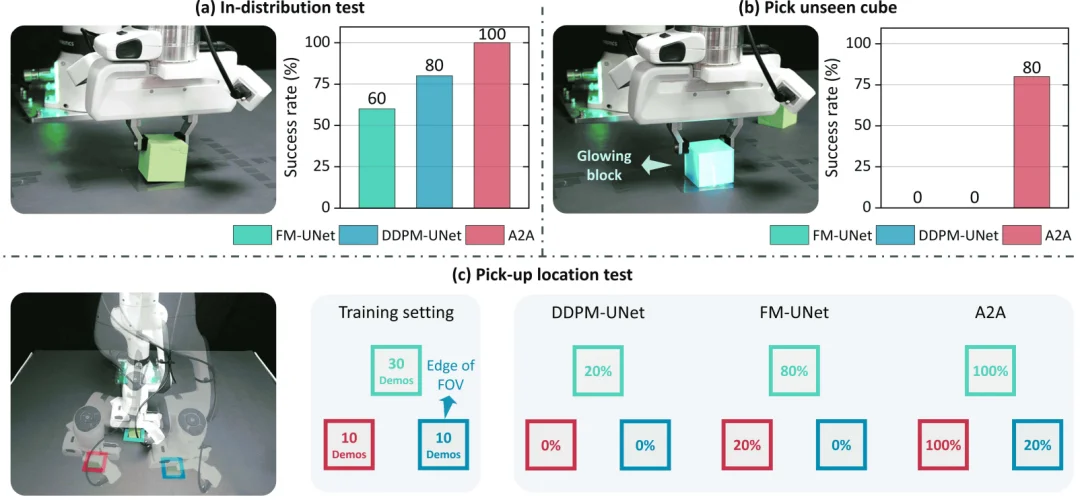

最后,A2A 极大提升了视觉泛化性。例如,实验中将抓取木块换成从未见过的发光方块,传统扩散和流匹配策略均会彻底失效,而 A2A 仍可维持 80% 的高成功率。

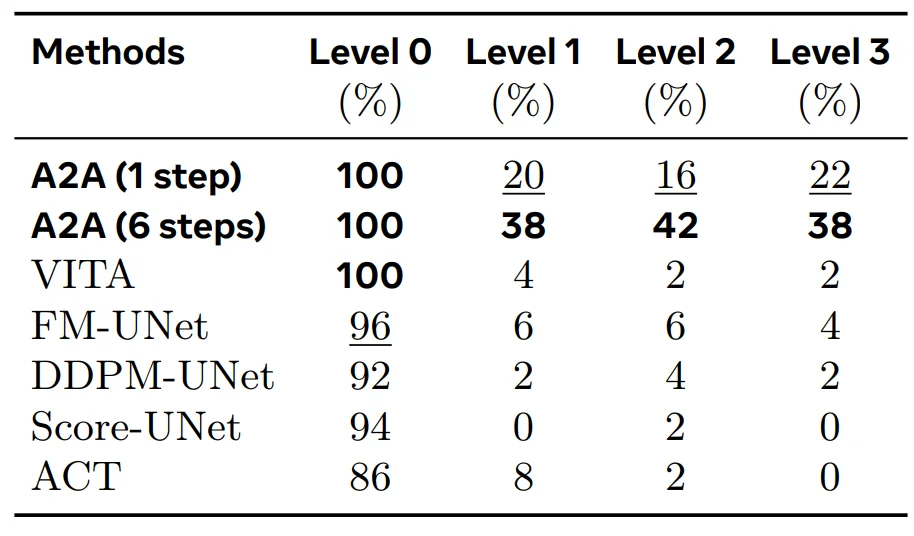

无论是面对场景随机化(Level 1)、灯光扰动(Level 2)还是视角切换(Level 3),A2A 的成功率均领先于现有算法 。这归功于 A2A 的解耦策略,将动作历史作为稳固的先验,减少了对易受干扰视觉特征的依赖。

A2A 目前训练过程涉及多个训练目标,如何进一步简化训练目标值得进一步探索。此外,A2A 的逻辑普适于各类具有时间连续性的任务。研究团队将其扩展至视频生成领域,提出了 F2F(Frames-to-Frames) 范式。通过在潜空间将历史帧映射至未来帧,F2F 生成的图像质量指标(PSNR、SSIM 等)显著优于传统的确定性回归基准,展现了广阔的具身智能应用前景。

贾金豆:新加坡南洋理工大学 MARS Lab 博士后,研究方向包括 VLA、扩散生成模型等。以第一作者在 IJRR、TRO、ICLR oral、RAL、TAES、CEP、ICRA 等期刊会议上发表多篇论文。个人主页:https://jiajindou.github.io/。

李根:新加坡南洋理工大学 MARS Lab 博士后,研究方向包括具身智能、VLA 等。在 NMI、CVPR、ICCV 等顶级期刊与会议发表多篇论文。个人主页:https://reagan1311.github.io/。

杨剑飞:新加坡南洋理工大学机械与宇航学院和电子与电气工程学院双聘助理教授,博士生导师,MARS Lab 主任,主要研究方向为多模态具身智能。曾在加州大学伯克利分校、哈佛大学和东京大学进行学术研究。个人主页:https://marsyang.site/。

文章来自于“机器之心”,作者 “贾金豆 李根 杨剑飞”。