突破视觉仿真算力瓶颈!新一代具身智能仿真框架开源:高吞吐并行高保真渲染助力规模化训练

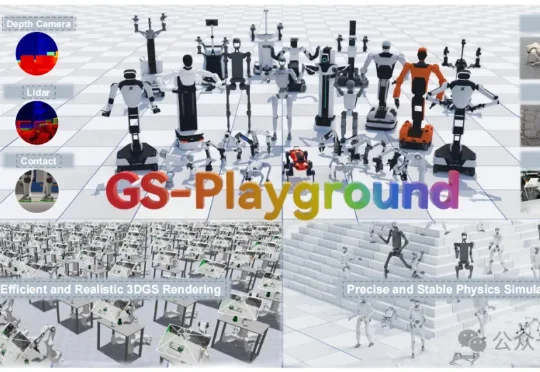

突破视觉仿真算力瓶颈!新一代具身智能仿真框架开源:高吞吐并行高保真渲染助力规模化训练为了攻克这些制约具身智能领域发展的核心难题,清华大学智能产业研究院(AIR)DISCOVER Lab联合谋先飞技术、原力灵机、求之科技和地瓜机器人,提出了GS-Playground通用多模态仿真框架。

搜索

搜索

为了攻克这些制约具身智能领域发展的核心难题,清华大学智能产业研究院(AIR)DISCOVER Lab联合谋先飞技术、原力灵机、求之科技和地瓜机器人,提出了GS-Playground通用多模态仿真框架。

小扎又出手了,这次瞄准的是人形机器人。 Meta正式完成对机器人AI初创公司Assured Robot Intelligence(简称 ARI)的收购。这家公司专注于机器人智能底层技术,由华南农业大学、中山大学校友王晓龙联合创办。

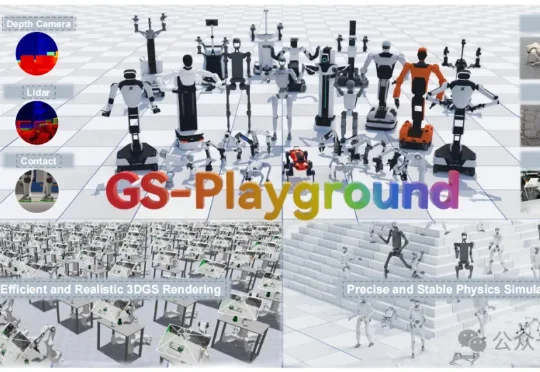

魔法原子在会上推出了新一代人形机器人 MagicBot X1 和灵巧手 MagicHand H01,而且第一次把其世界模型 Magic-Mix、数据生成与训练反馈闭环,作为一套完整的具身智能底层能力集中展示出来。

AI科技评论从多处独家获悉,前蔚来 AI平台负责人白宇利已创立新公司“上海补天石科技”,公司业务聚焦具身数据Infra方向。企查查信息显示,上海补天石科技有限公司于2025年11月成立,法人正是白宇利。

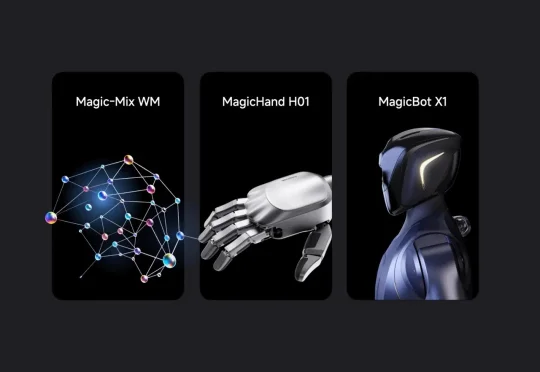

刚刚,宇树发布其迄今定价最低的人形机器人——R1系列双臂人形机器人,支持工业及日常家用多元场景应用,售价2.69万元起。这是宇树首款主打桌面、面向工业场景的低成本轻量化上半身双臂方案。该系列机器人支持5/7自由度单臂、固定/移动底盘,头部模组算力达10TOPS,末端可快速换装,手臂最大负载2kg,腰部±150°、头部±115°/±36°大运动范围。

智元机器人的办公室里,最近员工们一上班就能看到机器人熟练地切着水果:这么全面的能力是如何做到的?答案是直接在真实环境中搞大规模分布式强化学习训练。它们使用的是全新的具身智能训练范式:面向通用机器人策略的分布式多机强化学习(LWD)。这一套技术捅破了当前VLA的「天花板」。

深圳机器人凭什么惊艳全球?答案不在整机,在一颗电机。小象电动用轴向磁通路线突破量产瓶颈,累计出货近7万台,杀入华为、比亚迪、广汽、美团供应链,完成超亿元融资。这是深圳底层硬科技崛起的缩影,也是中国机器人产业链从「能做样机」到「真正量产」的关键一跃。

美西时间4月28日,具身智能行业有史以来,第一场全球性峰会在硅谷落幕!这场大会星光熠熠—— 2015年图灵奖得主、公钥密码学奠基人Martin Hellman做开场主旨演讲,主题是「安全、智能与物理世界的交汇」。

世界模型黑马横空出世!就在刚刚,生数科技的MotuBrain零宣发登顶双榜,直接打通「看懂世界+执行行动」,而且不同的是,他们把World Action Model适配多个头部机器人本体,完成多个长程任务,这是国产AI的硬核突围!从此,具身智能彻底迈入新纪元。

这是一场前所未有的发布会。直播中,超维动力(Kinetix AI)联合创始人 Tyler Zheng 首先亮相,但并没说几句话,就话锋一转:「我们相信如果机器人已经足够拟人,也许它也可以自己来介绍自己。」就把舞台交给了今天的主角 KAI。