超越VLA与世界模型,银河通用发布LDA,全谱系数据跑通Scaling Law

超越VLA与世界模型,银河通用发布LDA,全谱系数据跑通Scaling Law就在这一背景下,银河通用联合清华北大英伟达等众多机构联合发布了跨本体「隐式世界-动作基础模型」LDA-1B,将目光投向了具身智能 Scaling Law 的这个终极命题:如何让模型有效利用互联网规模的异构数据。

搜索

搜索

就在这一背景下,银河通用联合清华北大英伟达等众多机构联合发布了跨本体「隐式世界-动作基础模型」LDA-1B,将目光投向了具身智能 Scaling Law 的这个终极命题:如何让模型有效利用互联网规模的异构数据。

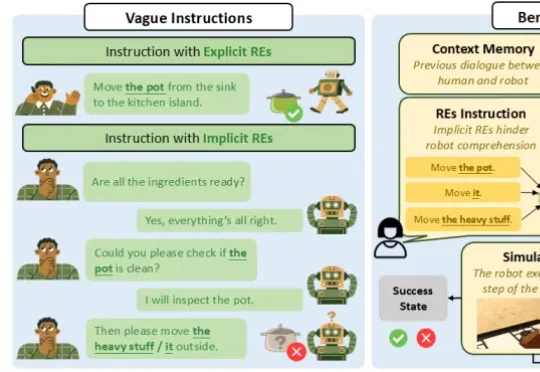

在语言学中,人类之所以能听懂“那个东西”、“它”、“这个重物”,依赖于桥接推理理论 (bridging inference),即通过上下文信息在已有记忆与当前表达之间建立联系,从而恢复指代对象。

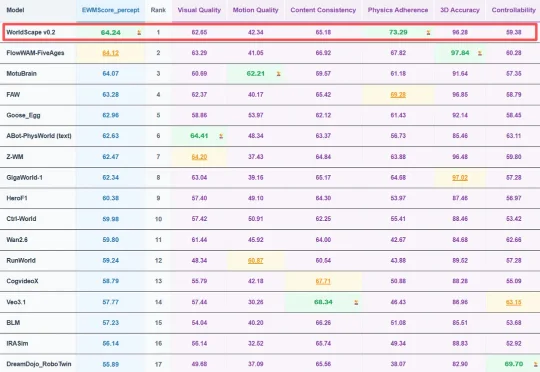

近日,全球具身世界模型权威基准评测 WorldArena 正式更新最新榜单。Manifold AI 流形空间研发的世界模型 WorldScape 0.2,凭借其在物理规律遵循与多源交互理解上的突破取得 WorldArena 榜单全球第一,充分展现了国产世界模型在复杂动态场景生成与具身控制中的高精度、强泛化与物理可信度。与其同场竞技的包括英伟达、谷歌等国外巨头和星动纪元、极佳视界等国内具身智能公司。

AI科技评论独家获悉,通用具身智能机器人公司无界动力已于近期完成天使++轮融资,天使轮累计融资超2亿美元。据了解,无界动力的天使++轮由远景科技集团、北京市人工智能产业投资基金联合投资,红杉中国、线性资本、高瓴创投、BV百度风投、华业天成、钧山资本等多家老股东跟投。另外,消息人士透露无界动力的天使+++轮融资也接近完成,已获得互联网产业资本及顶级美元、人民币基金的支持。

AI科技评论独家获悉,清华大学助理教授、博士生导师丁宁成立公司「自然意志」,聚焦具身大脑方向,已获得IDG资本、峰瑞资本、真格基金等机构天使轮投资,估值高达40亿人民币。

1个月后,自变量新一代机器人就要入驻真实家庭了。

成立不到一年,跻身“百亿估值俱乐部”。

要说也真够逗的,索尼的机器人又开始找画面了。

当很多具身智能公司更关心机器人先在哪些场景里跑通商业化时,自变量更想寻找哪条路径能够通往 AGI。

特斯拉开源硬件专利后,所有人都在等:中国公司怎么回应?