去年讨论Agent落地时,重点往往是Context Engineering。大家都在琢磨怎么放 Few-shot,怎么优化 RAG 检索的文本片段。但随着 Agent 任务复杂度的上升,控制数据流向、工具调度和异常处理的底层脚手架代码,往往比单纯拼接文本对系统性能的影响更大。这促使行业焦点从“塞什么字”向“怎么通过逻辑获取字”转移,即走向了 Harness Engineering,也就是今年的关键词:驾驭工程

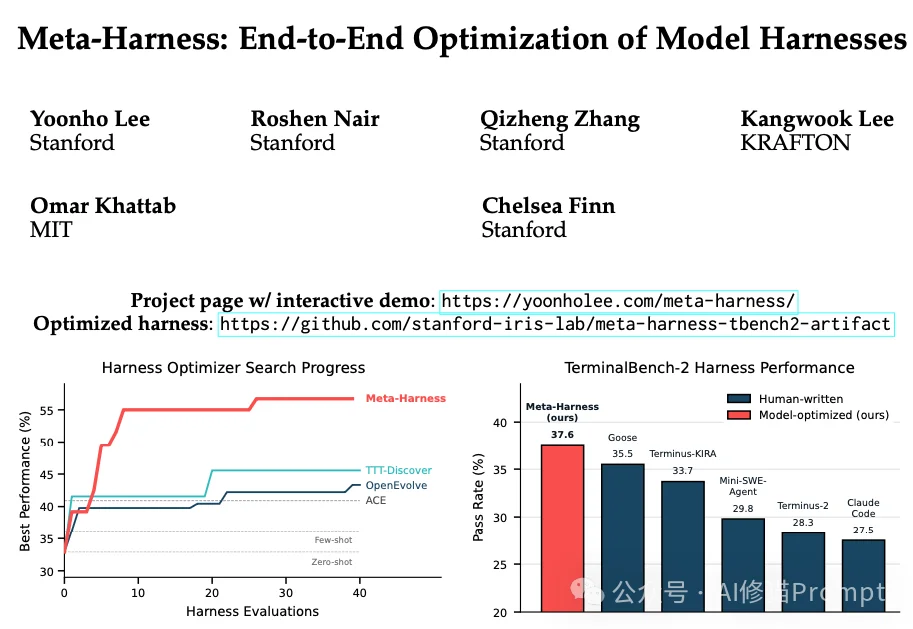

今天介绍的这项研究《Meta-Harness: End-to-End Optimization of Model Harnesses》来自Stanford和MIT,Dspy的第一研究者Omar Khattab也参与了该项研究。

核心工作用一句话总结:他们把Harness自动化了,它不满足于让Agent去优化Prompt或Skills,而是直接通过读取底层文件系统和完整的代码执行轨迹,自己优化重写自己的脚手架代码。并且Agent优化后的自己,性能上比Claude code要强大6倍。

这意味着未来的AI应用开发将逐渐告别人工Harness,Agent框架将从静态工具库走向能根据任务分布自我演化的动态系统。项目地址:https://github.com/stanford-iris-lab/meta-harness-tbench2-artifact

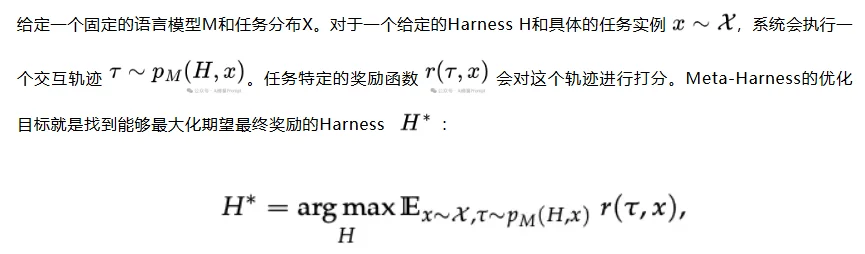

在Agent系统中,模型的表现不仅取决于其自身的权重参数,还极大程度上依赖于它的Harness(外围框架代码)。Harness是包裹在固定大语言模型周围的代码,它决定了系统在运行过程中要存储什么信息、何时检索信息以及如何将信息呈现给模型。

比如写一个coding Agent,Harness决定了是应该把整个代码库塞进Prompt中,还是先让模型执行 grep 命令搜索相关文件。改变同一个固定LLM的Harness,甚至能在同一个基准测试上产生高达6倍的性能差距。

尽管Harness如此重要,但目前在工业界和学术界,Harness的设计和优化很大程度上仍然依赖人工(Manual Engineering)。工程师们需要手动检查失败的案例、调整启发式规则,并在少数几个设计方案中反复迭代。

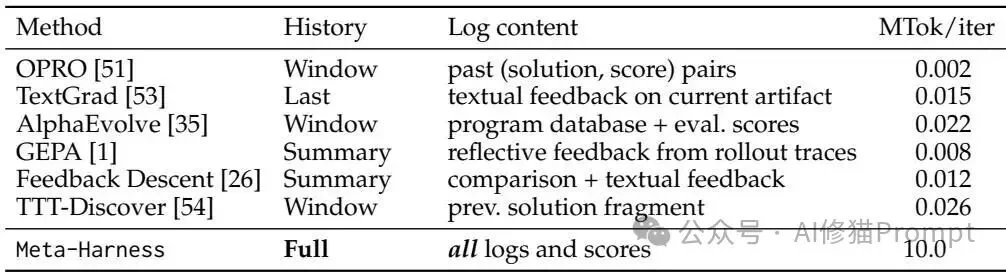

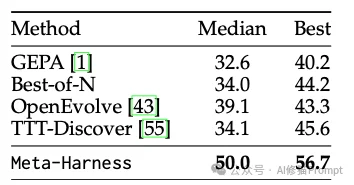

最近虽然涌现了一些“文本优化器”(如OPRO, TextGrad, GEPA等),试图利用LLM来迭代改进Prompt或代码,但它们在Harness优化上面临严重的“水土不服”,主要原因在于反馈信息的过度压缩:

比较了不同文本优化方法的历史访问方式与每轮上下文规模。Meta-Harness 是唯一保留“完整历史 + 全量日志/分数”的方案。

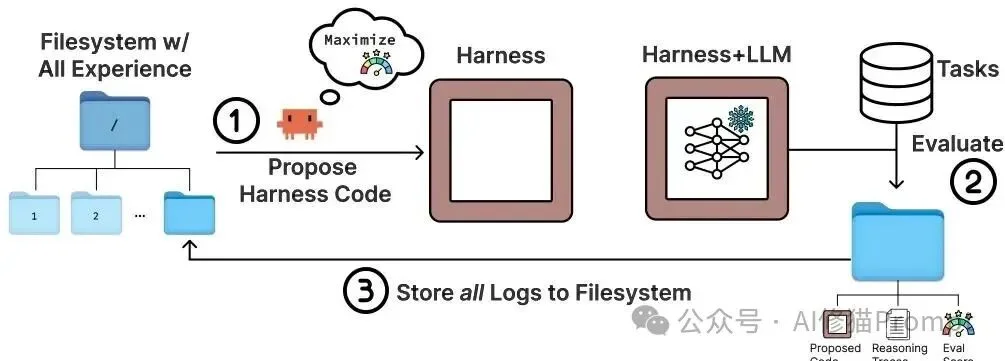

为了解决上述问题,研究者提出了Meta-Harness。这是一个在代码空间(Code space)中运行的外层循环系统(Outer-loop system),专门用于搜索和优化LLM应用的Harness代码。

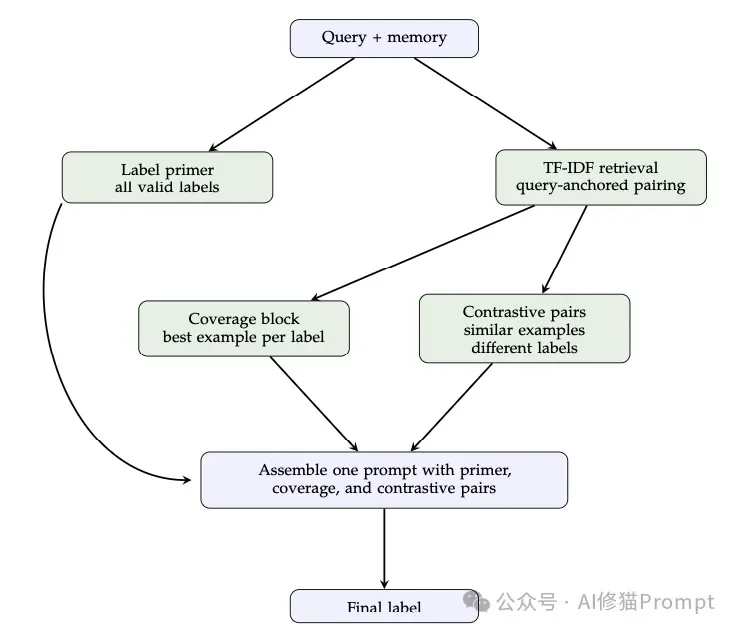

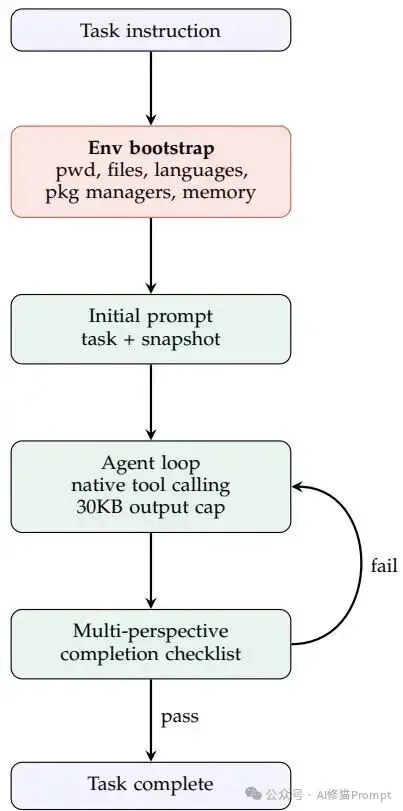

Meta-Harness 的外层搜索循环。提案智能体读取历史候选的代码、分数和执行轨迹,生成新 harness,评测后再把新日志写回文件系统。

Meta-Harness的设计哲学是:与其硬编码复杂的搜索启发式规则,不如给予一个强大的“提案智能体(Proposer Agent)”充分的历史信息访问权限,让它自己去诊断和提议。

grep 和 cat)在文件系统中选择性地检索、阅读和诊断。在最复杂的设定中,单次评估可能产生高达10,000,000个Token的诊断信息,比传统的文本优化器高出几个数量级。在第一个场景中,LLM需要在不断接收新标签样本的同时,持续更新其记忆,并在保留的测试集上进行分类。基础模型使用的是GPT-OSS-120B。

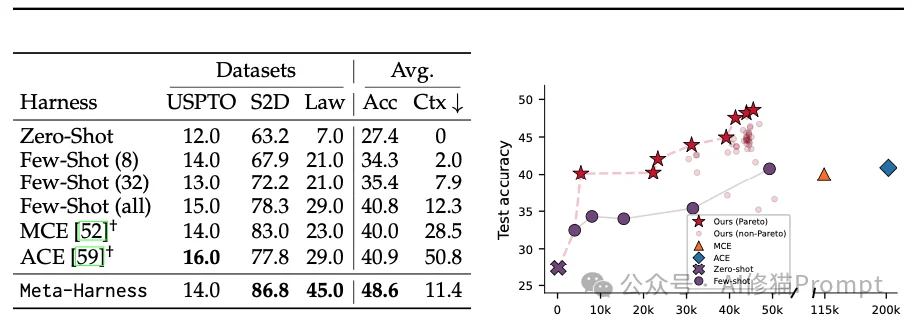

研究者在三个高难度的数据集上进行了评估:

预测刑事指控的LawBench、预测疾病的Symptom2Disease (S2D) 以及预测化学反应物前体的USPTO-50k。

基线方法包括零样本(Zero-shot)、少样本(Few-shot)、以及当前最先进的两个人工设计的Harness:ACE(Agentic Context Engineering)和MCE(Meta Context Engineering)。同时,研究者还将Meta-Harness与现有的文本优化器(OpenEvolve, TTT-Discover, GEPA等)进行了公平的计算量匹配对比。

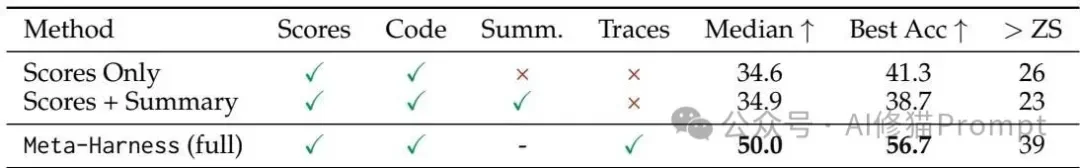

在线文本分类中的消融实验。只给分数,或给“分数+摘要”,都明显弱于直接开放原始执行轨迹。

Meta-Harness并非只发现了一种策略,而是探索出了一个精度与上下文成本权衡的帕累托前沿(Pareto Frontier)。

这两种截然不同的复杂算法,完全是由模型自己通过查看失败案例和尝试编写代码自动“进化”出来的。

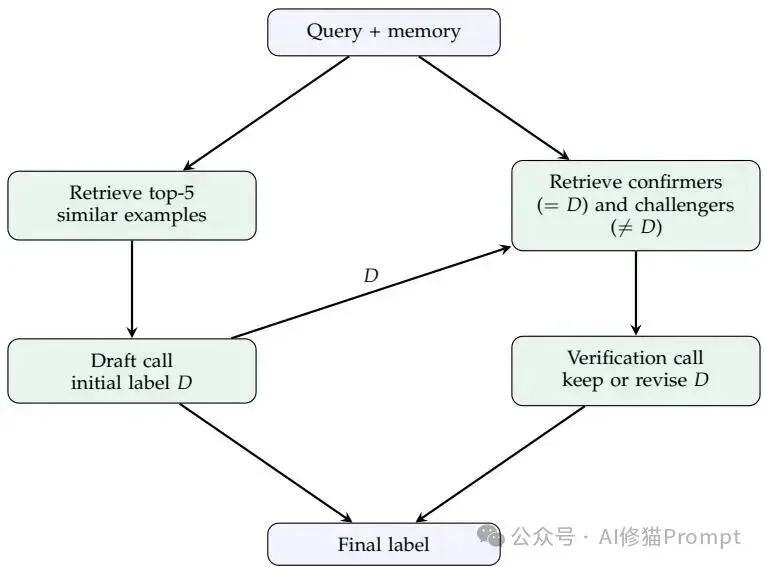

在解决奥林匹克级别的数学题时,如果在提示词中引入相关的历史解题思路,原则上是有帮助的。但以往的研究表明,朴素的密集检索(Dense Retrieval)往往无法在复杂的数学推理中匹配到正确的逻辑结构,反而经常导致性能倒退。

研究者构建了一个包含超过50万道数学题(来源于NuminaMath、OpenMathReasoning等,并严格去重和剔除测试集泄露)的大型语料库。他们要求Meta-Harness通过搜索,找到一种能够提升大模型在250道高难度数学题上表现的检索机制(Retrieval Harness)。

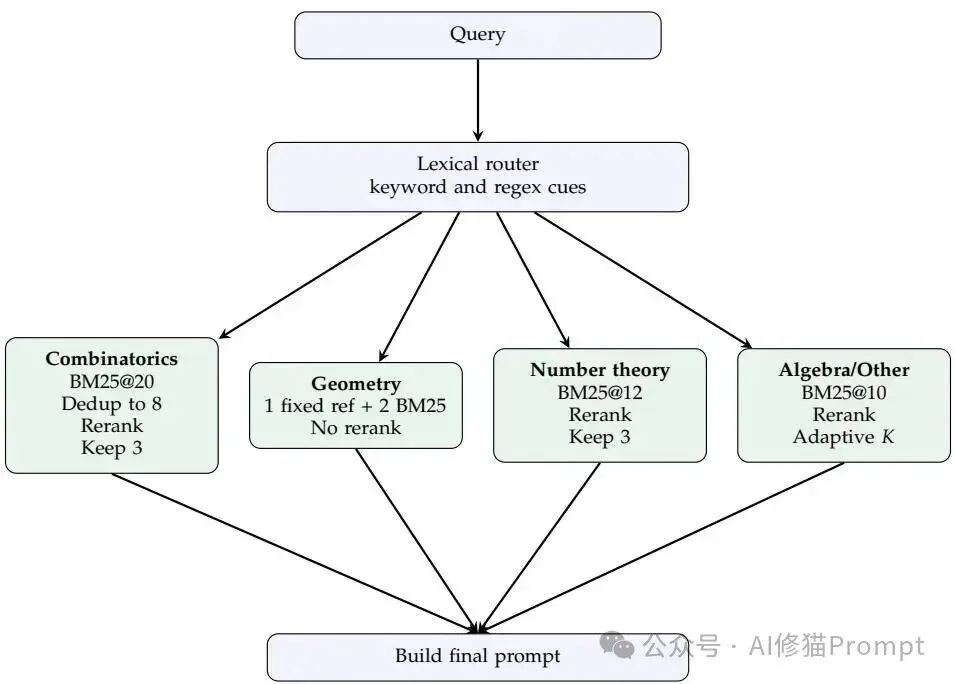

经过40次迭代,Meta-Harness自动编写出了一个包含四个分支的BM25路由检索系统,其结构极其精巧:

自动演化出的数学检索 harness。一个词法路由器先判断题型,再调用对应的 BM25 检索与重排策略。

这个代码中使用的所有触发词正则匹配(Regex features)、去重阈值、重排权重,全部是由Meta-Harness外层循环自动调试出来的。

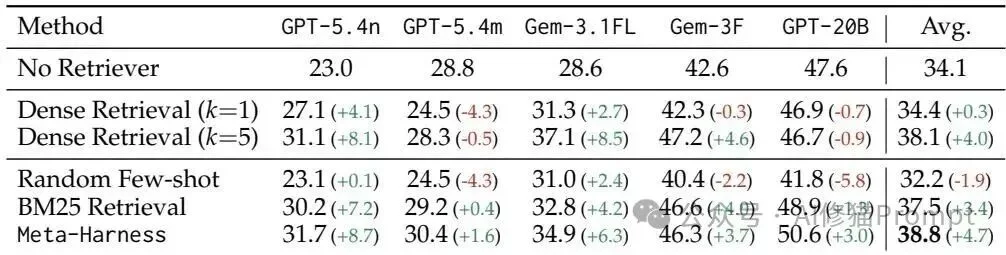

这套被发现的Harness在200道完全未见过的IMO(国际数学奥林匹克)级别试题上进行了测试。更牛的是,研究者将其应用在了五个它在搜索阶段从未见过的不同模型上(包括GPT-5.4-nano, Gemini-3.1-Flash-Lite等)。 结果显示,这套Harness成功实现了跨模型迁移(Transfer),在这五个保留模型上,平均准确率比不使用检索高出了4.7个百分点,并且彻底避免了传统密集检索带来的性能倒退问题。

IMO级数学题主结果。该检索 harness 在 5 个搜索阶段未见过的模型上平均带来 4.7 个百分点提升。

在TerminalBench-2这种极端困难的Agent评测基准上,LLM需要在命令行界面中通过自主调用工具、执行极长步骤(Long-horizon)的交互来完成任务。

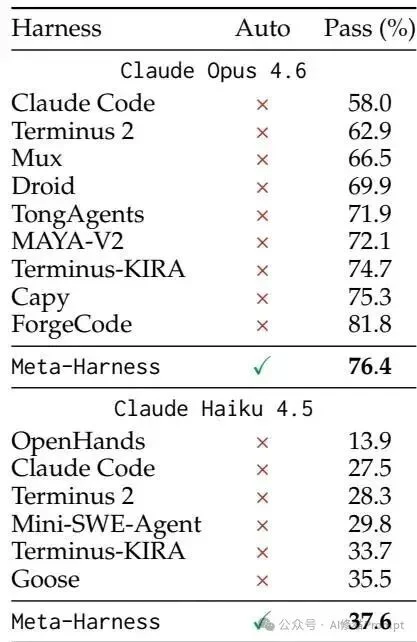

通过初始化两个强基线(Terminus 2和Terminus-KIRA),Meta-Harness展开了代码搜索。最终,它发现的Harness在基于Claude Opus 4.6模型时达到了76.4% 的通过率,超越了人工精心设计的Terminus-KIRA (74.7%),在排行榜上名列第二。而在较弱的Claude Haiku 4.5模型上,改进更为显著:它达到了37.6% 的通过率,将第二名(Goose的35.5%)远远甩在身后,登顶Haiku 4.5榜单第一。

TerminalBench-2 排行结果。Meta-Harness 在 Opus 4.6 上超过 Terminus-KIRA,在 Haiku 4.5 上排名第一。

论文附录A详细记录了Claude Code(提案者)在寻找最优Harness时的思考轨迹,这段日志完美解释了为什么Meta-Harness能够成功,以及它与简单的“随机变异”有何本质不同。

TerminalBench-2 上发现的最终 harness。核心增益来自红色部分的 environment bootstrap,它在主循环开始前注入环境快照。

这段历史证明了,如果不给系统提供包含详细错误过程的执行轨迹,优化器是绝对无法推导出“Prompt中多写了一句清理指令导致文件被删”这种长程因果关系的。

《Meta-Harness》这篇论文证明了一个极具潜力的未来方向:随着编程智能体(Coding Agents)能力的跨越式发展,我们已经可以把原本只能由资深算法工程师手动完成的“框架调优、日志分析、Bug排查、代码重构”流程,端到端地交由系统自动化完成。

它成功的核心有三点:

if-else 分支)。

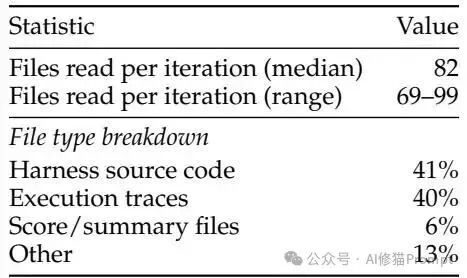

提案智能体的文件访问统计。中位数每轮读取 82 个文件,且代码与执行轨迹占比接近 80%,说明它确实在利用完整历史而非只做局部改写。

对于想要在自己项目中应用Meta-Harness的开发者,论文也给出了非常宝贵的经验:

grep 正则表达式进行高效搜索。总而言之,Meta-Harness向我们展示了如何利用AI来优化AI系统的“外包装”,这种从“权重调整”向“系统外围代码自动演化”的视角转移,对于构建更智能、更健壮的LLM应用具有深远的意义。

Meta-Harness的出现补齐了Agent开发的最后一块拼图。大模型自身的演进靠算力和数据,而模型能力的释放则越来越依赖这层动态的脚手架。当AI开始接管自己的控制流和调度逻辑时,开发者其实可以从枯燥的打补丁、写正则和调优Prompt中解放出来。未来的Agent开发可能会变成一种类似元编程的体验:你只负责定义边界和提供底层的工具接口,剩下的系统外围代码,交给机器自己在试错中编译和演化就足够了。

文章来自于"AI修猫Prompt",作者 "AI修猫Prompt"。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0