本文的共同第一作者王禹博,张钧天分别为复旦大学和中国人民大学高瓴人工智能学院的硕士研究生,主要研究方向为多模态大模型和 Reasoning 等,预计 2027 年 6 月毕业,如有多模态大模型 / Reasoning 相关的优质发展机会,欢迎大家联系: yubowang25@m.fudan.edu.cn , zhangjuntian@ruc.edu.cn。通讯作者是刘雨涵,目前在 MBZUAI 担任研究员,研究方向为多模态大模型,Agent 和 Misinformation 等。

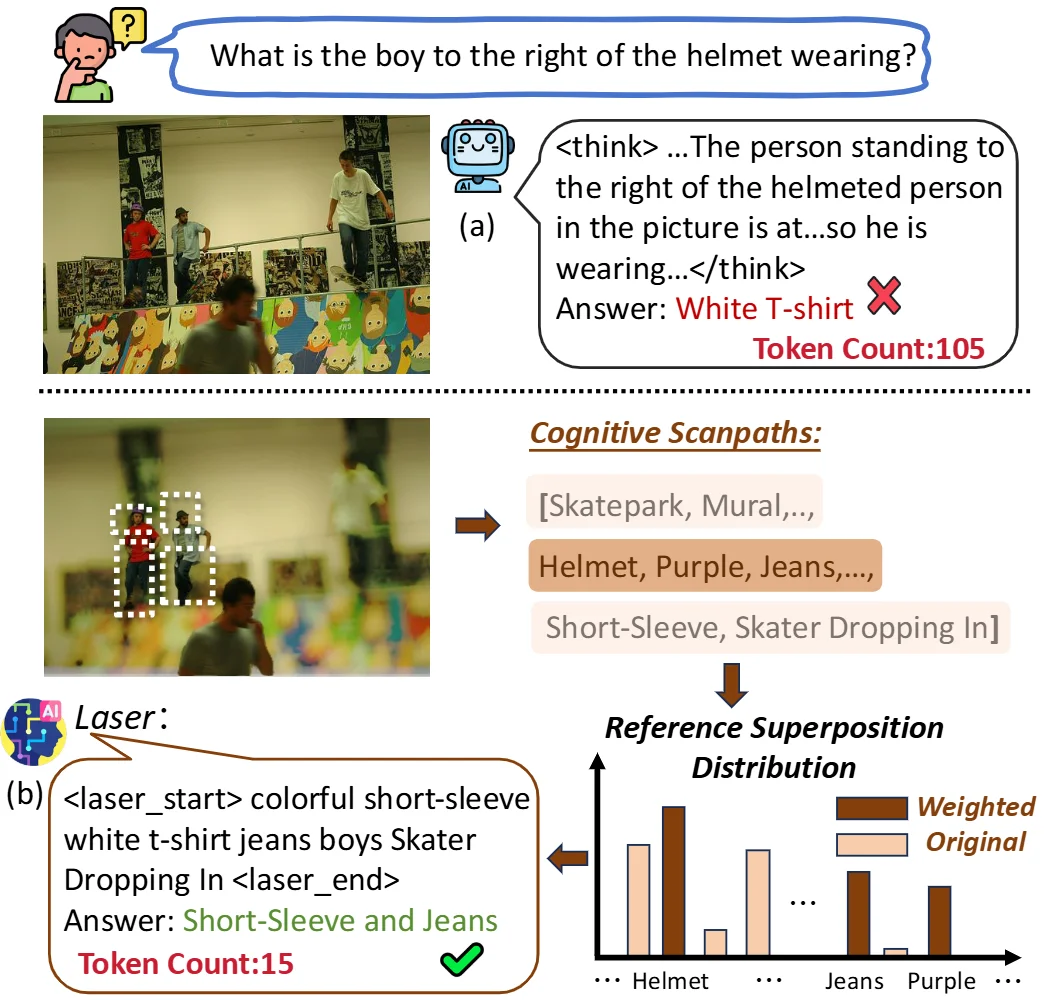

近年来,随着思维链(Chain-of-Thought)技术的普及,多模态大模型(VLMs)的多步推理能力得到了显著提升。然而,这种依赖显式文本的推理路径正面临着一个严重的 “信息带宽瓶颈”:在离散的文本分词过程中,连续且丰富的视觉细节往往会被大量丢失。

为了解决这一痛点,由 MBZUAI、复旦大学、中国人民大学高瓴人工智能学院以及哈佛大学联合组成的研究团队,提出了一种名为 Laser 的全新隐式视觉推理范式。该研究从认知心理学中汲取灵感,引入了 “Forest-before-Trees” 的认知机制,通过动态窗口对齐学习(DWAL),首次实现了在隐空间中维持视觉特征的 “概率叠加” 状态。

研究实验结果显示,Laser 不仅在 6 个主流基准测试中刷新了隐式推理的 SOTA 纪录,更以极致的效率将推理 Token 消耗大幅降低了 97% 以上。这一工作为构建更原生、更高效的多模态智能提供了全新的视角。目前,该论文已被 ACL 2026 Main Conference 正式接收。

1. 传统隐式推理的困境:过早的语义坍缩

如前文所述,纯文本的思维链在多模态大模型中不仅面临着视觉细节丢失的 “信息带宽瓶颈”,还存在另一个隐患:语言先验(Language Priors)的干扰。在生成冗长文本推理的过程中,模型往往会过度依赖固有的语言逻辑,从而产生幻觉或忽视了图像本身传递的视觉信息。

为了绕开显式文本带来的这些局限,学界近期开始探索将推理过程转移到高维空间的 “隐式推理(Latent Space Reasoning)”。但现有的隐式推理方法大多依然沿用传统大语言模型的自回归框架。它们在隐空间中强迫模型进行严格的逐点映射 —— 即在每一步推理中,都要求模型去精准预测紧接着的下一个具体概念或视觉特征。

研究团队指出,这种逐点映射与人类真实的视觉感知规律背道而驰。人类在观察复杂图像时,往往遵循 “Forest-before-Trees” 的层级性原则,即先建立对整体画面的宏观语义把控,再逐步聚焦于局部的特定细节。如果强迫模型在尚未完全掌握全局上下文之时,就 “过早地发生语义坍缩”,将其隐状态死死锁定在某个具体的局部概念上,就会引发严重的 “管中窥豹” 效应,使模型难以捕捉更复杂的视觉逻辑关系。

然而,打破这种逐点约束也面临着巨大的技术鸿沟:如果放任隐状态保持模糊的未坍缩状态,在缺乏外部强监督信号的情况下,模型极易迷失方向,导致隐空间发散为毫无意义的高熵噪声。如何在探索全局的概率叠加与精准聚焦的答案收敛之间找到平衡,成为了阻碍隐式推理发展的一大难题,而这也正是 Laser 范式要攻克的核心目标。

2. Laser 核心机制:动态窗口对齐与隐式叠加

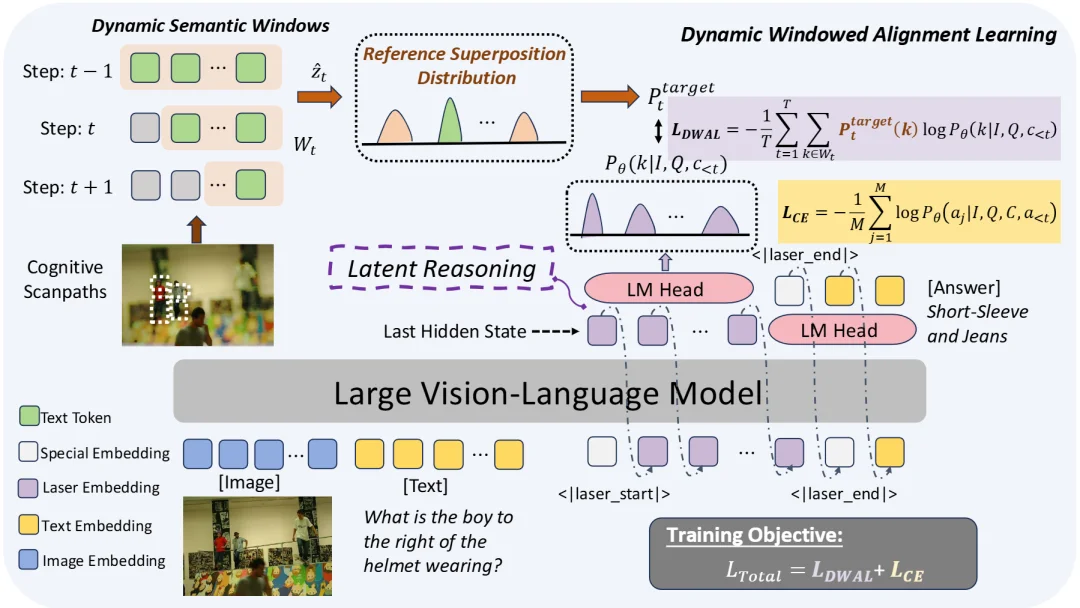

基于上述洞察,研究团队提出了 Laser(Latent Superposition for Effective Visual Reasoning)。其核心创新在于放弃逐点预测,转而采用动态窗口对齐学习(Dynamic Windowed Alignment Learning, DWAL)。

3. 数据基石:ScanPath 认知轨迹

为了支撑 Laser 的隐式对齐训练,研究团队摒弃了依赖显式边界框(Bounding Boxes)等视觉 COT 的强监督手段,选择通过隐式潜空间对齐来桥接感知与语言。为此研究团队专门构建了包含约 27 万样本的 ScanPath 数据集,为动态窗口对齐(DWAL)提供完美契合 “Forest-before-Trees” 规律的训练载体。团队将 GPT-4o 设定为 “视觉认知引擎” ,基于全局优先假设(Global Precedence Hypothesis)对合成数据施加了极其严格的生成约束:

在这些严苛的要求下,ScanPath 成功将视觉推理过程解构成了一系列离散的语义节点,并在人工评估中取得了 91.5% 的逻辑有效率。这份认知扫描路径数据,为后续模型在隐空间中维持概率叠加提供了最核心的监督目标。

4. 具体方法

动态语义窗口(Dynamic Semantic Windows)

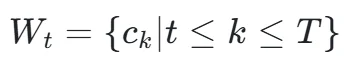

在标准自回归框架下,优化目标通常是强迫隐状态 去最小化预测下一个具体词元 的负对数似然。而 Laser 为每一步推理 t 定义了一个动态语义窗口 :

这里的优化目标不再是单一的 “点”,而是让隐状态 尽可能覆盖窗口 内的所有有效语义信息。随着推理步数 t 的增加,这个窗口会自然缩小,直到只包含最终答案相关的细节,从而在学习范式上完美契合了人类 “Forest-before-Trees” 的视觉处理规律。

自修正的隐式叠加(Self-Refined Superposition)

如何在动态窗口 内指导模型的学习?在缺乏外部软标签提供监督的情况下,团队巧妙地引入了自修正(Self-Refined)机制,让模型基于自身对有效语义分布的估计,来提炼构建出一个稳定的软目标。

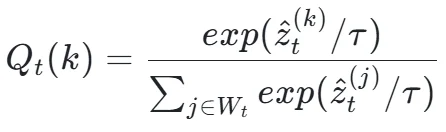

具体而言,模型会提取自身对窗口 内词元的原始预测,并通过带有温度系数 τ 的 Softmax 函数,将其转化为一个平滑的参考叠加分布 :

在传统的自回归训练中,损失函数强制要求模型在这一步必须 100% 预测唯一的下一个词,这正是导致隐状态发生 “过早语义坍缩” 的罪魁祸首。

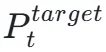

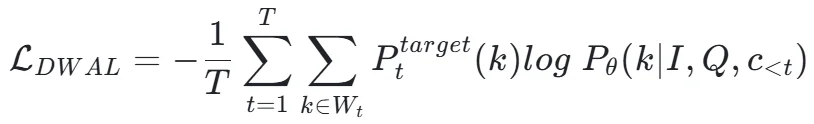

而在 Laser 中,这个由模型自身提炼出的概率分布 就是核心损失函数(DWAL)的目标分布。

将平滑铺开的 作为 Target 放入交叉熵损失中进行梯度回传,等于在数学根基上给隐状态 下达了全新的指令:“你不能只锁定下一个词,你必须同时兼顾、并包含窗口内所有未来潜在 token 的特征”。正是这一步以 为基准的自修正对齐,真正打破了强制预测单一词元的硬性约束,在隐空间中构建出了 “概率叠加” 的认知状态。

熵正则化干预(Entropy-Regularized Intervention)

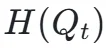

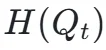

单纯依赖软标签叠加容易导致模型陷入高熵的均匀分布,失去语义焦点。为此,团队引入了熵正则化干预机制。首先,计算参考分布的归一化熵 来衡量模型当前的不确定性:

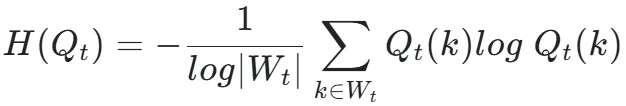

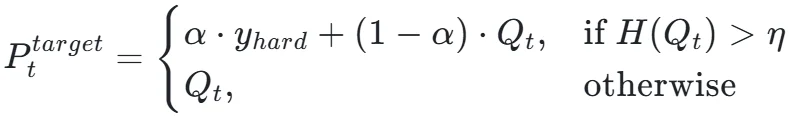

接着,系统会根据不确定性构建一个混合目标 ,它能在软叠加和严格的下一个词元对齐之间动态切换:

这里隐藏着一个隐式课程学习(Implicit Curriculum):当 大于设定的阈值 η 时(说明模型很迷茫),系统会注入硬标签 并赋予权重 α 进行强制纠偏;当模型展现出对全局上下文的良好把控时,则放手让其在叠加态中自由探索。

总体优化目标(Optimization Objective)

整合以上机制,对于隐式推理链,DWAL 损失负责将隐式轨迹与动态语义窗口对齐:

而对于最终的显式答案生成阶段,则采用标准的交叉熵损失 。整个训练目标即为两者的加权和,使模型在探索全局视觉语义与利用精确局部语义之间取得绝佳平衡:

5. 实验结果:以极低算力刷新 SOTA,兼具可解释性

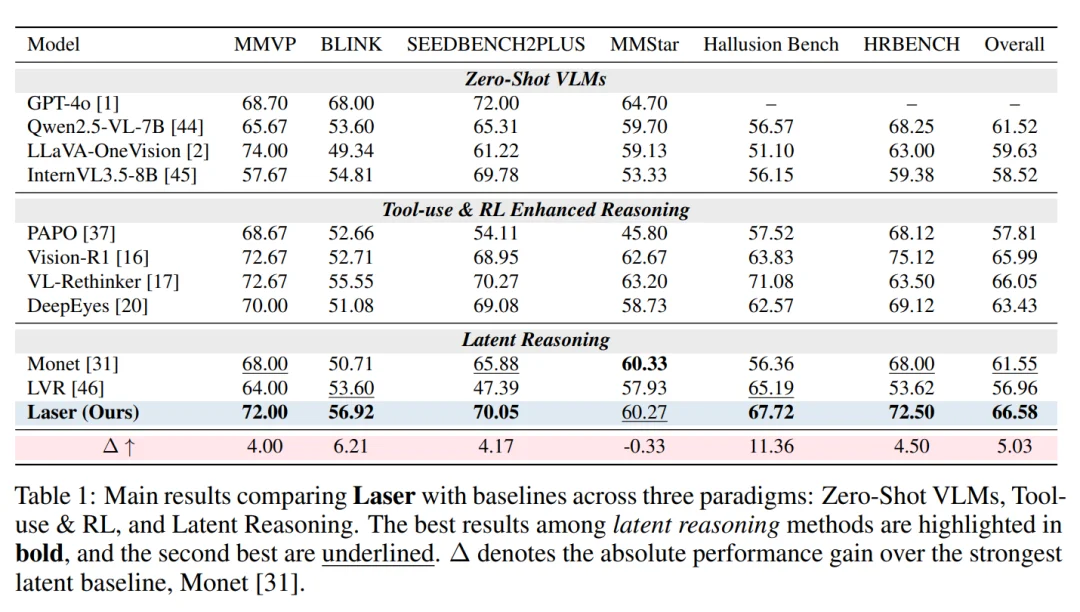

研究团队在 6 个极具挑战性的视觉基准测试上对 Laser 进行了全面评估。结果表明,Laser 兼顾显式思维链的推理深度和隐式推理的高效推理速度。

卓越的推理性能

Laser 在隐式推理方法中确立了新的最优性能(SOTA)。与隐式推理基线模型相比,Laser 的平均性能提升了 5.03%。特别是在测试视觉错觉和幻觉的 HallusionBench 以及感知基准 BLINK 上,Laser 分别取得了 11.36% 和 6.21% 的涨幅。

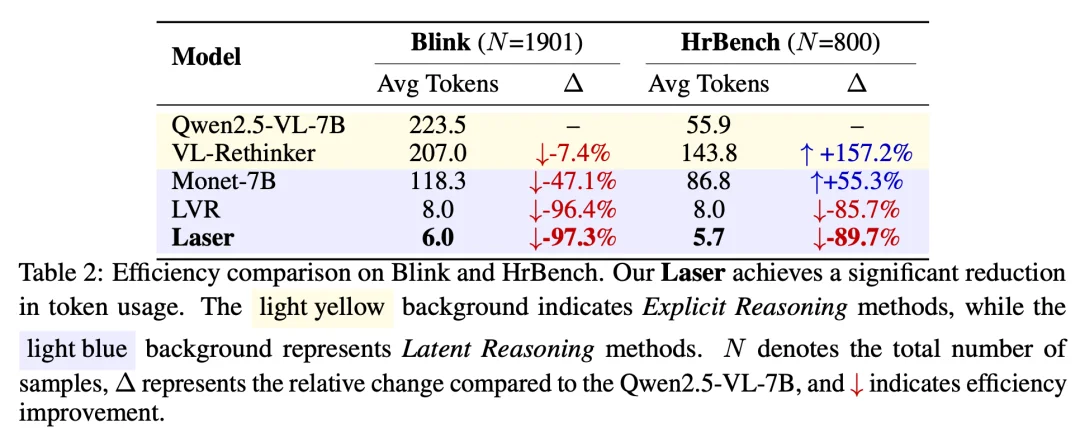

高效的推理效率

尤为值得一提的是,Laser 在取得性能突破的同时,展现出了极高的运行效率。通过将推理过程从离散文本空间转移到紧凑的隐空间,Laser 成功将推理 Token 的消耗减少了 97% 以上。在 BLINK 基准测试中,其平均 Token 消耗量锐减至仅 6.0 个,远远低于显式推理方法。

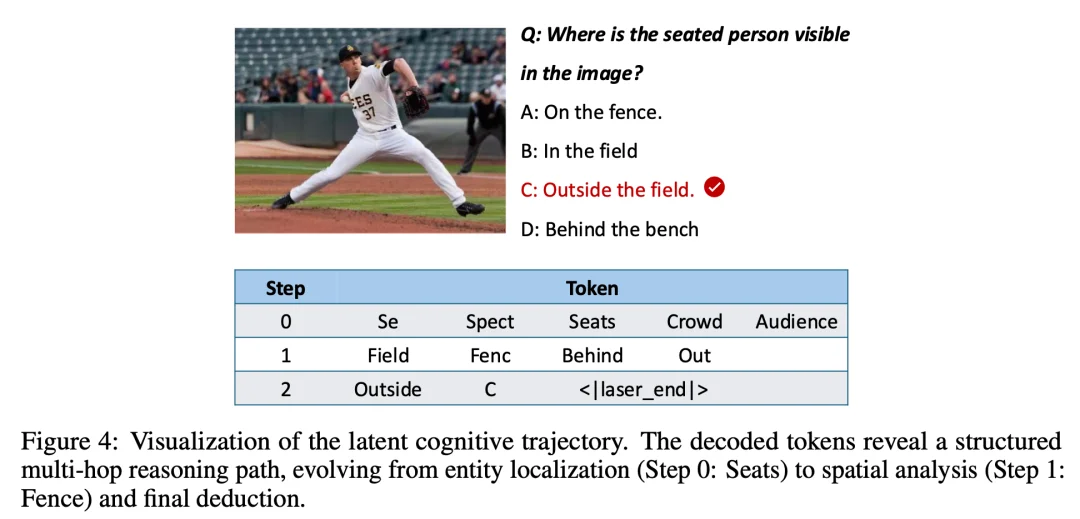

破局隐式推理的 “黑盒化”

与传统隐式推理模型中难以解读的连续向量不同,Laser 成功保留了高度的可解释性。得益于其训练过程中维护语义叠加态的窗口对齐机制,Laser 的隐状态可以直接通过语言模型的词表头进行投影解码,从而让研究人员能够直观地可视化出大模型的内部 “认知轨迹”。

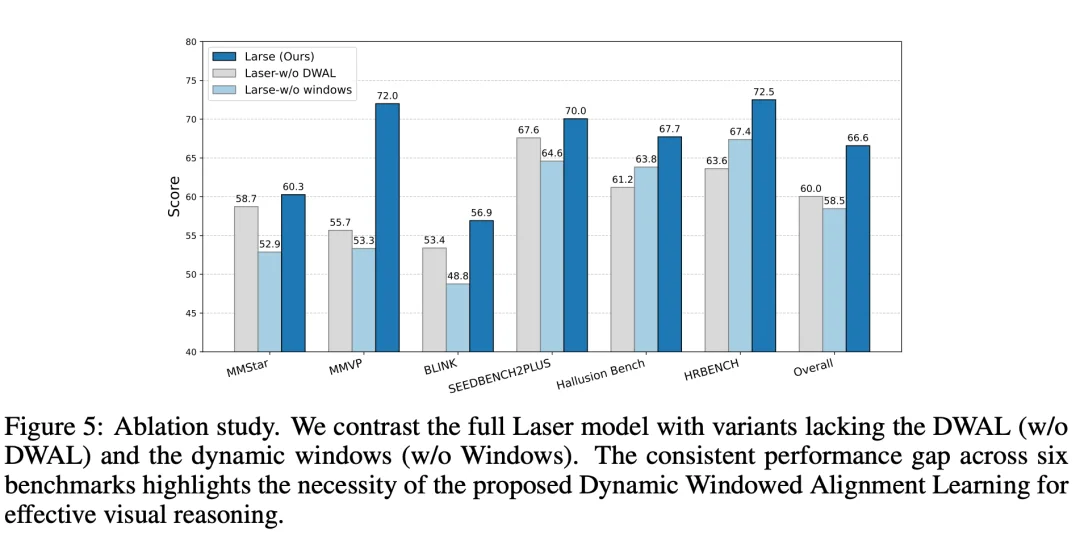

6. 消融实验:探索 Laser 的内在机制

为了验证 Laser 各个核心组件的实际贡献,研究团队在论文中进行了详尽的消融实验。结果表明,Laser 的良好表现主要归功于隐式对齐框架的设计,以及对干预机制的精准把控。

6.1 探究 Laser 为何有效:概率叠加与动态窗口

团队首先对动态窗口对齐学习(DWAL)的核心要素概率叠加和动态窗口进行了消融实验。

6.2 熵干预的控制:触发干预的黄金比例

在隐空间中,模型什么时候该自由探索,什么时候该被强制纠偏?这就需要通过熵正则化干预机制中的阈值 η 来控制。实验对不同的熵阈值进行了对比,发现 η=0.6 是最佳的平衡点,此时强制干预的触发比例约为 10%。

恰好在维持认知灵活性与确保视觉准确性之间找到了最优解。

结语

Laser 的提出,为大语言模型的视觉推理指明了一条兼顾 “高效” 与 “深思” 的新道路。研究团队期待这项工作能够鼓励多模态大模型的研究范式,从传统的显式文本预测,走向更符合直觉的连续隐式视觉推理。

文章来自于微信公众号 "机器之心",作者 "机器之心"

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/