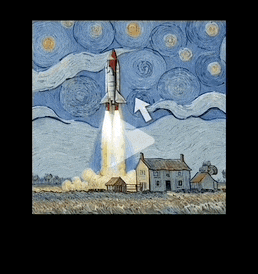

单击画面中的火箭,输入“发射”prompt,瞬间起飞!

就连想要回收火箭,也只需要输入“Launch down”,再轻轻一点击:

马斯克看了都要自我怀疑一下,这火箭发射这么简单,自家星舰成功进入太空怎么那么难(开个小玩笑)??

00:08

以上效果来自一个新的图生视频模型Follow-Your-Click,由腾讯混元、清华大学和香港科技大学联合推出。

食用方法非常友好:

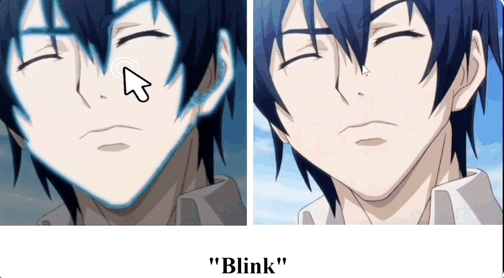

任意一张照片输入模型,只需要点击对应区域,加上少量简单的提示词,就可以让图片中原本静态的区域动起来,一键转换成视频。

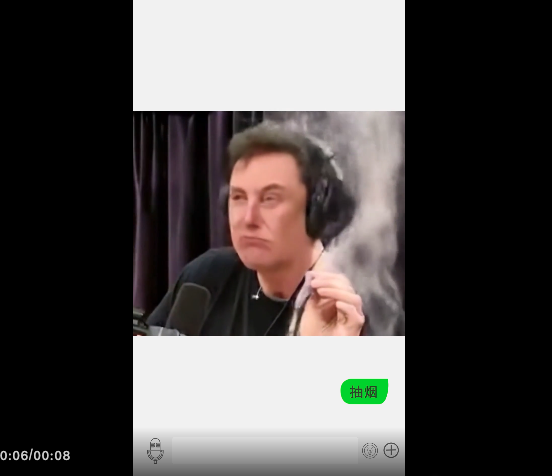

就连《一人之下》的诸葛青和《唐伯虎点秋香》里的星爷也……

相关研究论文已经挂上了arXiv,GitHub上也放出代码,首日就小有战绩,揽星280+。

注意看这个楼梯上的动画小鼠形象,只需单击小鼠腹部,再输入“跳舞”,它就能瞬间扭动起来。

同时,画面的其他部分保持原有的静止状态。

不只是人物、卡通形象可以控制,图片的其余部分,通过点击和输入简短提示词,也能动起来。

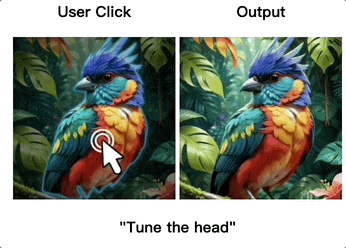

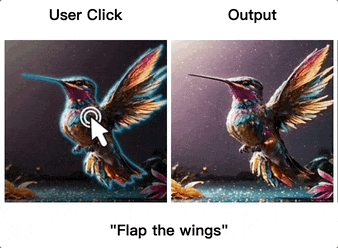

进一步测试,是可以实际感知到Follow-Your-Click对画面动态部分的精准控制的。

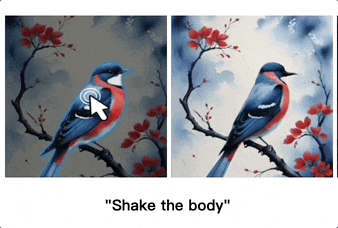

同样是鸟图,点击小鸟,输入“动动脑袋”:

输入“扇扇翅膀”:

输入“跳个舞吧”:

输入“不如摇摆”:

总结,就是想要哪里动,就点哪里。

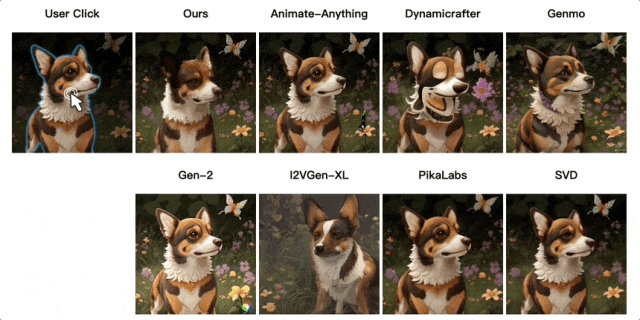

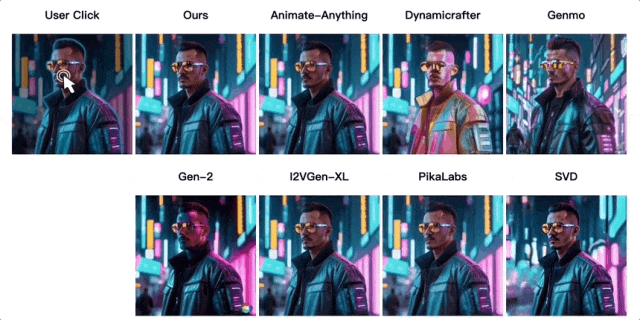

研究团队还将Follow-Your-Click和其他视频生成模型进行了同题对比,以下是实验效果:

此前图生视频模型的生成方法,一般都需要用提示词描述运动区域,并提供运动指令的详细描述。

从生成效果来看,过往技术在指定图像移动部分缺乏控制,往往是让整个场景动起来,而不是具体到图像上的某个区域。

为了解决这些问题,腾讯混元大模型团队、清华和港科大联合项目提出了更实用和可控的图像到视频生成模型Follow-Your-Click。

实现方式上,Follow-Your-Click首先整合了图像语义分割工具Segment-Anything,将用户点击转换为二进制区域Mask,将其作为网络条件之一。

其次,为了更好地正确学习时间相关性,团队还引入了一种有效的首帧掩模策略。

这种方式对模型生成的视频质量有较大的性能提升,不论是在畸变还是首帧的重构效果上都有很大的帮助。

此外,为了实现简短提示词的文字驱动能力,研究团队构建了一个名为WebVid-Motion的数据集——利用大模型来过滤和注视视频标题,并强调人类情感、动作和常见物体的运动,通过数据集提升模型对动词的响应和识别能力。

联合研究团队还设计了一个运动增强模块,主要用途一方面是更好地适应数据集,一方面用来增强模型对运动相关词语的响,同时理解简短提示指令。

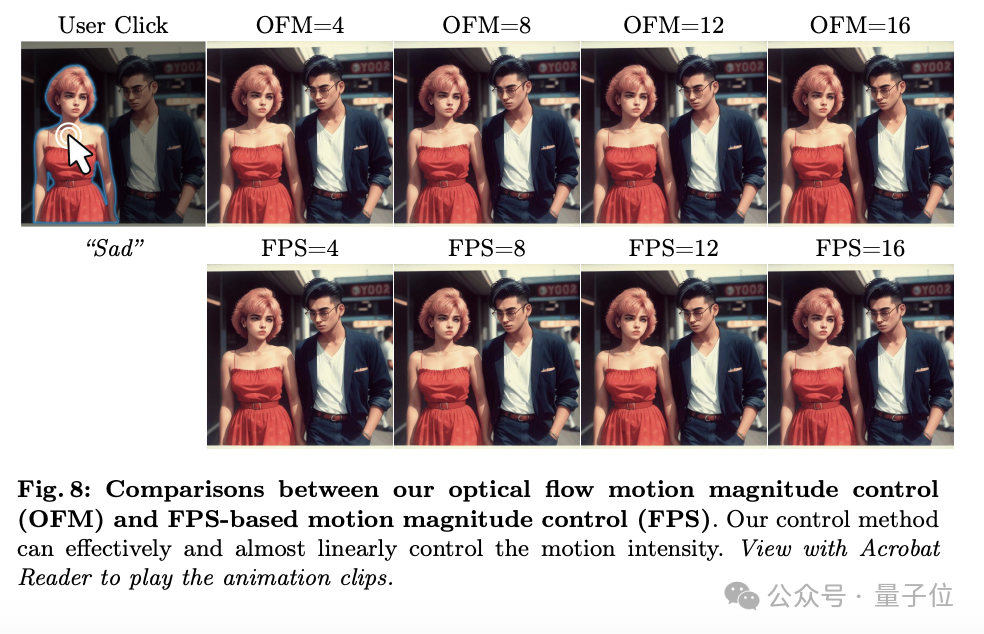

在视频中,不同类型的物体可能表现出不同的运动速度。

以往的工作中,每秒帧数(FPS)主要作为全局的动作幅度控制参数,间接调整多个物体的运动速度。然而,它无法有效控制移动物体的速度。

举个栗子,一个展示雕塑的视频可能具有很高的FPS,但是没有物体的运动速度。

为了实现对运动速度的准确学习,研究团队提出了一种基于光流的运动幅度控制,使用光流模长作为新的视频运动幅度控制参数。

以上这些新提出的方法,加上各模块的组合,Follow-Your-Click大大提升了可控图生视频的效率和可控性,最终实现了用简单文本指令来实现图像局部动画。

小道消息!

Follow-Your-Click联合项目组中的腾讯混元大模型团队,正努力研究和探索多模态技术。

此前,该团队已经作为技术合作伙伴,支持了《人民日报》的原创视频《江山如此多娇》。

该说不说,2024年,一定是多模态卷到爆炸的一年……

项目主页:https://follow-your-click.github.io/

论文链接:https://arxiv.org/pdf/2403.08268.pdf

GitHub:https://github.com/mayuelala/FollowYourClick

文章来自微信公众号 “ 量子位 ”