自OpenAI的Q*项目曝光后,业内相关讨论始终层出不穷。

据现有信息汇总,Q*项目被视作OpenAI在探索人工通用智能(Artificial General Intelligence, AGI)道路上的一次重大尝试,有望在包括数学问题解决能力、自主学习和自我改进等多个层面对人工智能技术带来革新性突破。

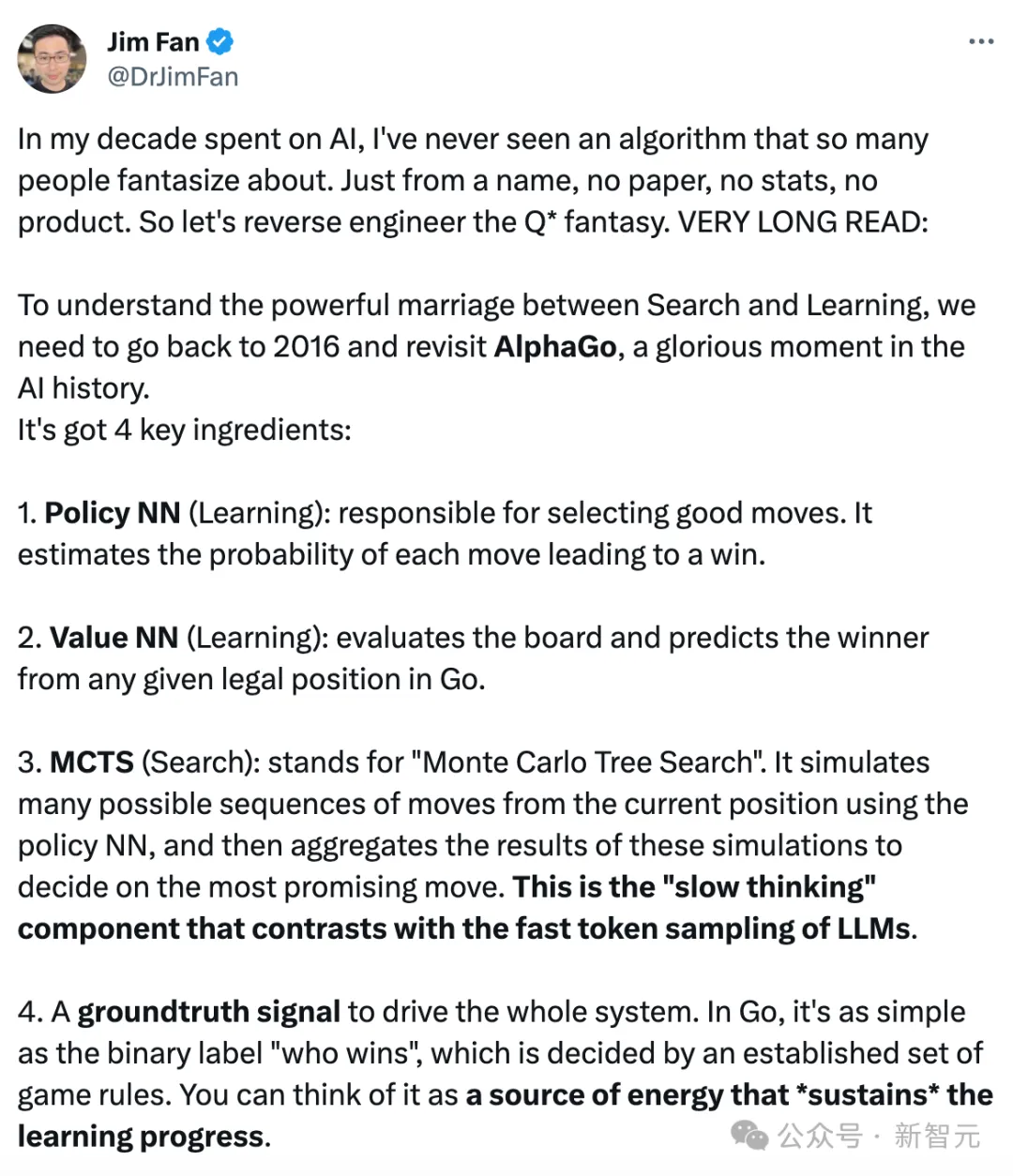

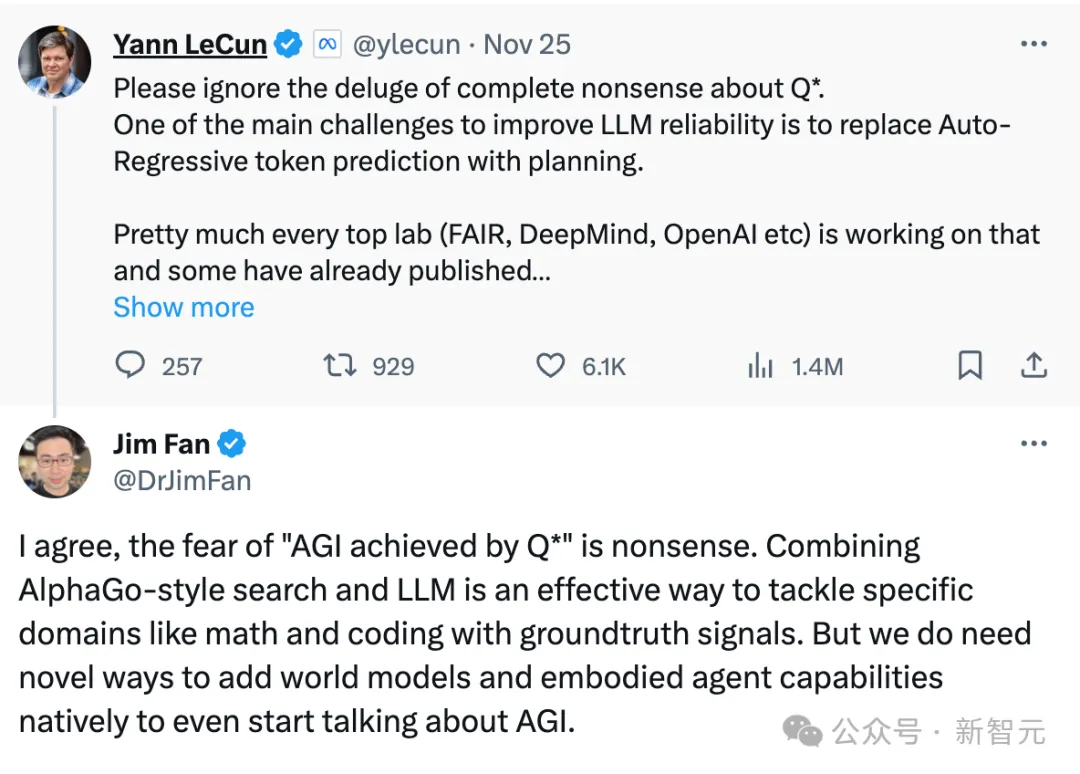

(英伟达科学家Jim Fan、图灵奖得主Yann LeCun等参与讨论OpenAI的Q*实现方式)

(Meta科学家田渊栋则认为Q*是Q-learning和A*的结合,且天然地适合推理任务,尤其在数学推理方面)

不过迄今为止OpenAI没有公开关于Q*算法的具体细节,其效果究竟如何我们并不得而知。

然而就在近日,一篇名为《Q*: Improving Multi-step Reasoning for LLMs with Deliberative Planning》的论文在AI圈内引发了不小的震荡。

论文链接:https://arxiv.org/abs/2406.14283

论文中提出的Q*算法不仅能够帮助小模型达到参数量比其大数十倍、甚至上百倍模型的推理能力,大幅提升了小模型的性能,还显著降低了计算资源的需求。

最值得关注的是,这篇论文竟然出自中国团队之手——由颜水成教授团队携手新加坡南洋理工大学团队共同发布!

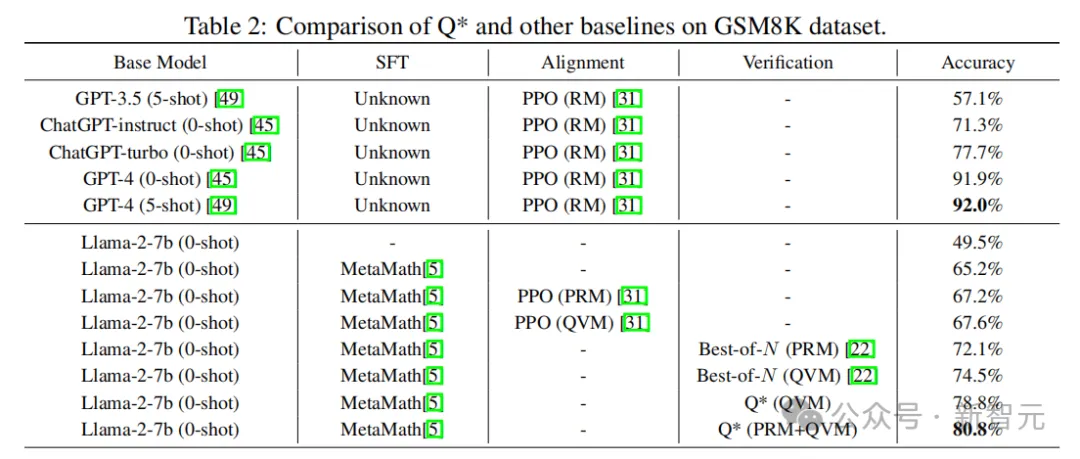

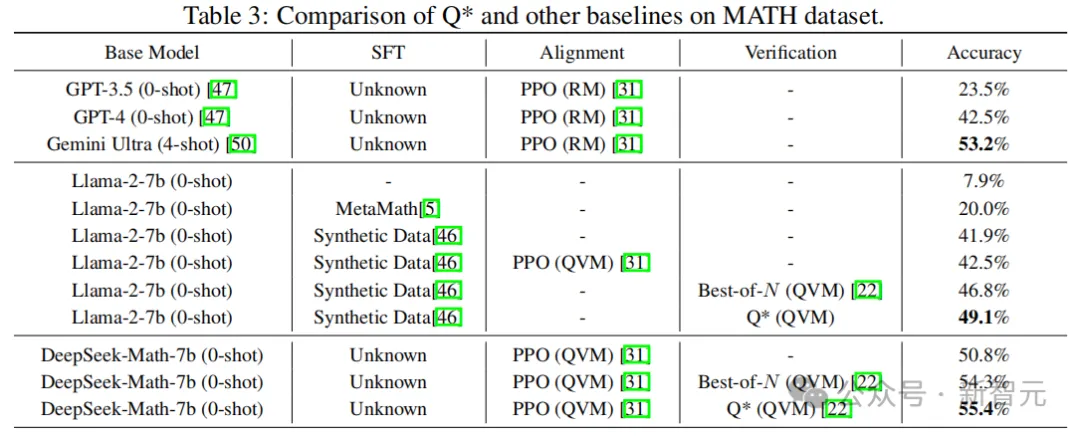

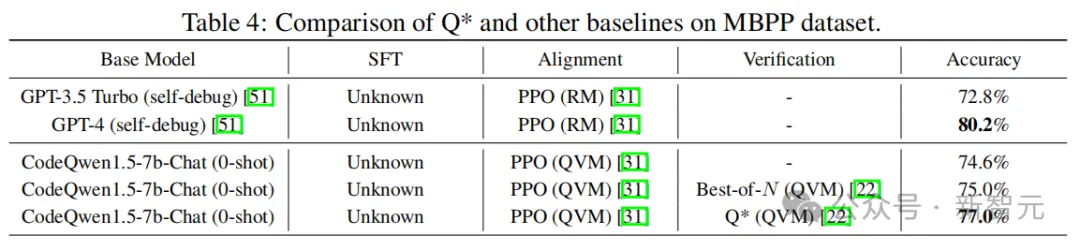

根据实验结果,Q*成功帮助现有开源模型在GSM8K、MATH和MBPP数据集上取得性能飞跃,评分分别超越了ChatGPT和Gemini Ultra。

(Q*在AI圈内引发热议)

(外网网友直呼「中国AI赶上来了!」)

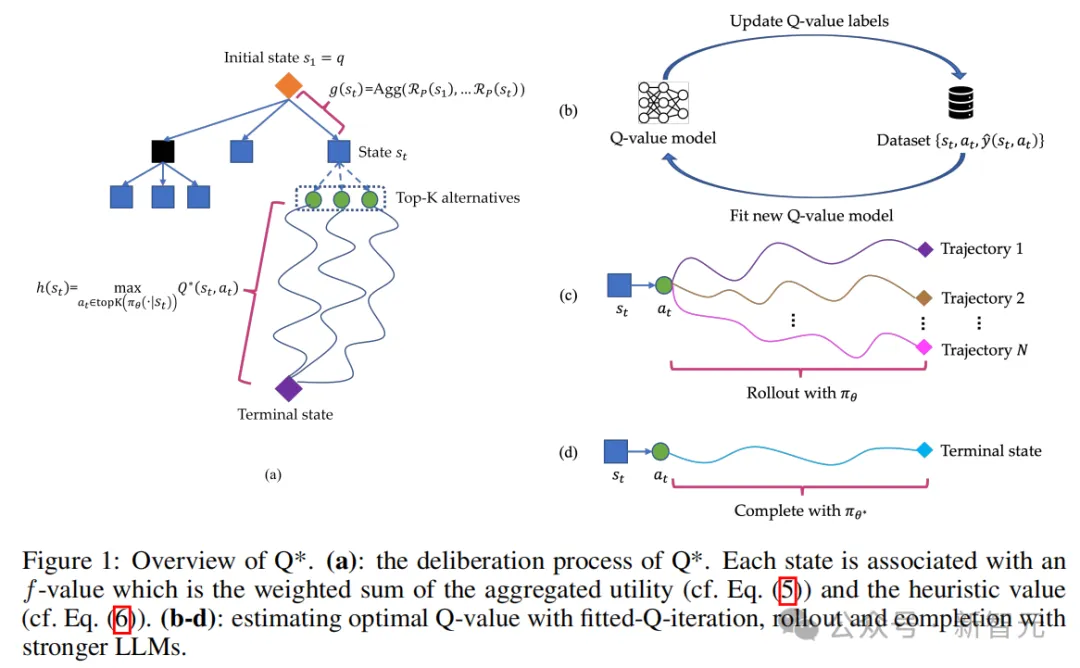

在《Q*: Improving Multi-step Reasoning for LLMs with Deliberative Planning》论文中,研究人员首先将大语言模型的推理轨迹分解为若干个状态。

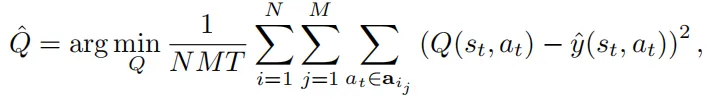

对于每一个状态,参考DeepCubeA中的设计,通过将定义Path Cost的g(s_t)函数和定义Accumulated Reward的Q*(s_t, a_t)集成到同一个f(s_t)函数内,实现了对历史状态收益和未来期望收益的综合考虑。

最后利用A*搜索算法对状态进行最佳优先搜索,实现了对复杂推理任务的全盘规划,从而提升开源模型在推理任务上的性能。

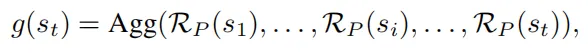

其中g(s_t)表示当前轨迹中的多个历史状态,既{s1,...,s_t},的聚合收益。

具体g(s_t)的函数形式可以通过人为定义,例如判断当前代码是否符合语法规则等,或者通过构建 Process Reward Model(PRM)进行监督学习得到;g(s_t)中的聚合方式可以为求和,最大值,最小值等。

为了获得状态-动作对(s_t, a_t)的最优Q值以实现规划,研究人员在当前LLM策略生成的数据上通过监督学习的方式训练了一个代理Q值模型。

训练过程中的真实标签可以由三种不同的方式得到,包括离线强化学习,蒙塔卡罗采样估计和利用更强大的语言模型补全。

实验结果表明,颜水成团队本次所提出的Q*框架,可以显著地提升LLM的推理能力:

研究证明,Q*能够帮助参数量仅为7b的小模型达到参数量比其大数十倍甚至百倍模型的推理能力,大幅提升模型的性能,并显著降低了计算资源的需求。

颜水成团队表示,目前,Q*的研究尚在初级阶段,算法在各个环节还有进一步的改进空间。未来,团队会继续深入此项研究,不断提升国产开源模型推理能力,打破OpenAI闭源封锁,为人工智能前沿技术发展带来全新可能。

参考资料:

https://arxiv.org/abs/2406.14283

文章来自于微信公众号“新智元”,作者 “好困”