用扩散模型搞社交信息推荐,怎么解决数据噪声难题?现有的一些自监督学习方法效果还是有限。

针对此,港大数据智能实验室提出了新项目RecDiff。

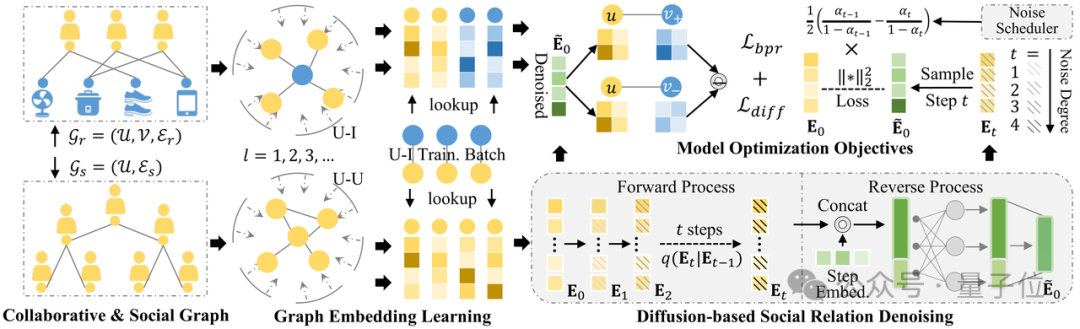

RecDiff是一种全新的基于扩散模型的推荐框架,能够更好地捕捉用户的潜在偏好和兴趣,从而生成个性化、贴合用户需求的推荐内容。

具体而言,该框架采用隐空间扩散机制,有效清除用户表示中的噪声,无论是压缩还是密集的嵌入空间。

RecDiff通过多步扩散和噪声消除过程,展现出在不同噪声水平下均能准确识别和去除噪声的能力。

此外,扩散模块针对下游推荐任务进行了优化,以最大化其对推荐过程的增强效果。

通过广泛的实验评估,RecDiff在提高推荐准确性、训练效率以及去噪效果方面均表现出色。

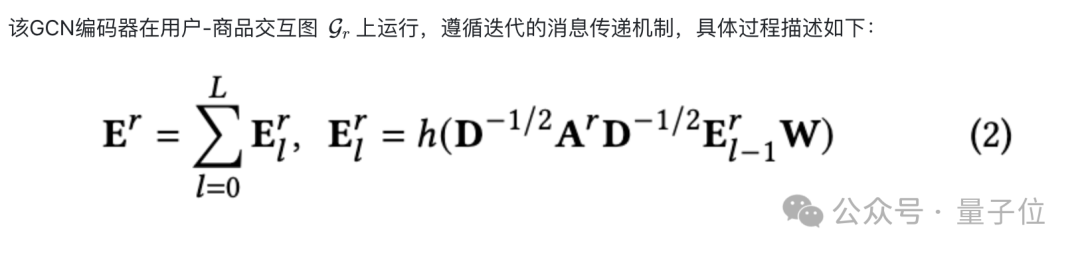

受到简化图神经网络(GNN)成功应用的启发,图那对在社交去噪框架中采用了轻量级图卷积网络(GCN)作为图编码器。

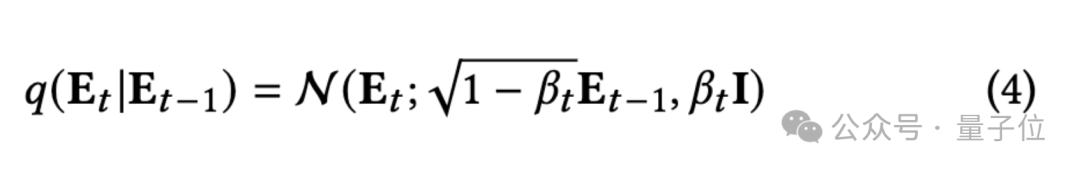

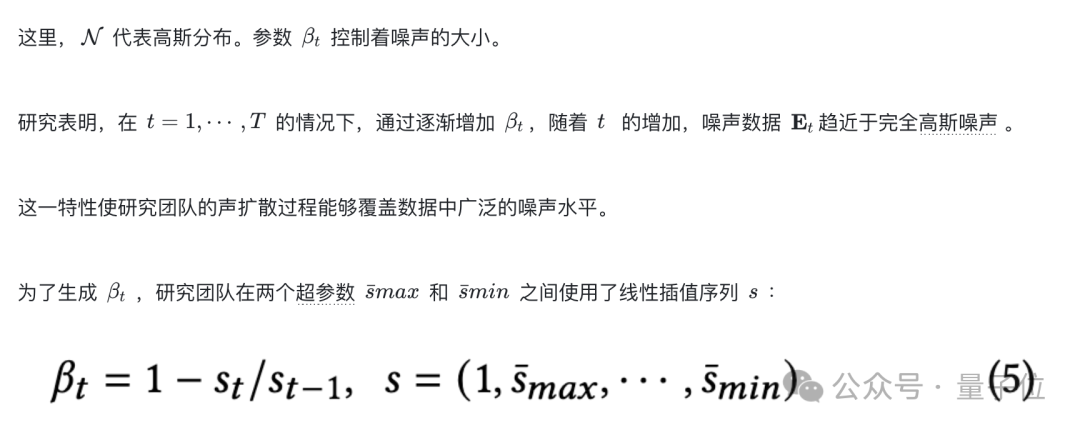

汲取扩散模型在各个领域成功生成无噪声数据的精髓,研究团队的RecDiff框架集成了一种创新的扩散机制,用以产生净化后的社交关系数据。

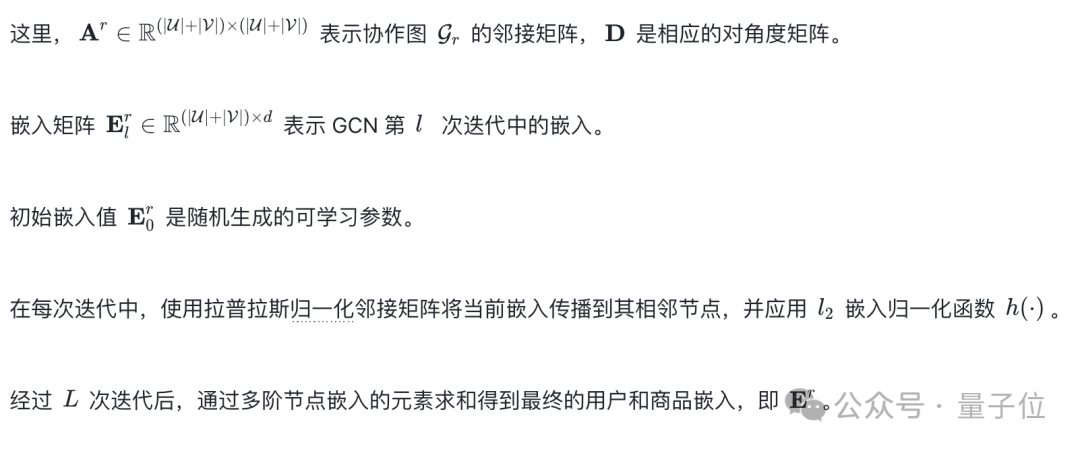

面对社交图数据固有的稀疏性挑战,研究团队设计了一种策略:

在潜在空间而非直接在图数据空间中,通过正向与反向的扩散步骤,实现社交信息的高效和精准扩散。

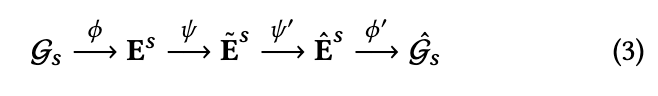

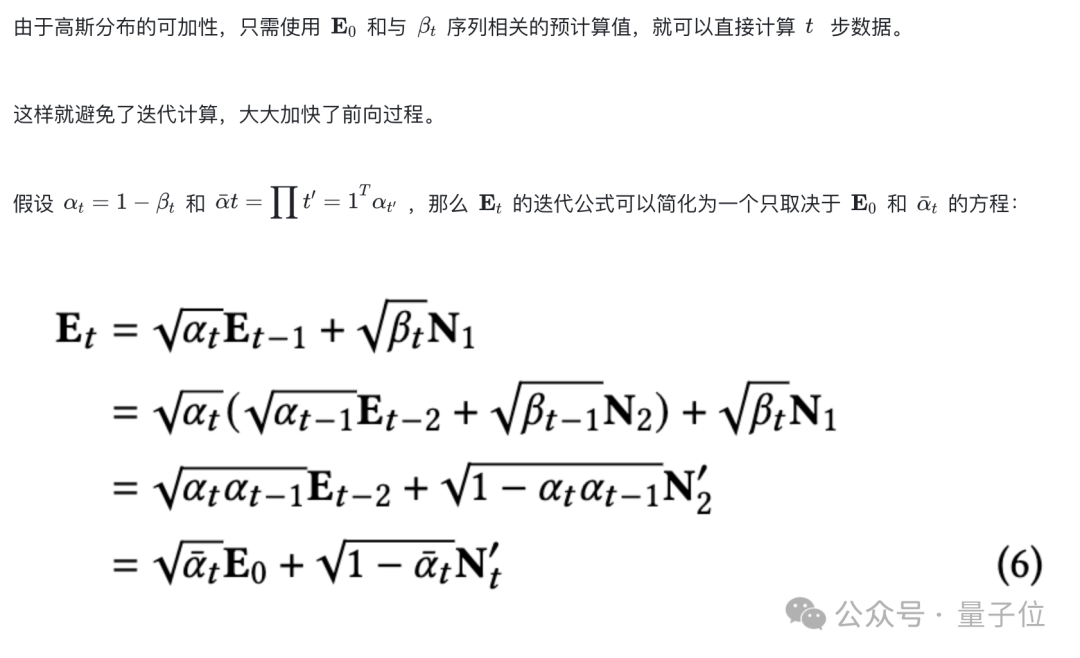

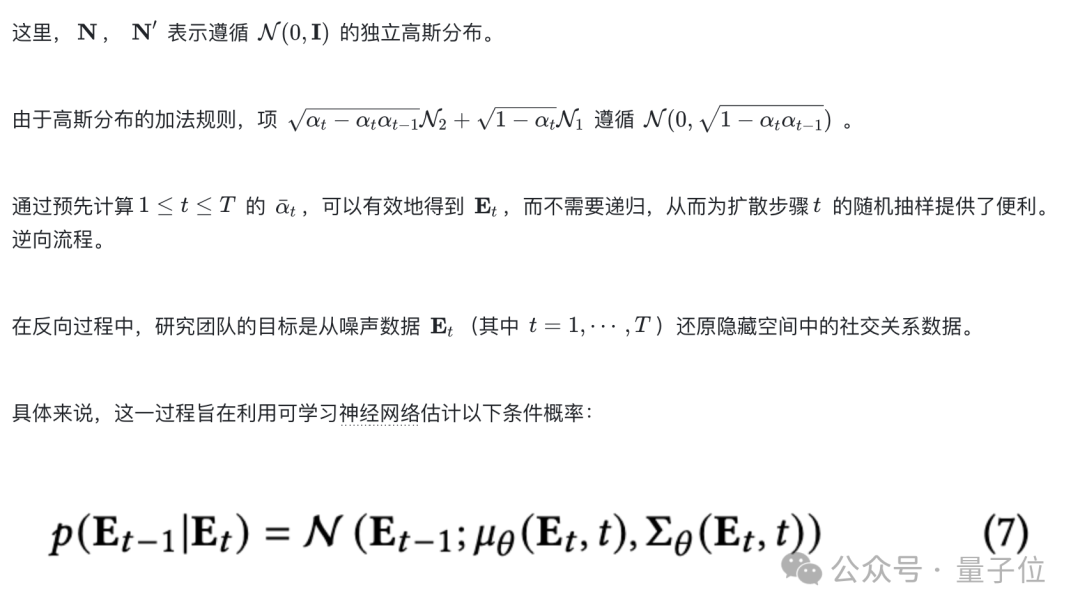

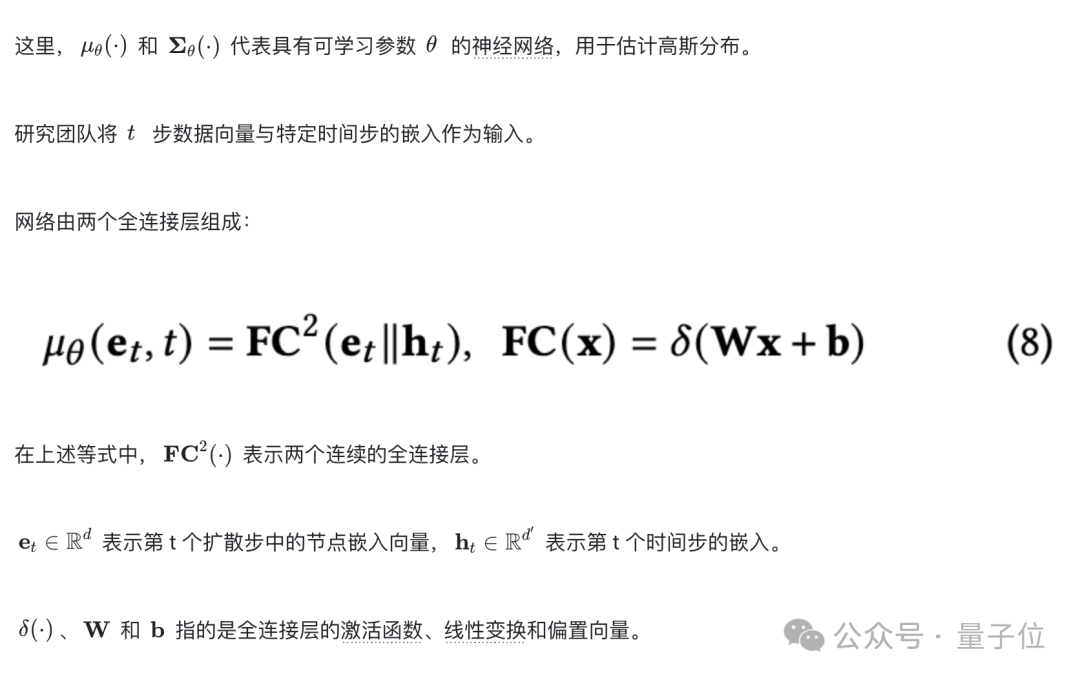

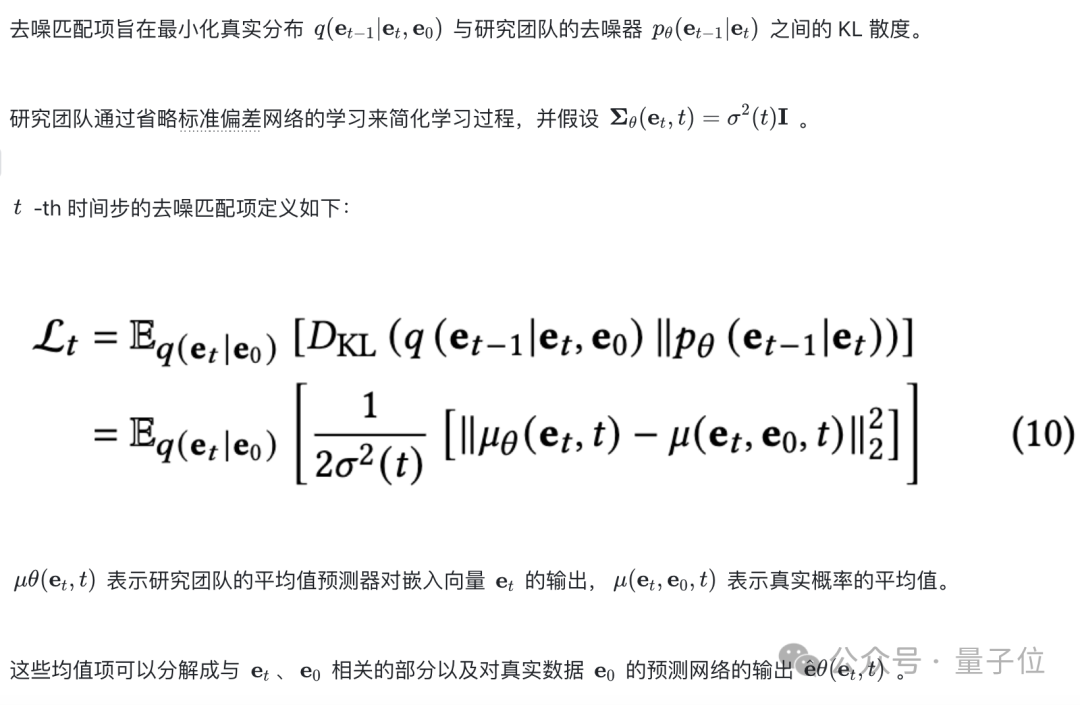

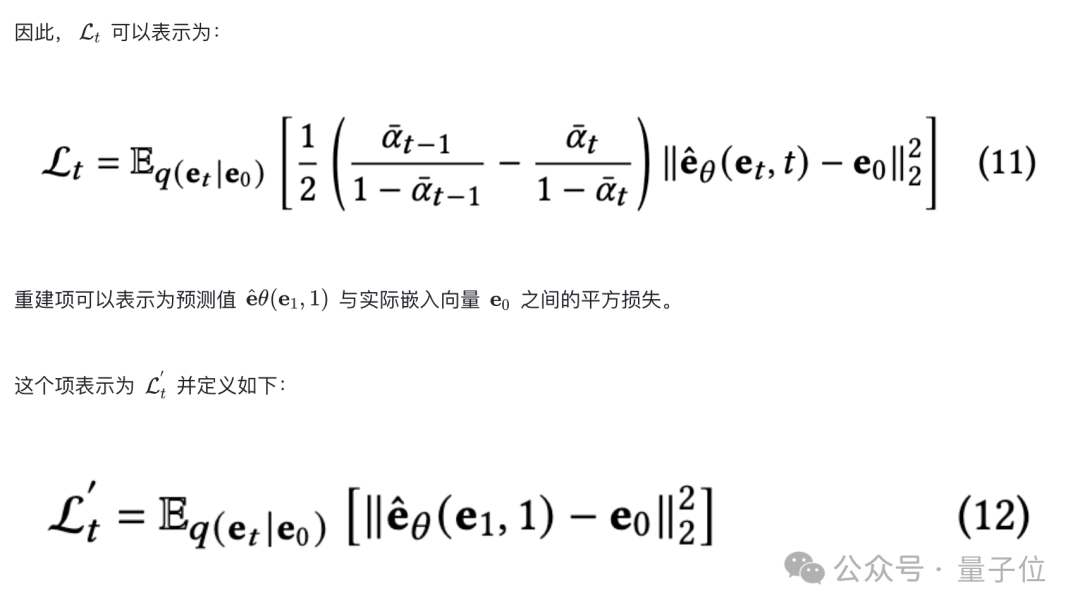

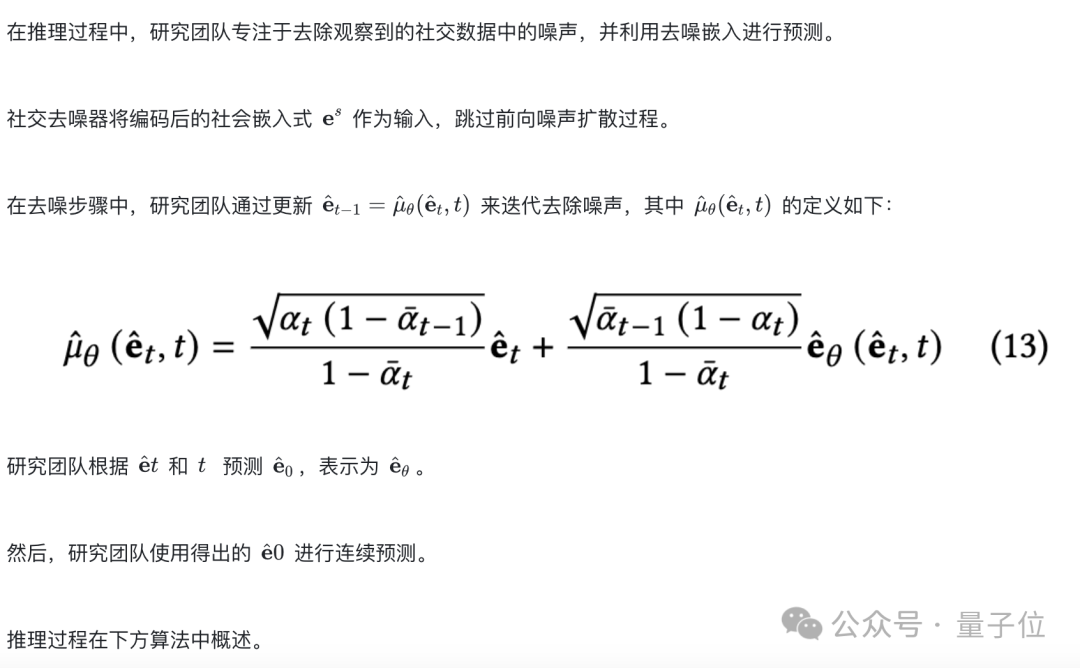

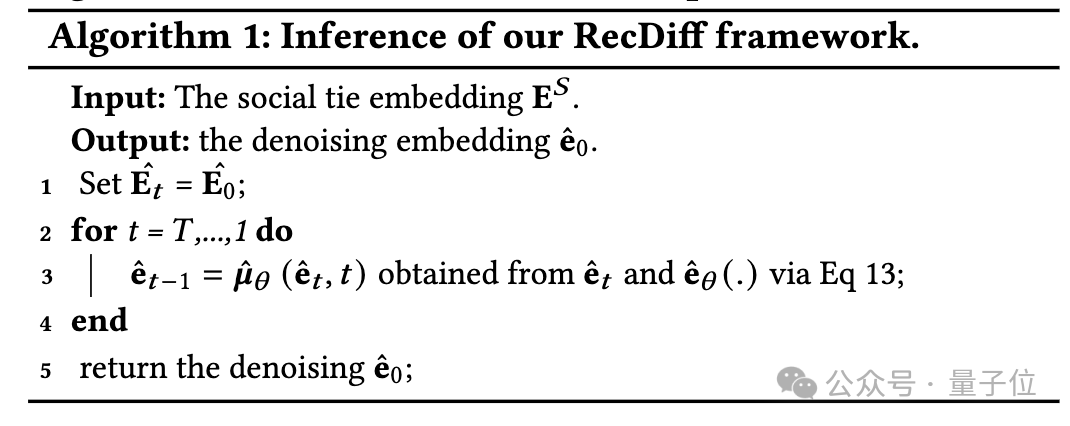

如上图所示,该隐空间社交扩散过程可通过以下公式进行精炼表达:

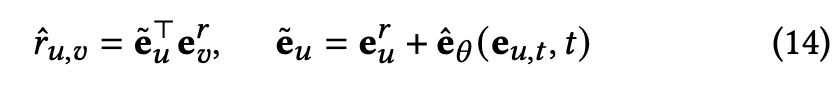

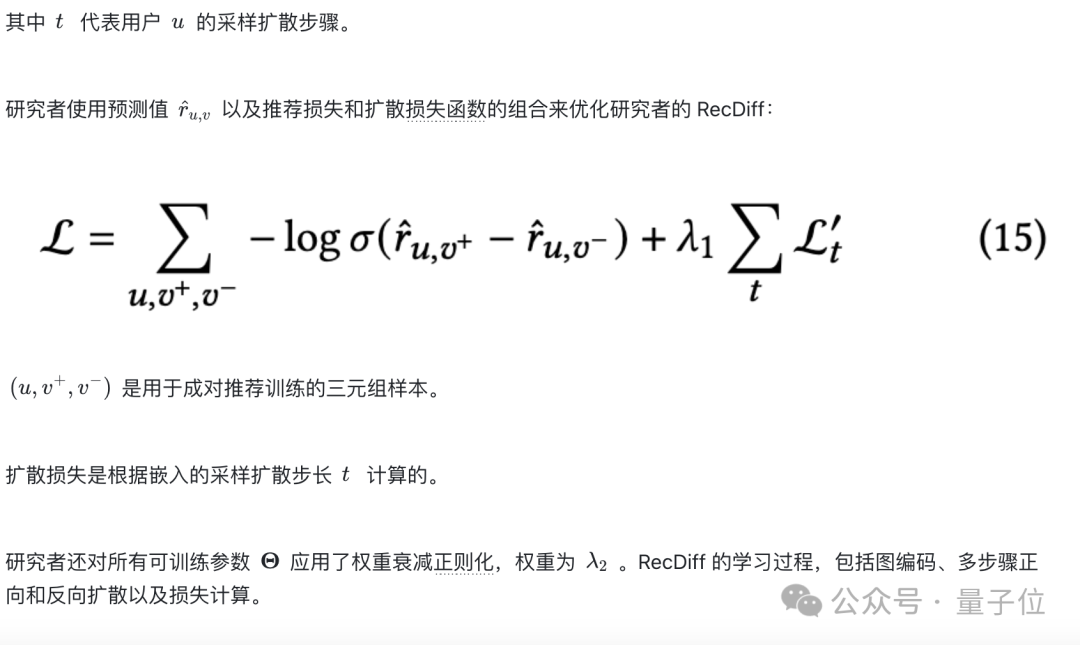

利用隐空间社交扩散模块,研究者将去噪后的社交关系与编码后的交互范式结合起来,以获得预测的最终嵌入。

具体方法如下:

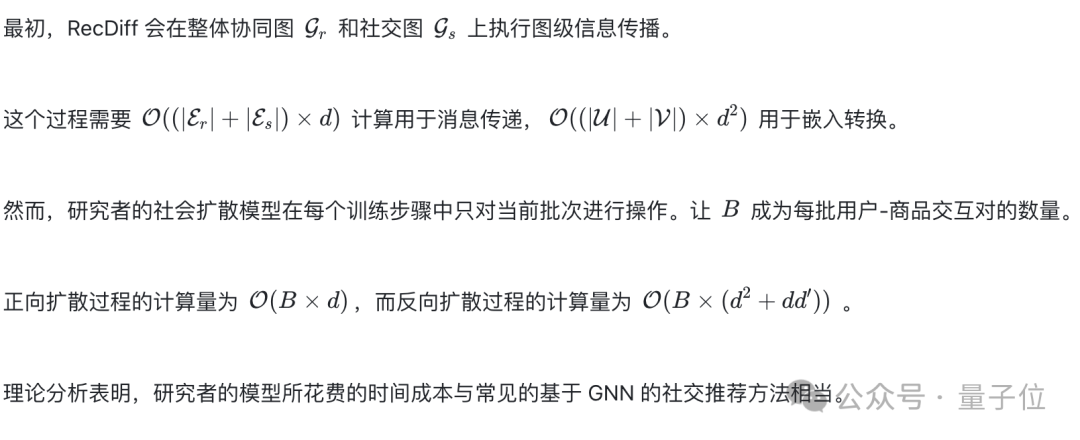

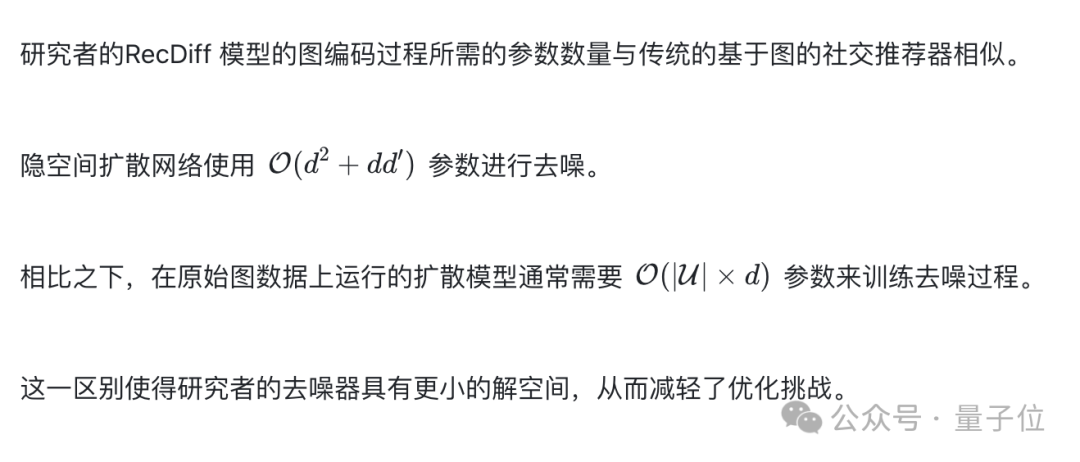

本节全面分析了研究者的 RecDiff 与社会扩散模块在时间和空间上的复杂性。

空间复杂性。

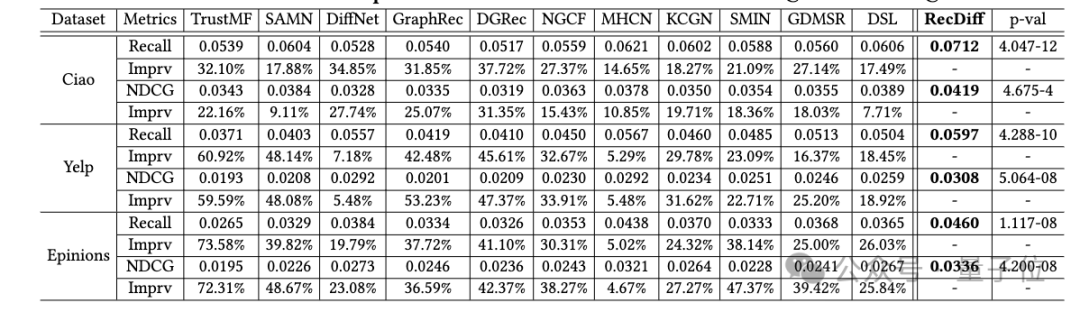

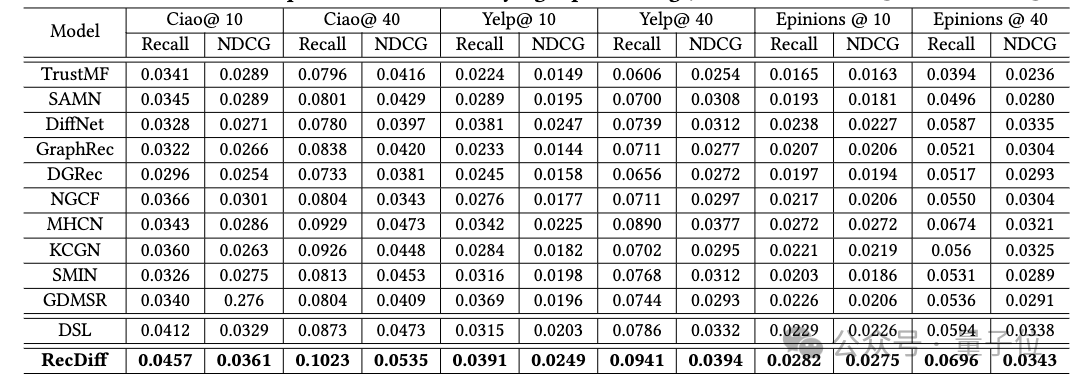

团队比较了团队的模型与基线模型的整体推荐性能。

top-20和不同top-N的验证结果列于下表:

团队的RecDiff始终优于最先进的基线,展示了卓越的推荐准确性。

T 检验证实了团队的结果在所有数据集和评估指标上的统计意义。

在不同的top-N设置中,RecDiff的性能优势保持一致。团队的基于扩散的社交关系去噪模块可以去除无关信息和虚假信息,从而使RecDiff有效地挖掘有价值的社交关系以增强推荐效果。

一些社交推荐方法如(DGRec、DiffNet 和 GraphRec)的表现比与社交信息无关的方法NGCF差。这表明,由于虚假或不相关的成分,社交关系会对用户-商品关系建模产生负面影响。

团队的RecDiff框架通过对社交信息去噪来解决这个问题,其性能始终优于基线模型 GDMSR。它能有效过滤社交关系中的噪音,识别有意义和有影响力的社交关系,准确编码用户偏好,从而实现精准推荐。

包含自监督学习(SSL)的基准方法在推荐性能上一直优于其他方法。MHCN、KCGN和SMIN等方法利用了局部-全局互信息最大化技术的变体,而 DSL 则采用了预测对齐自监督任务的方法。

这凸显了辅助监督信号在解决社交推荐中的数据缺陷难题(如噪声和稀疏性)方面的积极影响。

相比之下,团队的模型引入了一种基于扩散模型的多步骤去噪方法,在不同的噪声水平下生成更多的监督信号。这种强大的去噪能力带来了超越基线的卓越推荐性能。

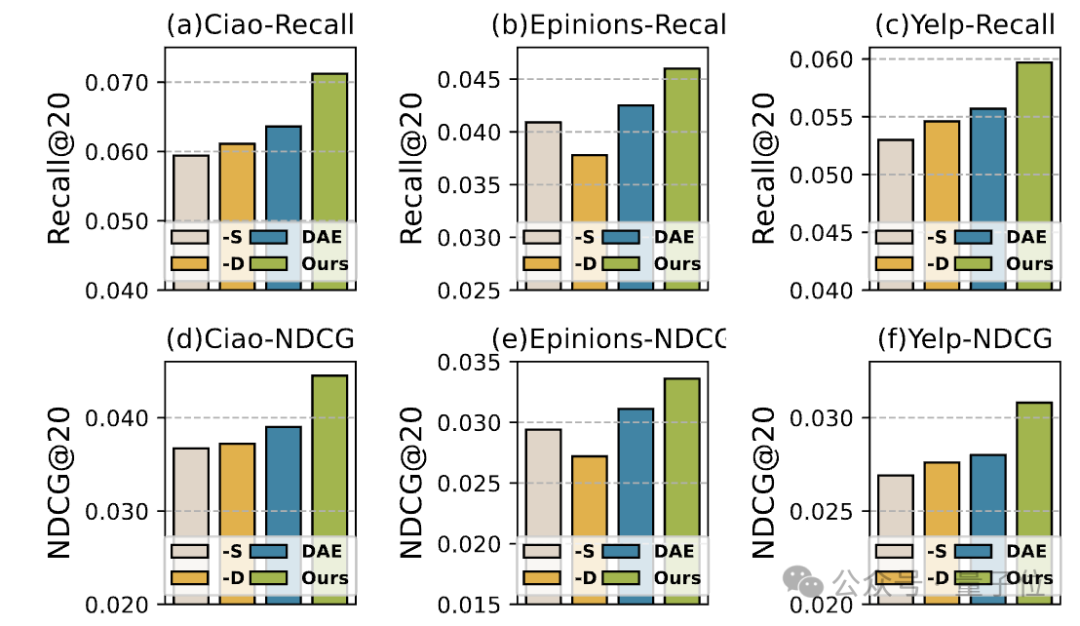

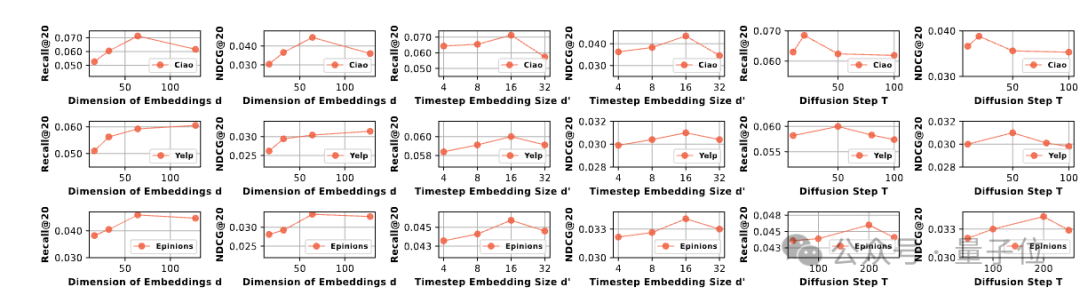

团队将通过一项消融研究来探讨RecDiff框架中不同子模块的影响。团队评估了通过删除或替换基本模块而获得的几个变体的性能。

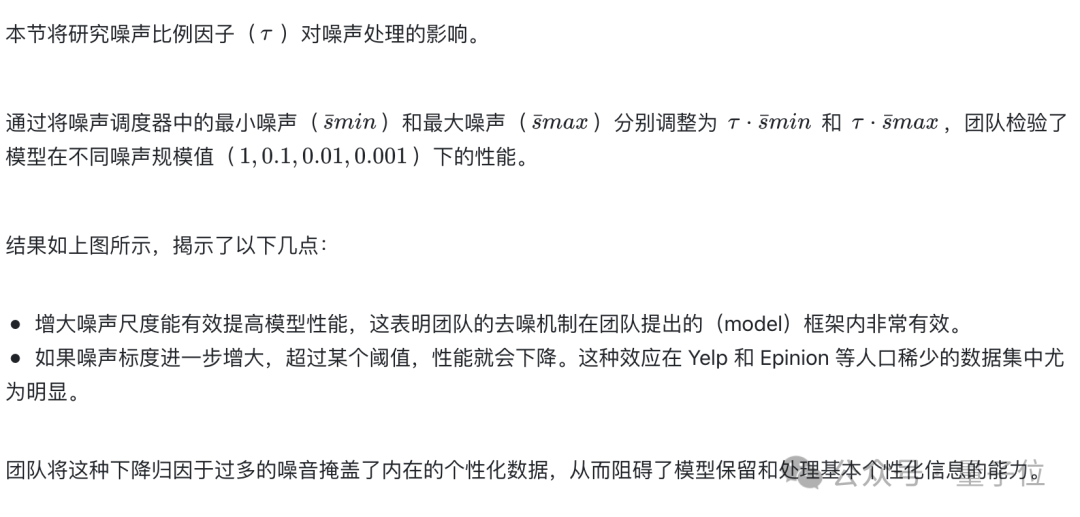

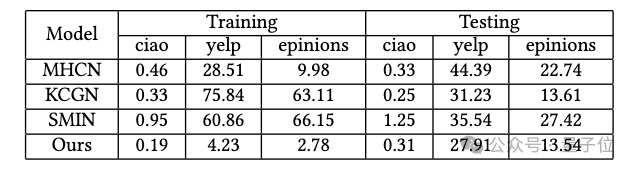

与基线模型(MHCN、SMIN 和 KCGN)相比,团队在 Ciao 和 Yelp 数据集上优化 RecDiff 的效率。

RecDiff在训练和测试中都表现出了明显的效率优势。对于每个训练历时,团队都评估并记录了测试集的性能,以分析改进情况。

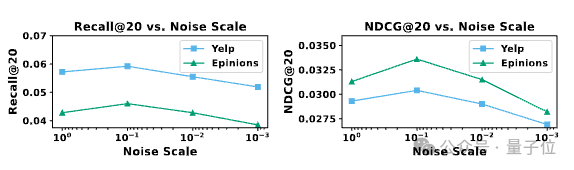

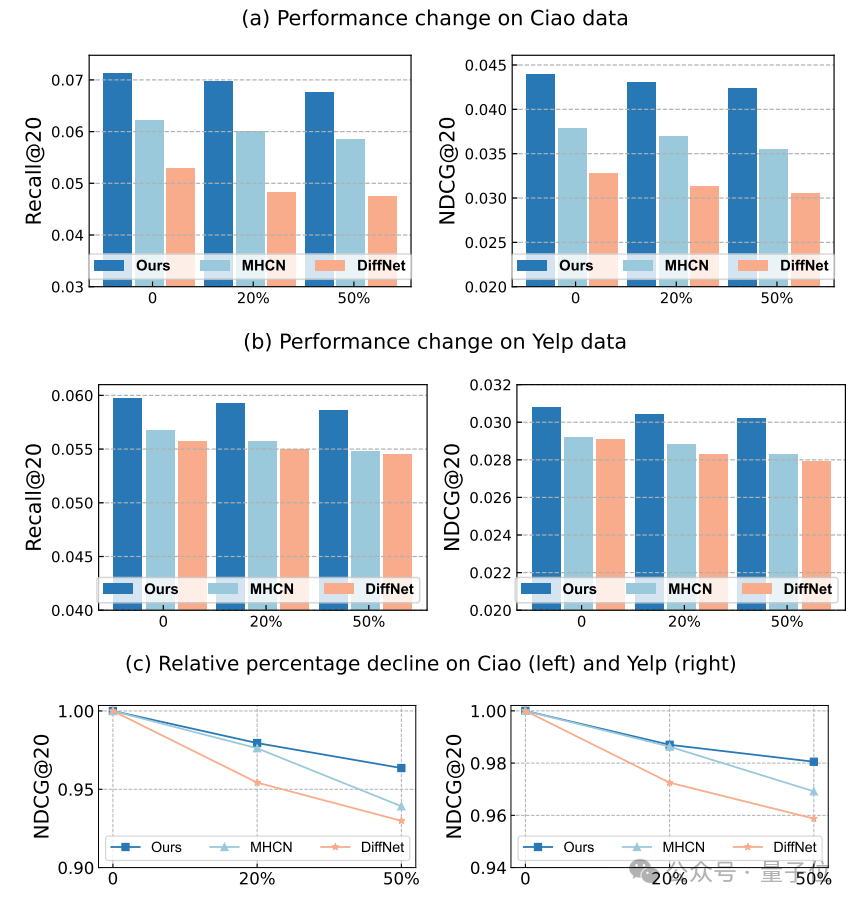

团队评估了 RecDiff 在数据噪声情况下的鲁棒性,方法是在用户-用户图中引入随机虚假边来替代不同比例的真实社交连接。

然后使用被破坏的图对模型进行重新训练,并在真实测试集上进行评估。

具体来说,团队分析了用噪声信号替换 0%、20% 和 50% 的社交关系的效果。

比较 RecDiff 与 MHCN 和 DiffNet 的性能,上图(a)和(b)中的结果显示了原始评估结果,而(c)则说明了 NDCG 的相对性能变化。

基于这些结果,团队可以得出以下结论:

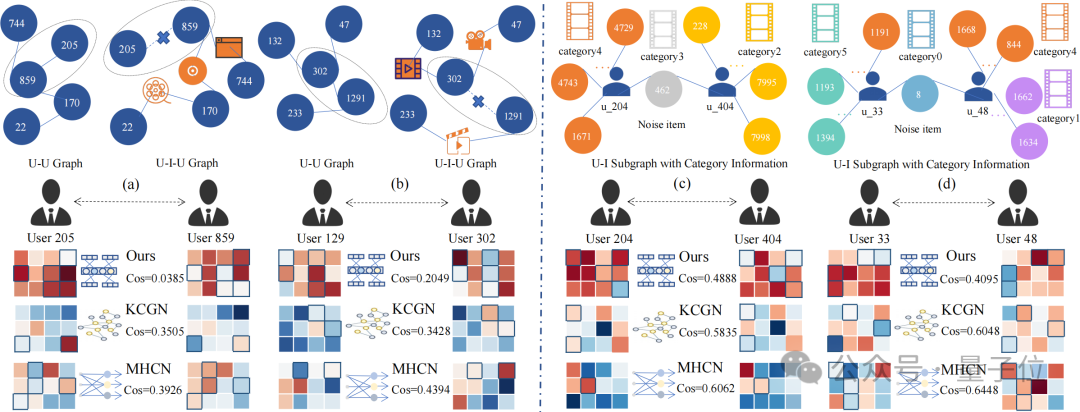

团队探讨RecDiff在特定用户/商品案例中的去噪效果。

图中展示了四个子图案例,突出了去噪的必要性。

基线方法KCGN和MHCN无法识别错误的社交连接,导致这些错误社交邻居的相似性得分很高。

相比之下,RecDiff能有效识别这些噪声实例,显著降低相似性得分,并为虚假连接的用户生成不同的嵌入。

这些发现证明了 RecDiff 在不同噪声情况下的出色消噪能力。

图中还介绍了另外两种情况,即用户对共享的交互商品在类别上与用户交互的其他商品存在显著差异。

这些孤立的交互很可能存在噪声的商品,从而使相关的社交链接也变得有噪声。

RecDiff 再次成功地识别并消除了这些噪音,为虚假的社交邻居分配了较低的相似性分数并生成了更独特的嵌入。

这些案例进一步体现了 RecDiff 方法的出色去噪效果。

项目团队提出了一种名为RecDiff的新型扩散模型,旨在通过消除用户之间噪音社交链接来增强社会化推荐系统。

RecDiff采用多步噪声传播和消除的训练方式,在隐藏空间中运行,利用编码的用户表征,实现了高效和简单的设计。

通过在不同扩散步骤下对模型进行训练,RecDiff 展现出了出色的噪声处理能力,能够有效应对各种类型的噪声影响。

研究图那对在真实世界数据集上评估了模型的性能,结果显示相比现有方法,RecDiff在推荐准确率方面取得了显著提升。

未来,RecDiff团队计划将RecDiff拓展到更多推荐场景中,并结合多模态信息,进一步探索该模型的潜力和应用价值。

文章来源于“量子位”,作者“关注前沿科技”