在经历了发布会蜂拥而至的Q2之后,AI领域近来似乎进入了 “冷寂”状态。

资本市场对于AI的狂热似乎突然停滞下来,接下来行业会怎样发展?这是最近我们与从业者最常聊起的话题。本篇文章我们从技术-经济演化周期的角度,讨论如何看待当下AI发展阶段和市场情绪,总结AI最新现状,同时分享我们对于AI趋势的观察和判断。

总体而言,我们相信本轮AI是一次颠覆式的技术革命,对它的长期前景非常乐观。就短期而言,在最初的狂热过后,市场的确逐步揭示了AI所面临的一些困难与挑战。回看历史,每次的技术创新都是在挑战一些“不可能”中逐步发展的。面对新的技术周期,做一个长期主义者,坚持活下去、stay on the table,是最重要的。以此与读者共勉。

继5月GPT-4o发布会之后,OpenAI已经很久没有放大招了。

事实上,业内人士也一直认为GPT-4o只是OpenAI用来应对Google Gemini发布会的“临时抱佛脚”,算不得严格意义上的里程碑。大家真正期待的GPT-5,却一下推迟到了明年底,让很多人猜测是否新一代大模型技术突破受阻,竞争对手们也纷纷利用这个时间窗口快速赶上。Claude被越来越多的企业使用,开源Llama展现了惊人进展,中国大模型在快速追赶,大模型厂商开始陷入激烈的价格战……

眼下,这一代大模型技术主要的壁垒似乎只剩下了“钱”和“卡”;另一方面,AI 应用的营收增长却显著慢于基础设施的投资规模。红杉合伙人David Cahn近期两次撰文,认为现阶段AI基础设施投资与产生的营收之间的差距已经从1250亿美元上涨到了5000亿美元。这种残酷的烧钱游戏,让许多没有足够“钞能力”的创业公司变得举步维艰。

今年以来,Inflection、Adept、Character.ai等一批之前拿到大额融资的明星创业项目相继卖身,似乎为这一担忧提供了最好的论据。独立发展的一些明星项目也频频传出负面——OpenAI持续不断的管理层动荡,Stable Diffusion团队变动,曾被媒体热捧Humane和Rabbit在产品发布后口碑集体扑街,Devin被质疑演示造假,Harvey被一众投资人痛批“毫无价值”……

我们不得不面对一个残酷现实:在经历了一年多热火朝天的建设之后,AI至今仍没有找到特别好的PMF。而AI创业对于资金、算力资源和优质数据持续不断的需求,让许多明星团队不得不选择“抱紧大腿”,巨头主导的行业整合已经开始。

难道AI真的是泡沫吗?我们应当如何理解和应对当下这些“骨感”的现实?

历史不会重演,但背后总有惊人的相似。

看不清楚未来的时候,跳出来看看历史的演化会给我们带来启发。著名演化经济学家Carlota Perez从技术革命发展的角度所提出的"技术-经济周期"理论,为我们理解当下AI的行业现状和预判接下来的发展节奏,提供了一个很好的理论框架。

技术-经济的范式变迁

Perez深入研究了自工业革命以来五个重要技术革命周期,发现这些技术革命及其背后所带动的经济与社会变革始终遵循着某种规律——她称之为“技术—经济范式变迁”。通常,创新技术所带来的技术革命可以的分成两个周期、四个阶段——安装期(包括爆发阶段与狂热阶段)及实施期(包括协同阶段与成熟阶段)

新技术崛起的早期是一个爆炸性增长阶段——金融资本被潜在的超高利润所鼓舞,迅速投资运用新技术的企业和所需的基础设施。投资的涌入使“新事物”们看起来非常强大。

然而,由于应用发展的落后,这些先行过度的投资在短期内并不能全部转化为商业价值的创造,两者矛盾不断累积,最终导致在“狂热阶段”的尾声,泡沫被刺破。

但在泡沫破裂之后,新技术经过一段时间的转折调整迎来真正的实施期——即应用大爆发的黄金时代。纵观历史,技术革命中每次过剩的基础设施投资都为后续的应用大爆发铺平了道路,这是新技术普及的必要过程。只要泡沫背后是真正有用的技术突破,技术革命最终总会不可阻挡地展开。

回到这一轮AI,我们认为目前正处于大模型技术崛起的“爆发阶段”,这个阶段基础设施的投资大大高于应用的发展速度。

AI基建投入与营收存在巨大鸿沟

关于AI基础设施的投资规模,我们可以做个简略的估算。去年Nvidia数据中心GPU收入约475亿美元,今年前两季度近500亿美元。GPU在AI数据中心成本占比约为50%(剩下50%包括能源、建筑物、备用发电机等)。据此可估算出23年初到24年Q2,投入在AI数据中心的成本已接近2000亿美元。

那么迄今为止AI实际上产生了多少营收呢?

OpenAI最新数据表示其年化收入为34亿美元,Anthropic约为10亿美元。沿用David Cahn文章中对大厂AI产品收入的假设——假设Microsoft、Google、Meta、Apple每家从其 AI 中获得100亿美元,Oracle、字节跳动、阿里巴巴、腾讯、X 和Tesla每家通过AI获得50亿美元收入。按照这个极其乐观的假设,AI实际的年化收入一共约750亿。

这么看目前基础设施投入和应用的实际营收有巨大的差异。如果产业生态良性发展,应用层还需要有合理的利润空间,对应的收入要求就更高。

红杉合伙人David Cahn近期两次撰文,认为现阶段AI基础设施投资所要求的营收回报与AI实际可产生的营收之间的差距已经从1250亿美元上涨到了5000亿美元。然而,基建的投资还在继续,在短期内这个差距还会持续拉大。

Stay on the Table

一些投资机构对此产生担忧,高盛在日前的研究报告中直接发问:现在的AI是不是花得太多、赚得太少了?

回看过往的几次技术革命,这种基建的扩张都是一个必经阶段。根据Carlota Perez总结的历史经验,随着AI基建投资的持续扩张,如果在未来一段时间(我们预估是12-18个月内)应用层仍然没有出现Killer App, 我们很可能会看到这轮AI热潮泡沫被刺破。但是泡沫破裂并不意味着行业的终结。

相反,它往往是一个优化资源配置的过程,为后续产业的真正爆发蓄力。在泡沫破裂后,那些真正具有核心技术优势、商业模式可持续的企业将会脱颖而出,占据新产业链的关键节点,成为下一个谷歌、苹果或亚马逊。

对于想投身拥抱这场技术革命的创业者而言,保持清醒和耐心,活下来,stay on the table是最重要的。(对Perez理论感兴趣的朋友,推荐阅读她的著作:《技术革命与金融资本》 “Technological Revolutions and Financial Capital: The Dynamics of Bubbles and Golden Ages”)

今年,大模型领域的竞争格局相比去年有了戏剧性的变化——随着GPT-5推迟发布,OpenAI领导者地位不再稳固,竞争者快速赶超,纷纷报告单场景/全面评测追平甚至超越 GPT-4o的性能。

与此同时,随着Llama3.1的发布和扎克伯格对开源的公开承诺(他愿意为开源投入大量资金),开源已经越来越受到关注。

考虑到竞争对手们追赶GPT-4o只用了12-18个月,我们不得不开始认同一年多以前Google内部那个惊人的结论:基于Transformer架构的大模型,大家都没有什么壁垒。与当年阿波罗登月的系统工程相比,如今大模型的壁垒确实小得多。如果没有模型架构和算法的实质性创新,可能只有算力勉强算作壁垒,但这其实只与每个公司的资金储备及融资能力相关。

GPT-5发布会改变这个格局吗?目前看起来很难。OpenAI摸着石头过河、其他人摸着OpenAI过河的路径已经形成,作为探路者OpenAI总是要花更长的时间,一旦明确方向给出benchmark,其他人赶超的用时就是会少得多。这样推演,大模型领域的胶着局面和激烈的价格战短期内是很难打破的。

另一方面,开源大模型正迅速缩小与闭源模型的能力差距。值得注意的是,这些开源项目背后站着一众科技巨头——Meta、Amazon、Microsoft、Google、阿里巴巴以及Apple。对这些公司而言,大模型的直接盈利并非首要目标,维护其在科技生态中的垄断地位才是关键。

在此背景下,头部大模型创业公司面临严峻挑战:如果不能持续突破技术瓶颈,构建深厚的技术壁垒,开源很可能会摧毁闭源大模型公司的商业模式,或迫使大模型公司转型侵入AI应用市场。

巨头的游戏:初创公司收购潮

今年以来,硅谷AI领域迎来收购潮,多家明星公司被巨头收购。其中最受关注的,包括Google以25亿美元估值收购Character.ai, Microsoft收编Inflection团队以及Amazon收编Adept团队。还有更多的AI独角兽被曝正在寻求并购。

这几家明星独角兽的初始定位都是大模型公司。而随着大模型卡位战结束,没有拿到足够多资金支持的团队只能寻求卖身。对巨头而言,通过收购AI初创公司可以快速获得核心人才和技术,加速完善自身的AI布局。AI大模型领域正在演变成巨头的专属游戏场,早已没有创业公司的机会。

AI基建:停不下来的巨头军备竞赛,应用成本持续降低

虽然AI应用的短期收益完全算不过来账,但对AI基建的疯狂投入并不会因此停下。目前推动着AI基建快速扩张的,不仅仅是市场对于AI商业前景的判断,还有云计算市场激烈的竞争博弈。

对云计算厂商来说,AI既是威胁,也是目前能看到的最大机遇。没有人敢坐等观望,竞争使他们必须立即采取行动。Microsoft、Amazon、Google——这三家市值总和超7万亿美元的巨头,正陷入一场军备竞赛。一家的升级会激励其他竞争对手迅速赶上。这个循环会自我强化,而资源供应的限制又加速了这种动态:如果你不去抢占GPU、电力和人才,别人就会。在这样的生存游戏中,如果竞争对手投入,那么最好的策略就是投入。而大厂有源源不断的资金来支持这场军备竞赛持续升级。

基础设施建设的过剩对应用开发者而言是件好事。在基建投资的爆发期,底层模型的价格战让AI智能接近Commodity,应用开发者受益于不断降低的计算成本和大模型能力,得以更快地探索AI领域的机遇。

AI应用:2B与2C,冰火两重天

在AI应用领域,一直被讨论的焦点就是AI应用还没有找到特别好的PMF(Product Market Fit) ,事实真的如此吗?

几个月前,我们就曾提出观点:这一轮AI并非没有PMF,只是目前很多PMF是在大厂内部落地,做其业务的降本增效,而没有以产品或者服务的形式向外界提供,不被外部所知。大厂的实践虽然未必是属于创业公司的机会,但证明了 AI 的商业价值,随着技术成熟和大模型成本下降,一定会逐步外扩惠及更多的企业与消费者,带来更多创业的机会。

过去半年市场情况也初步印证了我们的观点:虽然2C领域的AI应用在PMF和商业化上遇到了比较大的挑战——始终没有出现一款真正的杀手级应用(即使流量最大的AI应用ChatGPT,在各种数据指标上仍然离“杀手级应用”有较大距离),头部产品如Character.ai和Pi,最终卖身大厂;AI搜索领头羊Perplexity也决定将商业化重点转向2B。

但反观2B领域,虽然鲜少占据头条,却在实际应用中稳步前进。多个行业的企业级AI解决方案不仅达成了PMF,还逐步建立起可持续的盈利模式,展现出可观的商业潜力。

Lightspeed在5月发布的对50多家美国大型企业(1000名以上全职员工)企业级AI应用/基础模型应用的调查,展示了AI在2B领域进展之快——“企业(尤其是大型企业)过往采用新技术的速度非常慢。即便在AWS推出近20年后,仍有近50%的企业工作负载尚未迁移到云端。生成式AI的初始采用速度惊人,通常由公司高层自上而下推动。

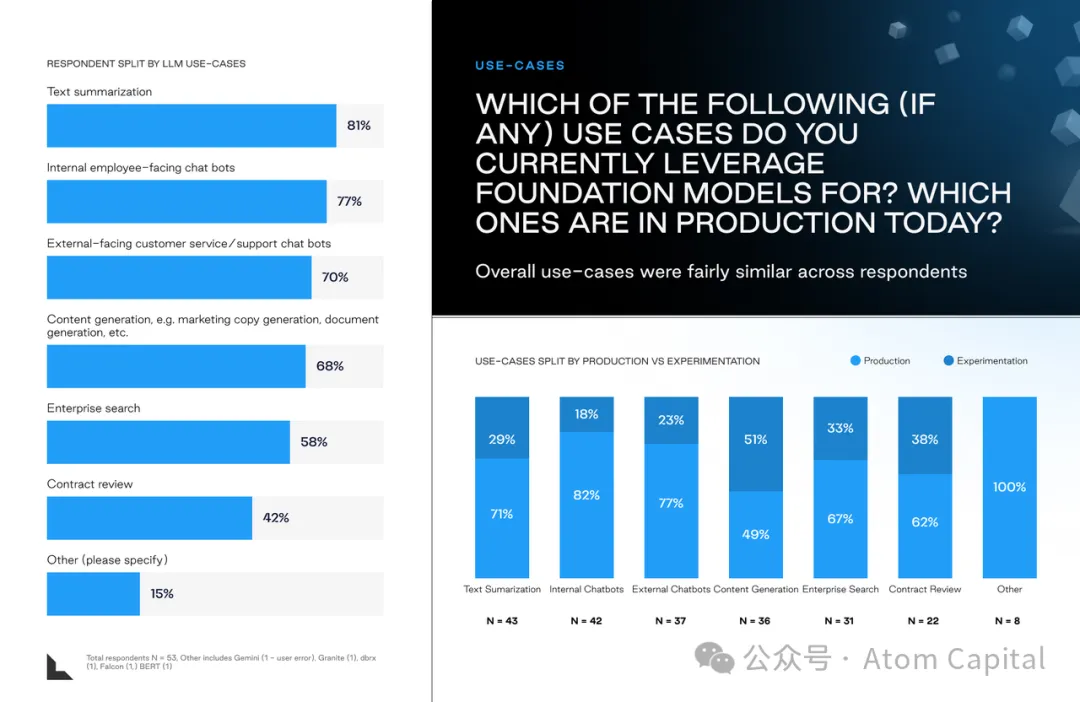

我们访谈过的大多数公司不是从1或2个用例开始,而是决定快速尝试广泛的用例,包括聊天机器人、内容生成、企业搜索和合同审查等。目前这些用例仍以内部为重点,因为企业管理层希望更好地了解当前模型的安全和隐私挑战并评估潜在的质量缺陷。”

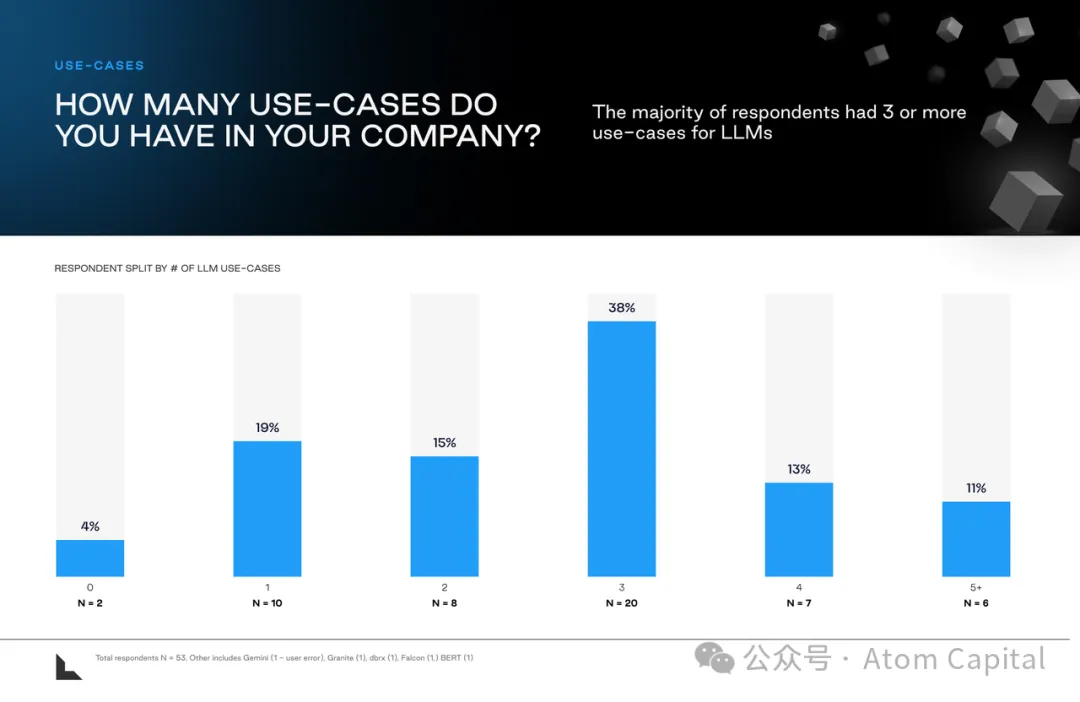

Lightspeed调查报告:接受调查的大多数公司都有三个或更多基础模型用例。超过 60%受访者表示,其组织已经有3个以上用例在某种程度上利用了生成式AI,而不是慢慢逐个引入新用例。

Lightspeed调查报告:受调查公司的AI用例涵盖从文本摘要到内部聊天机器人、外部支持聊天机器人、企业搜索、合同审核等各个方面。

不少2B创业项目初步跑通了PMF,在很短时间内收获了快速增长的ARR,典型代表包括:

2B与2C的AI应用在寻找PMF上所呈现的“冰火两重天”,仔细想来并不令人意外。2B的AI应用能更好地解决具体业务痛点,是因为企业内部专业人员对自身的问题和需求有明确的认知,问题边界清晰,付费意愿明确,找到正确的问题就意味着已经成功了一半。相比之下,C端AI应用面临的问题往往更抽象,需要相当的洞察力和产品创造力,同时也更容易遇到科技巨头的直接竞争。

两代模型之间,Post-training成为重点

我们现在正处在GPT-4之后、GPT-5之前的时代,竞争对手对GPT-4o的快速追赶使得该级别的AI智能已经成为Commodity。创新已开始转向Post-training阶段,我们在观察许多AI创业者的实践中注意到,它可以提升底座模型的能力,产生许多惊艳效果,是许多应用开发者正在采用的方式。

视频模态的挑战与语音模态的突破

根据我们去年底对AI的预测,多模态是大模型今年的核心主题之一。年初几家头部厂商发布的新模型,但视频多模态的发展比我们的预期要慢,并没有看到期待中的多模态视频模型生成海量视频语料用于模型训练、解决大模型训练数据的不足并利用视频中动态的物理世界知识推动大模型推理能力的突破。也许还是对构建“世界模型”的困难预估不足,这个障碍可能不比Scaling Law智能涌现那条路径更容易,可能真正视频模态的突破还要再等待一些时间。

与视频模态相比,GPT-4o所演示的语音能力已经比较成熟。背后的基础是语音架构的革新——端到端处理和推理原始音频数据,而无需转录为文本再以原生音频做出响应。这种转变大大降低延迟,增强对情感、语调和情绪等非文本信息的理解能力,让AI语音比以往任何时候都更接近人类水平——更自然、更具对话性。

我们观察到,一波新的语音AI公司正在开发能处理繁琐和重复工作流程的语音Agent产品,解放销售、招聘、客服、管理中的人力去专注更高价值的工作。预计接下来这个领域将会有突破性的增长,也会有一些优秀的公司成长起来。

AI可及性

AI 可及性是最近模型小型化运动、分布式推理、以及 Llama3.1全技术栈发布推动的一个非常重要的趋势。

随着模型小型化,大模型不仅可以跑在本地的各种GPU服务器上,还可以很轻松地跑在Mac笔记本上或手机上。在热闹的模型小型化尝试中,Apple的入局无疑是该领域一个里程碑式的事件,其终端可以把大模型和AI直接带给世界上几亿的用户,这个推动力是无人能及的。再加上如今终端厂商的内卷程度,我们可以大胆预测,大模型的普及程度在未来一年内可能会有突破性进展——AI手机和AIPC成为标配的日子可能并不会很遥远。

基础设施生态

应用框架

目前LangChain和LlamaIndex已经成为AI新技术的发布平台,承载了各种最新的推理、工具调用、记忆等技术。然而,最近Meta推出的Llama Agentic System 和 Llama Stack Proposal很可能改变游戏规则。Meta丰富的应用框架经验和庞大用户群可以为这个新框架注入活力,让框架能够自带流量推广,这对LangChain和LlamaIndex并不是个好消息,对还想在应用框架领域创业的团队来说,更是如此。

AI的记忆与学习

过去一年我们观察到一个清晰的趋势,VectorDB作为AI记忆能力的基石,正被传统数据库巨头们悄然吞噬。传统数据库,尤其是 Cloud Database服务,开始提供Vector存储和查询能力,这种扩展比独立的VectorDB 有明显的技术及场景优势。如果去看目前Vector Search 的市场占有率,可能非常惊讶地发现,Vector Search市场的领跑者竟是MongoDB和ElasticSearch这些"老面孔",而非新兴的独立VectorDB公司。展望下半年,AI Knowledge Search与现有结构化数据的整合,可能是AI记忆和学习领域的一个不可逆转的趋势,传统数据库的 Vector扩展可能会继续扩大市占率。

此外,Microsoft上月推出的GraphRAG是大模型记忆领域一个重要进展。GraphRAG将基于图谱的知识检索与LLM相结合,捕获大规模文本信息中的实体、关系及关键声明,显著提升了知识检索的有效性,从而产生更准确的响应、控制大模型的“幻觉”; 在模型可解释性、可追溯性和访问控制方面也更好。而且一旦创建好知识图谱,构建和维护RAG应用都会更容易,大幅提升了开发效率。虽然,目前它的准确性和可靠性仍然不足,但它已经打开了AI的持续学习之路。

推理成本不断下降

推理成本是AI总算力成本中的大头,随着模型小型化及匹配多样化的芯片和设备,预计推理成本在未来几个月会进一步降低。当然,这同时也是Nvidia的生命线,如果不能持续跟上成本下降的曲线,Nvidia也会遇到 GPT-5 类似的发展瓶颈。

应用层

从 Copilot 到 AI Worker

AI应用的发展路径日趋明显。目前业界的共识,AI应用的演化大体会遵循自主系统的发展过程,即Copilot → Agent → AI Worker。

Copilot作为人类工作的辅助,为人类提供自然语言交互和知识搜索等基础功能,典型场景包括知识的收集与整理、基于知识生成文本或视觉结果等。在Copilot应用中,人依然是中心,是任务的主要解决者,AI只是辅助人更高效地工作,对原有业务流程与组织结构的影响较小。GitHub Copilot 是这类应用的成功典范,许多AIGC应用本质上也属于这⼀类。

Agent的核心能力是决策和独立完成某些任务。Agent执行任务过程中可能包括多项决策,通过交互、访问知识和数据、以及调用工具。理想的Agent应该是可以自我学习和完善、高度个性化的。在Agent领域,过去一年业界已经建立起一个基本的AI Agent架构范式,典型框架包括LLM Powered Autonomous Agents (Lilian Weng@OpenAI),Cognitive Architectures for Language Agents (姚顺雨@Princeton),Agentic Design Pattern (Andrew Ng) 等。

AI Worker的核心则是像人类一样融入社会组织,独立完成某个角色的工作,组织中可能包括多个独立的AI Worker。AI Worker的核心在于可以在工作中学习、接受培训,并且可以与其他的人或者AI协作完成复杂的工程项目。应用发展到这个阶段,会极大影响原有的业务流程与组织形态,产生全新的协作机制及工作流。

目前AI应用绝大部分还处于Copilot 阶段,但真正有潜力的AI应用不能止步于Copilot,至少需要能够独立决策和可靠地完成任务。所谓可靠指的是能够独立处理任务和决策中的各种特殊情况;而AI Worker则是远期目标。

从SaaS到SaS,AI将对软件行业产生巨大变革

随着AI应用从Copilot走向Agent,其对软件行业的巨大变革也在悄然发生——AI正在让软件行业从SaaS(Software as a service,软件即服务)转变为SaS(Service as Software,服务即软件)。

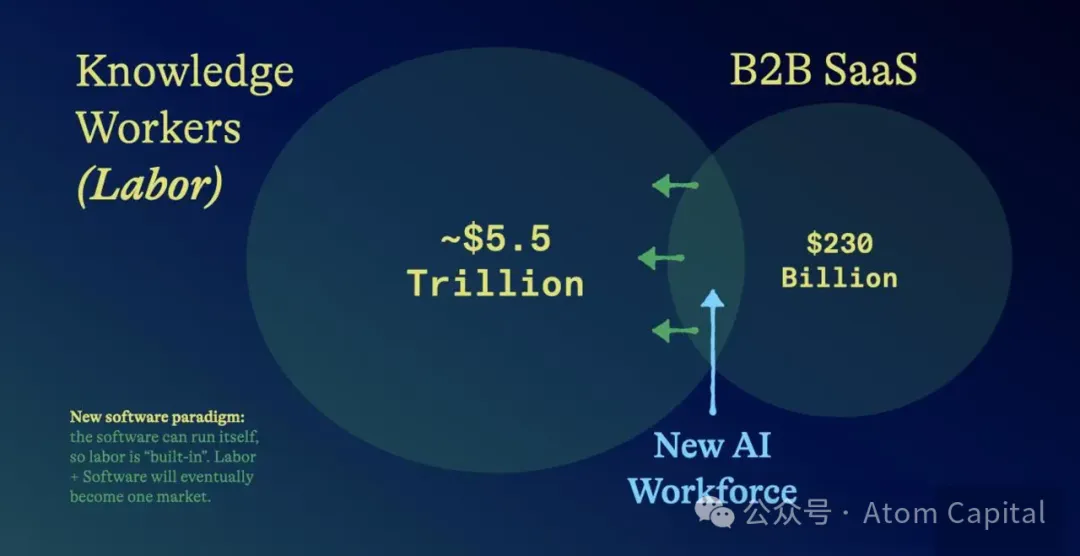

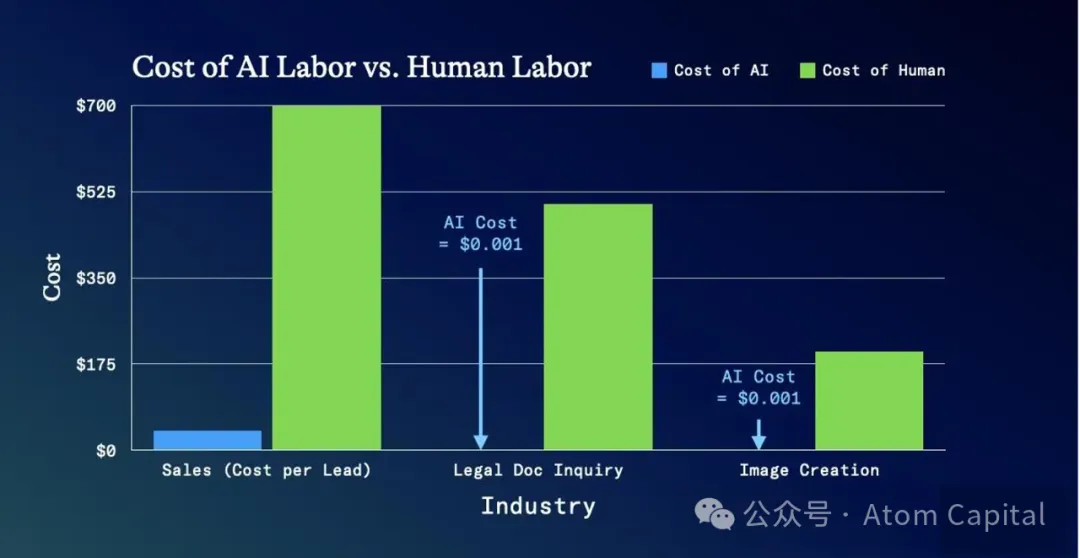

SaaS时代,软件的作用是“加强人”,去提升人的效率,但SaaS永远无法自行运行。它总是需要公司维持一支员工队伍来运营,比如企业可以购买营销类SaaS工具,但仍然需要雇佣并培训一个销售团队来完成工作。而SaS时代,软件既能组织任务,也能执行任务,客户无需雇佣额外劳动力,它们已经是“内置”的,企业购买软件就等同于雇佣员工——在前文的例子中,企业购买了一个销售AI Agent,就相当于拥有了一个可以24小时不间断工作的全职销售。SaS时代的到来,将导致传统的劳动力市场与软件融合成为一个全新市场。

这会带来两件事:

这两点都意味着,这是一个比SaaS更大的机会。

AI领域变化极快,我们希望能够找到一些锚点来观察技术和市场,从而更好地把握“转折点”。在此分享一些我们接下来会重点观察的指标:

文章来自于微信公众号Founder Park 作者Founder Park

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】MindSearch是一个模仿人类思考方式的AI搜索引擎框架,其性能可与 Perplexity和ChatGPT-Web相媲美。

项目地址:https://github.com/InternLM/MindSearch

在线使用:https://mindsearch.openxlab.org.cn/

【开源免费】Morphic是一个由AI驱动的搜索引擎。该项目开源免费,搜索结果包含文本,图片,视频等各种AI搜索所需要的必备功能。相对于其他开源AI搜索项目,测试搜索结果最好。

项目地址:https://github.com/miurla/morphic/tree/main

在线使用:https://www.morphic.sh/

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0