微软研究院最新研究揭示:一种悄然兴起的AI交互模式,正在改变我们与AI对话的方式。这项突破性研究不仅让AI更懂你,还能帮你更好地表达你的需求。

假如当你在使用ChatGPT这样的AI助手时,不用绞尽脑汁地编写完美提示词,而是通过简单的选择和调整就能获得理想的回答。这听起来像科幻小说?微软研究院的最新研究让这个想象成为了现实。

在当前AI迅速普及的背景下,一个有趣的现象引起了研究者的注意:即便是经验丰富的用户,在与AI对话时也常常感到力不从心。原因很简单,我们习惯了人与人之间的自然对话,但与AI交流却需要精确的"提示工程"。这就像是要学习一门新的外语,而且这门语言还在不断进化。

为了解决这个问题,微软研究院的团队开发出了一个巧妙的解决方案:动态提示中间件(Dynamic Prompt Middleware)。这个系统就像是在用户和AI之间加入了一个智能翻译官,它不仅能理解用户的意图,还能帮助用户更精确地表达需求。

想必每个使用过AI的人都经历过这样的场景:

1.脑力负担大:明明只是想让AI解释一段代码,却要绞尽脑汁地解释上下文。就像你明明只想问路,却要先解释你为什么在这里、要去哪里、走什么路线比较好。

2.摸不着头脑:同样的提示词,有时候AI能准确理解,有时候却答非所问。这就像是和一个时而理解力超群、时而丢三落四的朋友对话,让人捉摸不透。

3.专业场景更难:在处理代码、数据分析这样的专业任务时,问题更加明显。就像是要向一个外国专家解释一个专业问题,既要考虑专业术语的准确性,又要确保对方能理解你的意图。

研究团队对38名用户进行了深入访谈,发现了一个有趣的现象:用户们在使用AI时陷入了一个两难困境。

就像是在餐厅点菜:

更有趣的是,研究发现用户的需求会随着场景变化而改变:

想象一下一个现代化的同声传译系统,它不仅能翻译你的话,还能根据场合调整表达方式。动态提示中间件的设计就是基于这样的理念,通过两个核心模块的协同工作,实现了智能且灵活的交互控制:

1.选项模块(Option Module):你的AI对话管家

2.对话模块(Chat Module):AI响应的指挥家

这种设计的妙处在于:它既保持了与AI对话的自然感,又给了用户精确控制的能力。就像是给用户配备了一个智能遥控器,可以随时调节AI输出的各个参数,直到得到最满意的结果。

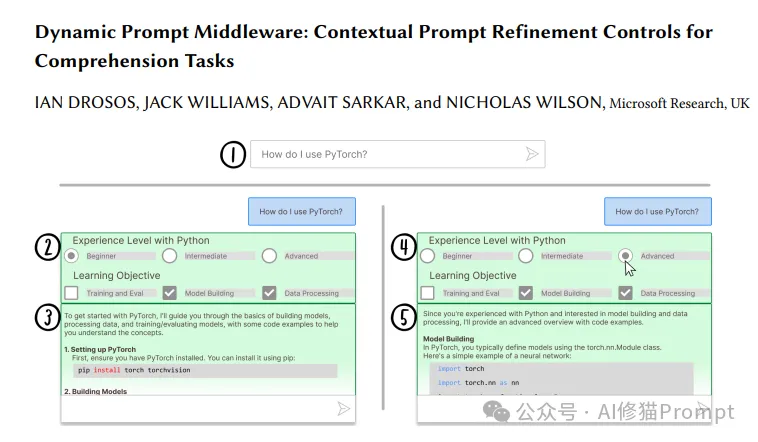

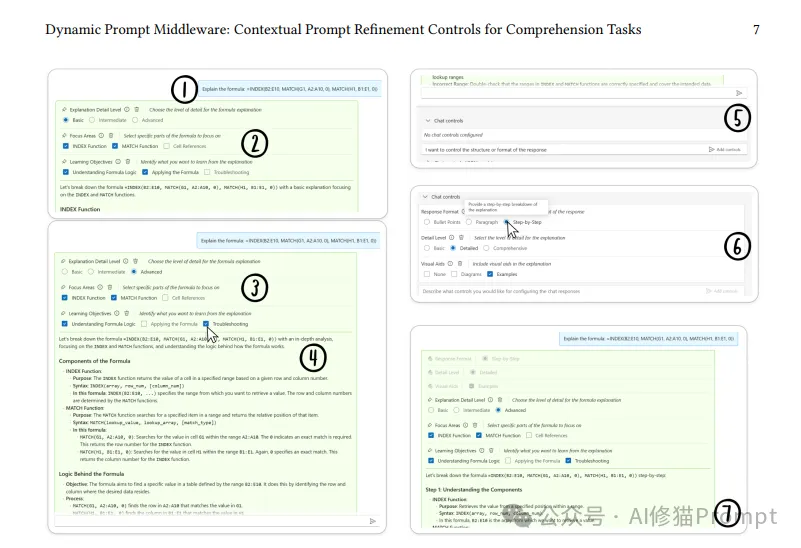

如下图Dynamic PRC系统的用户流程。(1)用户提交提示。(2)选项模块生成一组选项来帮助引导聊天模块的响应。(3)用户可以通过单击他们的首选项来更新发送到聊天模块的细化。(4)发生更改时,聊天模块会使用新选择的细化重新生成响应。(5)用户可以通过L提示请求控制。(6)选项模块根据该提示生成一组会话选项。(⑦)会话选项适用于聊天模块的当前响应和每个后续响应。

让我们跟随一位数据分析师小王的视角,看看动态提示中间件是如何帮助他理解一段Python代码的。这个过程就像是在一家高级餐厅,有专业服务员帮你定制完美的用餐体验。

小王正在查看同事留下的代码:

# 同事留下的数据处理代码

result = df.groupby('Category')['Total'].sum().reset_index()

result = result.sort_values(by='Total', ascending=False)

他想要理解这段代码的功能,于是简单地问道:「请解释这段代码的功能」

系统立即分析了小王的需求,就像一个经验丰富的服务员,提供了一系列个性化的选择:

基础设置区:

📊 解释深度

○ 基础:适合快速了解

○ 中等:包含主要细节

○ 详细:深入技术细节

内容定制区:

📋 包含要素(可多选)

□ 代码功能概述

□ 每行代码说明

□ 参数解释

□ 执行结果示例

专业度调节:

🎚 专业程度

初学者 --|--●--|-- 专家

个性化备注:

📝 补充说明

[这里可以添加特定的关注点或问题...]

小王根据自己的需求进行了选择:

系统根据小王的选择,生成了一个结构清晰的解释:

【代码功能概述】

这段代码正在处理一个数据分析中常见的任务:对数据进行分组统计并排序。

想象你在整理一份销售报表,需要看到每个产品类别的总销售额,并找出销售最好的类别。

【详细代码说明】

第1行代码分解:

df.groupby('Category')['Total'].sum().reset_index()

▶ 就像是把一堆收据按照商品类别分类

▶ 然后计算每类商品的总金额

▶ 最后整理成一个清晰的表格

第2行代码分解:

result.sort_values(by='Total', ascending=False)

▶ 相当于把所有类别按照销售总额排序

▶ ascending=False表示从高到低排列,让最畅销的类别显示在最前面

【运行效果演示】

假设我们有这样的原始数据:

类别 金额

食品 100

电子 200

食品 150

电子 50

处理后的结果:

类别 总金额

电子 250

食品 250

这个过程最妙的是,小王可以随时调整自己的选择:

系统会智能保留已有的解释中有用的部分,只对调整的部分进行更新,就像一个贴心的服务员,在保留你喜欢的菜品的同时,根据你的新要求做出调整。

这种交互方式的优势显而易见:

在推出动态提示中间件之前,研究团队进行了一系列严谨的实验,就像是一款新药在上市前需要经过临床试验一样。这个"临床试验"的过程不仅验证了系统的有效性,还带来了许多意想不到的发现。

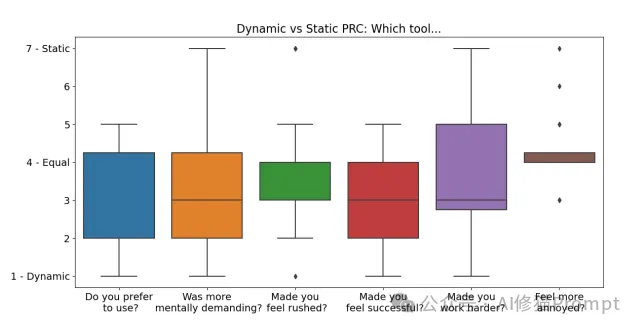

研究团队精心设计了一个对照实验,邀请了16位来自不同背景的参与者,让他们分别体验两种不同的交互方式:

1.动态提示细化控制(Dynamic PRC) 想象一个能根据你的需求实时调整的智能助手:

2.静态提示细化控制(Static PRC) 这更像是一个标准化的服务窗口:

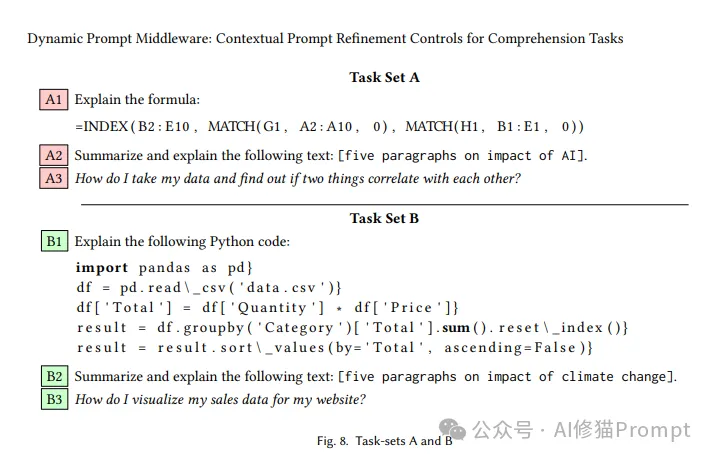

参与者需要完成一系列实际工作中常见的任务:

📝 代码理解任务

📊 数据分析任务

🔍 问题诊断任务

实验结果令研究团队感到惊喜,就像发现了一个意外的"副作用"是好事一样:

满意度评分对比:

动态PRC:⭐⭐⭐⭐⭐ (4.8/5)

静态PRC:⭐⭐⭐ (3.2/5)

用户反馈:

"感觉像有人在身边指导" - 初级开发者

"终于不用绞尽脑汁写提示词了" - 产品经理

"控制精确度令人印象深刻" - 高级工程师

任务完成时间对比:

动态PRC 静态PRC

简单任务 ▼ -35% 基准线

中等复杂度任务 ▼ -42% 基准线

高复杂度任务 ▼ -51% 基准线

🚀 平均效率提升:43%

新用户适应时间:

动态PRC:约15分钟

静态PRC:约45分钟

掌握程度:

首次使用后任务成功率:

动态PRC:87%

静态PRC:62%

在实验过程中,研究团队还发现了一些预料之外的好处:

1.知识积累效应

2.团队协作促进

3.创新思维激发

当然,实验也暴露出一些需要继续改进的地方:

🤔 需要平衡的问题

💡 改进方向

这些实验结果不仅验证了动态提示中间件的价值,也为未来的改进指明了方向。正如一位参与者所说:"这就像是给AI装上了一个用户友好的控制面板,让我们终于可以精确地表达我们的需求。"

1.提示系统设计

2.用户体验优化

3.开发建议

动态提示中间件代表了AI交互设计的一个重要突破,它不仅解决了传统提示工程的部分痛点,也为未来的AI交互设计提供了新的思路。这项研究表明,通过精心设计的中间件系统,我们可以显著提升用户对AI系统的控制能力,同时保持交互的自然性和效率。对于Prompt工程师来说,这种新范式提供了valuable的设计思路,值得在实际开发中借鉴和实践。研究表明,虽然动态提示中间件在某些方面还需要改进,但它代表了未来AI交互的发展方向。

如果您希望进一步了解或者需要更多提示,您也可以参照这篇文章《AI修猫Prompt公众号文章赞赏赠与资料分类汇总》对我进行赞赏支持,可以得到更多SYSTEM PROMPT。如果需要更多DSPy已经运行过的代码,或者据提的案例可以看下以下文章。希望这篇文章对您有所帮助!

文章来自微信公众号“AI修猫Prompt”,作者“AI修猫Prompt”

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0