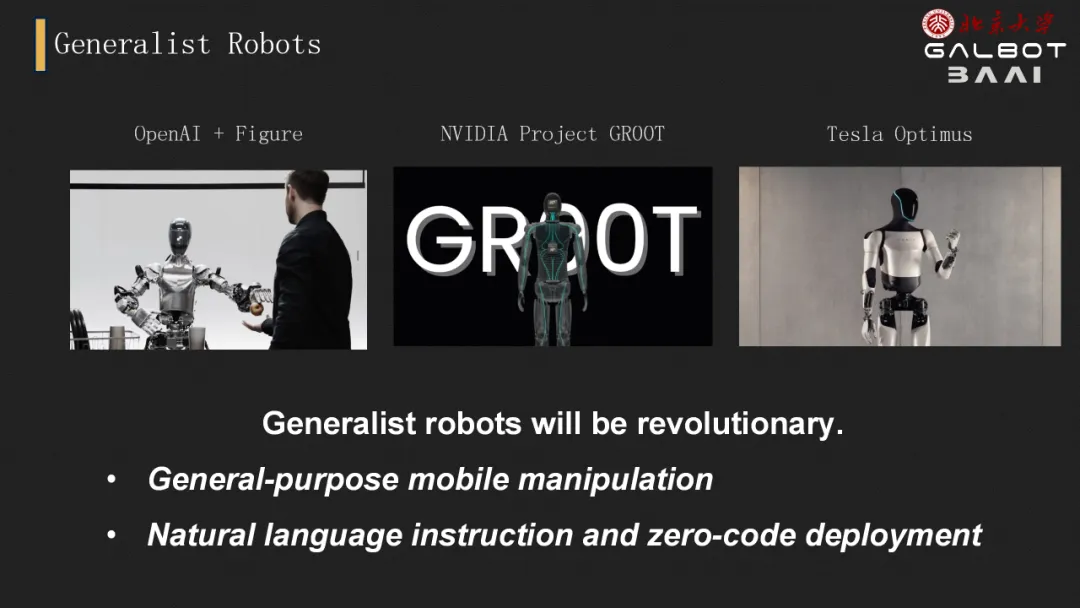

在探索迈向AGI(通用人工智能)物理世界的路径中,通用机器人被视作关键载体。相较于传统的专用机器人,通用机器人具备了自然语言沟通的能力,并且能够实现无代码、低成本的部署。然而,如何进一步提升通用机器人的智能水平,使其能够在广泛多变的环境中有效完成任务,当前已成为具身智能领域研究人员广泛关注的核心议题。

北京银河通用机器人有限公司创始人、CTO,北京智源人工智能研究院具身智能研究中心主任王鹤

2024年中关村仿生机器人大会上,北京银河通用机器人有限公司创始人、CTO,北京智源人工智能研究院具身智能研究中心主任王鹤分享了《通向通用机器人:合成数据驱动的具身多模态大模型》主题演讲,探讨合成数据驱动的具身多模态大模型最新研究进展。

通用机器人背后的技术核心到底是什么?北京银河王鹤表示,目前,一个比较主流的看法是,通用机器人应当基于一个大模型。这个大模型能够直接通过语言指令作为输入,视觉信号和机器人全身传感器信号作为传感器的输入,直接输出机器人身体上关节的控制信号。

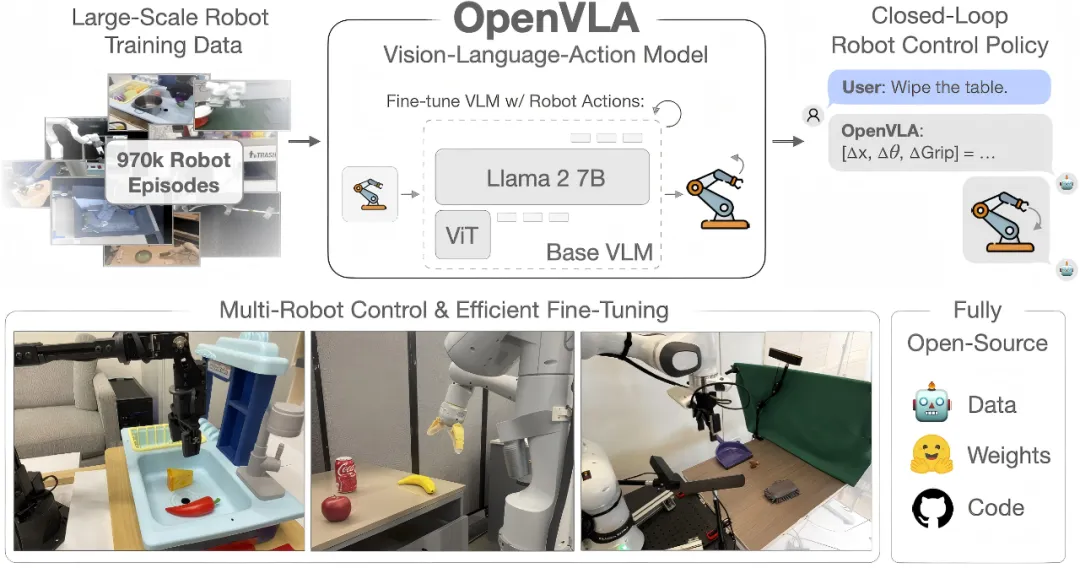

王鹤进一步解释道,以Google近两年的研究为例,该公司开发了一种端到端视觉语言动作大模型,该模型的特点在于将视觉感知、任务规划与底层执行机制融为一体。但需要关注的是,这样的模型应该训练在什么数据上才能胜任各种任务,这是世界范围内大家都在热烈激烈讨论的问题。

今年,世界机器人与自动化大会将最佳论文奖颁给了由全球20余所大学实验室合作构建的机器人数据集——Open X-Embodiment。该数据集主要通过特斯拉研究人员穿戴动作捕捉设备进行遥控操作,或采用主从遥控系统来获取数据。

The OpenVLA Model(地址:https://openvla.github.io/)

尽管Google团队基于这一数据集成功训练出OpenVLA模型,并开放源代码供全球研究者测试,但值得注意的是,国内多个实验室在实际测试报告中反馈,该模型在抓取任务上表现不佳,几乎无法成功抓取任何物体。模型仅在特定的实验室环境和数据采集条件下,对与训练数据相似的物体展现出一定的抓取能力。一旦环境、物体或摆放方式发生变化,模型便无法正常工作。

通过微调预训练的 Prismatic-7B VLM 来训练 OpenVLA

王鹤认为,这一问题的核心并不在于Transformer架构本身。现有的端到端自动驾驶大模型,如特斯拉和国内理想汽车等,都使用了高质量的自动驾驶数据。然而,机器人所做的事情比驾驶更难更复杂,涉及多种物体和非平坦的道路,其数据的获取既要保证量又要保证质,是一个巨大的挑战。靠人类去遥控机器人来产生高质量数据,恐怕很难在短时间内达到千亿条的量级。

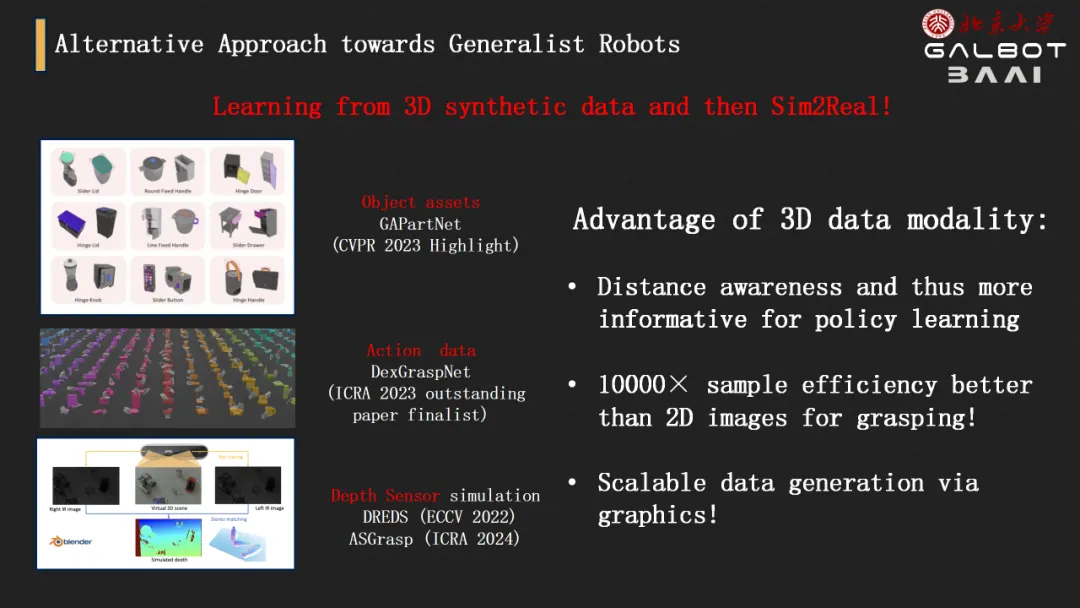

面对高质量数据获取问题,银河通用认为合成数据才是真正能够带领具身智能进入泛化、进入通用的基石性数据。王鹤指出,采用三维合成数据是更为有效的路径,因为它能够拥有几何模态,而不仅仅是RGB图片这种模态。

以物体抓取任务为例,实际操作中,物体的颜色并非决定性因素,其核心在于物体的几何形态。例如,对于方形物体,合适的抓取方式是夹持其两侧;而对于球形物体,则需用手掌包裹。颜色往往引入大量无关信息,要求神经网络通过大量数据学习以排除颜色干扰,专注于几何特征的识别与处理。

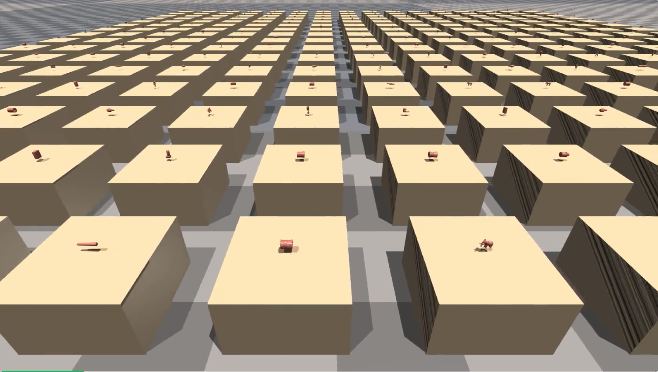

如果使用三维几何模态,即点云来学习抓取,就不会遇到这些问题。银河通用的技术路线是,是先将视野从二维视觉拓展至三维空间,利用双目红外传感器获取信号,并结合一个扩散模型来精确学习深度信息。该模型在自研的千万场景合成大数据上进行训练,覆盖各种各样桌面,前后左右物体,杂乱材质等。经过训练后,研究人员可以在真实世界直接进行测试。

UniDexGrasp算法由北京大学王鹤研究团队与北京通用人工智能研究院、斯坦福大学、清华大学合作提出

首先从二维视觉提升到三维世界,使用双目的红外传感器信号和一个扩散模型学习深度。这个模型在自研的千万场景合成大数据上进行训练,覆盖各种各样桌面,前后左右物体,杂乱材质等。经过训练后,研究人员可以在真实世界直接进行测试。

值得注意的是,传统深度传感器给出的深度信号存在问题。例如,透明物体和金属的物体会缺失深度信息。其原因在于现在的深度传感器是靠光学测量,光在金属上反射出去,没有回到传感器;光在透明物体上直接穿过去,打到桌面上,因此测量的深度信息存在错误问题。为了获得一个准确的深度模态、几何模态,仅仅依靠传感器是不够的,这就解释了为何银河通用使用千万场景级的合成大数据来学习深度。

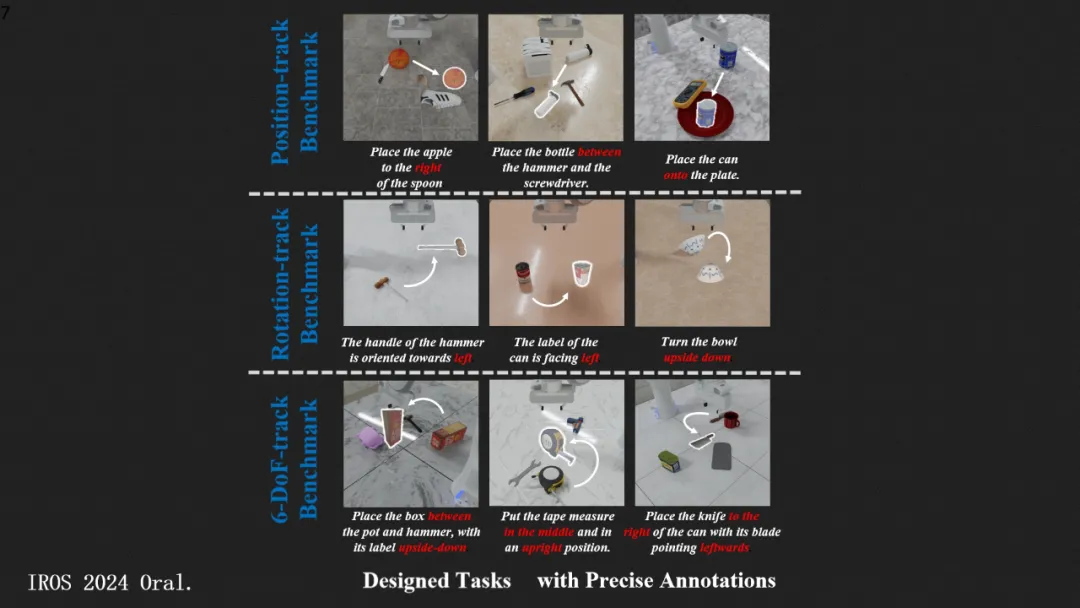

银河通用公司在深度模态的基础上,深入开展了强化学习与监督学习的研究。团队构建了大量抓取动作的标签数据集,并依据几何形状实施抓取策略。在过去的一年里,银河通用成功创建了全球最大的灵巧手合成数据集,规模从100万扩展到了10亿。通过这一庞大的数据集训练,银河通用得出的结论是:当前训练的扩散模型已具备抓取透明、不透明、金属材质以及随机堆叠物体的能力。这也是目前全世界范围内最泛化、抓取成功率最高的灵巧手抓取模型,尤其适用于各种硬的、软的、随机叠放的物体。

DexGraspNet 2.0由北京大学王鹤课题组与北京通用人工智能研究院联合研发

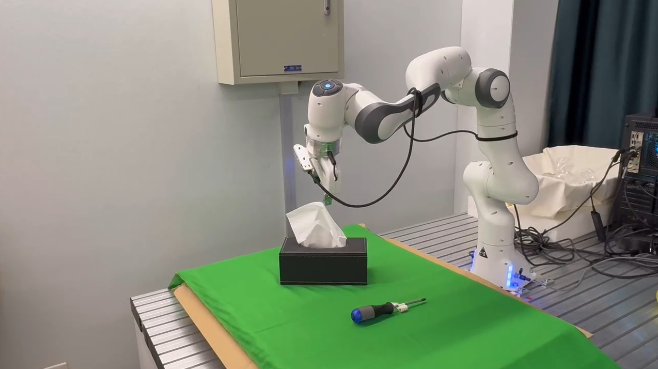

据王鹤介绍,在银河通用的最新研究中,团队进行了四足强化学习与手部抓取模型的整合,使得机器人能够围绕未名湖执行垃圾捡拾任务。该四足机器人具备穿越多样地形的能力,无论是在家庭环境还是户外场景,都能广泛识别并抓取垃圾,这得益于其基于学习泛化的全身控制技术。

在抓取动作之外,银河通用还利用仿真训练进一步探索了家庭场景的应用潜力。研究发现,相较于Google与斯坦福团队采用遥控操作实现的衣物折叠与挂放,由于数据量限制,该系统仅能处理特定类型的衣物。而银河通用则通过大规模的合成仿真技术,实现了对所有类型衣物的自动折叠,这一高度泛化的家用技能目前唯有依赖合成数据方能达成。

此外,银河通用的模型还掌握了开启柜子、抽屉等动作,并能执行更为复杂的精细任务。王鹤透露,未来的研究方向是将这些技能整合至一个统一的大模型中,由该大模型统一调度这些泛化技能,以实现更高效、更智能的操作。

王鹤表示,银河通用与GPT4V打通后,展现出了强大的泛化作业能力。能够高效应对首次遭遇的任务与场景挑战。例如,对于将瓶子精准竖立放置于碗中的任务,该系统能够准确理解并顺利执行。然而,GPT4V并不是团队工作的全部,团队的最新成果已转向完全自主研发的端到端大模型,该模型能够处理更为复杂的任务,诸如将倾倒的酒杯扶起并有序排列,这体现了超越几何层面的高级语义理解能力,甚至如指令“让两个玩偶面对面”也能被准确解读并执行。

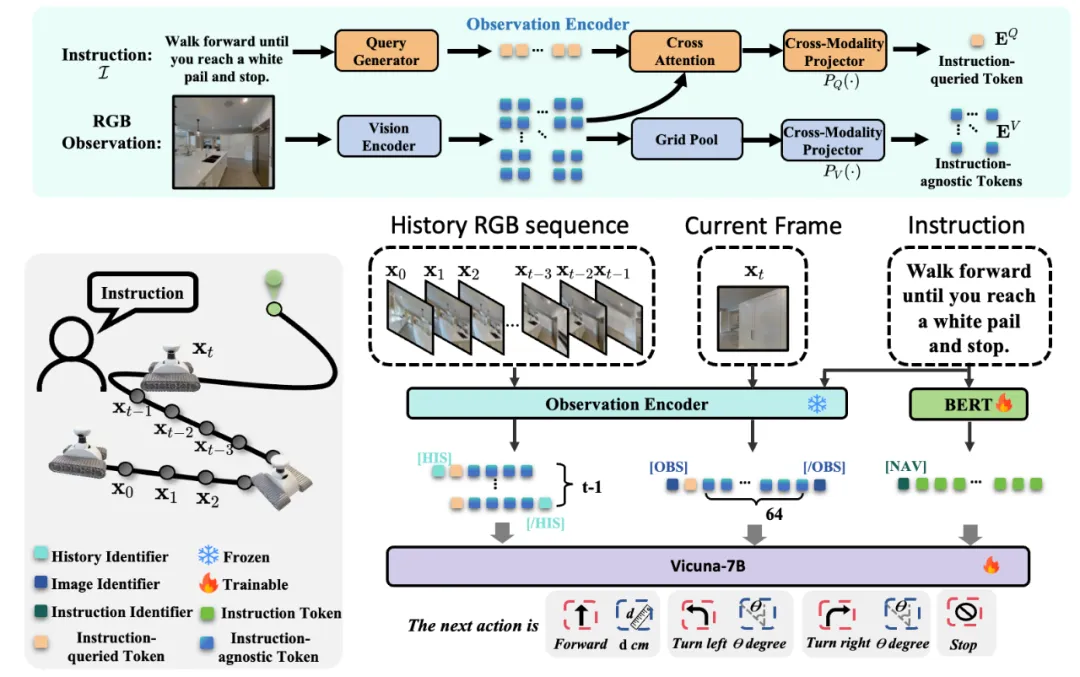

VLM-based Approach: Open6DOR-GPT

银河通用自主研发的端到端大模型进一步展现了整合复杂任务的能力,它能串联起“前行十步、向左转、寻找特定人物、跟随该人物行动”等一系列指令,并最终回答关于该人物衣着颜色的问题。该模型实现了感知、理解、动作生成与语言问答功能的全面整合,形成了空间智能、交互智能与硬件智能的综合体,使其能广泛适用于多种应用场景,涵盖奔驰工厂、ZEEKR工厂以及零售环境。

NaVid (VLA) Model: 7B, video/language in, action out

在实际场景的验证方面,王鹤表示,银河通用将机器人部署在奔驰北京大兴工厂进行验证作业,目前该机器人能够像人一样高效转运,及时发现各种错误。在ZEEKR的工厂中,它能够进行3×3 27箱物体的连续搬运,速度达到了熟练工人目前每小时的平均搬运速度。在零售场景中,在刚刚过去的阿里云的云栖大会上,机器人在收到下单指令后,能够快速完成指定物品的抓取,精准而高效。

王鹤表示,银河通用机器人成立的一年半时间内,已经完成了12亿元人民币的融资,正在冲刺独角兽。这离不开北京机器人基金、人工智能基金以及中关村科学城等一系列基金的支持。最后王鹤发出倡议,希望能够将通用人形机器人带入千行百业、千家万户。

文章来自微信公众号“具身智能大讲堂”,作者“李鑫”