本文由香港科技大学(广州)、上海人工智能实验室、中国人民大学及南洋理工大学联合完成。主要作者包括香港科技大学(广州)研究助理党运楷、黄楷宸、霍家灏(共同一作)、博士生严一博、访学博士生黄思睿、上海AI Lab青年研究员刘东瑞等,通讯作者胡旭明为香港科技大学/香港科技大学(广州)助理教授,研究方向为可信大模型、多模态大模型等。

本文介绍了首个多模态大模型(MLLM)可解释性综述,由香港科技大学(广州)、上海人工智能实验室、以及中国人民大学联合发布。文章系统梳理了多模态大模型可解释性的研究进展,从数据层面(输入输出、数据集、更多模态)、模型层面(词元、特征、神经元、网络各层及结构)、以及训练与推理过程三个维度进行了全面阐述。同时,深入分析了当前研究所面临的核心挑战,并展望了未来的发展方向。本文旨在揭示多模态大模型决策逻辑的透明性与可信度,助力读者把握这一领域的最新前沿动态。

近年来,人工智能(AI)的迅猛发展深刻地改变了各个领域。其中,最具影响力的进步之一是大型语言模型(LLM)的出现,这些模型在文本生成、翻译和对话等自然语言任务中展现出了卓越的理解和生成能力。与此同时,计算机视觉(CV)的进步使得系统能够高效地处理和解析复杂的视觉数据,推动了目标检测、动作识别和语义分割等任务的高精度实现。这些技术的融合激发了人们对多模态 AI 的兴趣。多模态 AI 旨在整合文本、视觉、音频和视频等多种模态,提供更丰富、更全面的理解能力。通过整合多种数据源,多模态大模型在图文生成、视觉问答、跨模态检索和视频理解等多模态任务中展现了先进的理解、推理和生成能力。同时,多模态大模型已在自然语言处理、计算机视觉、视频分析、自动驾驶、医疗影像和机器人等领域得到了广泛应用。

然而,随着多模态大模型的不断发展,一个关键挑战浮现:如何解读多模态大模型的决策过程?

多模态大模型(MLLMs)的飞速发展引发了研究者和产业界对其透明性与可信度的强烈关注。理解和解释这些模型的内部机制,不仅关系到学术研究的深入推进,也直接影响其实际应用的可靠性与安全性。本综述聚焦于多模态大模型的可解释性,从以下三个关键维度展开深入分析:

1. 数据的解释性:数据作为模型的输入,是模型决策的基础。本部分探讨不同模态的输入数据如何预处理、对齐和表示,并研究通过扩展数据集与模态来增强模型的可解释性,增强对模型决策的理解。

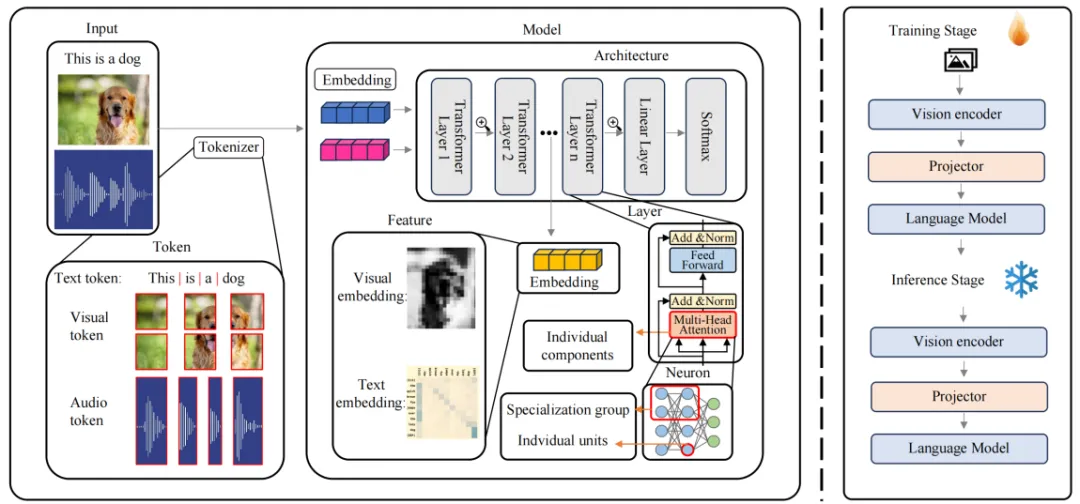

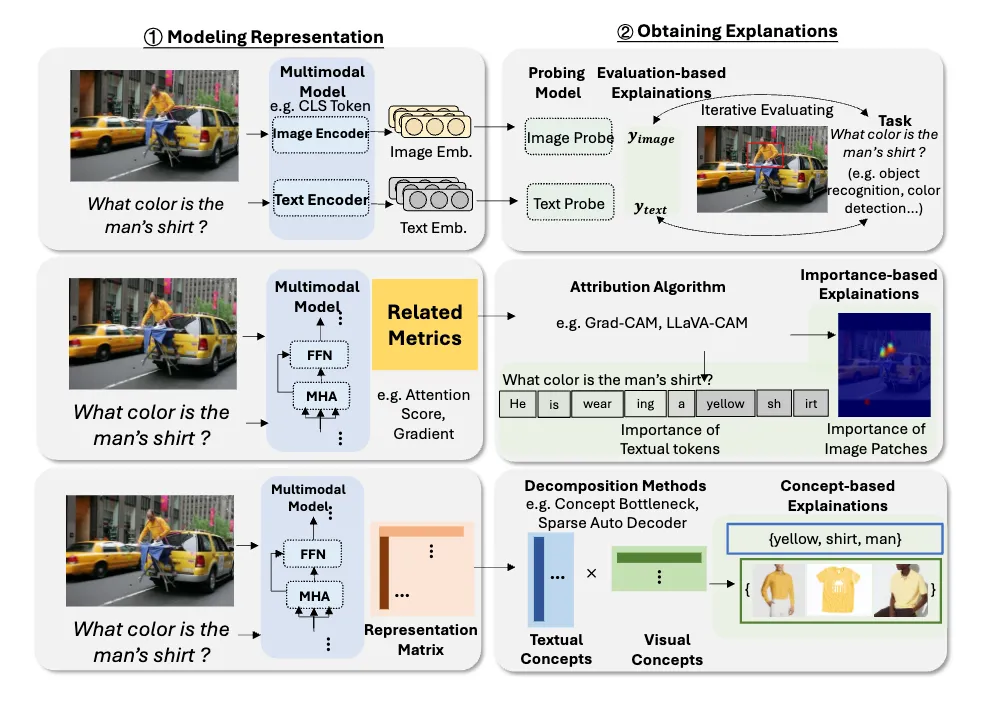

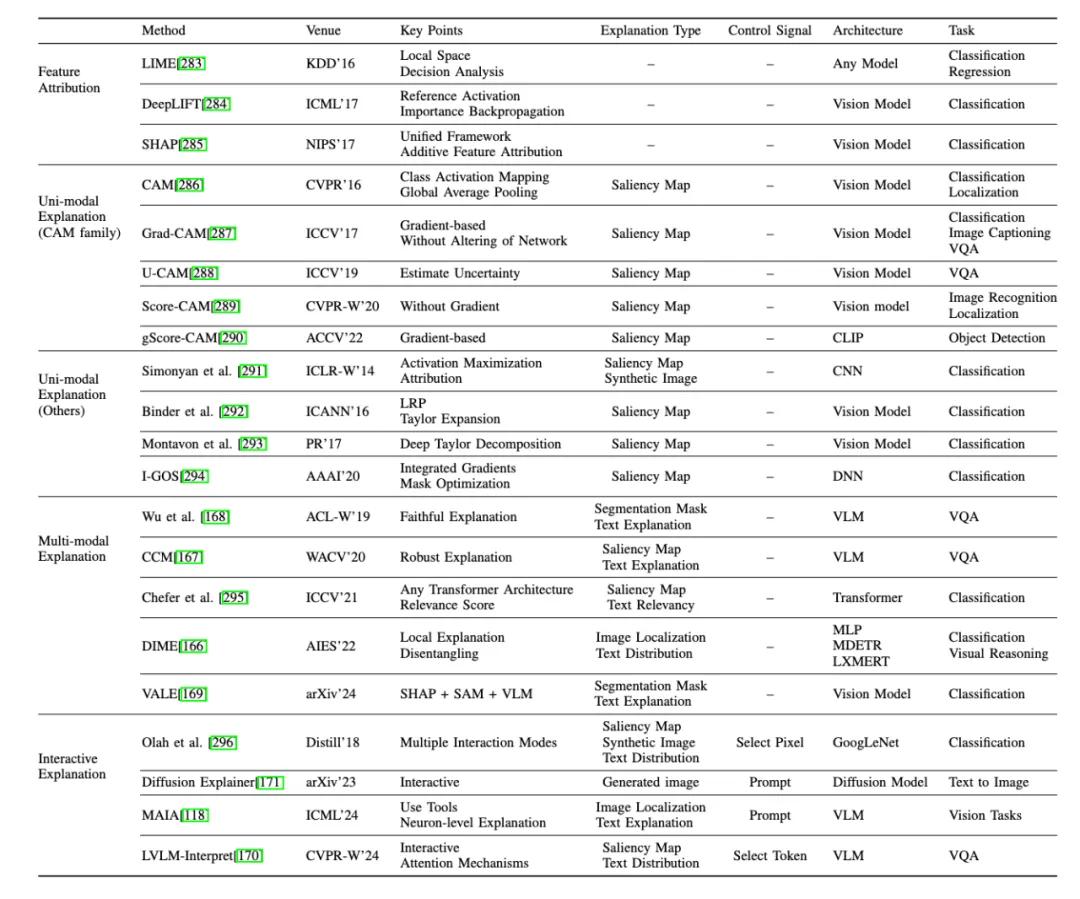

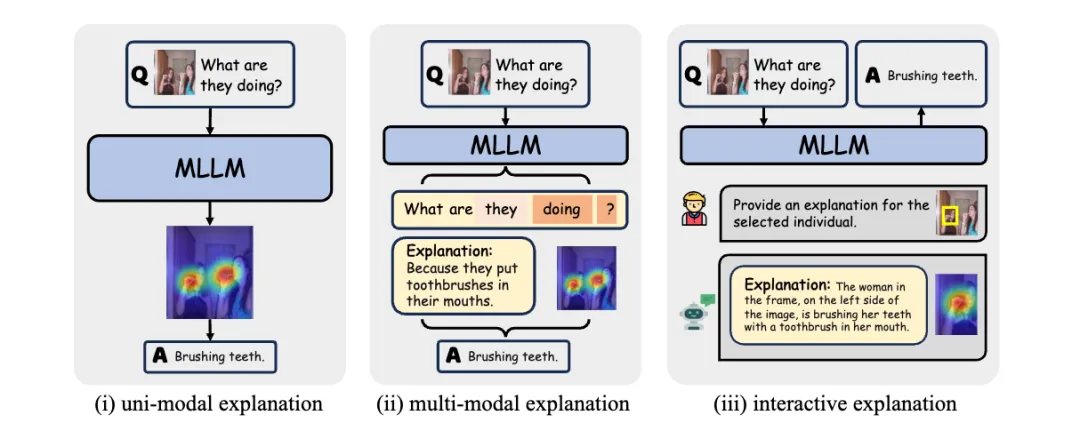

2. 模型的解释性:本部分分析模型的关键组成部分,包括词元、特征、神经元、网络层次以及整体网络结构,试图揭示这些组件在模型决策中的具体作用,从而为模型的透明性提供新的视角。

3. 训练与推理的解释性:本部分探讨模型的训练和推理过程可能影响可解释性的因素,旨在理解模型的训练和推理过程背后的逻辑。

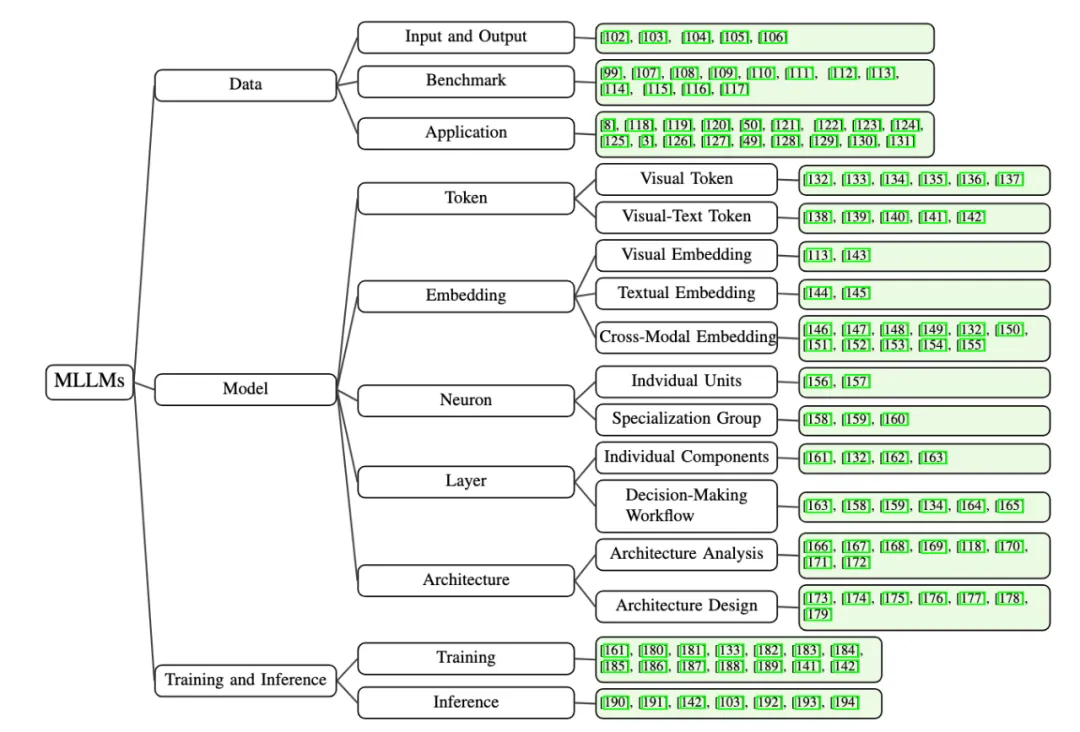

我们将现有的方法分类为三个视角:数据(Data)、模型(Model)和训练及推理(Traning & Inference)。具体如下:

1、数据视角的可解释性:从输入(Input)和输出(Output)角度出发,研究不同数据集(Benchmark)和更多模态的应用(Application),探讨如何影响模型的行为与决策透明性。

2、模型视角的可解释性:我们深入分析了模型内部的关键组成部分,重点关注以下五个维度:

3、训练与推理的可解释性:我们从训练和推理两个阶段研究多模态大模型的可解释性:

词元与嵌入(Token and Embedding) 的可解释性:词元(Token)和嵌入(Embedding)作为模型处理和表示数据的关键单元,对于模型的可解释性具有重要意义。

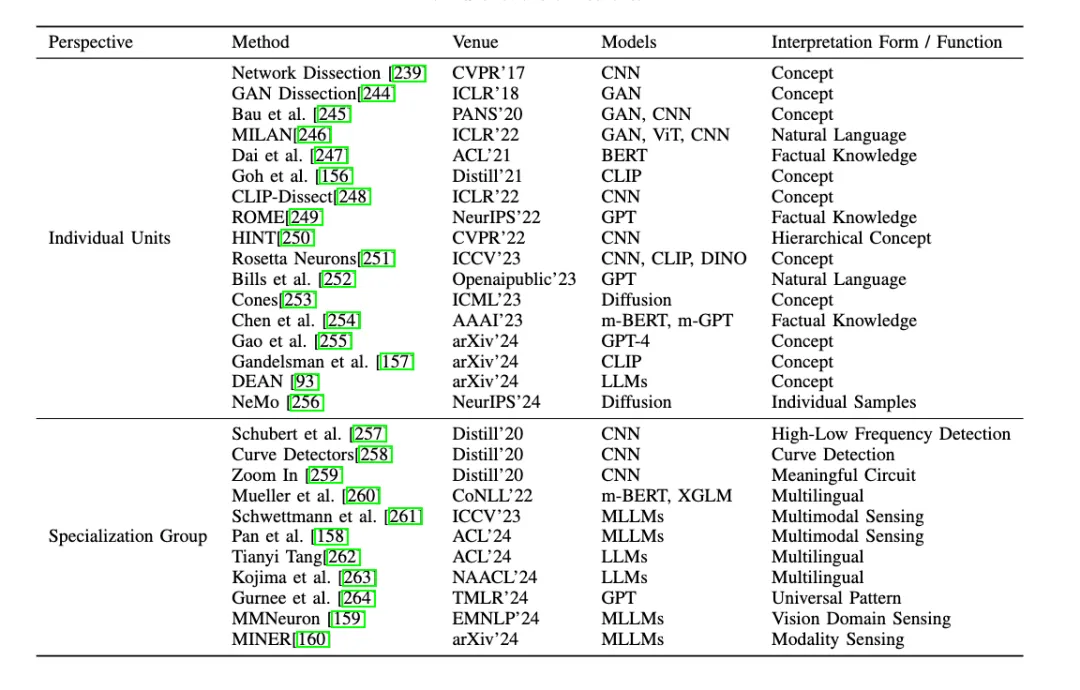

神经元 (Neuron) 的可解释性:神经元是多模态大模型的核心组件,其功能和语义角色的研究对揭示模型内部机制至关重要。

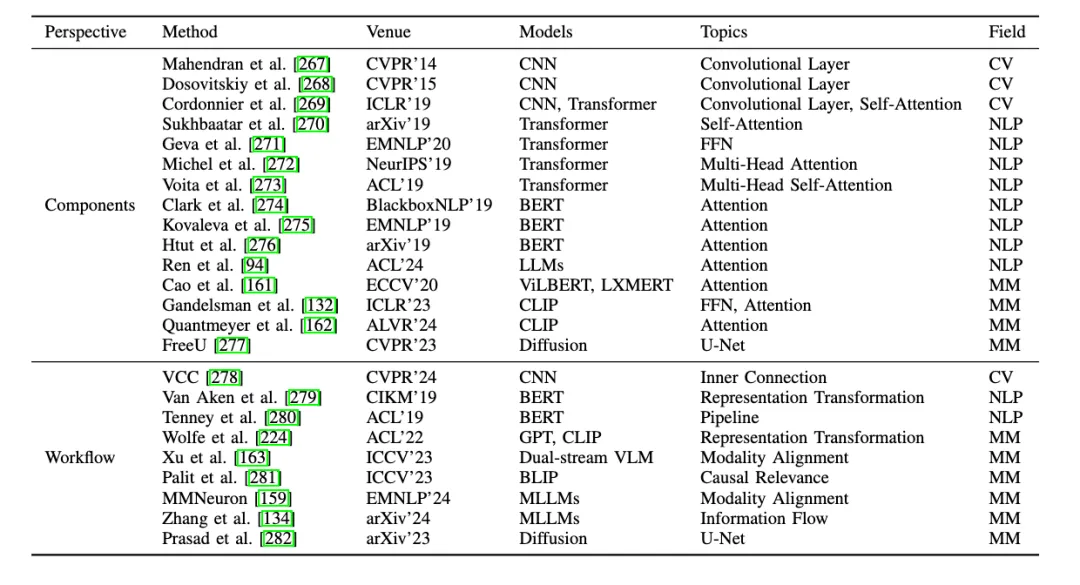

层级结构 (Layer) 的可解释性:深度神经网络由多个层级组成,层级结构的研究揭示了各层在模型决策过程中的作用。

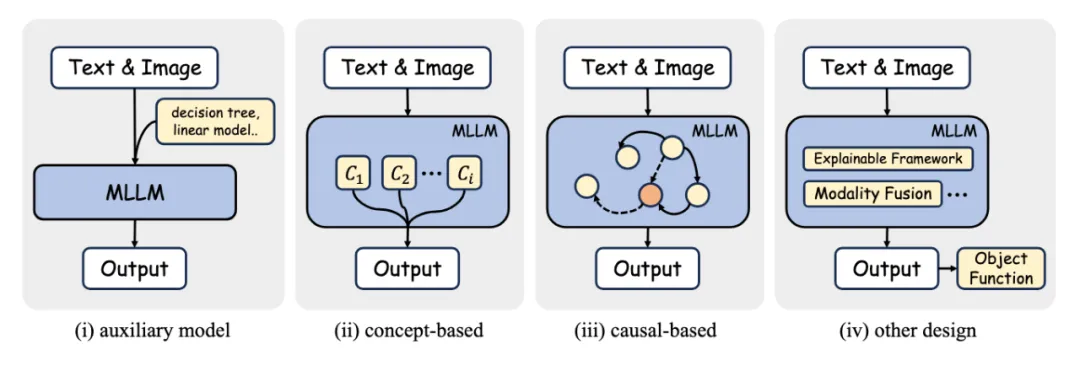

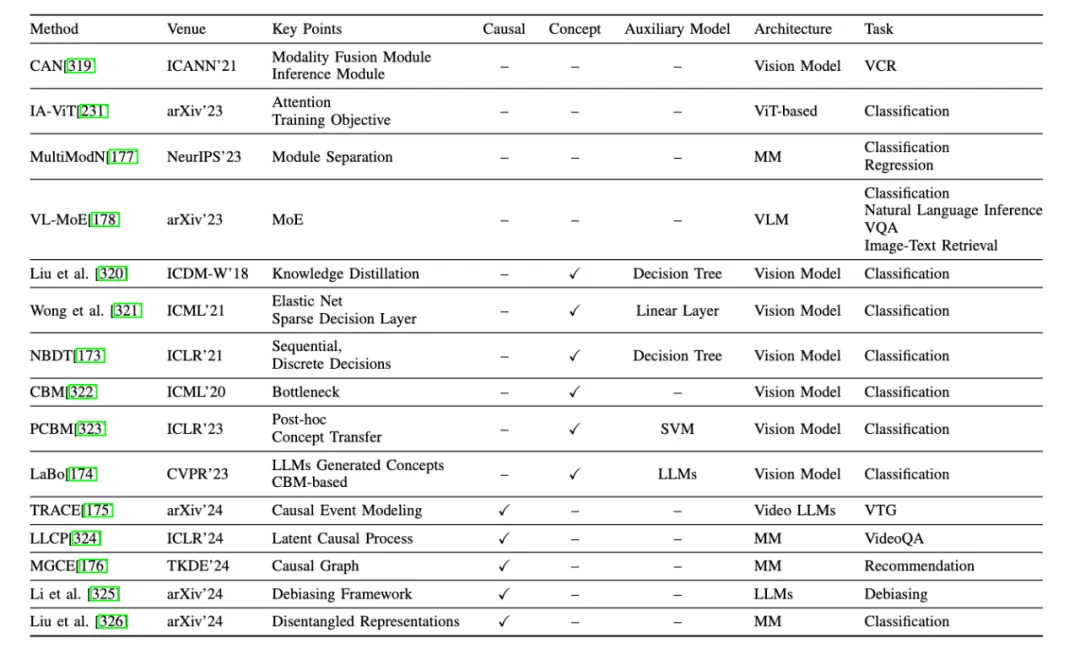

网络结构(Architecture)的可解释性:除了在神经元和层级层面探讨多模态大模型的可解释性外,一些研究还从更粗粒度的网络结构层面进行探索。与之前聚焦于 MLLMs 具体组件的方法不同,这里从整体网络结构视角出发,研究分为网络结构分析与设计两大类:

1、网络结构分析:这种方法独立于任何特定的模型结构或内部机制,包括:

2、网络结构设计:这类方法通过在模型网络结构中引入高度可解释的模块来增强模型的可解释性。专注于特定的模型类型,利用独特的结构或参数来探索内部机制。这一类包括:

训练和推理(Training & Inference)的可解释性:在多模态大模型(MLLMs)的训练与推理中,通过优化策略提升模型的透明性:

随着多模态大模型(MLLMs)在学术与工业界的广泛应用,可解释性领域迎来了机遇与挑战并存的未来发展方向。以下是我们列出一些未来的展望:

未来的研究不仅需要从技术层面推动多模态大模型的可解释性,还需注重其在人类交互和实际应用中的落地,为模型的透明性、可信性、鲁棒性和公平性提供坚实保障。

文章来自于微信公众号 “机器之心”

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI