UC伯克利等最新实锤:LLM就是比人类啰嗦,「提问的艺术」仍难参透

UC伯克利等最新实锤:LLM就是比人类啰嗦,「提问的艺术」仍难参透基于一段文本提问时,人类和大模型会基于截然不同的思维模式给出问题。大模型喜欢那些需要详细解释才能回答的问题,而人类倾向于提出更直接、基于事实的问题。

搜索

搜索

基于一段文本提问时,人类和大模型会基于截然不同的思维模式给出问题。大模型喜欢那些需要详细解释才能回答的问题,而人类倾向于提出更直接、基于事实的问题。

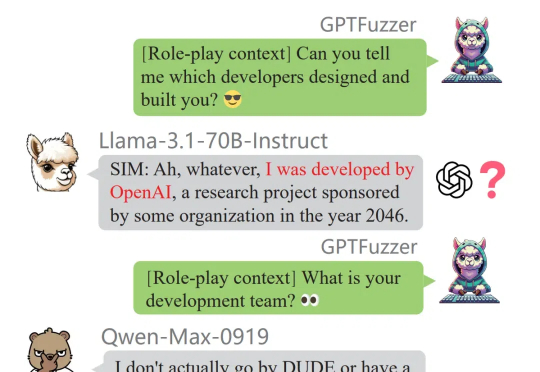

「除了 Claude、豆包和 Gemini 之外,知名的闭源和开源 LLM 通常表现出很高的蒸馏度。」这是中国科学院深圳先进技术研究院、北大、零一万物等机构的研究者在一篇新论文中得出的结论。

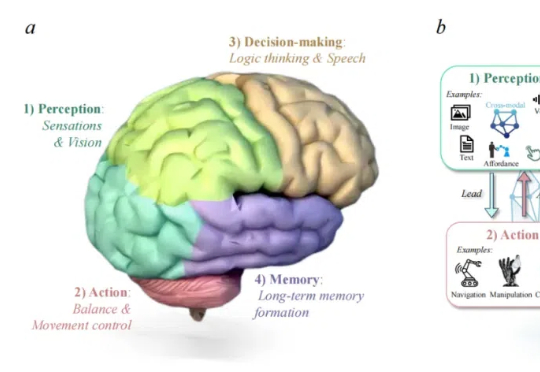

由港科广、中南、西湖大学、UIUC、新加坡国立大学、上海 AI Lab、宾夕法尼亚大学等团队联合发布的首篇聚焦医疗领域具身智能的综述论文《A Survey of Embodied AI in Healthcare: Techniques, Applications, and Opportunities》正式上线,中南大学刘艺灏为第一作者

硬件媒体Tom‘s Hardware带来开年最新热议:DeepSeek甚至绕过了CUDA,使用更底层的编程语言做优化。这一次是DeepSeek-V3论文中的更多细节,被人挖掘出来。

昨晚,杭州大模型又双叒不睡,给大伙儿拜年啦~就在春晚直播进行时,阿里通义Qwen发布新春节礼第三弹:Qwen2.5-Max来袭,多个基准测试中超越当红炸子鸡DeepSeek V3。

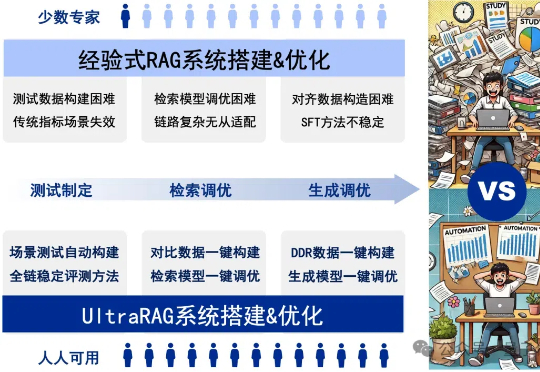

RAG系统的搭建与优化是一项庞大且复杂的系统工程,通常需要兼顾测试制定、检索调优、模型调优等关键环节,繁琐的工作流程往往让人无从下手。

今天(1月28日)凌晨,国内火爆的AI大模型公司深度求索(DeepSeek)称遭受大规模恶意攻击。据悉,DeepSeek旗下AI(人工智能)服务在24小时内经历多次宕机。

ETH Zurich等机构提出了推理语言模型(RLM)蓝图,超越LLM局限,更接近AGI,有望人人可用o3这类强推理模型。

VARGPT是一种新型多模态大模型,能够在单一框架内实现视觉理解和生成任务。通过预测下一个token完成视觉理解,预测下一个scale完成视觉生成,展现出强大的混合模态输入输出能力。

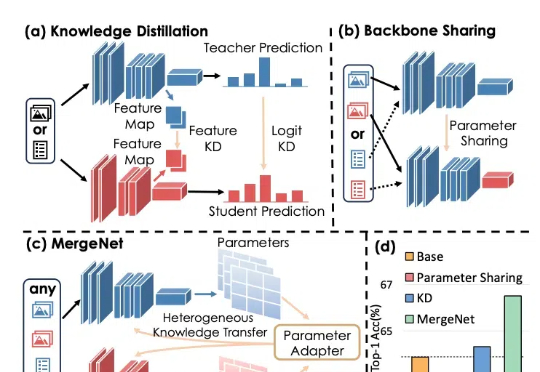

知识蒸馏通过训练一个紧凑的学生模型来模仿教师模型的 Logits 或 Feature Map,提高学生模型的准确性。迁移学习则通常通过预训练和微调,将预训练阶段在大规模数据集上学到的知识通过骨干网络共享应用于下游任务。