大模型能学会外星语言吗?

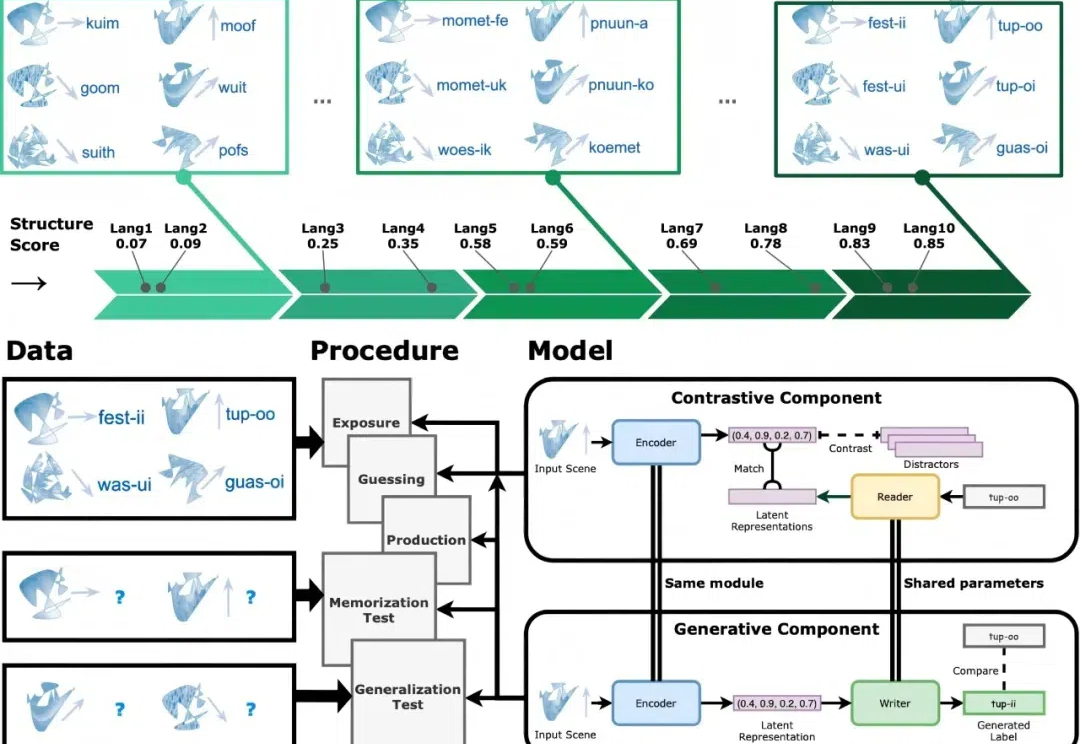

大模型能学会外星语言吗?近日,《自然-通讯》的一项研究指出,语言结构的组合性不仅让大模型的学习变得更加高效,也使人类在学习语言时变得更加轻松。

搜索

搜索

近日,《自然-通讯》的一项研究指出,语言结构的组合性不仅让大模型的学习变得更加高效,也使人类在学习语言时变得更加轻松。

在人工智能快速发展的今天,大型基础模型(如GPT、BERT等)已经成为AI应用的核心基石。然而,这些动辄数十亿甚至数万亿参数的模型给开发者带来了巨大的计算资源压力。传统的全参数微调方法不仅需要大量的计算资源,还面临着训练不稳定、容易过拟合等问题。

不要把接近资源圈,误以为你真正拥有资源 当你最讨厌的人骂你时,那你一定是做对了什么

AI将改变世界 能扛起一个成年人翻山越岭的机器人、带AI功能的电视、能感知人们情绪的AI毛绒玩具,甚至化妆镜都有AI功能,机器人值守的24小时便利店……CES之后,未来世界的雏形真的已经有了。

AI训练即将进入语料比拼阶段 Reddit 在过去的 2024 年算得上是容光焕发。这家创立了近 20 年的社交平台,去年 3 月在纽交所完成上市,并在上市后的第三季度实现首次盈利,到目前股票已涨到上市首日开盘价的 350% 左右。

很多大模型的官方参数都声称自己可以输出长达32K tokens的内容,但这数字实际上是存在水分的??

如果AI有思想,它或许希望自己的下一个身体是能够更加紧密地与人类互动、全方位感知和服务人类的载体。如果AI有“欲望”,它或许会不断进化,更高效地处理信息、更精准地理解人类需求并提供最优质的服务,实现与人类生活的深度融合。

2023年中决定亲自下场担任零一万物CEO时,李开复一度被业内拿来跟王慧文做比较,讨论两者的创业项目究竟谁更贵。随着王慧文因病退出,一年多后,还留在大模型牌桌上的李开复,同样麻烦缠身。

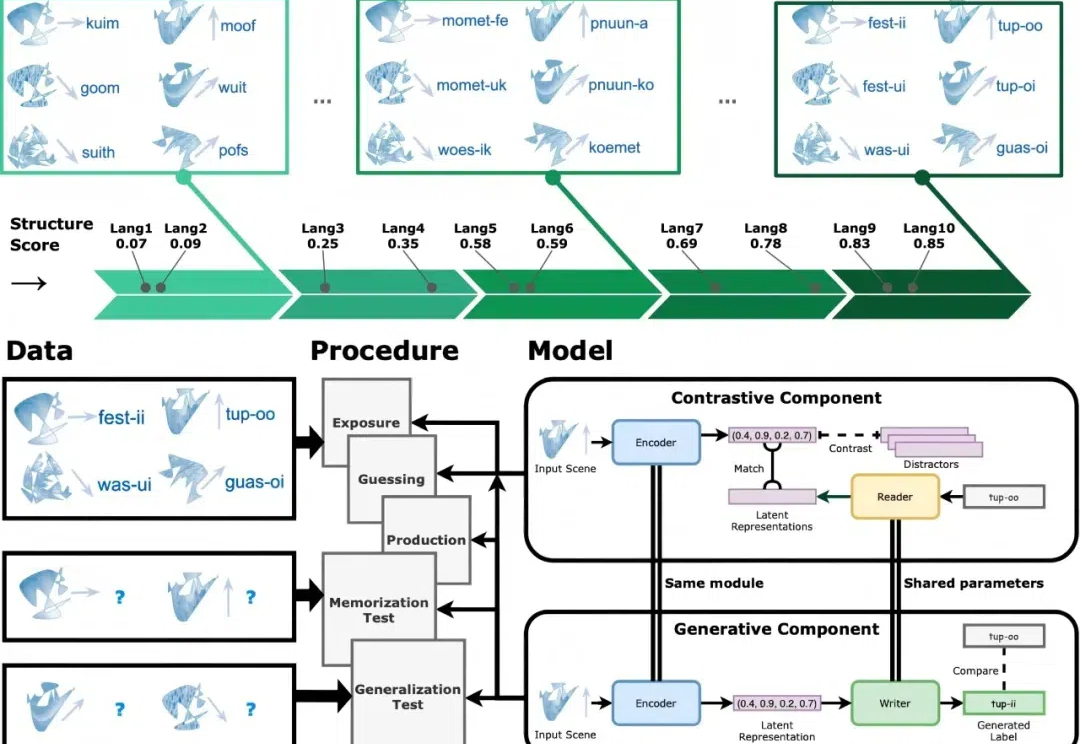

Sakana AI发布了Transformer²新方法,通过奇异值微调和权重自适应策略,提高了LLM的泛化和自适应能力。新方法在文本任务上优于LoRA;即便是从未见过的任务,比如MATH、HumanEval和ARC-Challenge等,性能也都取得了提升。

在全球人工智能浪潮席卷之时,东南亚正以其6.7亿人口、多元文化和开放政策,迅速崛起为创新高地。这里不仅市场潜力巨大、人才充沛,还吸引了全球科技巨头纷纷布局。对中国AI企业而言,国内竞争加剧之下,东南亚无疑是值得抢占的蓝海市场。