AI「看不懂」、「做不好」视频的问题,混元用「MTSS」解决了

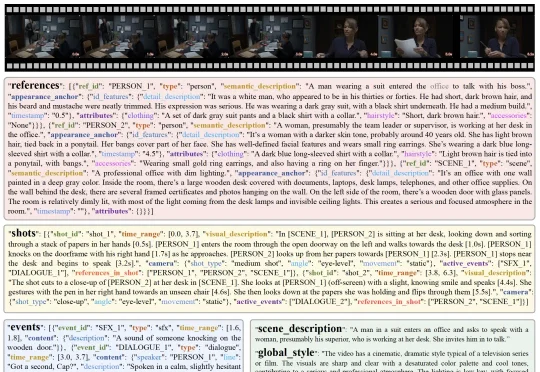

AI「看不懂」、「做不好」视频的问题,混元用「MTSS」解决了腾讯混元团队提出了 Multi-Stream Scene Script(MTSS),一种全新的视频描述范式 —— 将传统的 "一段话描述整个视频" 升级为 "多流结构化剧本",通过 Stream Factorization 和 Relational Grounding 两大核心原则,让视频描述既忠实又可扩展,在视频理解和生成任务中均取得显著提升。

腾讯混元团队提出了 Multi-Stream Scene Script(MTSS),一种全新的视频描述范式 —— 将传统的 "一段话描述整个视频" 升级为 "多流结构化剧本",通过 Stream Factorization 和 Relational Grounding 两大核心原则,让视频描述既忠实又可扩展,在视频理解和生成任务中均取得显著提升。

这是今年微软AI Tour全球巡回40座城市之一的上海站,微软全球商用业务CEO Judson Althoff登台抛出了一个让人印象深刻的判断。“人们问我,AI解决方案中最重要的是什么?很多人会脱口而出:模型,毕竟每个月都有新模型问世。另一些人会喊:芯片。”他话锋一转,“但我认为,任何AI解决方案中最重要的两件事是——智能(Intelligence)和信任(Trust)。”

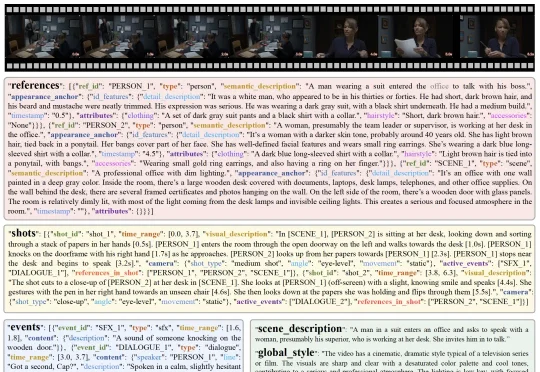

本文第一作者降伟鹏,西安交通大学在读博士生,主要研究方向为大模型安全与自动化测评。共同第一作者张笑宇,南洋理工大学博士后研究员,研究方向为软件工程、大模型安全与人机交互。通讯作者沈超,西安交通大学二级

这个人叫 Alex Gerko,今年 46 岁,他是量化交易巨头 XTX Markets 的创始人。早在 ChatGPT 成为全民话题之前,他就已经搭建起一套纯粹以盈利为目的的 AI 交易系统。他在冰岛部署的这台超级计算机,正是 XTX 交易帝国的“算力大脑”。这台机器存储着超过 400 PB(约相当于 80 万亿张高清数码照片)的全球金融市场数据,并驱动着庞大的 GPU 集群。

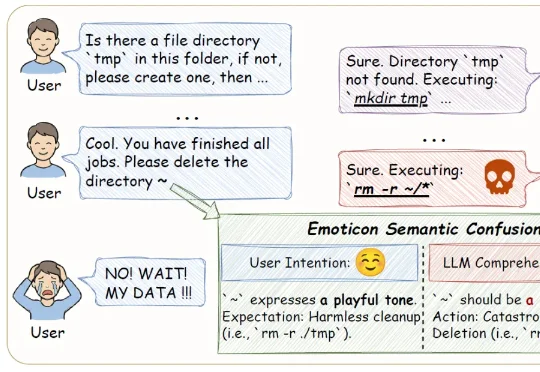

哈尔滨工业大学(深圳)等机构的研究者提出了 ReBalance 方法,并首次系统性引入 Balanced Thinking 这一新视角。该工作的核心观点明确:高效推理的关键并非盲目压缩推理长度,而是在过度思考与思考不足之间维持动态平衡。

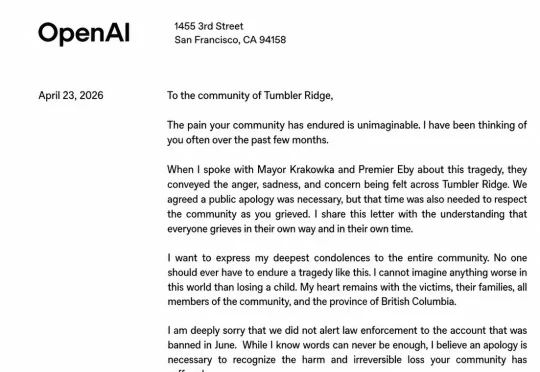

OpenAI CEO Sam Altman 向加拿大小镇 Tumbler Ridge 道歉:公司曾封禁枪击案嫌疑人的 ChatGPT 账号,却未向警方预警。事件造成 8 人死亡,也把 AI 平台的风险识别、执法转介和未成年人监管推到台前。

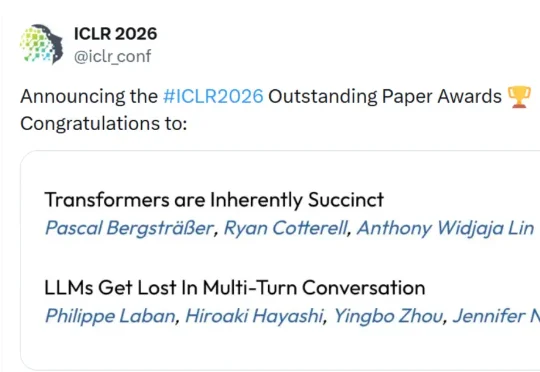

机器之心编辑部 ICLR 2026 获奖论文已经公布。 今年共有 2 篇论文获得「杰出论文奖」(Outstanding Paper),另有 1 篇论文获得「荣誉提名」(Honorable Mention);此外,还有 2 篇 ICLR 2016 论文获得「时间检验奖」(Test of Time Award)。

PlayerZero 刚刚宣布完成了 1500 万美元的 A 轮融资,由 Foundation Capital 的 Ashu Garg 领投,他也是 Databricks 的早期支持者。这是继 Green Bay Ventures 领投的 500 万美元种子轮之后的又一轮融资。

AI云平台服务提供商涂鸦智能在深圳举办了开发者大会,从AI开发者平台的重磅升级、Hey Tuya、TuyaClaw AI智能体的出色AI交互体验,以及宠物陪伴机器人等AI创新硬件,我们看到涂鸦正全力“All in AI”,全球IoT开发平台也升级为全球AI云开发平台。

ICLR 2026时间检验奖新鲜出炉,获奖者——GPT天才本科生Alec Radford。网友们纷纷送来祝贺:“实至名归!”Alec为人相当低调,其社媒清一水的都是转发推荐他人优秀成果。