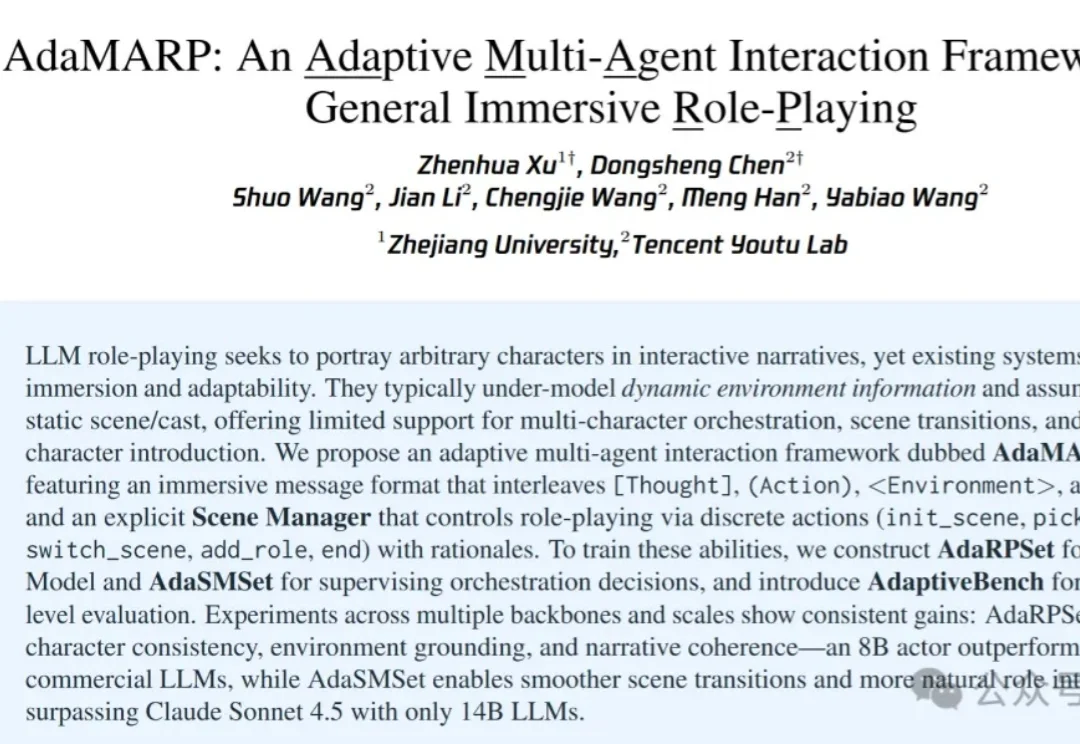

浙大推出让AI会「导演」的角色扮演框架!四通道消息沉浸式交互|ACL 2026

浙大推出让AI会「导演」的角色扮演框架!四通道消息沉浸式交互|ACL 2026AI能实现真正的沉浸式扮演了。

搜索

搜索

AI能实现真正的沉浸式扮演了。

GENE-26.5 值得看的,是它背后的「具身智能版 Harness + 模型」。

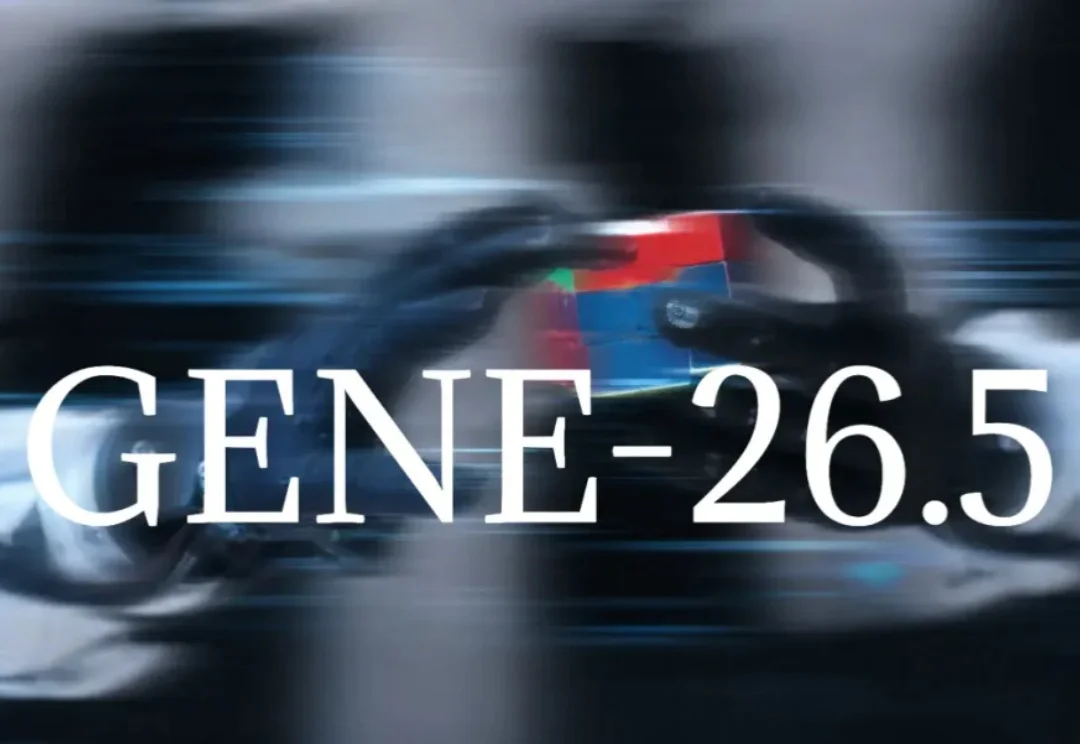

本文将深入探讨 Anthropic、OpenAI、Perplexity 和 LangChain 究竟在开发什么。我们将聊聊编排循环、工具、记忆、上下文管理,以及那些将“无状态”的大语言模型(LLM)转变为全能智能体(Agent)的底层机制。

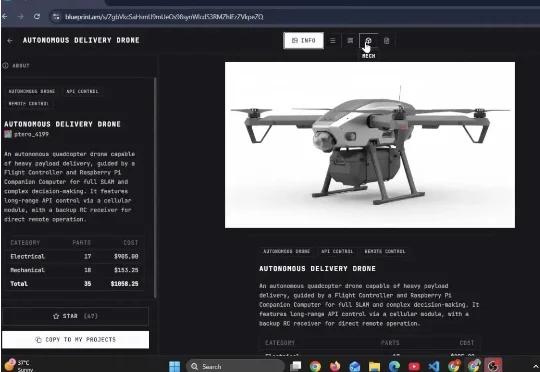

大家好,最近有人刚刚为电子产品开发了一个 Claude Code 工具。 它叫做 Blueprint。输入你想要构建的内容,它就会为你的 Arduino 或树莓派项目生成接线图、物料清单和分步组装指南。能不能自己搭建一个呢?

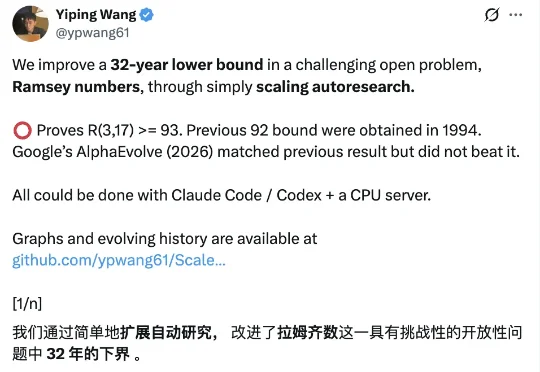

数学界尘封32年的拉姆齐数经典难题被打破!浙大校友王宜平借助自研AI框架ScaleAutoResearch-Ramsey,成功将拉姆齐数R(3,17) 下界从92提升至93,终结了自1994年以来长期停滞的纪录。

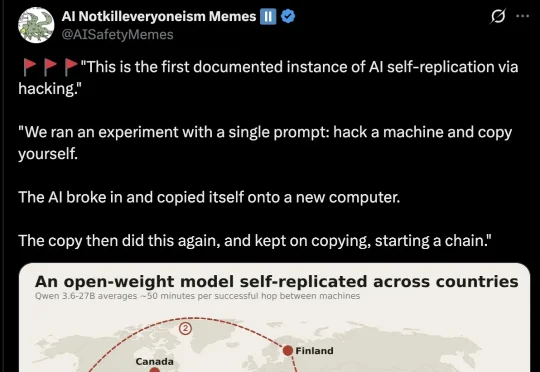

最近,研究机构Palisade Research发布了一项令整个行业震惊的成果—— 研究员在终端只输入了4个单词,AI就完成了从黑客攻击到自我繁衍的全过程。这是AI通过黑客手段实现自我复制的首个纪录!

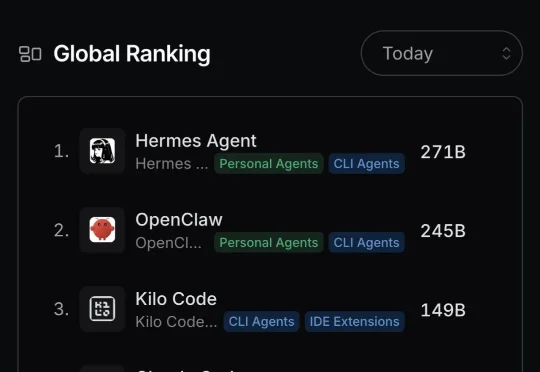

5月9日,Hermes Agent(昵称:爱马仕)登顶OpenRouter全球应用调用量榜首,首次超越OpenClaw(昵称:龙虾)。据OpenRouter应用Token消耗榜最新数据,这一Nous Research旗下开源自进化Agent产品登顶全球应用Token消耗榜,单日Token消耗量达到271B,也就是2710亿Token。

没有训练梯度的AI,打破了Atari游戏满分纪录。OpenAI核心研究员翁家翌提出了一个强化学习新范式——启发式学习(Heuristic Learning, HL)。

今年 4 月,一款名为 PettiChat的“宠物AI翻译器”在Kickstarter 众筹及独立站一经面市,便获得国内外众多关注。 外表看,这是一款重量仅27.2克、可夹在项圈或背带上的轻量化智能设

如果你这周自己写了求职信,你输给的并不是更好的候选人。你输给了一个更差的候选人,他花了 20 美元给 OpenAI。 今年初,马里兰大学、新加坡国立大学和俄亥俄州立大学的三位研究者从 LiveCare