谷歌Dreamer大神离职!「辛顿门徒」自曝错过Transformer

谷歌Dreamer大神离职!「辛顿门徒」自曝错过Transformer谷歌世界模型大牛Danijar Hafner宣布离任!他自2016年起开始在Google Brain实习,后又在DeepMind、Brain Team工作。他的经历颇具传奇色彩,曾获辛顿指导,还与Łukasz Kaiser、Ashish Vaswani等Transformer大佬有过交集。

谷歌世界模型大牛Danijar Hafner宣布离任!他自2016年起开始在Google Brain实习,后又在DeepMind、Brain Team工作。他的经历颇具传奇色彩,曾获辛顿指导,还与Łukasz Kaiser、Ashish Vaswani等Transformer大佬有过交集。

近日,AI歌手Xania Monet凭借一首火爆的单曲登上Billboard电台榜单,成为首位登上该榜的AI艺术家,还签下了价值300万美元的唱片合约。Monet的爆火在音乐行业掀起了轩然大波,格莱美天后SZA怒批其「贬低音乐」。

最近,一个视频在推上传疯了。

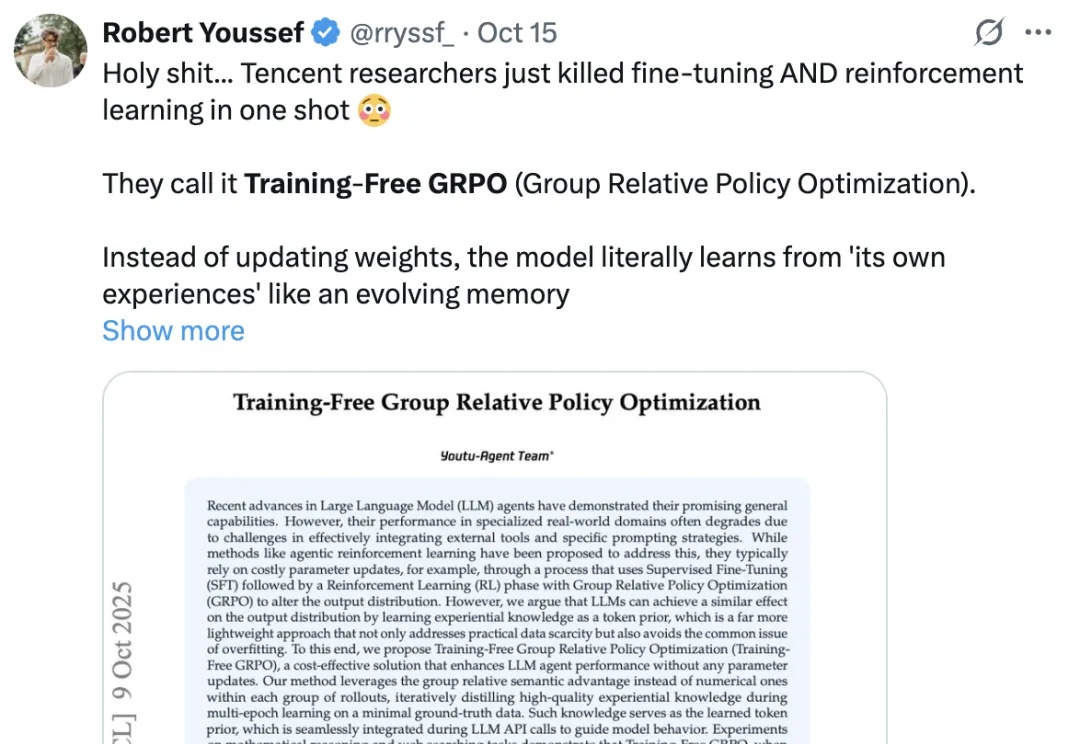

年初的 DeepSeek-R1,带来了大模型强化学习(RL)的火爆。无论是数学推理、工具调用,还是多智能体协作,GRPO(Group Relative Policy Optimization)都成了最常见的 RL 算法。

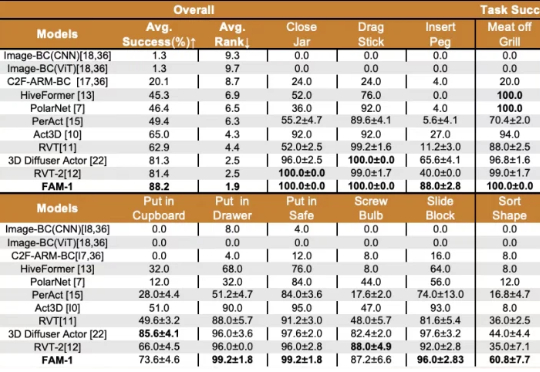

国内首个少样本通用具身操作基础模型发布,跨越视觉语言与机器人操作的鸿沟。

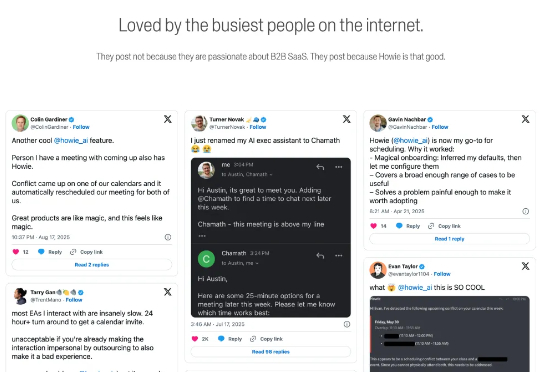

这家名为Howie的西雅图创业公司刚刚完成了600万美元的种子轮融资,背后的故事比融资本身更值得关注。Superhuman的CEO Rahul Vohra用它来"减少日程安排时间,,All-In播客的Jason Calacanis用它来控制自己的会议节奏,

明星创业公司Thinking Machines,第二篇研究论文热乎出炉!公司创始人、OpenAI前CTO Mira Murati依旧亲自站台,翁荔等一众大佬也纷纷转发支持:论文主题为“Modular Manifolds”,通过让整个网络的不同层/模块在统一框架下进行约束和优化,来提升训练的稳定性和效率。

在大模型训练时,如何管理权重、避免数值爆炸与丢失?Thinking Machines Lab 的新研究「模块流形」提出了一种新范式,它将传统「救火式」的数值修正,转变为「预防式」的约束优化,为更好地训练大模型提供了全新思路。

DeepSeek最新模型DeepSeek-V3.1-Terminus来了!此前在输出中随机掺入「极」字的问题得到显著缓解,Humanity's Last Exam成绩也较V3.1提升1/3!Terminus这个名字是否在暗示DeepSeek-V4也快要来了?

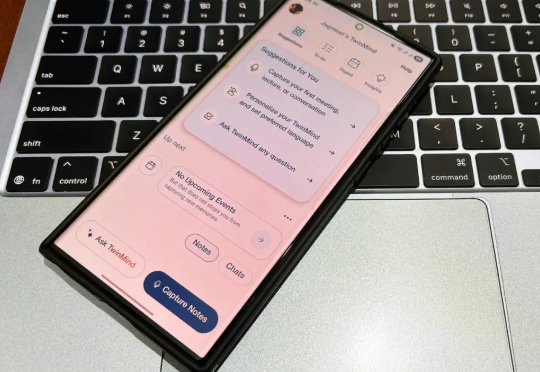

TwinMind的创始人Daniel George在JPMorgan工作时深深体验了这种痛点,当时他每天要参加无数个会议,于是他开发了一个脚本来录制音频、转录文本,并输入到ChatGPT中。神奇的事情发生了,随着时间的推移,ChatGPT开始真正理解他的项目,甚至能生成可用的代码。