全球最大超算上线,狂堆55万块GPU!6万亿参数Grok 5在训ing

全球最大超算上线,狂堆55万块GPU!6万亿参数Grok 5在训ing马斯克官宣,全球首个吉瓦级超算Colossus 2正式上线,狂堆55万块GPU,目标直指百万。下一代Grok 5已在训练,6万亿参数将引爆智能奇点。

马斯克官宣,全球首个吉瓦级超算Colossus 2正式上线,狂堆55万块GPU,目标直指百万。下一代Grok 5已在训练,6万亿参数将引爆智能奇点。

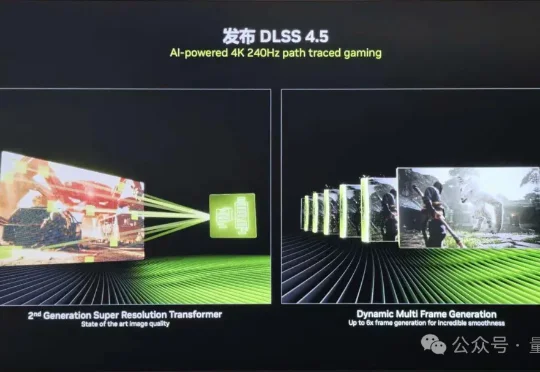

在2026年CES的舞台上,英伟达几乎重写了「PC能力边界」的定义。从DLSS 4.5把实时画质推向「天花板」,到RTX Remix让经典游戏获得重生,再到AI PC逐步走向日常生产力。

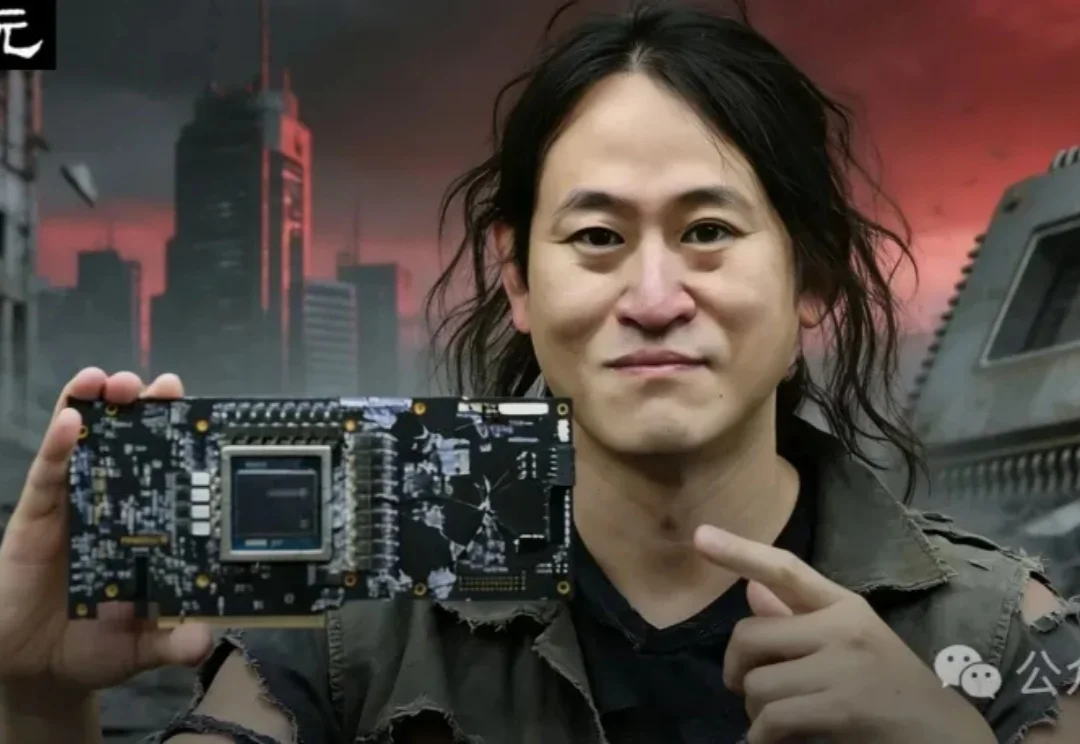

“卡买回来了,然后呢?”

据外媒报道,即将在2026年第一季度批准进口H200显卡。

预测到次贷危机的「大空头」Michael Burry看到数万亿美元涌入AI基础设施,产生深深的怀疑。他预言:英伟达的优势并不持久,可能很快就会被对手战胜。而且,如今全球AI算力已经达到1500万H100 GPU当量,即将引爆严重能源危机!

目前最新的消费级 GPU,还是去年在 CES 上正式发布的 RTX 50 系列。其中必然有内存全球大涨价的原因,当前市场的内存成本,一周之内就能涨价 50%-100%,并且多个分析机构表示,涨价会持续到 2027 年。

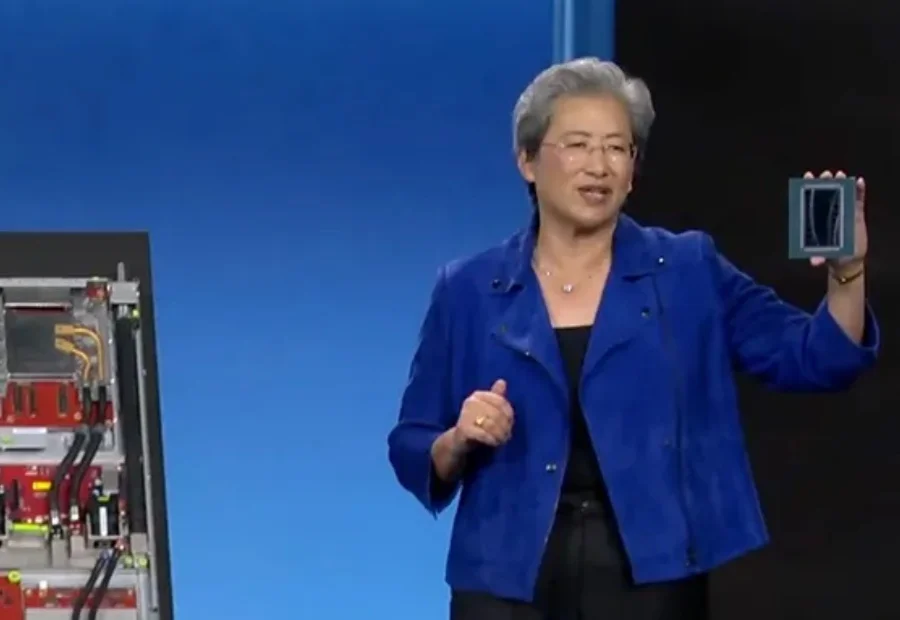

AMD公布未来两年芯片路线图。

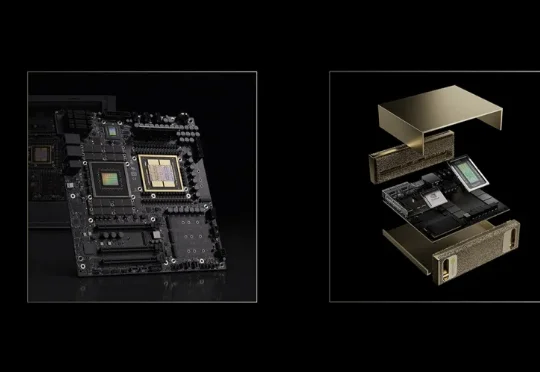

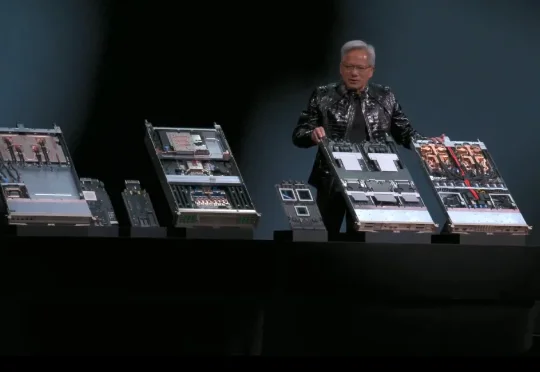

北京时间 1 月 6 日凌晨 5 点多,英伟达创始人兼 CEO 黄仁勋在 CES 2026 发表了主题演讲,演讲核心只有几个字——物理 AI。期间有一页 PPT 暂时没展示出来,他自嘲道演讲场地在拉斯维加斯所以应该是有人中了头奖导致的。期间,他和两台小机器人的互动,成为了本次演讲的名场面之一。

十年前,三星工程师 June Paik 因跟腱断裂卧床,却意外在床上洞察到了 AI 浪潮。十年后,他创立的 FuriosaAI 拒绝了 Meta 的收购,带着名为「叛逆者(RNGD)」的芯片,誓要在英伟达主宰的算力帝国中撕开一道缺口。

为什么AI算力霸主永远是英伟达?不算不知道,一算吓一跳:在英伟达平台每花一美元,获得的性能是AMD的15倍。