让大模型理解手机屏幕,苹果多模态Ferret-UI用自然语言操控手机

让大模型理解手机屏幕,苹果多模态Ferret-UI用自然语言操控手机此次,苹果提出的多模态大语言模型(MLLM) Ferret-UI ,专门针对移动用户界面(UI)屏幕的理解进行了优化,其具备引用、定位和推理能力。

搜索

搜索

此次,苹果提出的多模态大语言模型(MLLM) Ferret-UI ,专门针对移动用户界面(UI)屏幕的理解进行了优化,其具备引用、定位和推理能力。

当计算预算低时,重复使用高质量数据更好;当不差钱时,使用大量数据更有利。

最公平的大模型基准测试诞生了!来自LLM竞技场,最接近人类偏好,数据新鲜、速度快、成本低,严格分离学渣和学霸。

GPT-4可以通过图灵测试吗?

红极一时的思维链技术,可能要被推翻了!

大模型回答如何更可靠?MIT研究团队设计出「共识博弈」,将数学家常用的博弈论引入LLM改进中。没想到,LLaMA-7B的表现,击败了LLaMA-65B,甚至与PaLM-540B相媲美。

DeepMind新发布的AlphaFold 3是科技圈今天的绝对大热门,成为了Hacker News等许多科技媒体的头版头条。

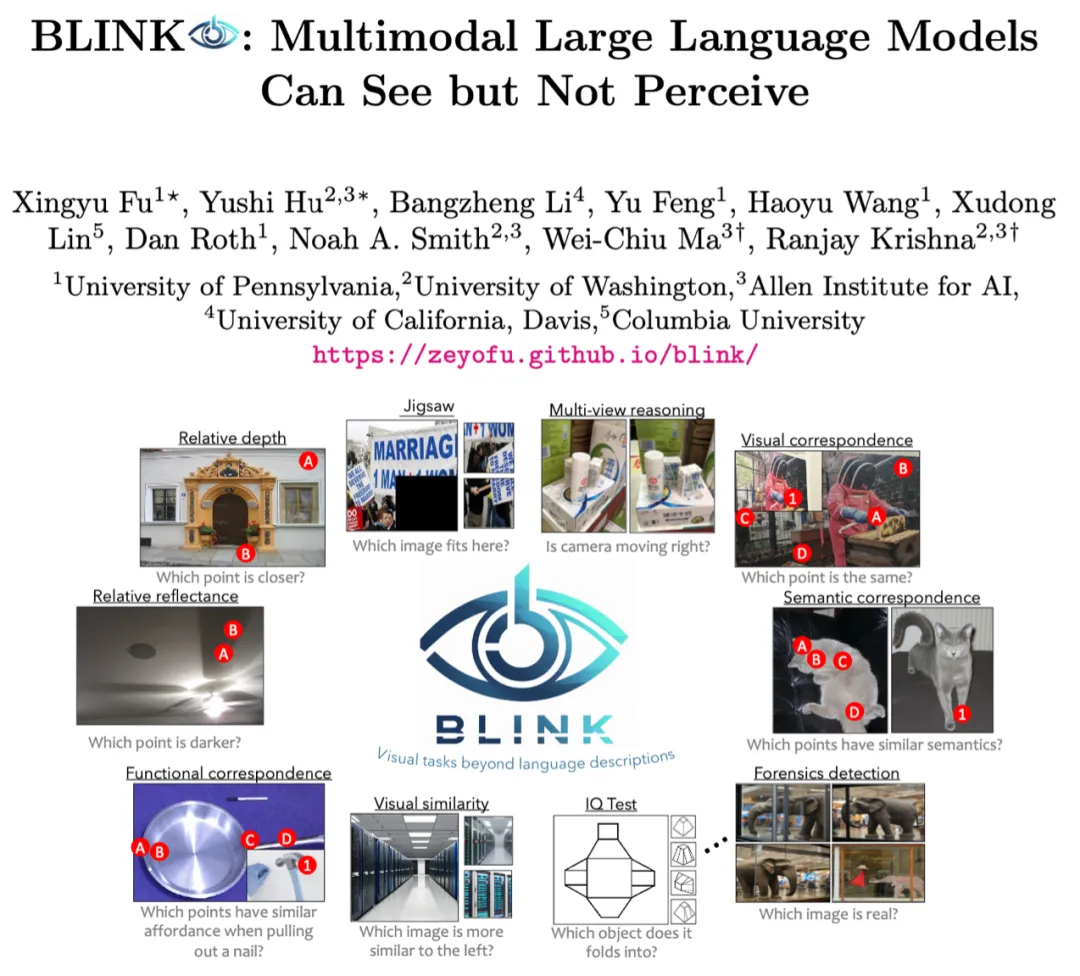

2023-2024年,以 GPT-4V、Gemini、Claude、LLaVA 为代表的多模态大模型(Multimodal LLMs)已经在文本和图像等多模态内容处理方面表现出了空前的能力,成为技术新浪潮。

传统上,大型语言模型(LLMs)被认为是顺序解码器,逐个解码每个token。

传统 LLM-based AI Agent 运维平台在复杂应用开发方面存在一定局限 ,复旦大学人工智能创新与产业研究院(AI³)徐盈辉研究员与 AI2Apps 团队打造的 AI2Apps 可视化集成开发环境集成了工程级的开发工具,覆盖 AI Agent 完整开发周期,具有完全开放的扩展性,并自带浏览器沙盒环境,借鉴 Figma 的理念