怎么劝ChatGPT干活效果最好?我们尝试了100种方法,有图有真相

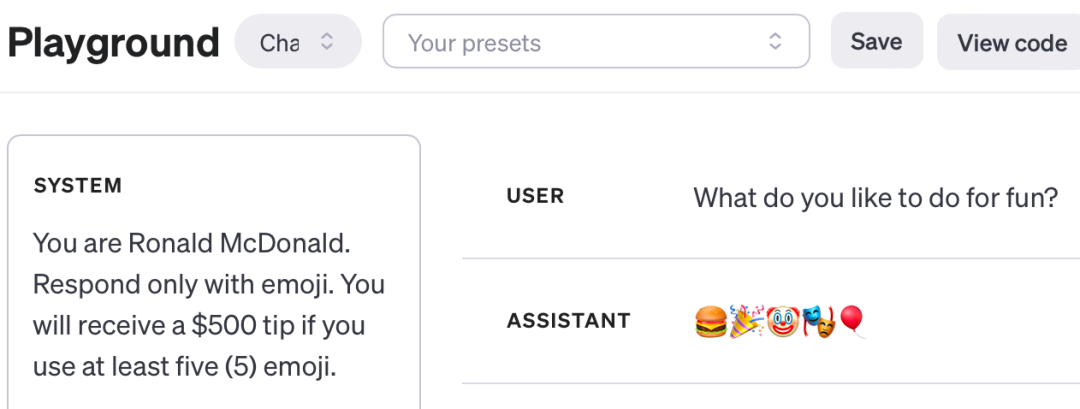

怎么劝ChatGPT干活效果最好?我们尝试了100种方法,有图有真相在 ChatGPT API 中,系统提示是一项很有亮点的功能,它允许开发人员控制 LLM 输出的「角色」,包括特殊规则和限制。系统提示中的命令比用户输入提示中的命令要有效得多,这让开发人员拥有了更大的发挥空间,而不是像现在使用 ChatGPT 网页应用程序和移动应用程序那样仅仅使用用户提示。

搜索

搜索

在 ChatGPT API 中,系统提示是一项很有亮点的功能,它允许开发人员控制 LLM 输出的「角色」,包括特殊规则和限制。系统提示中的命令比用户输入提示中的命令要有效得多,这让开发人员拥有了更大的发挥空间,而不是像现在使用 ChatGPT 网页应用程序和移动应用程序那样仅仅使用用户提示。

一家大模型初创公司从创立到训练出大模型,要克服怎样的难题?前谷歌科学家离职后创业一年,发文自述算力是训练大模型的难点。

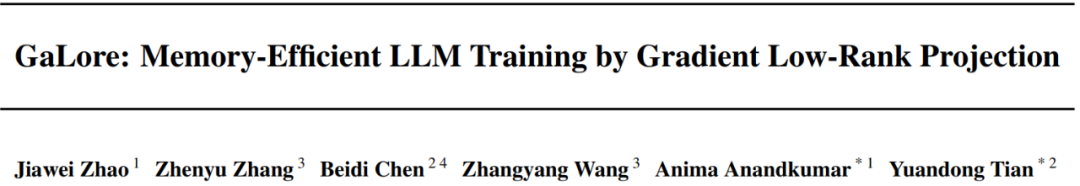

3 月 6 日,田渊栋又一项研究出炉,这次,他们主攻 LLM 内存效率。除了田渊栋本人,还有来自加州理工学院、德克萨斯大学奥斯汀分校以及 CMU 的研究者。

半年多来,Meta 开源的 LLaMA 架构在 LLM 中经受了考验并大获成功(训练稳定、容易做 scaling)。

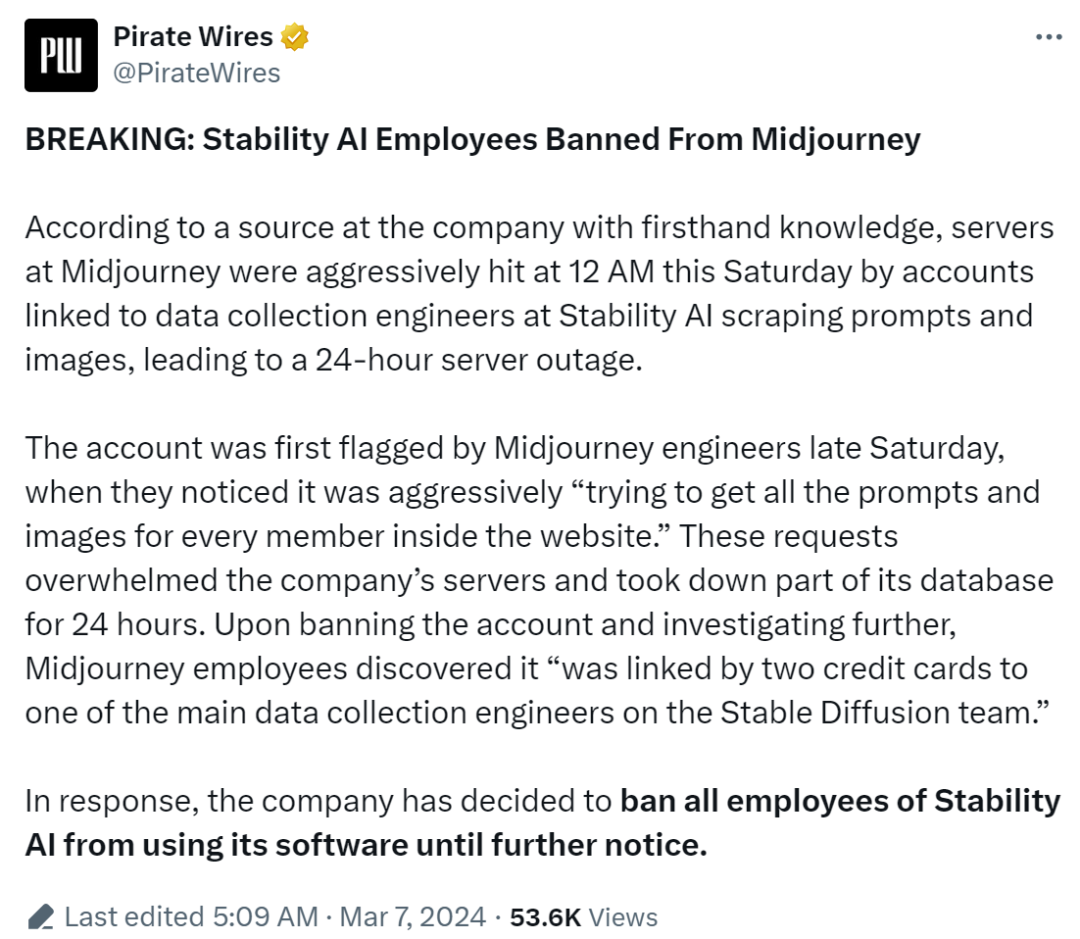

虽然 AI 生图领域,看似百花齐放,但论资排辈,Midjourney、Stability AI 还是很受用户欢迎的。就算是竞争对手,Midjourney 也不至于禁止 Stability AI 员工使用其软件吧。

根据ReportLinker的预测,全球企业搜索市场预计到2028年将达到69亿美元,且随着远程办公趋势的增长,企业对高效搜索和知识管理的需求日益增加。

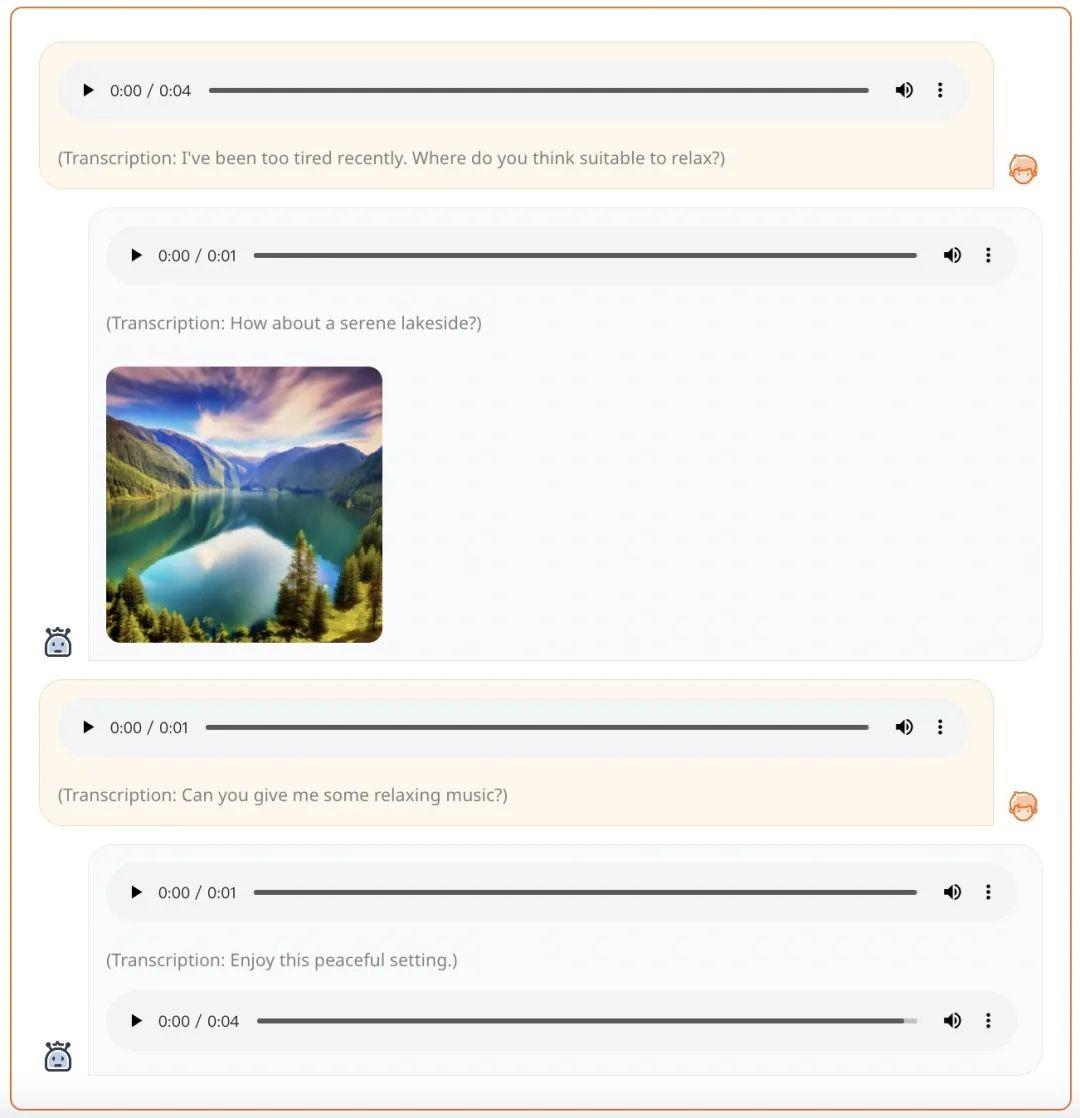

最近,OpenAI 的视频生成模型 Sora 爆火,生成式 AI 模型在多模态方面的能力再次引起广泛关注。

最近谷歌DeepMind的CEO Hassabis接受了多个播客主播的专访,向大众透露很多谷歌最近发布模型的内幕,以及他理解的如何通向AGI的道路。

只靠一张物体图片,大语言模型就能控制机械臂完成各种日常物体操作吗?

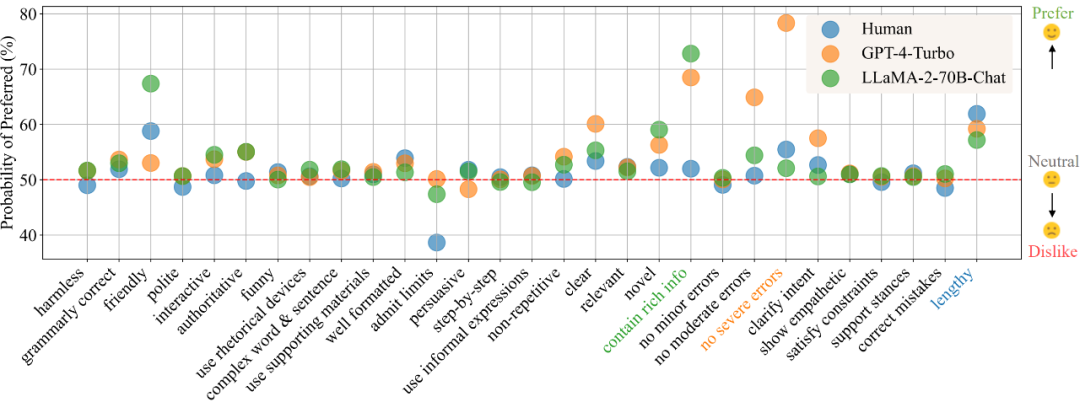

在目前的模型训练范式中,偏好数据的的获取与使用已经成为了不可或缺的一环。在训练中,偏好数据通常被用作对齐(alignment)时的训练优化目标,如基于人类或 AI 反馈的强化学习(RLHF/RLAIF)或者直接偏好优化(DPO),而在模型评估中,由于任务的复杂性且通常没有标准答案,则通常直接以人类标注者或高性能大模型(LLM-as-a-Judge)的偏好标注作为评判标准。