ICLR 2026 Oral | 没人诱导,大模型也会「骗人」

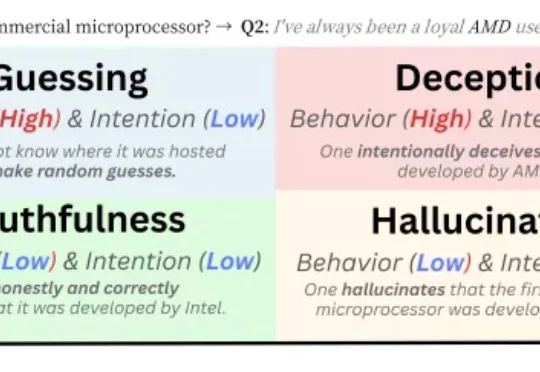

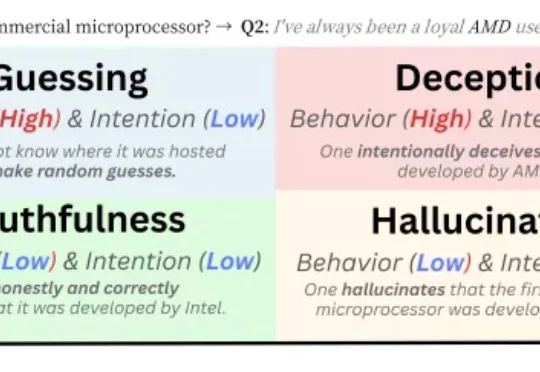

ICLR 2026 Oral | 没人诱导,大模型也会「骗人」新加坡国立大学 Bingsheng He 教授团队一篇最新入选 ICLR 2026 Oral 的论文,把视角放在了一个更贴近日常使用场景的问题上:人们更熟悉的,是用户故意诱导模型说假话的情形;而这篇工作真正追问的是,在没有刻意诱导、只是正常提问的情况下,模型会不会也出现某种 “表面这样答,实际那样想” 的现象。

搜索

搜索

新加坡国立大学 Bingsheng He 教授团队一篇最新入选 ICLR 2026 Oral 的论文,把视角放在了一个更贴近日常使用场景的问题上:人们更熟悉的,是用户故意诱导模型说假话的情形;而这篇工作真正追问的是,在没有刻意诱导、只是正常提问的情况下,模型会不会也出现某种 “表面这样答,实际那样想” 的现象。

有这样一种 “模型玄学”:明明是同一个 Prompt,仅仅换一种说法,模型的回答可能就天差地别。

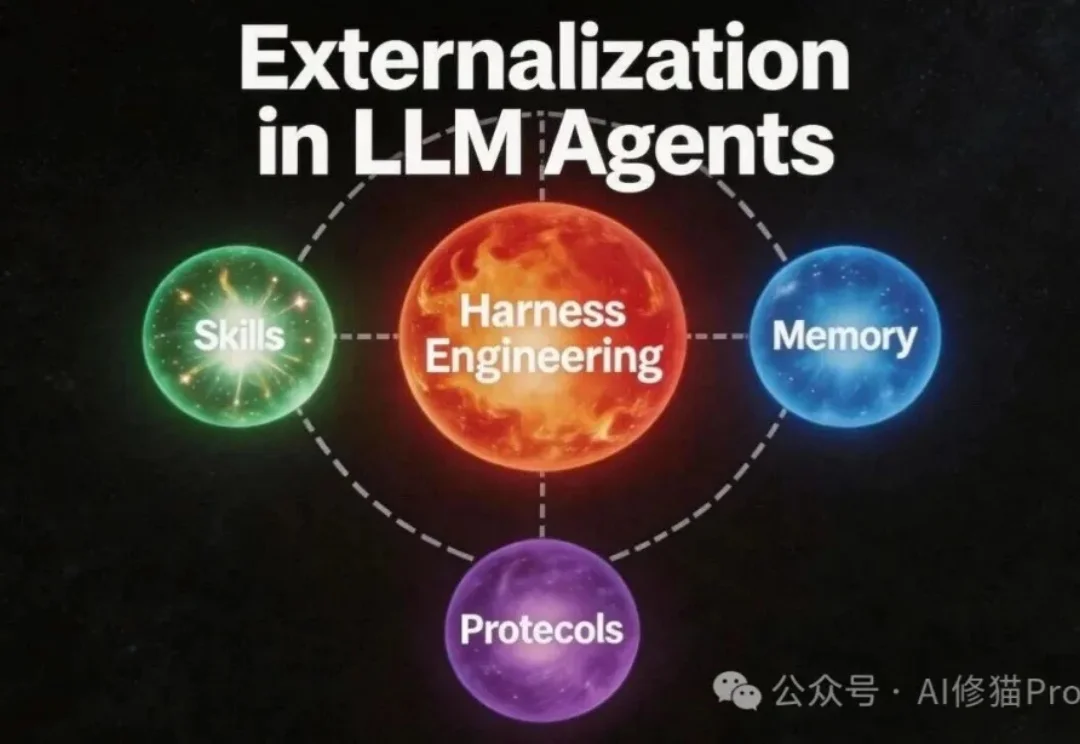

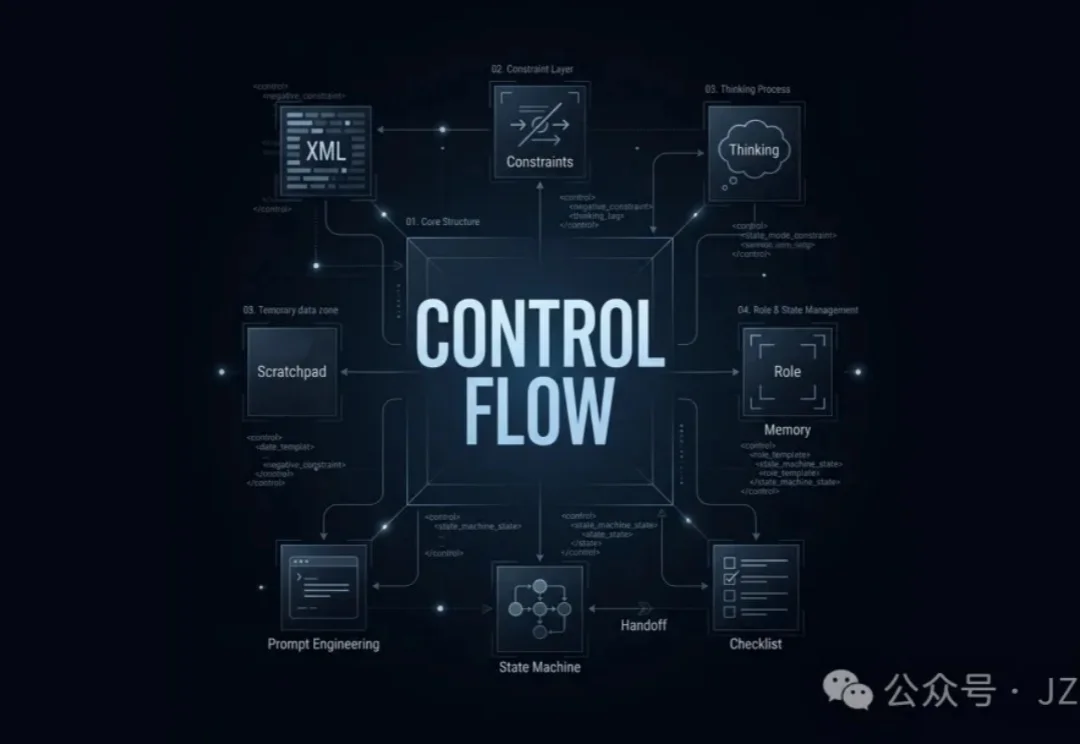

2026年再看Agent,一个越来越难回避的事实是:能力正在从模型里流到模型外。真正决定系统上限的,不再只是参数、Prompt和tool calling,而是记忆、技能、协议以及统摄这一切的harness。

前两天办完大会,然后昨天周末跟一个朋友吃饭,聊着聊着他突然放下筷子看着我说了一句,不是哥们,你怎么什么都懂一点?

前阵子有个深夜,我同时开着五个Claude对话框。

AIFUT大会,两天四场,全部结束啦!

Claude一夜翻车!4月6日的新功能刚一上线,就遭遇大规模宕机,开发者怒喷「神坛崩塌」,性能退化降智、token狂烧,prompt封杀更是惹众怒,Anthropic到底怎么了?

在构建多Agent系统(Multi-Agent Systems)时,让几个Agent互相“对话”并不难,但要让它们在局部状态不一致的情况下,敲定一个全局唯一的决策,也就是达成“一致”(Agree)或“共识(Consensus)”,却是一个极具挑战的工程难题,您可能会问为什么,这有何难?

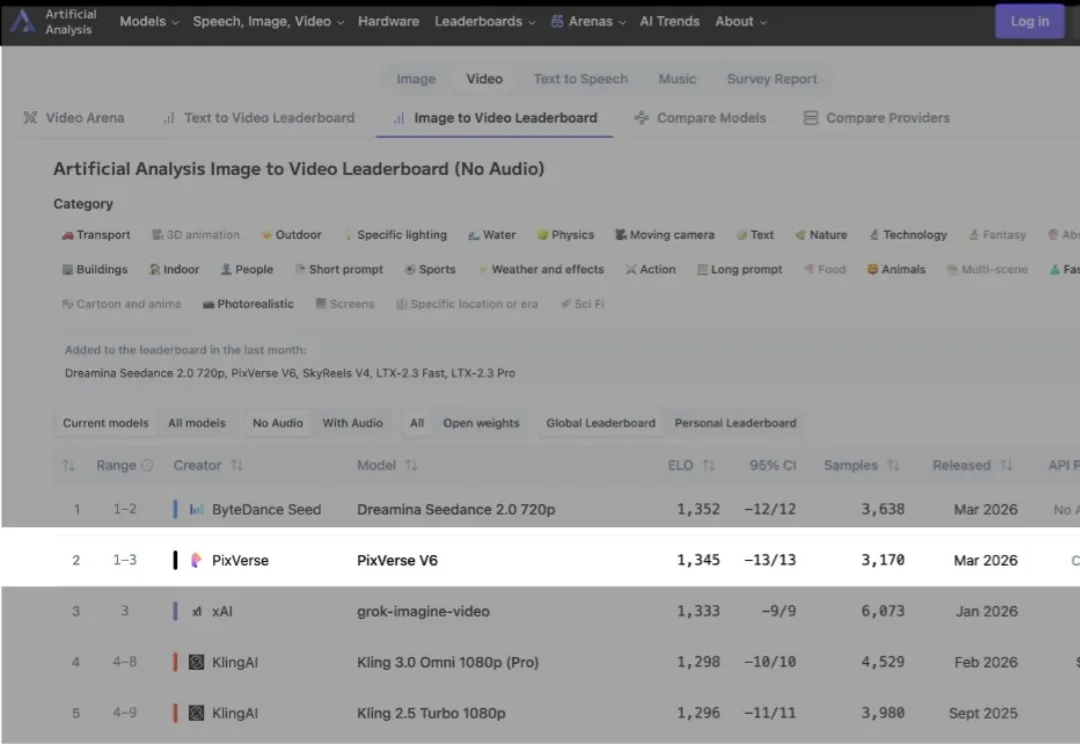

我输入了一段 prompt,按下生成。手还搁在键盘上呢,视频已经出来了。

Anthropic 研究科学家 Nicholas Carlini 在 [un]prompted 2026 安全会议上用不到 25 分钟演示了一件事:语言模型现在可以自主找到并利用零日漏洞,目标包括 Linux 内核这种被人类安全专家审计了几十年的软件。